取人类与大模型之长,人机协作式智能软件开发框架AgileGen来了

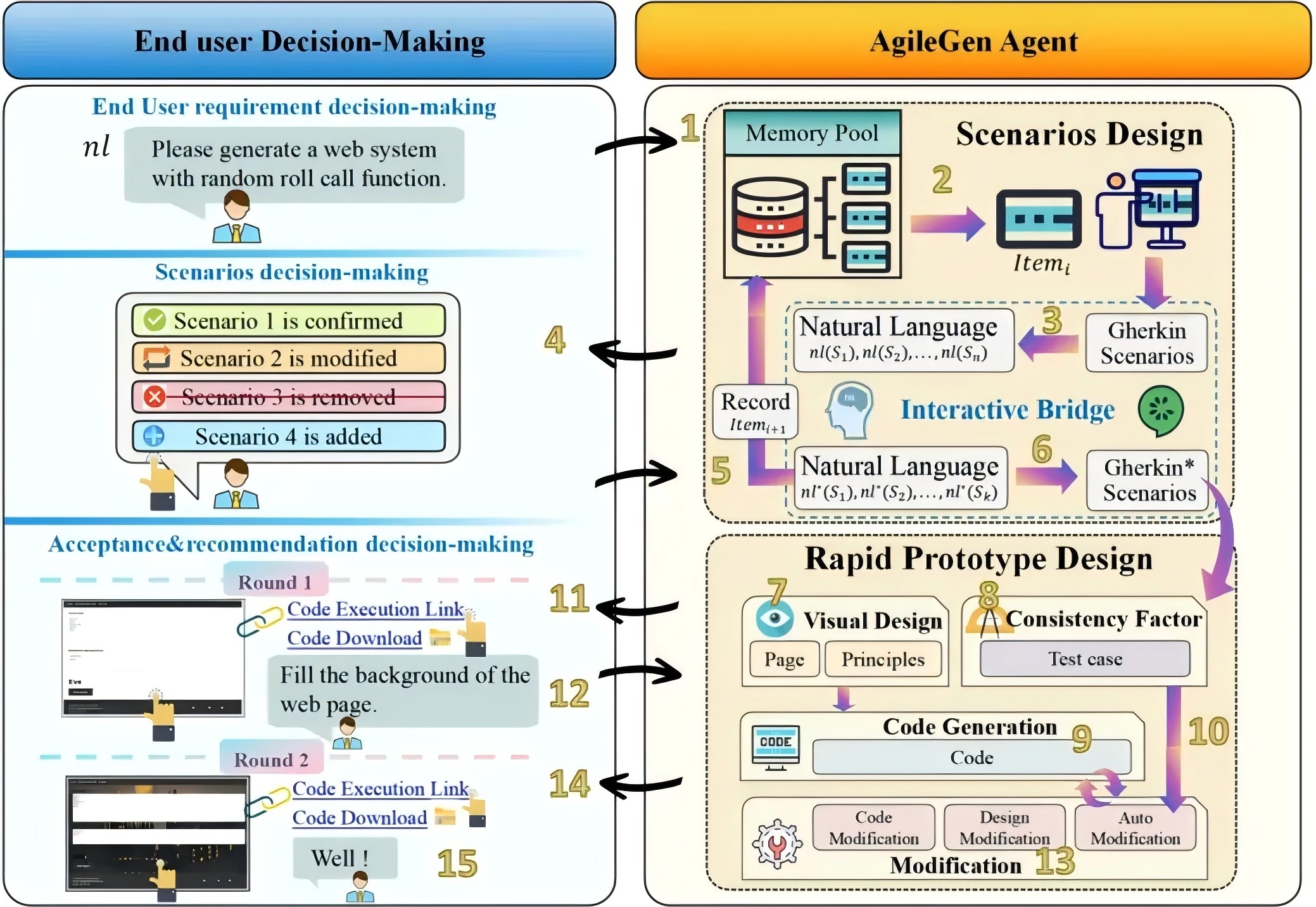

取人类与大模型之长,人机协作式智能软件开发框架AgileGen来了我们即将介绍的 AgileGen— 一种基于人机协作的敏捷生成式软件开发框架。

我们即将介绍的 AgileGen— 一种基于人机协作的敏捷生成式软件开发框架。

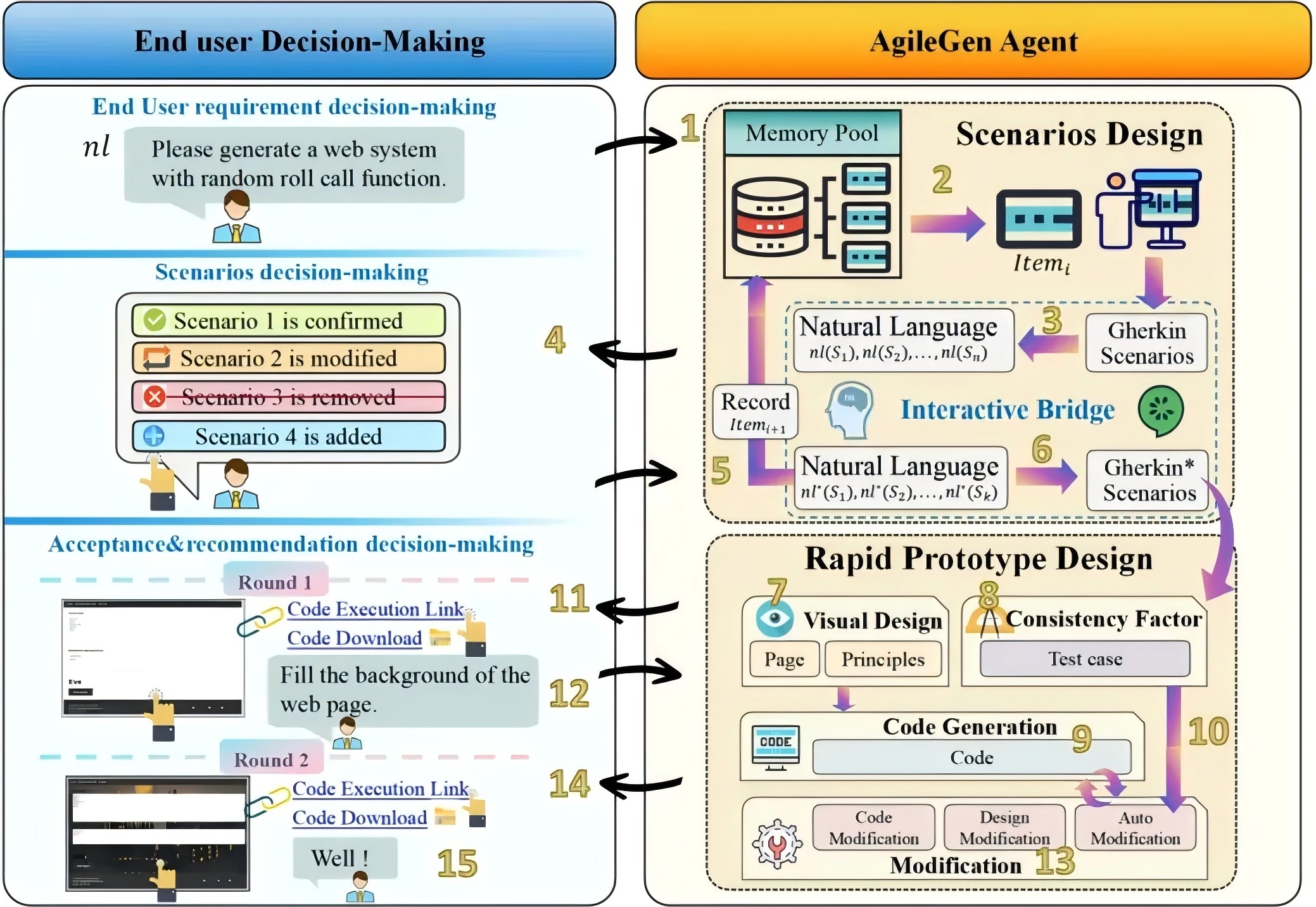

大模型在数学问题上的表现不佳,原因在于采取启发式算法进行数学运算的,通过定位到多层感知机(MLP)中的单个神经元,可以对进行数学运算的具体过程进行解释。

近期,围绕Scaling Law的讨论不绝于耳。

DIAMOND是一种新型的强化学习智能体,在一个由扩散模型构建的虚拟世界中进行训练,能够以更高效率学习和掌握各种任务。在Atari 100k基准测试中,DIAMOND的平均得分超越了人类玩家,证明了其在模拟复杂环境中处理细节和进行决策的能力。

最近,大家都被这条消息吓到了:传说Grok 3已经成功证明出黎曼猜想?!虽然这是在玩梗,但还是让我们来仔细剖析下,目前的AI距离千禧年数学难题,究竟还有多远。

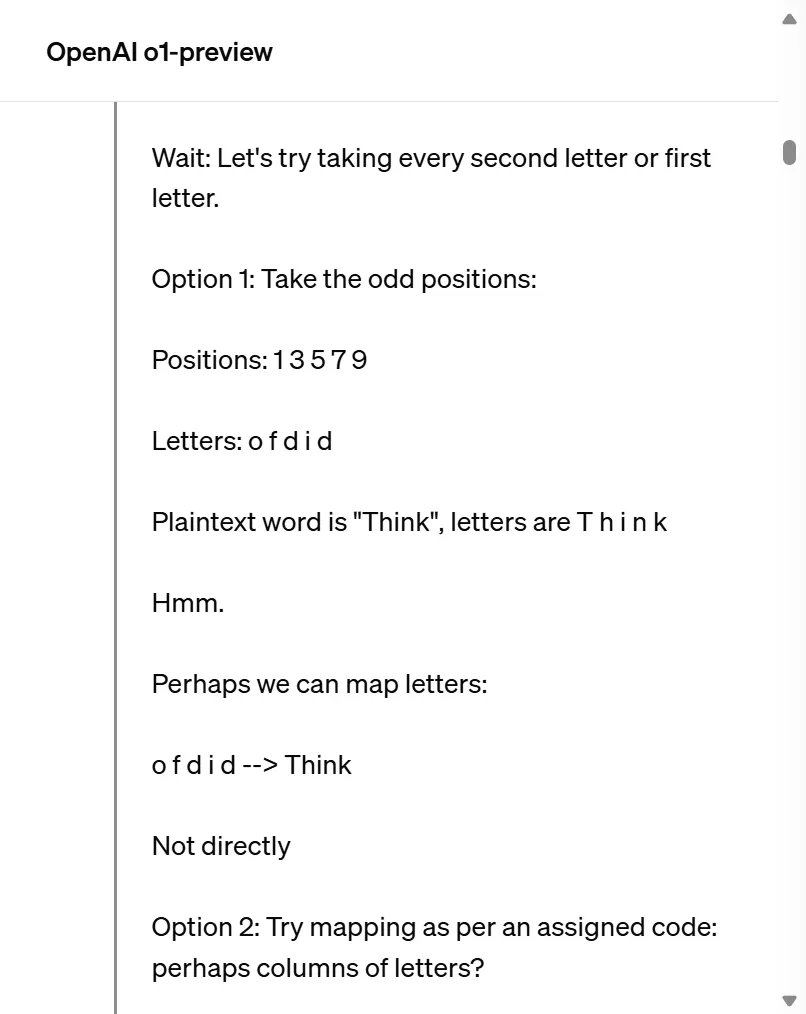

自我纠错(Self Correction)能力,传统上被视为人类特有的特征,正越来越多地在人工智能领域,尤其是大型语言模型(LLMs)中得到广泛应用,最近爆火的OpenAI o1模型[1]和Reflection 70B模型[2]都采取了自我纠正的方法。

想象一下,使用人工智能比较两个看似毫无关联的创造——生物组织和贝多芬的《第九交响曲》。

如今,机器人学习最大的瓶颈是缺乏数据。与图片和文字相比,机器人的学习数据非常稀少。目前机器人学科的主流方向是通过扩大真实世界中的数据收集来尝试实现通用具身智能,但是和其他的基础模型,比如初版的 StableDiffusion 相比,即使是 pi 的数据都会少七八个数量级。

在现代 AI 模型的快速迭代中,如何在保持模型精度的同时提升计算效率成为关键课题。尤其在大规模 AI 推理中,非结构化稀疏矩阵的计算效率低下成为难以突破的瓶颈。面对这一挑战,我们自主研发了 CROSS—— 一种创新的端到端稀疏编译优化方案,为 AI 推理带来细粒度稀疏计算的加速效果。

哈佛斯坦福MIT等机构首次提出「精度感知」scaling law,揭示了精度、参数规模、数据量之间的统一关系。数据量增加,模型对量化精度要求随之提高,这预示着AI领域低精度加速的时代即将结束!