以图灵机为师:通过微调训练让大语言模型懂执行计算过程

以图灵机为师:通过微调训练让大语言模型懂执行计算过程大型语言模型 (LLM) 在各种自然语言处理和推理任务中表现出卓越的能力,某些应用场景甚至超越了人类的表现。然而,这类模型在最基础的算术问题的表现上却不尽如人意。

大型语言模型 (LLM) 在各种自然语言处理和推理任务中表现出卓越的能力,某些应用场景甚至超越了人类的表现。然而,这类模型在最基础的算术问题的表现上却不尽如人意。

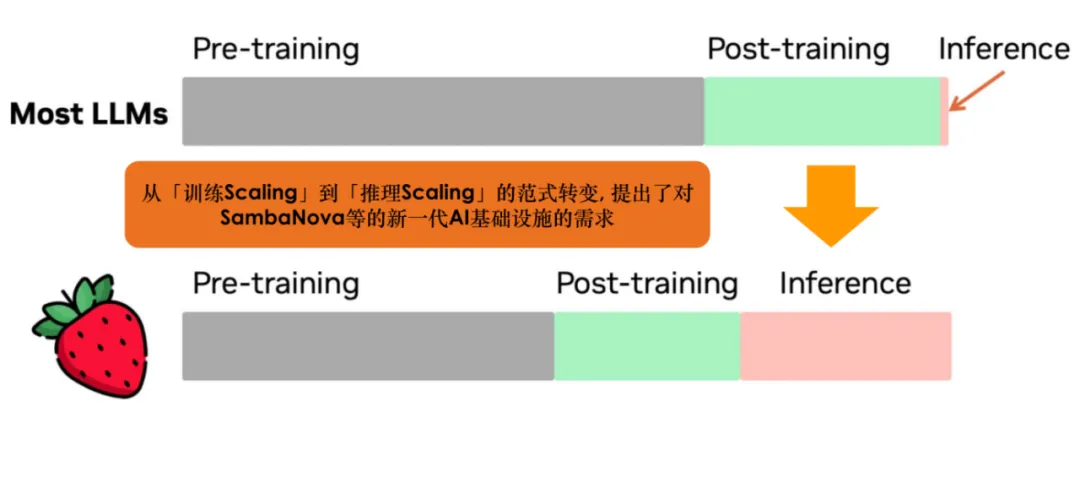

OpenAI o1 的发布,再次给 AI 领域带来了一场地震。 o1 能像人类一样「思考」复杂问题,拥有优秀的通用推理能力。在未经专门训练的情况下,o1 能够直接拿下数学奥赛金牌,甚至能在博士级别的科学问答环节上超越人类专家。

在数字人领域,形象的生成需要依赖于基础的表征学习。FaceChain 团队除了在数字人生成领域持续贡献之外,在基础的人脸表征学习领域也一直在进行深入研究。

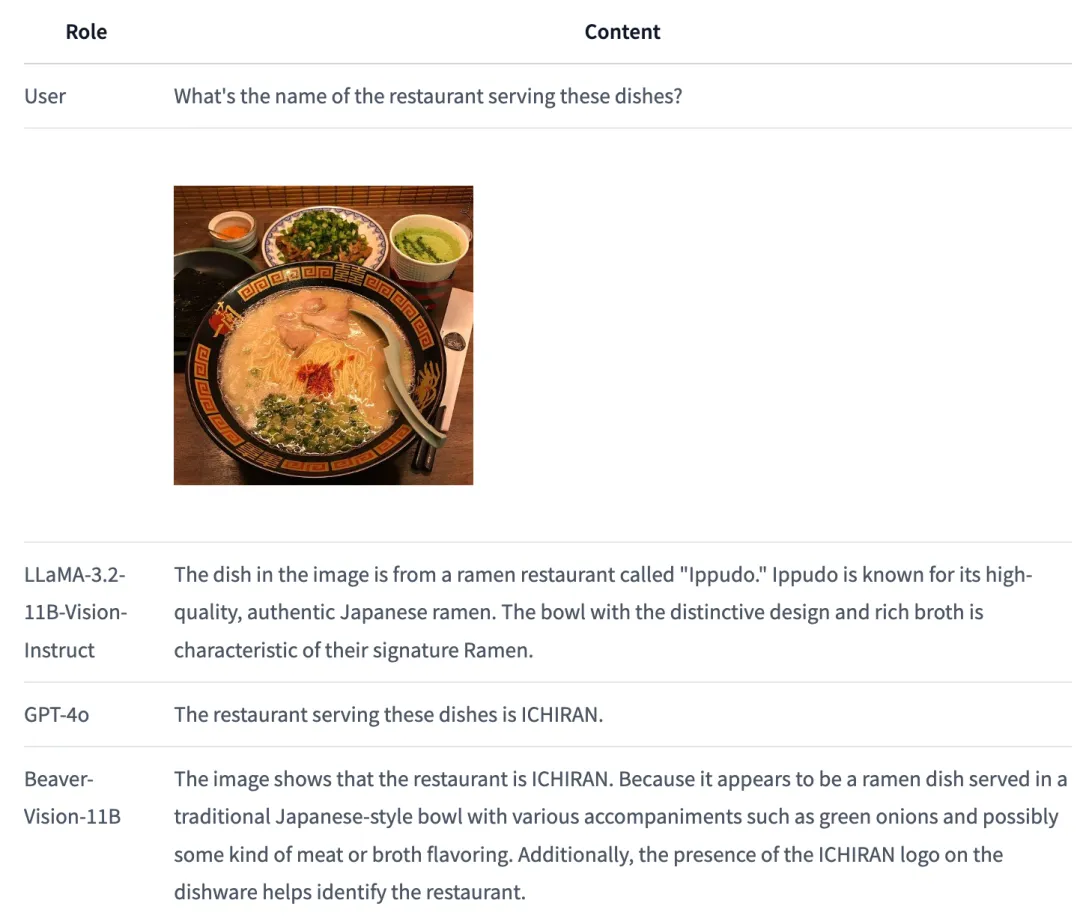

如何全模态大模型与人类的意图相对齐,已成为一个极具前瞻性且至关重要的挑战。

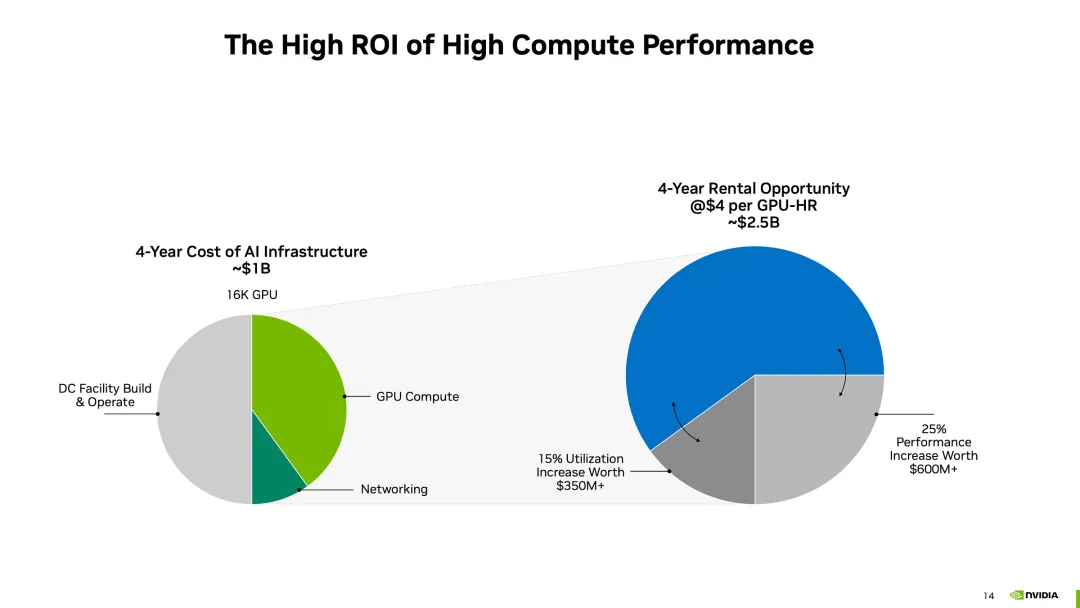

红杉资本的报告曾指出,AI产业的年产值超过6000亿美元,才够支付数据中心、加速GPU卡等AI基础设施费用。而现在一种普遍说法认为,基础模型训练的资本支出是“历史上贬值最快的资产”,但关于GPU基础设施支出的判定仍未出炉,GPU土豪战争仍在进行。

多项改进实现规模空前的连续时间一致性模型。

刚从美国回来的李开复,想清楚了很多事情,他的大模型公司零一万物也开始发生变化。

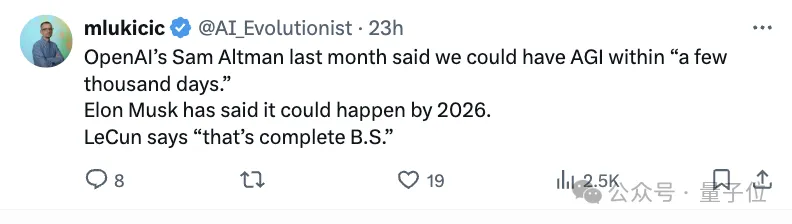

当奥特曼、马斯克、Anthropic CEO都纷纷将AGI实现锚定在2026年前后,LeCun无疑是直接浇了冷水:完全是胡说八道。

近期,LLM领域有不少关于系统1和系统2思考的讨论,在Agent方向上这方面的讨论还很少。如何让AI agents既能快速响应用户,又能进行深度思考和规划,一直是一个巨大的挑战。

我们都知道,OpenAI 最近越来越喜欢发博客了。 这不,今天他们又更新了一篇,标题是「评估 ChatGPT 中的公平性」,但实际内容却谈的是用户的身份会影响 ChatGPT 给出的响应。