8B文字多模态大模型指标逼近GPT4V,字节、华师、华科联合提出TextSquare

8B文字多模态大模型指标逼近GPT4V,字节、华师、华科联合提出TextSquare近期,多模态大模型 (MLLM) 在文本中心的 VQA 领域取得了显著进展,尤其是多个闭源模型,例如:GPT4V 和 Gemini,甚至在某些方面展现了超越人类能力的表现。

近期,多模态大模型 (MLLM) 在文本中心的 VQA 领域取得了显著进展,尤其是多个闭源模型,例如:GPT4V 和 Gemini,甚至在某些方面展现了超越人类能力的表现。

Snowflake 发布高「企业智能」模型 Arctic,专注于企业内部应用。

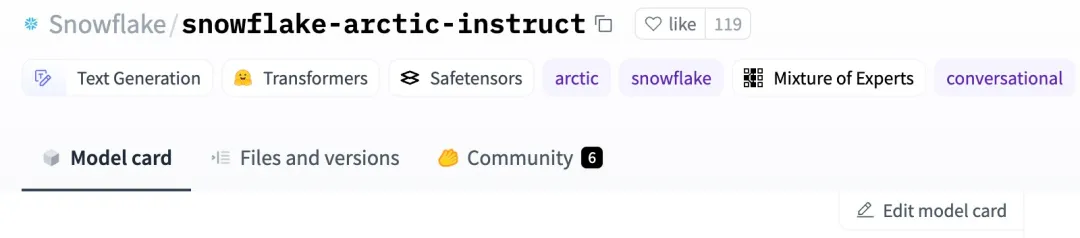

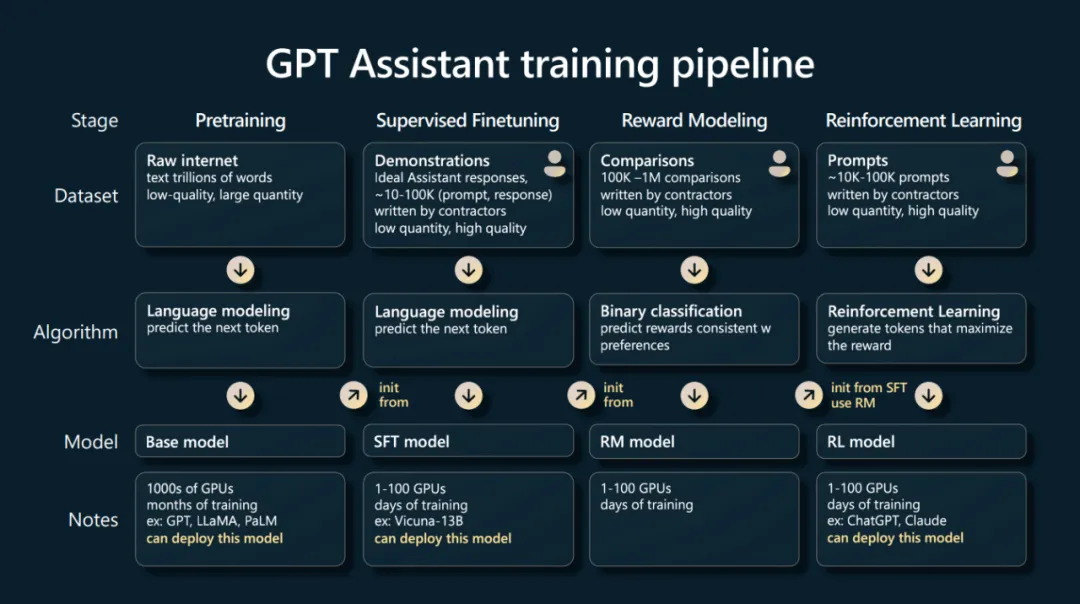

在人工智能的前沿领域,大语言模型(Large Language Models,LLMs)由于其强大的能力正吸引着全球研究者的目光。在 LLMs 的研发流程中,预训练阶段占据着举足轻重的地位,它不仅消耗了大量的计算资源,还蕴含着许多尚未揭示的秘密。

要说 ChatGPT 拉开了大模型竞赛的序幕,那么 Meta 开源 Llama 系列模型则掀起了开源领域的热潮。在这当中,苹果似乎掀起的水花不是很大。

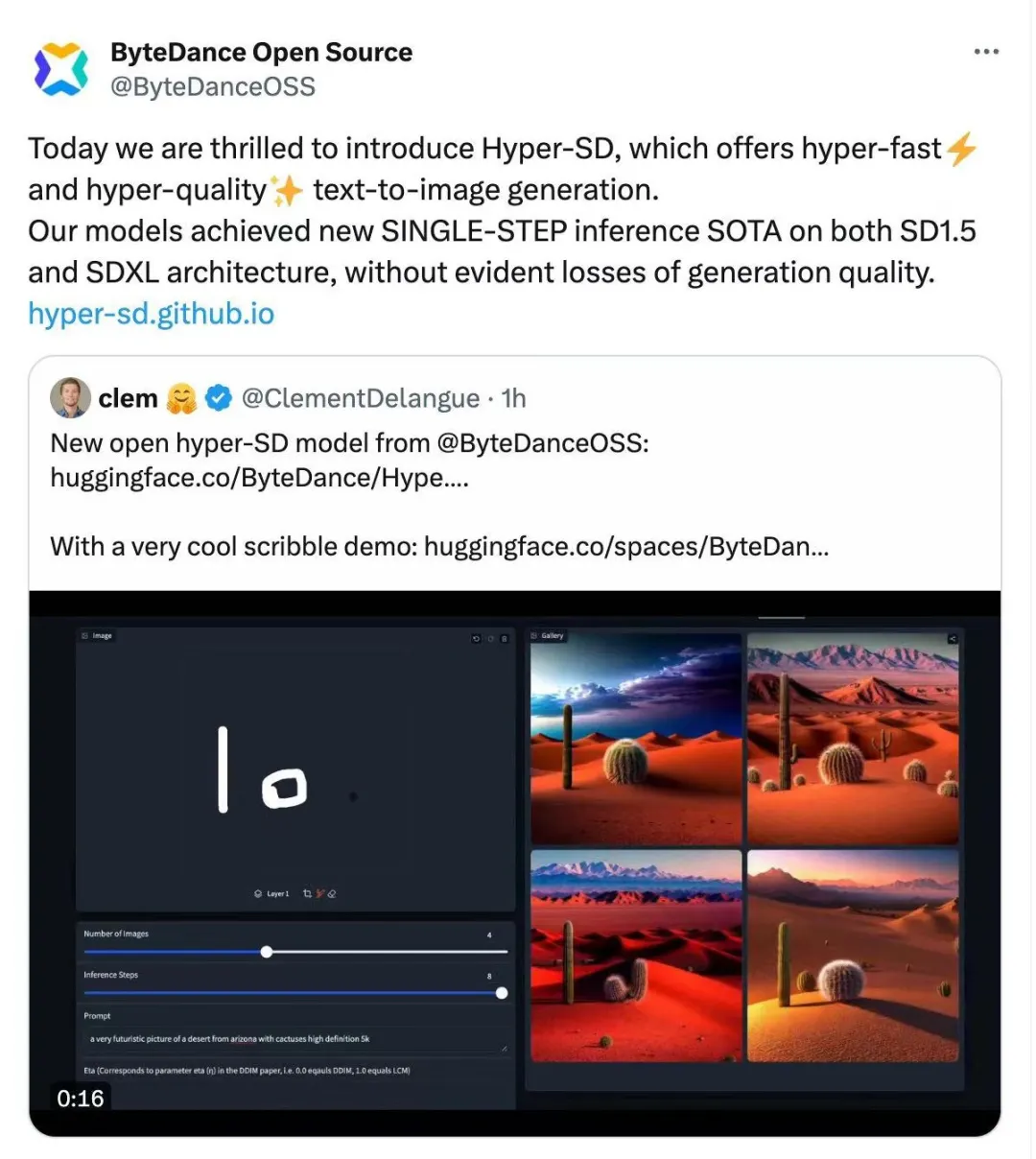

最近,扩散模型(Diffusion Model)在图像生成领域取得了显著的进展,为图像生成和视频生成任务带来了前所未有的发展机遇。尽管取得了令人印象深刻的结果,扩散模型在推理过程中天然存在的多步数迭代去噪特性导致了较高的计算成本。

在人物说话的过程中,每一个细微的动作和表情都可以表达情感,都能向观众传达出无声的信息,也是影响生成结果真实性的关键因素。

国内AI不行,是因为芯片不行? 我们跟国外的差距,是因为和英伟达芯片的差距过大?

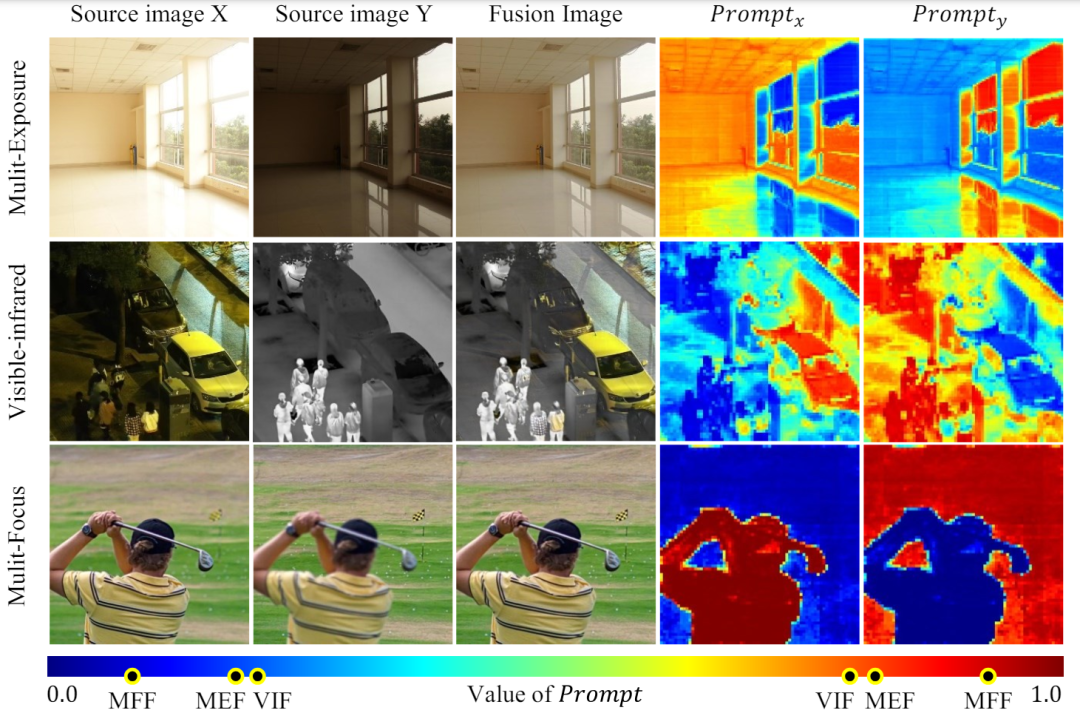

图像融合的目的是将同一场景中不同传感器捕获的多源图像的互补信息整合到单个图像上。这种方式通常被用于提取图片重要信息和提高视觉质量。

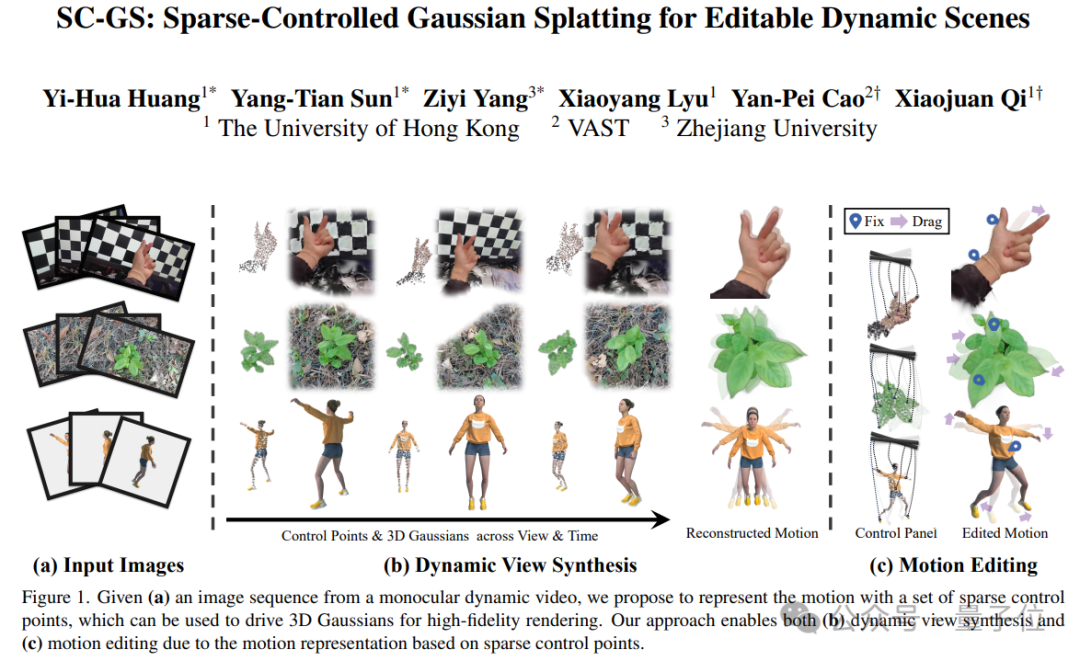

高斯溅射(Gaussian Splatting)在新视角合成领域掀起了一轮革命性浪潮,取代上一代技术神经辐射场(NeRF)成为学界业界顶流

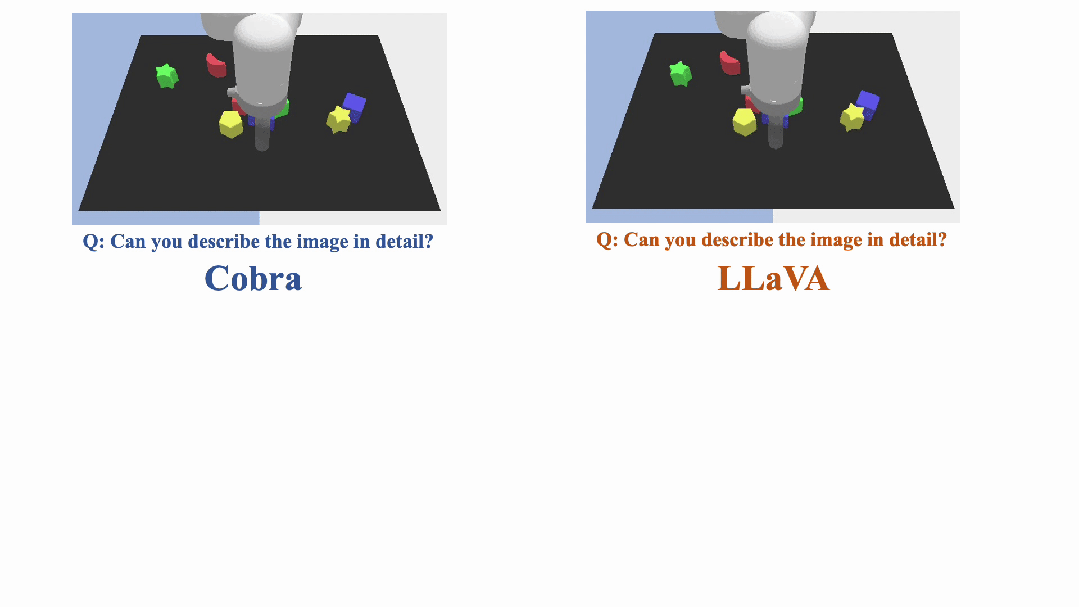

近年来,多模态大型语言模型(MLLM)在各个领域的应用取得了显著的成功。然而,作为许多下游任务的基础模型,当前的 MLLM 由众所周知的 Transformer 网络构成,这种网络具有较低效的二次计算复杂度。