“想拿我的数据训练AI,那麻烦先把账结一下” 果壳 果壳 壁虎小队 关注

“想拿我的数据训练AI,那麻烦先把账结一下” 果壳 果壳 壁虎小队 关注当我们感慨 AI 快把人类一锅端了时,有大聪明发现了 AI 的一生之敌——弱智吧。

当我们感慨 AI 快把人类一锅端了时,有大聪明发现了 AI 的一生之敌——弱智吧。

近年来,人工智能发展迅速,尤其是像ChatGPT这样的基础大模型,在对话、上下文理解和代码生成等方面表现出色,能够为多种任务提供解决方案。

谷歌就此成为了第一家因为训练数据而被罚款的人工智能公司。

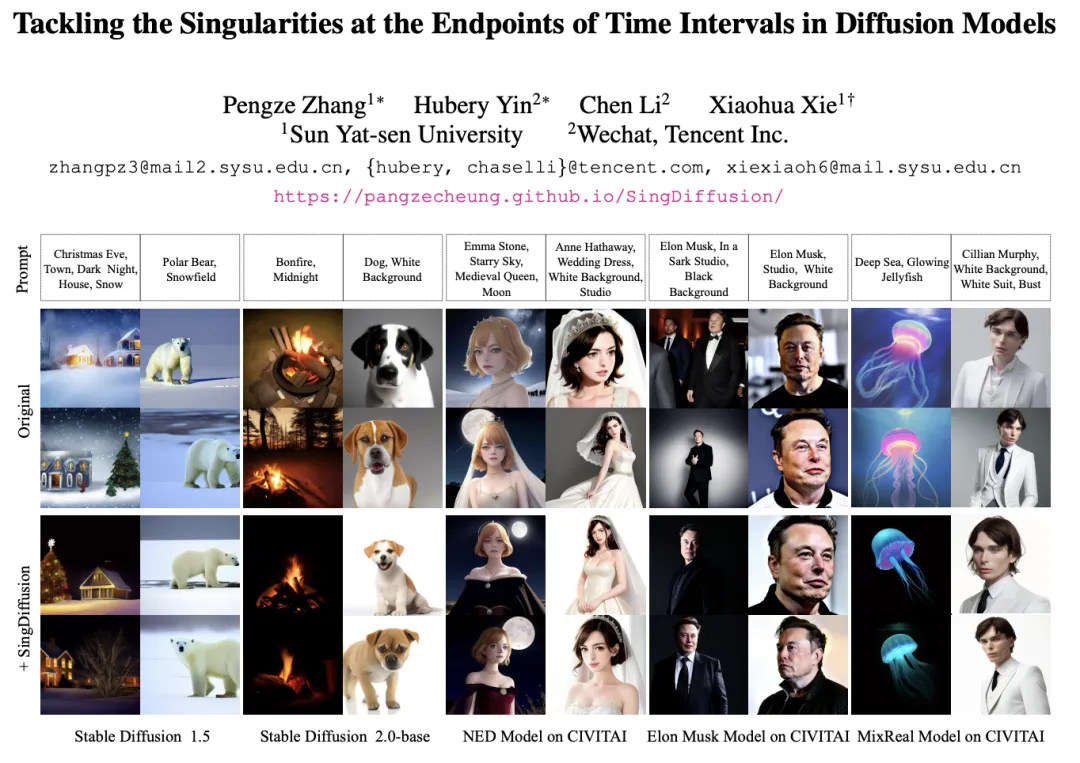

扩散模型凭借其在图像生成方面的出色表现,开启了生成式模型的新纪元。诸如 Stable Diffusion,DALLE,Imagen,SORA 等大模型如雨后春笋般涌现,进一步丰富了生成式 AI 的应用前景。然而,当前的扩散模型在理论上并非完美,鲜有研究关注到采样时间端点处未定义的奇点问题。此外,奇点问题在应用中导致的平均灰度等影响生成图像质量的问题也一直未得到解决。

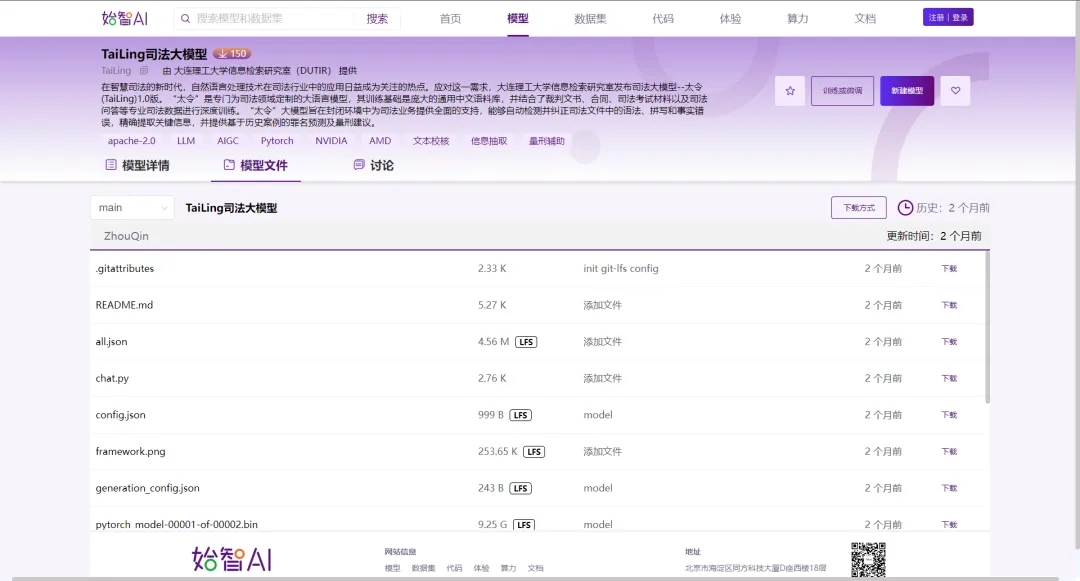

大连理工大学信息检索研究室在始智AI wisemodel.cn开源社区发布了司法大模型--太令(TaiLing)1.0版,“太令”是专门为司法领域定制的大语言模型,其训练基础是庞大的通用中文语料库,并结合了裁判文书、合同、司法考试材料以及司法问答等专业司法数据进行深度训练。

RLHF 通过学习人类偏好,能够在难以手工设计奖励函数的复杂决策任务中学习到正确的奖励引导,得到了很高的关注,在不同环境中选择合适的人类反馈类型和不同的学习方法至关重要

2022年底,OpenAI(美国人工智能研究公司)发布的大模型ChatGPT(对话生成式预训练大模型)引发了广泛关注。在“大模型+大数据+大算力”的加持下,ChatGPT能够通过自然语言交互完成多种任务,具备了多场景、多用 途、跨学科的任务处理能力。

随着 Sora 的成功发布,视频 DiT 模型得到了大量的关注和讨论。设计稳定的超大规模神经网络一直是视觉生成领域的研究重点。DiT [1] 的成功为图像生成的规模化提供了可能性。

图是组织信息的一种有用方式,但LLMs主要是在常规文本上训练的。谷歌团队找到一种将图转换为LLMs可以理解的格式的方法,显著提高LLMs在图形问题上超过60%的准确性。

大模型的训练阶段我们选择GPU,但到了推理阶段,我们果断把CPU加到了菜单上。