拿CPU搞AI推理,谁给你的底气?

拿CPU搞AI推理,谁给你的底气?大模型的训练阶段我们选择GPU,但到了推理阶段,我们果断把CPU加到了菜单上。

大模型的训练阶段我们选择GPU,但到了推理阶段,我们果断把CPU加到了菜单上。

【新智元导读】GPT-5还未发布,GPT-6已经在路上了?微软工程师曝出,为GPT-6搭建10万个H100训练集群,整个电网却被搞崩。通往AGI大关,还需要破解电力难题。

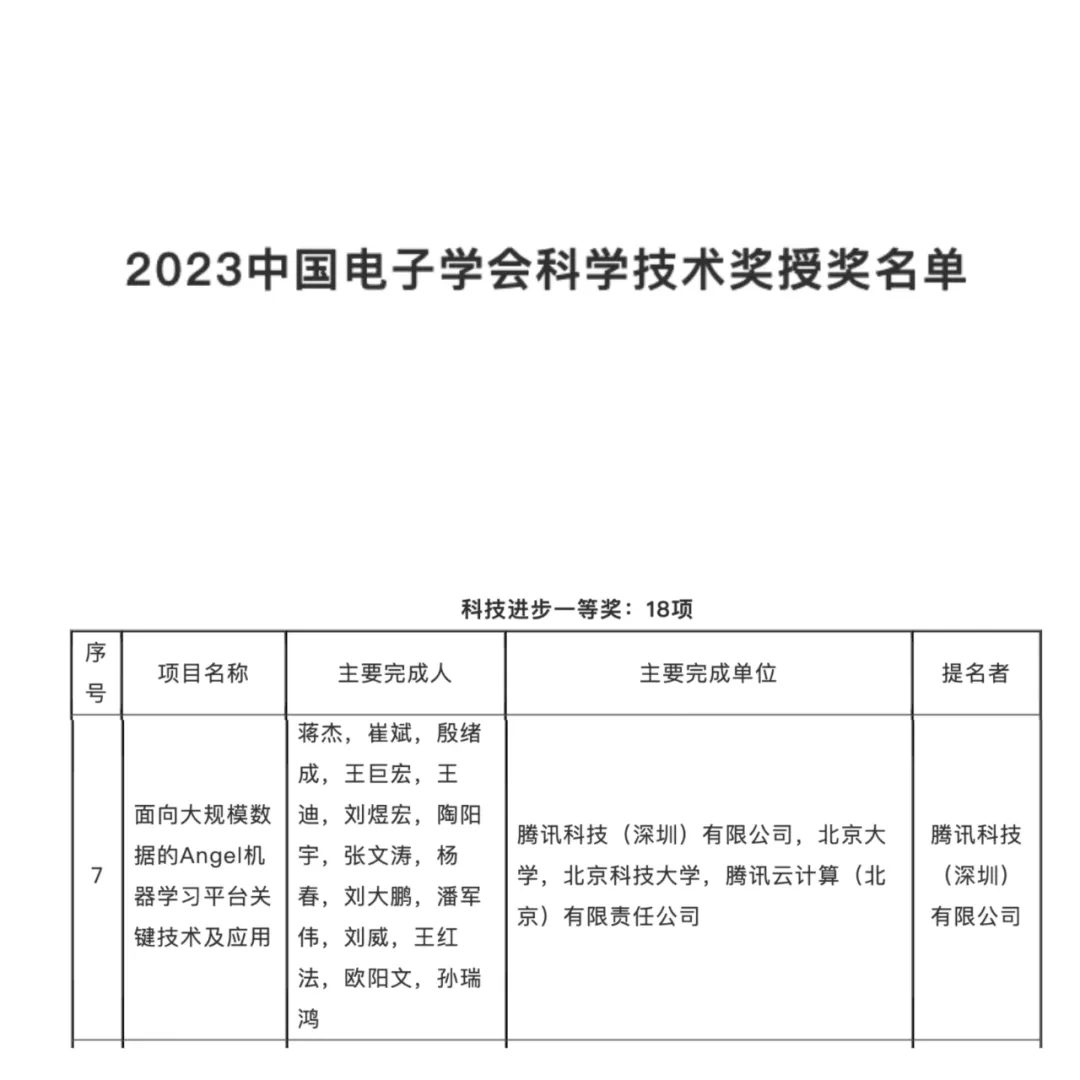

中国电子学会 2023 科学技术奖授奖名单公布,这次,我们发现了一个熟悉的身影 —— 腾讯 Angel 机器学习平台。

Stable Diffusion 3 还没全面开放,这家公司的代码生成模型先来了。本周一,Stability AI 开源了小体量预训练模型 Stable Code Instruct 3B。

基于案例的推理助力大模型智能体挑战自动化数据科学任务,吉大、上交和汪军团队发布专注于数据科学的智能体构建框架 DS-Agent。

把Huggingface上的现成模型拿来“攒一攒”—— 直接就能组合出新的强大模型?!日本大模型公司sakana.ai脑洞大开(正是“Transformer八子”之一所创办的公司),想出了这么一个进化合并模型的妙招。

去年 8 月,两位著名的前谷歌研究人员 David Ha、Llion Jones 宣布创立一家人工智能公司 Sakana AI,总部位于日本东京。

自香农在《通信的数学原理》一书中提出「下一个 token 预测任务」之后,这一概念逐渐成为现代语言模型的核心部分。最近,围绕下一个 token 预测的讨论日趋激烈。

PreFLMR模型是一个通用的预训练多模态知识检索器,可用于搭建多模态RAG应用。模型基于发表于 NeurIPS 2023 的 Fine-grained Late-interaction Multi-modal Retriever (FLMR) 并进行了模型改进和 M2KR 上的大规模预训练。

物体姿态估计在许多现实世界应用中起到至关重要的作用,例如具身智能、机器人灵巧操作和增强现实等。