更像人脑的新型注意力机制,Meta让大模型自动屏蔽任务无关信息,准确率提高27%

更像人脑的新型注意力机制,Meta让大模型自动屏蔽任务无关信息,准确率提高27%关于大模型注意力机制,Meta又有了一项新研究。通过调整模型注意力,屏蔽无关信息的干扰,新的机制让大模型准确率进一步提升。而且这种机制不需要微调或训练,只靠Prompt就能让大模型的准确率上升27%。

关于大模型注意力机制,Meta又有了一项新研究。通过调整模型注意力,屏蔽无关信息的干扰,新的机制让大模型准确率进一步提升。而且这种机制不需要微调或训练,只靠Prompt就能让大模型的准确率上升27%。

我们都知道,大语言模型(LLM)能够以一种无需模型微调的方式从少量示例中学习,这种方式被称为「上下文学习」(In-context Learning)。这种上下文学习现象目前只能在大模型上观察到。比如 GPT-4、Llama 等大模型在非常多的领域中都表现出了杰出的性能,但还是有很多场景受限于资源或者实时性要求较高,无法使用大模型。

用视觉来做Prompt!沈向洋展示IDEA研究院新模型,无需训练或微调,开箱即用

本文探讨了AI对齐在OpenAI公司中被忽视的一部分,以及AI对齐在大模型训练中的重要性和影响。文章揭示了OpenAI内部因AI对齐而产生的分歧,并阐述了AI对齐在保证AI按照人类意图和价值观运作方面的作用。同时,文章指出AI对齐在大模型训练中存在的性能阉割和对齐税等问题,以及AI对齐在大模型发展中的隐藏模型和重要性。

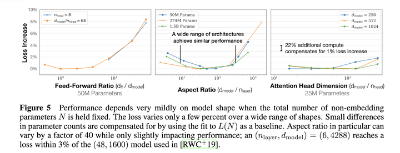

计划训练一个10B的模型,想知道至少需要多大的数据?收集到了1T的数据,想知道能训练一个多大的模型?老板准备1个月后开发布会,给的资源是100张A100,那应该用多少数据训一个多大模型最终效果最好?

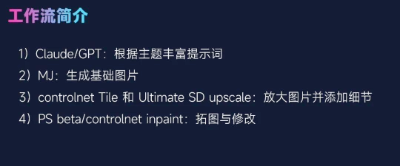

有一部分业内人士开始专门钻研 AI 技术,并且尝试作为一个独立的团队与游戏厂商展开合作,为他们提供包括建立合理工作流、自主训练模型、AI 辅助概念设计等方面的解决方案。和 AI 技术一样,这种团队非常新兴,人们尚且不够全面了解他们所能做到的事情。

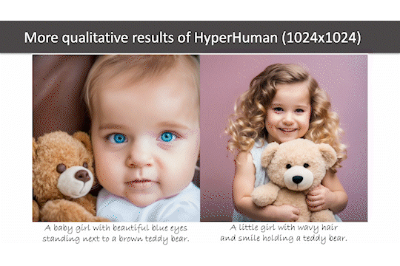

为了让AI画出的人更加逼真,港中大博士生用了3.4亿张图像专门训练画人。人物的表情、姿态,环境的空间关系、光线都能合理布局,可谓立体感十足。

C-MCR利用现有多模态对比表征间可能存在的重叠模态,来连接不同的对比表征,从而学到更多模态间的对齐关系,实现了在缺乏配对数据的多模态间进行训练。

这次,GPT-5真的要来了。「OpenAI正在开发下一代大模型GPT-5。我们的意义所在,就是打造超凡脱俗的神奇AI智能」。

专注于人工智能医学影像分析的美国RapidAI公司宣布,美国食品药品监督管理局(FDA)批准其Rapid SDH用于美国的医院。Rapid SDH 由 AI (人工智能)提供支持,其AI 用过往的患者数据进行训练,以发现急性和慢性硬膜下血肿的潜在指标。