DeepMind重磅,用PC-SUBQ提示策略让LLM从相关性推断因果关系

DeepMind重磅,用PC-SUBQ提示策略让LLM从相关性推断因果关系在人工智能领域,大语言模型(LLMs)展现出了令人惊叹的能力,但在因果推理这一人类智能的核心能力上仍面临重大挑战。特别是在从相关性信息推断因果关系这一任务上,现有的大语言模型表现出明显的不足。

在人工智能领域,大语言模型(LLMs)展现出了令人惊叹的能力,但在因果推理这一人类智能的核心能力上仍面临重大挑战。特别是在从相关性信息推断因果关系这一任务上,现有的大语言模型表现出明显的不足。

冬天来了,家里下雪了吗?

预训练语言模型通常在其参数中编码大量信息,并且随着规模的增加,它们可以更准确地回忆和使用这些信息。

万字长文盘点 2024,展望 2025 2024 年,大语言模型(LLM)迎来了翻天覆地的变化。让我们一起回顾过去一年中这个领域的重大发现,梳理其中的关键主题和标志性时刻。

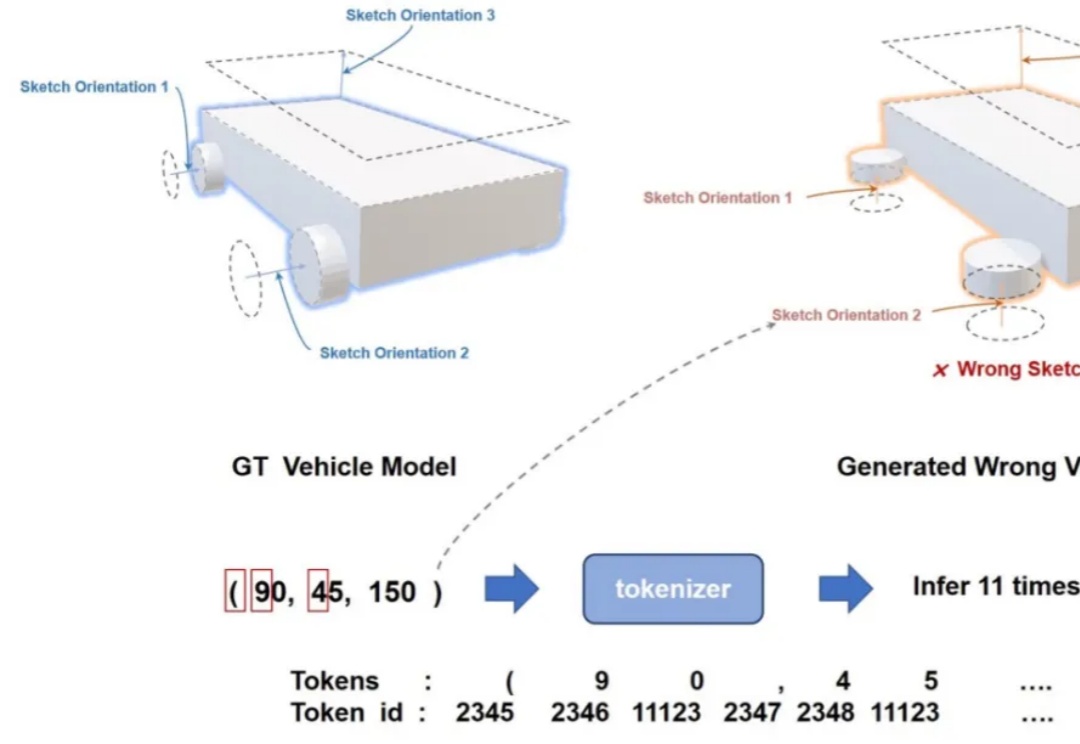

计算机辅助设计(CAD)已经成为许多行业设计、绘图和建模的标准方法。如今,几乎每一个制造出来的物体都是从参数化 CAD 建模开始的。

在刚刚过去的 2024 年,OpenAI 推出了 o 系列模型。相比于以往大型语言模型,o 系列模型使用更多的计算进行更深入的「思考」,能够回答更复杂、更细致的问题。

近年来,大语言模型在多个领域展现出了令人惊叹的潜力。同行评审作为一项既繁琐又至关重要的任务,正在引起越来越多学者的关注并尝试利用大语言模型来辅助甚至替代审稿,力图提高这一传统流程的效率。

你是否想过在自己的设备上运行自己的大型语言模型(LLMs)或视觉语言模型(VLMs)?你可能有过这样的想法,但是一想到要从头开始设置、管理环境、下载正确的模型权重,以及你的设备是否能处理这些模型的不确定性,你可能就犹豫了。

视觉价值模型(VisVM)通过「推理时搜索」来提升多模态视觉语言模型的图像描述质量,减少幻觉现象。实验表明,VisVM能显著提高模型的视觉理解能力,并可通过自我训练进一步提升性能。

在人工智能领域,大语言模型(LLM)的应用已经渗透到创意写作的方方面面。