本地LLM万字救场指南来了!全网超全AI实测:4卡狂飙70B大模型

本地LLM万字救场指南来了!全网超全AI实测:4卡狂飙70B大模型AI非上云不可、非集群不能?万字实测告诉你,32B卡不卡?70B是不是智商税?要几张卡才能撑住业务? 全网最全指南教你如何用最合适的配置,跑出最强性能。

AI非上云不可、非集群不能?万字实测告诉你,32B卡不卡?70B是不是智商税?要几张卡才能撑住业务? 全网最全指南教你如何用最合适的配置,跑出最强性能。

OpenAI计划发布一个非常强大的开源模型。它能够让人们在本地运行极其强大的模型,重新认识“本地部署”的可能性。

Palantir是一家大数据AI公司,从军事起家如协助追缉本·拉登,扩展到商业和国防应用。核心产品包括Gotham情报分析、Foundry企业整合、AIP代理和Apollo部署,提供定制化服务以提升效率。在AI浪潮下股价大涨15倍,市盈率520倍。硅谷右翼崛起推动其定位为“国运股”,挑战传统估值逻辑。

6 月 27 日,腾讯混元宣布开源首个混合推理 MoE 模型 Hunyuan-A13B,总参数 80B,激活参数仅 13B,效果比肩同等架构领先开源模型,但是推理速度更快,性价比更高。模型已经在 Github 和 Huggingface 等开源社区上线,同时模型 API 也在腾讯云官网正式上线,支持快速接入部署。

今天,Gemini 家族迎来了一个新成员:Gemini Robotics On-Device。这是谷歌 DeepMind 首个可以直接部署在机器人上的视觉-语言-动作(VLA)模型,可以帮助机器人更快、更高效地适应新任务和环境,同时无需持续的互联网连接。

据媒体报道,两位知情人士透露,英伟达正在与富士康洽谈,计划在美国得州休斯敦的一座新工厂内部署人形机器人,该工厂将用于生产英伟达的AI服务器。消息人士称,这将是英伟达产品首次在生产线上由人形机器人协助下制造,同时也有望是富士康首座在生产线上使用人形机器人进行生产的AI服务器工厂。

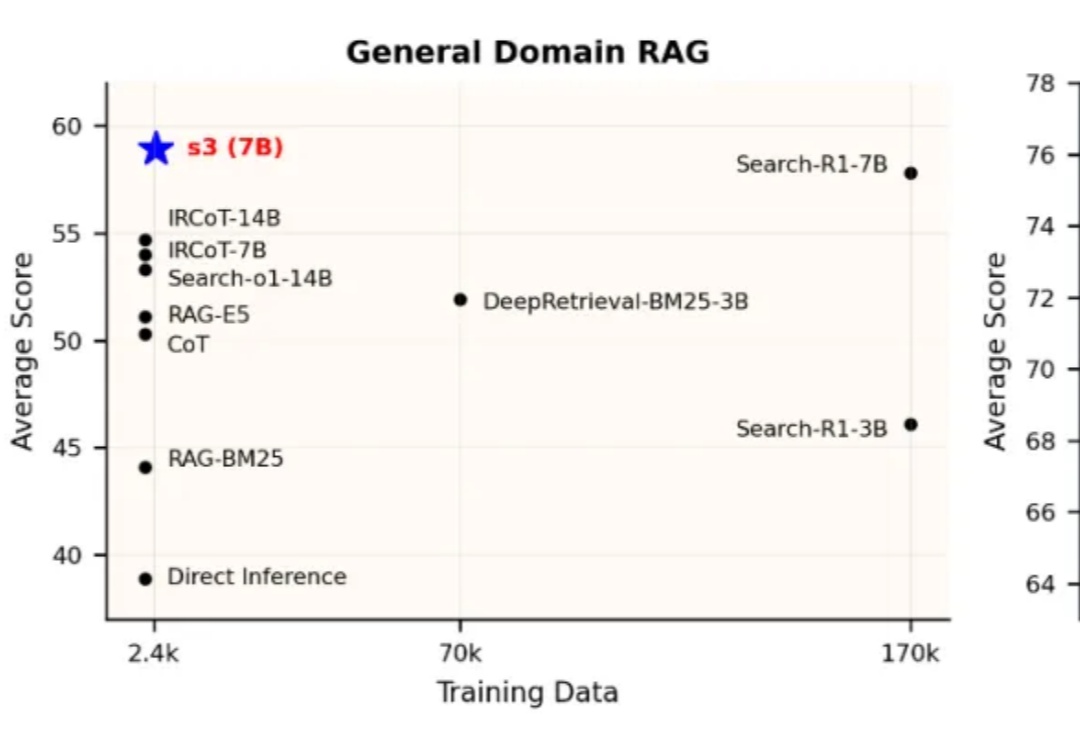

当前,Agentic RAG(Retrieval-Augmented Generation)正逐步成为大型语言模型访问外部知识的关键路径。但在真实实践中,搜索智能体的强化学习训练并未展现出预期的稳定优势。一方面,部分方法优化的目标与真实下游需求存在偏离,另一方面,搜索器与生成器间的耦合也影响了泛化与部署效率。

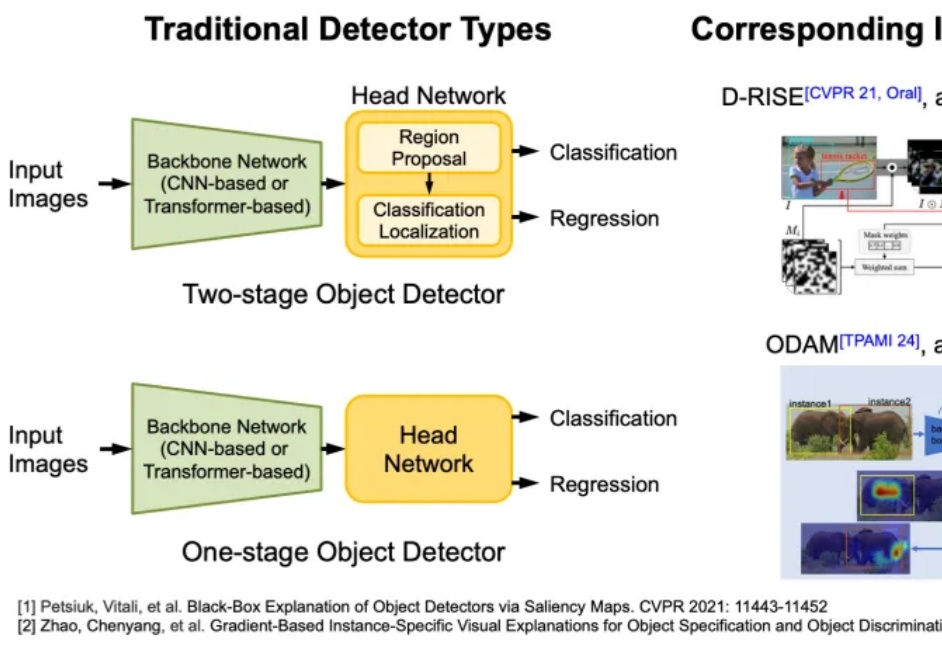

AI 决策的可靠性与安全性是其实际部署的核心挑战。当前智能体广泛依赖复杂的机器学习模型进行决策,但由于模型缺乏透明性,其决策过程往往难以被理解与验证,尤其在关键场景中,错误决策可能带来严重后果。因此,提升模型的可解释性成为迫切需求。

Lemon AI作为全球首款全栈开源通用AI Agent系统,由hexdocom团队开发,旨在通过开源、本地化部署和低成本特性,让企业与个人均可轻松拥有专属智能体。

AI 决策的可靠性与安全性是其实际部署的核心挑战。当前智能体广泛依赖复杂的机器学习模型进行决策,但由于模型缺乏透明性,其决策过程往往难以被理解与验证,尤其在关键场景中,错误决策可能带来严重后果。因此,提升模型的可解释性成为迫切需求。