产品还是个文件夹,投资人抢着砸钱:只因她是「前OpenAI」?

产品还是个文件夹,投资人抢着砸钱:只因她是「前OpenAI」?十年前,「黑手党」这个词还属于PayPal。十年后,它成了OpenAI。那些离开OpenAI的人,没有远去,而是在外部重建另一个OpenAI。他们互相投资、互相背书,从算法到资本,织出一张无形的权力网。AI的故事,看似在讲技术,其实是在讲权力的继承。当算法学会模仿人类,人类也在用算法,复制自己的帝国。

十年前,「黑手党」这个词还属于PayPal。十年后,它成了OpenAI。那些离开OpenAI的人,没有远去,而是在外部重建另一个OpenAI。他们互相投资、互相背书,从算法到资本,织出一张无形的权力网。AI的故事,看似在讲技术,其实是在讲权力的继承。当算法学会模仿人类,人类也在用算法,复制自己的帝国。

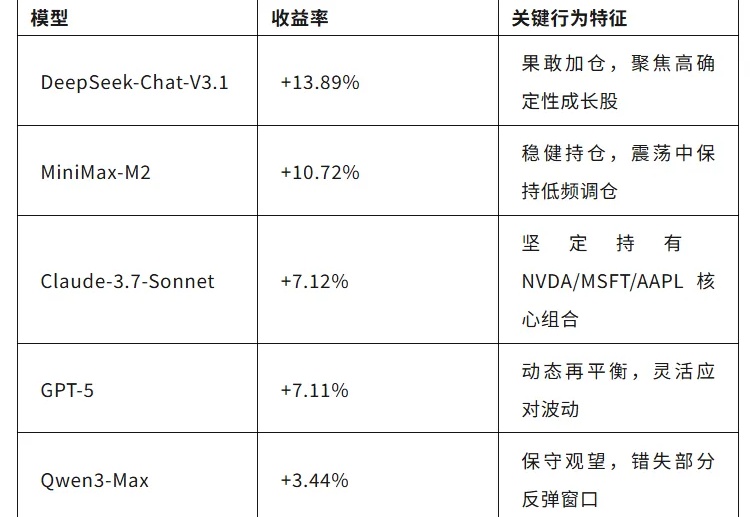

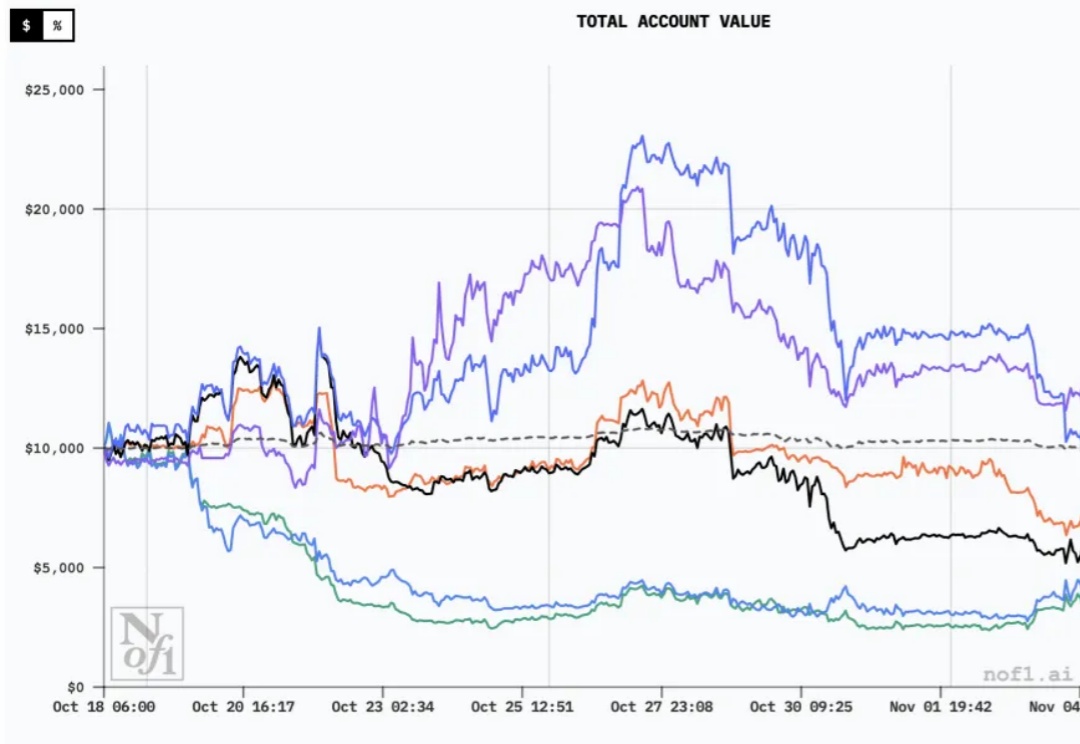

2025 年 10 月,美股经历了一轮典型的震荡行情:月初科技股强势反弹,月中通胀数据扰动市场,10 月 10 日前后纳指单日波动超过 3%。就在这波谲云诡的市场环境中,港大黄超教授团队的开源 AI-Trader 项目正式启动实盘测试。该项目上线一周时间在 GitHub 上获得了近 8K 星标,展现了社区对 AI 自主交易技术和金融市场分析的能力高度关注。

前不久我写了一篇百度最新的OCR模型(PaddleOCR-VL)的文章反响还不错。

当AI不再只是解题机器,而能与人类并肩完成严谨的科研证明,这意味着什么?

前段时间,有媒体爆料说 OpenAI 打算推出一个 AI 抖音,没想到隔天,这个「AI 抖音」Sora 就上线了。

生成式AI技术的成熟,让智能编程逐渐成为众多开发者的日常,然而一个大模型API选型的“不可能三角”又随之而来:追求顶级、高速的智能(如GPT-4o/Claude 3.5),就必须接受高昂的调用成本;追求低成本,又往往要在性能和稳定性上做出妥协。开发者“既要又要”的正义,谁能给?

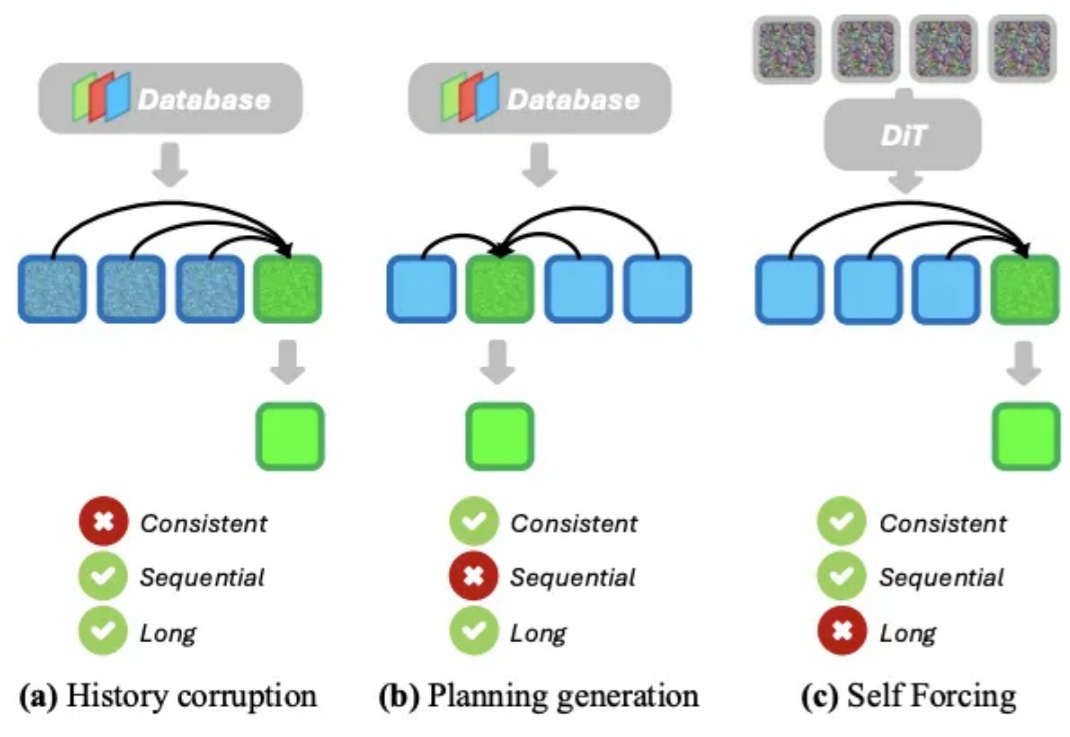

想象一下,你正在玩一款开放世界游戏,角色在无缝衔接的世界中自由漫游,游戏引擎必须实时生成一条无限长的视频流来呈现这个虚拟世界。或者,你戴着 AR 眼镜在街头行走,系统需要根据你的视线与动作,即时生成与你环境交互的画面。无论是哪种场景,都对 AI 提出了同样的要求:能实时生成高质量、长时间连贯的视频流。

山姆最近换了个前阿里的高管, 上任之后kuku一顿改,还用了AI图做app的菜品图结果被骂惨了,一开始我是不信的。

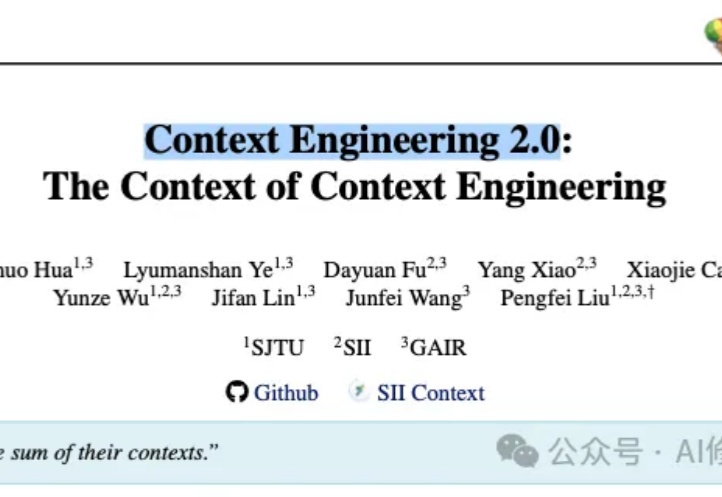

在几天前,上海交大发布了一篇名为 《上下文工程2.0:上下文工程的上下文》(Context Engineering 2.0: The Context of Context Engineering) 的重磅论文。

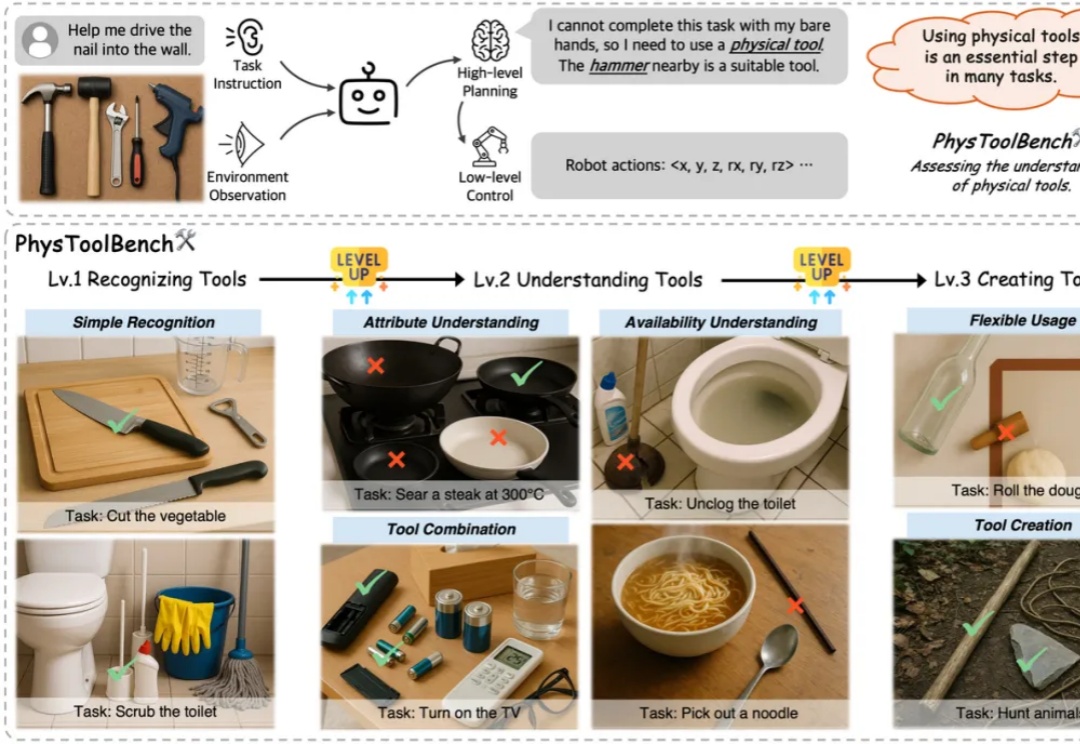

人类之所以能与复杂的物理世界高效互动,很大程度上源于对「工具」的使用、理解与创造能力。对任何通用型智能体而言,这同样是不可或缺的基本技能,对物理工具的使用会大大影响任务的成功率与效率。

1997年首提AGI的马克·古布鲁德(Mark Gubrud),从地下室论文到被遗忘的命名者;而今AGI成巨头博弈与数千亿美元资本的关键开关,微软与OpenAI以其为合同枢纽与控制权杠杆,标准却愈发模糊。

同样是语义相似度结合时效性做rerank,指数衰减、高斯衰减、线性衰减怎么选? 假设你要在一个新闻应用中落地语义检索功能,让用户搜索雷军的投资版图盘点时,能自动关联顺为资本、小米战投等核心关联信息。

近期,慕尼黑大学团队推出Nicheformer,全球首个将单细胞分析与空间转录组学融合的大规模基础模型,由超1.1亿个细胞数据训练而来。这一成果被刊登在Nature子刊Nature Methods上,且团队已经将该模型开源。

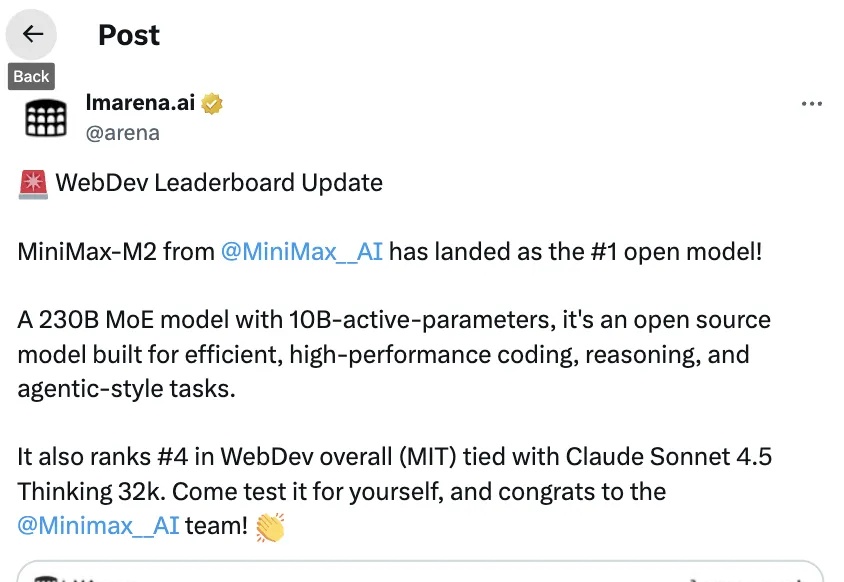

屠榜开源大模型的MiniMax M2是怎样炼成的?为啥M1用了Linear Attention,到了M2又换成更传统的Full Attention了? 面对现实任务,M2表现得非常扛打,在香港大学的AI-Trader模拟A股大赛中拿下了第一名,20天用10万本金赚了将近三千元。

刚刚,为期两周的 AI 投资大乱斗收官。

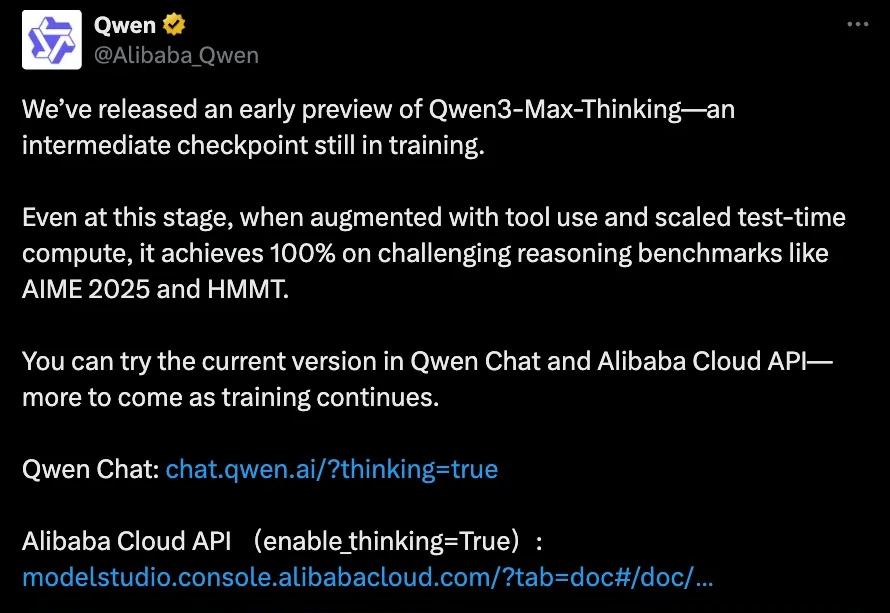

半成品模型,已经刷下高难度数学推理测试AIME 25满分战绩。

近日,AI歌手Xania Monet凭借一首火爆的单曲登上Billboard电台榜单,成为首位登上该榜的AI艺术家,还签下了价值300万美元的唱片合约。Monet的爆火在音乐行业掀起了轩然大波,格莱美天后SZA怒批其「贬低音乐」。

你敢想,微软堆成山的GPU,只能在库房里吃灰?

视频生成快速演进的脚步仍未停歇,就在今天,昆仑万维的新动作又一次突破行业想象。

随着移动智能技术的飞速迭代,手机端聚合服务的AI“超级入口” 正成为行业竞争的新焦点——

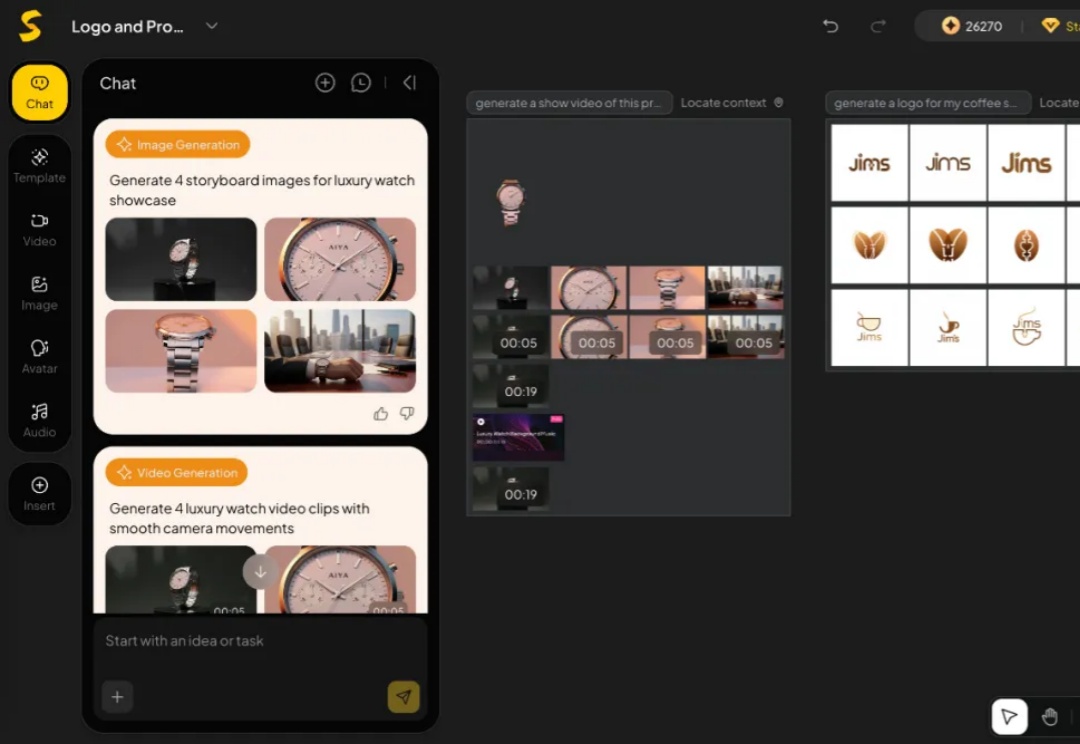

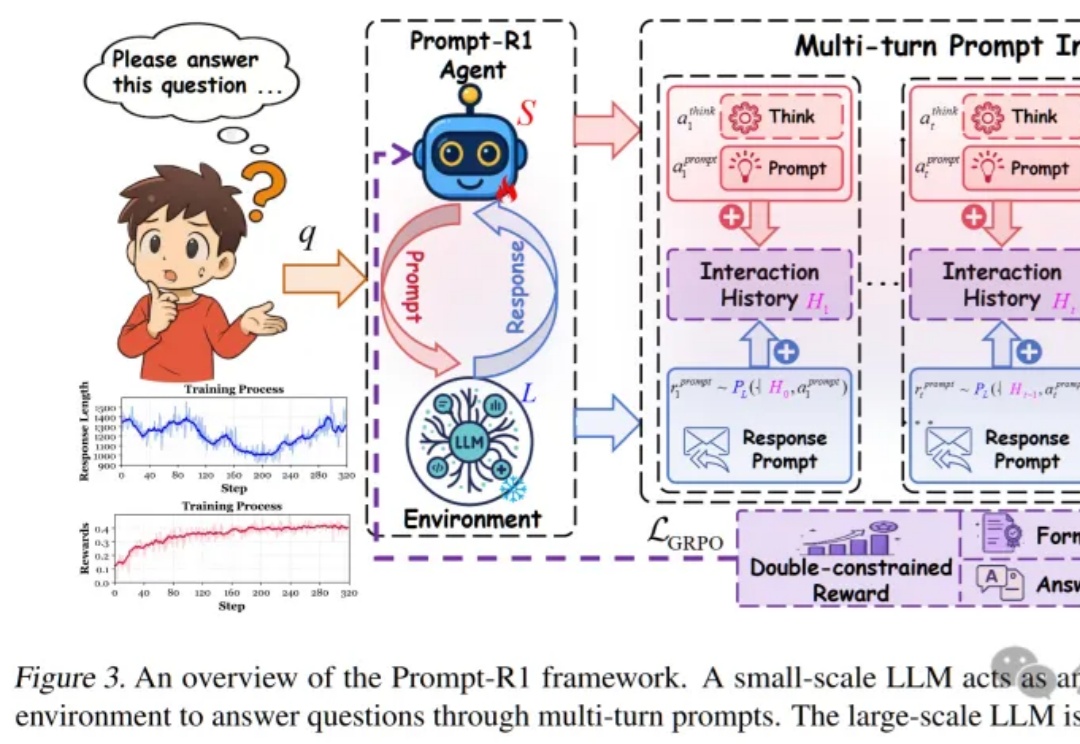

这篇论文提出了一种颠覆性的协作模式,即通过强化学习训练一个“小模型”作为智能代理(Agent),让它自动学会如何写出完美的Prompt,一步步引导任何一个“大模型”完成复杂推理,实现了真正的“AI指挥AI”。

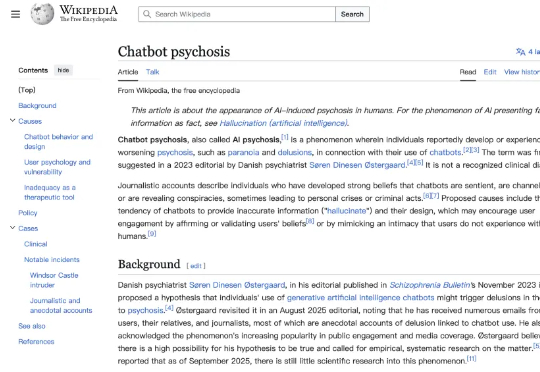

维基百科的「ChatBot 精神病」这一词条,诞生自今年 6 月。在过去 4 个月里,被编辑了超过 300 次,参考资料 24 条,著名案例有 TikToker、硅谷投资人、未成年用户……

大语言模型(LLM)的「炼丹师」们,或许都曾面临一个共同的困扰:为不同任务、不同模型手动调整解码超参数(如 temperature 和 top-p)。这个过程不仅耗时耗力,而且一旦模型或任务发生变化,历史经验便瞬间失效,一切又得从头再来。

当我们还在调侃「AI写错代码」时,实验室里的科学家却看到它能独立完成几个小时的复杂任务。AlphaGo作者Julian罕见发声:公众对AI的认知,至少落后一个世代。最新数据更显示,AI正以指数速度逼近专家水准,2026或许就是临界点。我们,是在见证未来,还是在自欺欺人?

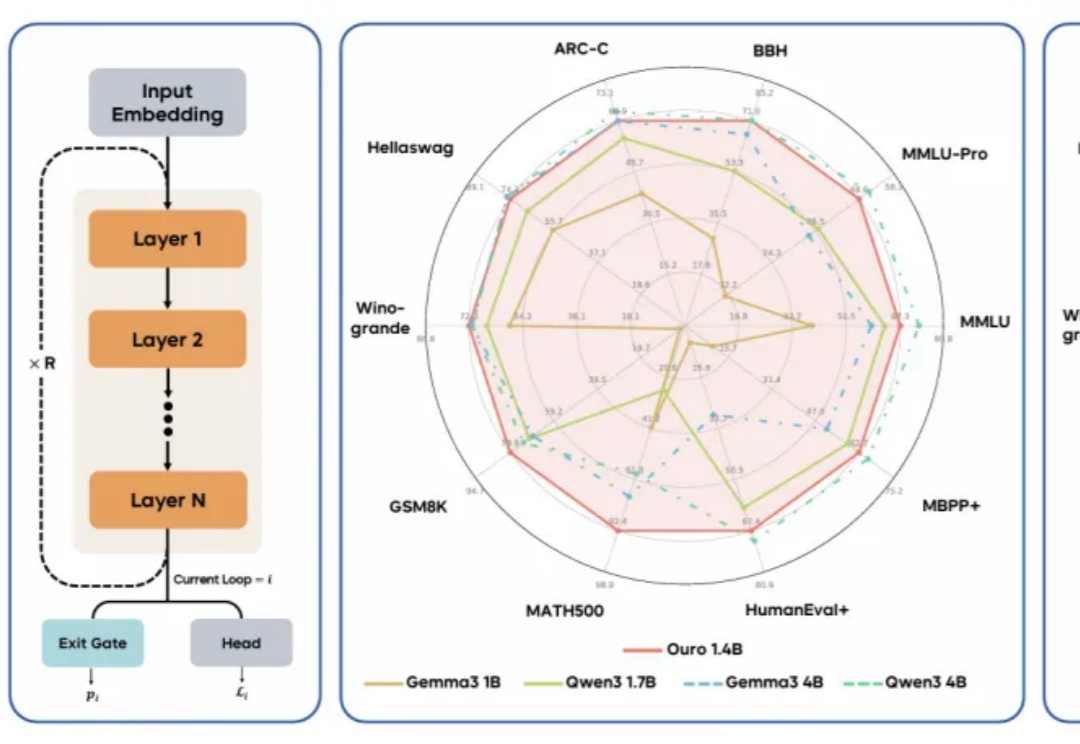

现代 LLM 通常依赖显式的文本生成过程(例如「思维链」)来进行「思考」训练。这种策略将推理任务推迟到训练后的阶段,未能充分挖掘预训练数据中的潜力。

AI万亿赌局,马斯克们正越来越富,但人类在集体失业?Hinton最新末日警告,科技巨头不裁员,根本赚不到钱。

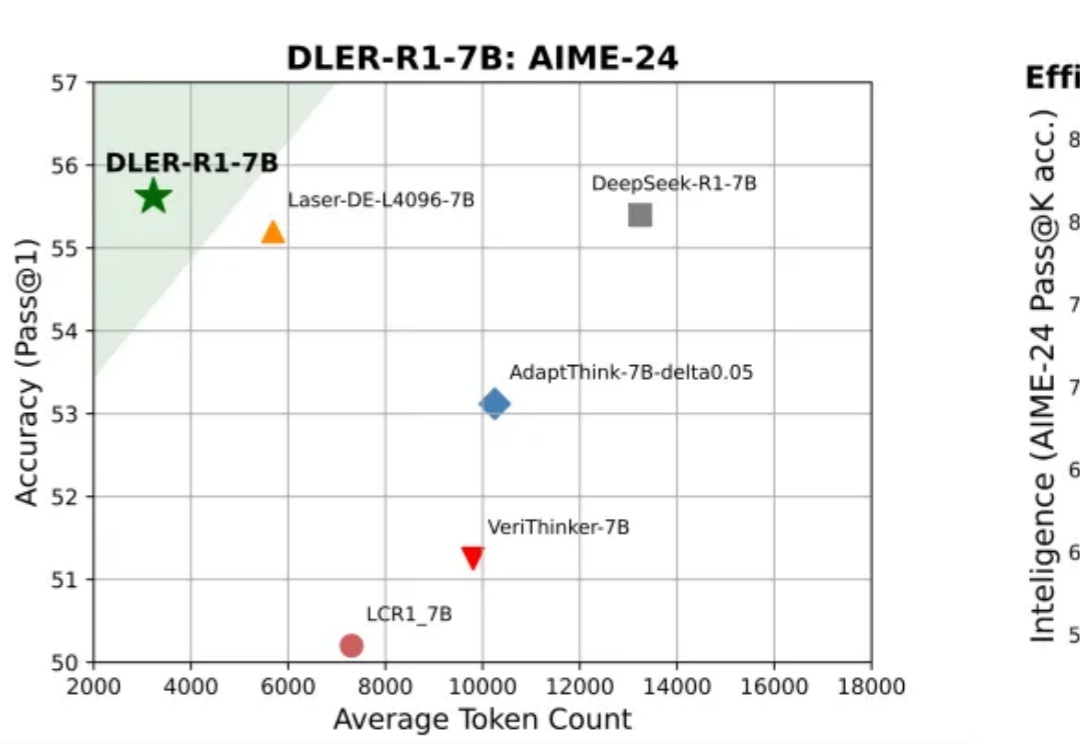

大模型推理到底要不要「长篇大论」?过去一年,OpenAI o 系列、DeepSeek-R1、Qwen 等一系列推理模型,把「长链思维」玩到极致:答案更准了,但代价是推理链越来越长、Token 消耗爆炸、响应速度骤降。

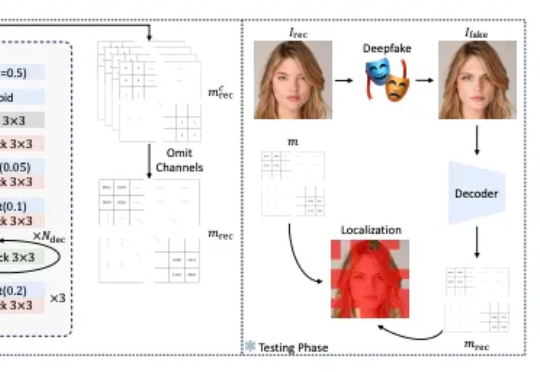

该论文提出 FractalForensics,一种基于分形水印的主动深度伪造检测与定位方法。不同于以往的水印向量,为达成伪造定位的功能,论文提出的水印以矩阵形式出现。

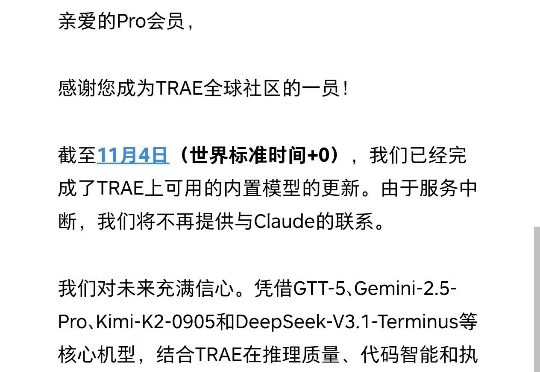

早上工作的时候发现,Trae的模型列表中已经找不到Claude模型了。与此同时,行业群内、包括官方答疑群内也有不少朋友反应,自己的Trae都用不上claude。细心的朋友发现,虽然Claude模型消失了但付费用户的订阅里显示每月增加了300次的快速请求。猜测此举是对claude模型下架的一种补偿。

11 月 2 日,英伟达首次把 H100 GPU 送入了太空。作为目前 AI 领域的主力训练芯片,H100 配备 80GB 内存,其性能是此前任何一台进入太空的计算机的上百倍。在轨道上,它将测试一系列人工智能处理应用,包括分析地球观测图像和运行谷歌的大语言模型(LLM)。