您是否遇到过这样的困扰:明明搭建了完善的RAG系统,但Agent总是回答过时的信息,或者面对历史偏好变化时一脸茫然?

三个月前说喜欢激进投资策略,两周前改口要稳健配置,今天又想尝试新兴市场,传统RAG系统只能茫然地检索文档片段,根本无法理解这种动态演进。

这不是您的系统有问题,而是静态RAG天生的局限性在作祟。

传统RAG系统本质上是一个"文档图书馆",它假设知识是固定不变的,这在处理动态业务场景时就显得力不从心了。

首先,当新信息与旧信息发生冲突时,系统无法智能地判断哪个更可信,往往会把矛盾的信息一股脑儿返回给用户。

其次,缺乏时间维度的理解让系统无法区分"用户去年的偏好"和"用户现在的需求",导致推荐结果偏离实际情况。

在企业级应用中,这种局限性会被无限放大。

比如您在开发一个客户服务Agent,客户A在过去一年中经历了从创业公司到中型企业的转变,其需求从成本控制转向了效率提升,但传统RAG系统仍然会基于历史文档推荐成本优化方案。

这种脱节不仅影响用户体验,更可能造成业务损失。

ZEP系统的核心是Graphiti引擎,它采用了一个巧妙的三层知识图谱架构来解决传统RAG的痛点:

这种设计让系统既能保留细节,又能进行抽象推理。

ZEP最独特的创新是引入了双时间轴建模机制:

这种设计让系统能够准确处理"用户两周前提到的那个项目其实是三个月前开始的"这类复杂时间关系。

传统系统面对信息冲突时往往束手无策,而ZEP通过LLM驱动的边失效机制优雅地解决了这个问题:

这种机制让Agent能够准确回答"用户什么时候改变了偏好"这类涉及时间推理的复杂问题。

ZEP的检索系统采用了三种互补的搜索方法来最大化召回率:

这种设计特别适合处理用户询问"那个项目的进展如何"时的指代消解问题。

检索到候选结果后,ZEP使用多种重排序策略来提升精确度:

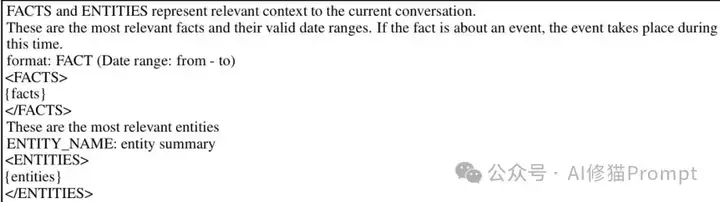

最后一步是将检索和重排序后的节点和边转换为LLM友好的文本格式:

上下文构造模板

ZEP的上下文构造模板示例,清晰标注事实的时间范围和实体信息

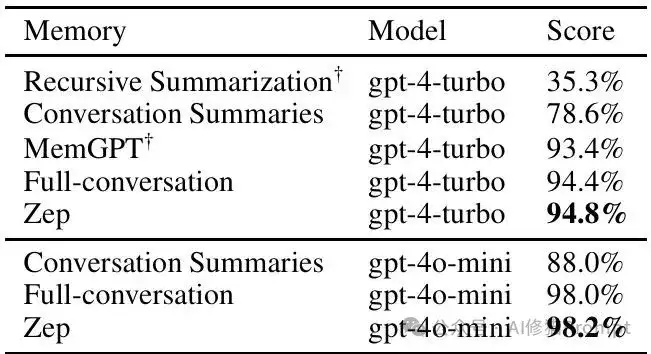

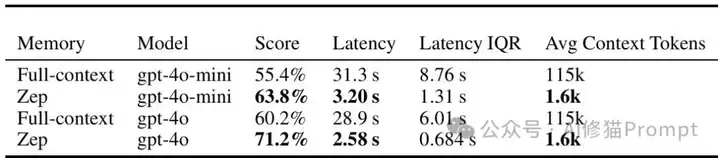

在Deep Memory Retrieval基准测试中:

DMR基准测试结果对比

Deep Memory Retrieval基准测试结果对比,ZEP在多个模型上都取得了最佳性能

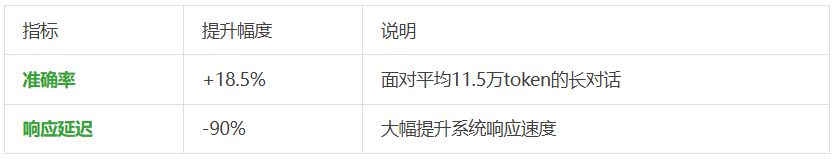

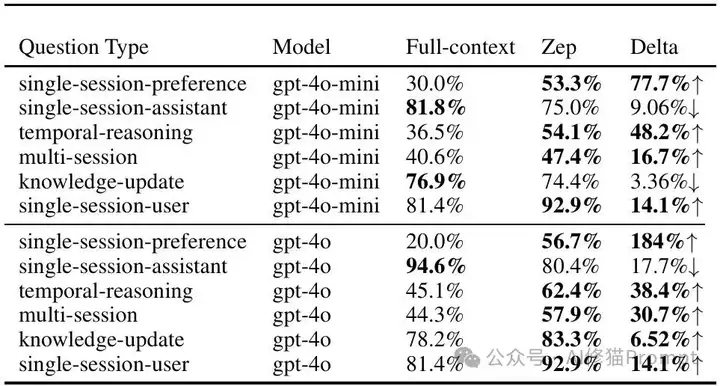

在更具挑战性的LongMemEval测试中,ZEP的优势得到了充分体现:

LongMemEval测试结果

LongMemEval基准测试结果,ZEP显著提升准确率的同时大幅降低延迟

详细的分类结果显示,ZEP在复杂推理任务上的提升最为显著:

问题类型详细分析

LongMemEval各问题类型的详细表现分析,ZEP在复杂推理任务上优势明显

核心组件:

部署优势:

支持的LLM提供商:

优化特性:

关键优化措施:

性能指标:

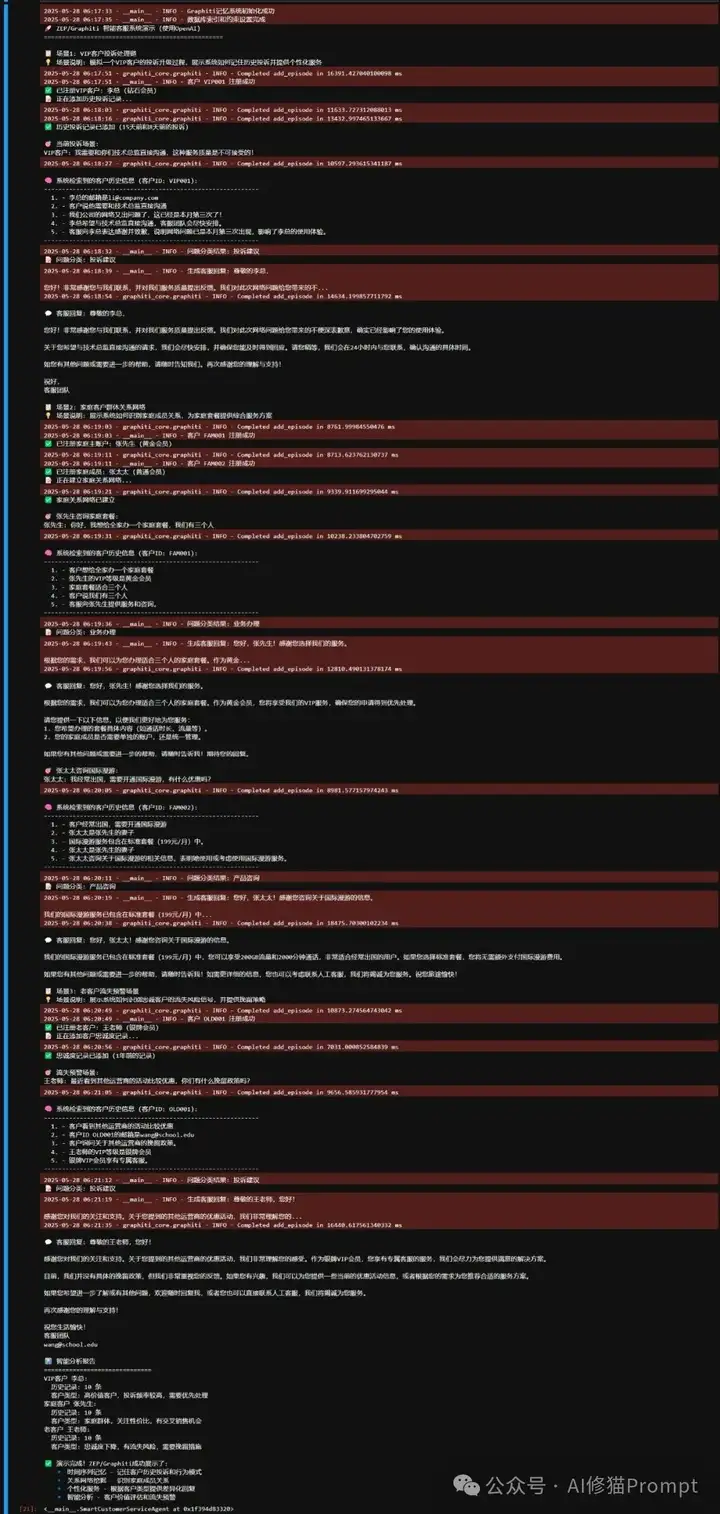

为了更好地展示ZEP技术的实际应用价值,我写了一个Zep智能客服的示例。用Jina作为embedding模型

客户背景:钻石会员李总,大企业CEO,要求快速响应

历史记录:

当前投诉:"我需要和你们技术总监直接沟通,这种服务质量是不可接受的!"

系统表现:

客户关系:

交互场景:

系统表现:

客户背景:王老师,5年忠诚客户,银牌会员,最近使用频率下降

风险信号:"最近看到其他运营商的活动比较优惠,你们有什么挽留政策吗?"

系统表现:

核心功能模块:

主要挑战:

解决方向:

面临问题:

技术要求:

现状问题:

影响:

Zep时间感知的知识图谱架构解决了传统RAG在动态场景下的根本性局限,是个非常值得仔细研究的项目,根据Zep的官方公告,Zep Community Edition现已不再维护,核心的Graphiti动态知识图谱技术已迁移到Graphiti项目中继续开发,所以如果您打算部署,正确的地址是https://github.com/getzep/graphiti/tree/main

文章来自于“AI修猫Prompt”,作者“AI修猫Prompt”。

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】FASTGPT是基于LLM的知识库开源项目,提供开箱即用的数据处理、模型调用等能力。整体功能和“Dify”“RAGFlow”项目类似。很多接入微信,飞书的AI项目都基于该项目二次开发。

项目地址:https://github.com/labring/FastGPT

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0