在大数据和大模型推动下,微调技术凭借成本低、效率高优势,成为应对小样本、长尾目标等复杂场景的利器。从早期全参数微调到参数高效微调(PEFT),再到如今融合多种PEFT技术的混合微调,遥感微调技术不断进化。清华大学等团队在CVMJ期刊上系统梳理了技术脉络,并指出了九个潜在研究方向,助力遥感技术在农业监测、天气预报等关键领域发挥更大作用。

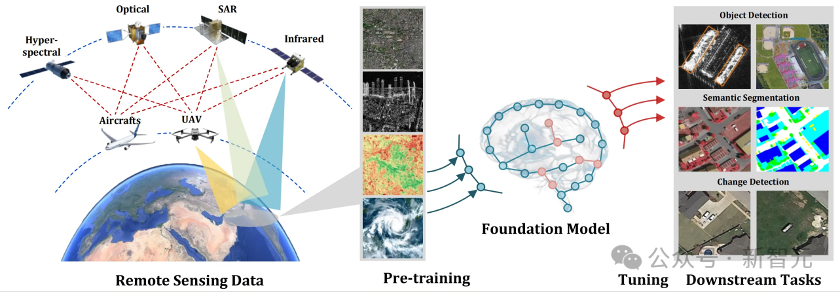

近年来,在大数据与大模型的共同驱动下,遥感图像解译的热点正从模型结构设计转向「基础模型 + 微调」的新范式。

在丰富且复杂的任务场景中,依托预训练的通用表征作为基础,通过任务化适配,可以实现更强的迁移能力和应用效果。

面对土地调查、农业监测、天气预报、海洋导航等关键应用领域所面临的「小样本、长尾目标、算力受限」的现实挑战,微调技术以其独特的优势,在更低的数据和资源成本投入下,取得更好的任务性能和更高的部署效率。

图1 基础模型、微调技术在遥感下游任务适配过程中的作用

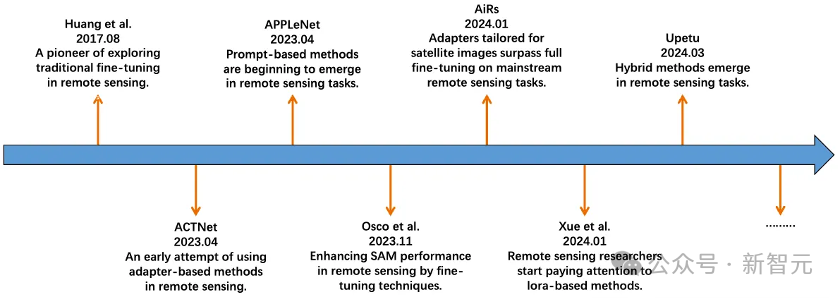

顺应这一趋势,遥感微调技术经历了清晰的范式演进:早期主要采用全参数微调,通过解冻并更新大部分参数来实现跨任务迁移;

随后进入参数高效微调(PEFT)阶段,适配器、提示、重参数化等方法在卫星和航拍等遥感场景中迅速应用;近年来,逐步迈向「混合范式」,通过统一框架融合多种PEFT技术,兼顾多模态与多任务的一体化适配及可扩展性。

由此,形成了从「全参数 → PEFT → 融合微调」的技术主线,为工程实践提供了更加灵活的选择空间。

图2 代表性遥感微调技术的发展时间线

在此背景下,清华大学胡事民院士团队联合南开大学范登平教授团队、湖南大学李树涛教授、武汉大学杜博教授和中科院孙显研究员,在CVMJ期刊(当前影响因子18.3)发布遥感模型微调技术综述,系统梳理从传统微调到参数高效微调再到混合微调范式的技术脉络,并结合技术发展现状总结出多个潜在研究方向。

论文链接:https://ieeexplore.ieee.org/document/11119145

论文仓库:https://github.com/DongshuoYin/Remote-Sensing-Tuning-A-Survey

该综述以微调技术类型为线索,系统性地梳理了从早期的全微调方法到近年来兴起的参数高效微调方法在遥感领域的应用与发展历程。

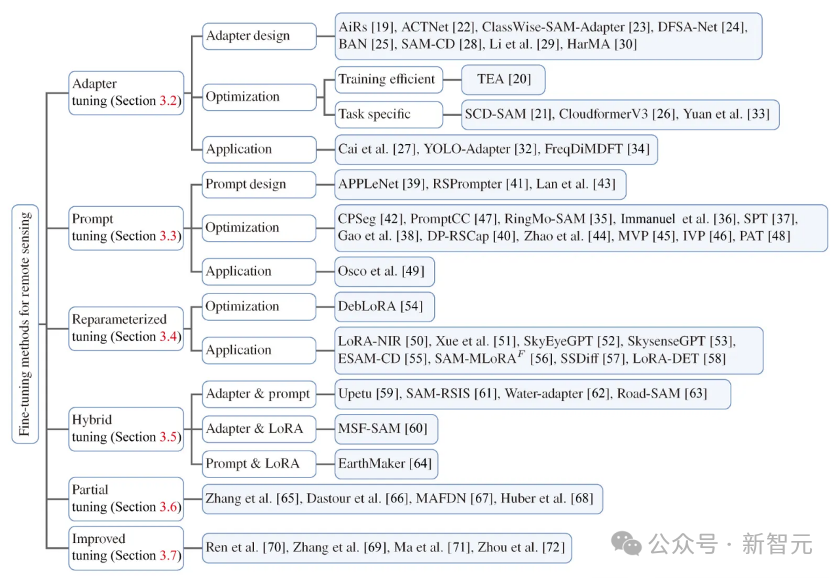

内容不仅囊括了适配器微调(Adapter Tuning)、提示微调(Prompt Tuning)、低秩适应(LoRA)等主流的PEFT范式,还深入剖析了各类论文如何将这些技术与遥感图像的独特特性相结合,从而有效提升模型在分类、检测、分割等典型任务中的性能表现。

该论文的第一作者为清华大学博士后殷东硕,第二作者为南开大学赵廷枫同学。

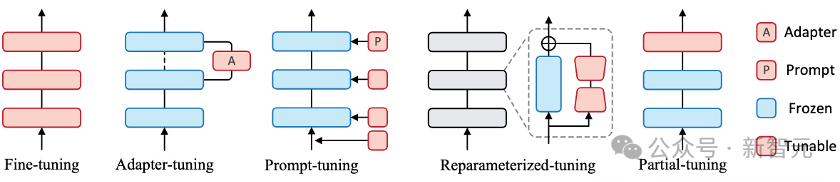

遥感基础模型微调技术旨在高效地将大规模预训练的基础模型迁移至具体下游任务中,主要可分为六种范式。

图3 几种代表性的参数高效微调范式

适配器微调(Adapter Tuning)通过在预训练模型的骨干网络中插入轻量级、可学习的模块,在冻结大部分原始参数的同时,仅训练这些新增适配器以适应新任务。

提示微调(Prompt Tuning)则通过学习可优化的「提示」(Prompt)向量,将这些向量与输入数据拼接,引导冻结的模型产生期望输出,从而改变模型行为。

重参数化微调(Reparameterized Tuning)的核心思想是对模型权重的更新量进行低秩分解等参数化处理,例如流行的LoRA方法,通过学习两个低秩矩阵的乘积来模拟权重变化,大幅减少可训练参数。

混合微调(Hybrid Tuning)结合上述两种或多种范式,例如同时使用适配器微调技术和提示微调技术,以期获得更优的性能和灵活性。

部分微调(Partial Tuning)采用更直接的策略,仅解冻并微调预训练模型中的一部分原有参数,如最后几层的权重、偏置或归一化层参数。

改进型微调(Improved Tuning)对传统全微调技术进行优化,通过设计新的训练策略或损失函数来提升效率或性能。这些技术共同构成了当前遥感领域参数高效微调的主要方法体系。

图4 现有遥感微调技术概览

在具体应用中,代表性工作成功地将通用微调范式与遥感任务的特殊性进行了深度融合。

在适配器微调方面,AiRs专门设计了空间上下文适配器(SCA)和语义响应适配器(SRA),以更高效地处理遥感图像中的空间和语义信息;

SCD-SAM则通过语义适配器优化输入处理、重构重叠的图像块嵌入,并集成多尺度语义特征,显著提升了变化检测的性能。

在提示微调方面,RSPrompter提出了一种链式思维(Chain-of-Thought)提示方法,通过设计多步推理提示(例如,先判断目标存在性再进行分割),引导模型深入理解遥感图像中复杂的上下文关系。

在重参数化微调方面,LoRA-NIR专门针对近红外波段的遥感影像进行适配,而Xue等人将LoRA应用于SAM,成功将SAM强大的分割能力迁移到道路、水体等特定遥感地物的提取任务中。

混合微调方法如Upetu旨在整合多种高效的参数微调技术,而MSF-SAM则结合了适配器微调技术和LoRA微调技术,以期更全面地适应遥感任务的需求。

此外,部分研究通过优化训练策略来提升性能,例如,Ren等人在两阶段微调中引入度量判别损失和知识蒸馏,有效应对小样本场景下的灾难性遗忘问题。

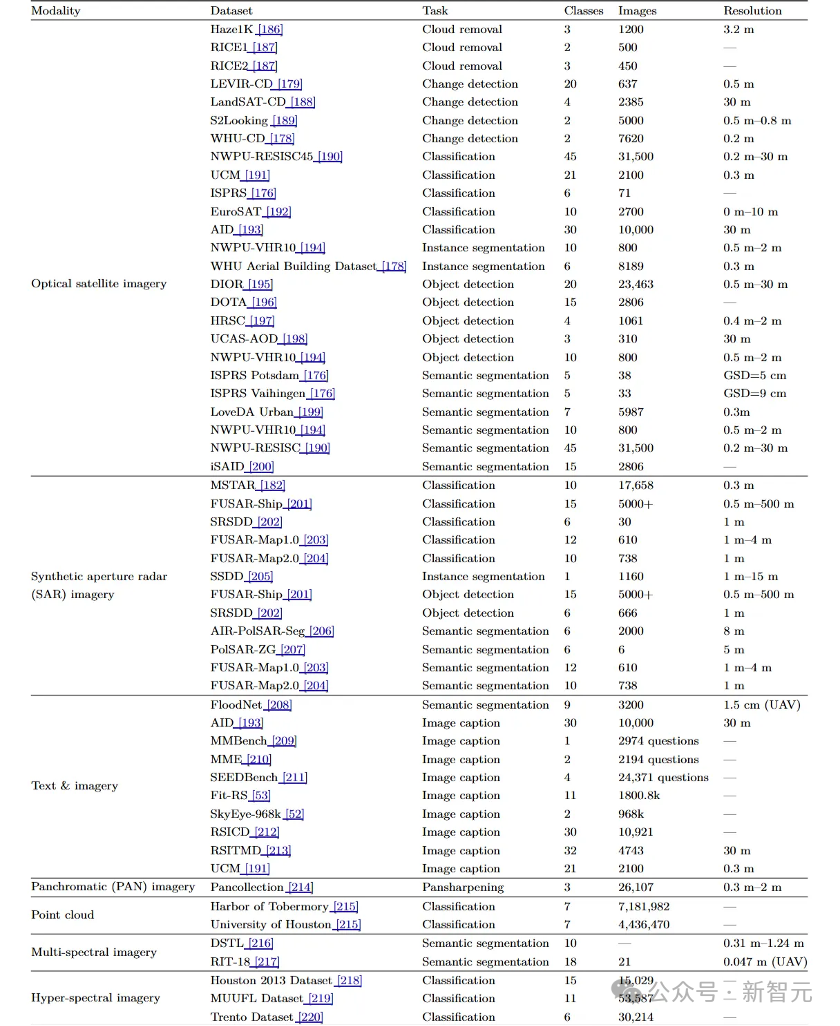

表1 遥感微调技术涉及到的数据集汇总

该综述系统性地梳理并整合了当前用于模型微调的主流遥感数据集,覆盖了光学、SAR、高光谱、点云以及文本-图像多模态等多种传感器类型,全面涉及去雾、变化检测、语义分割、目标检测、图像描述等任务。

表1数据集概览为遥感模型微调技术研究者快速定位适配数据、设计下游应用提供了高效的指引。

在大模型与大数据的时代背景下,基础模型与微调技术正引领遥感研究的新趋势。本文系统性地综述了遥感领域的微调技术发展现状。

现有方法依据所调整参数与预训练模型之间的关联性进行分类,旨在帮助读者清晰把握该技术的发展脉络。

参考资料:

https://ieeexplore.ieee.org/document/11119145

文章来自于“新智元”,作者 “LRST”。

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0