实现通用机器人的类人灵巧操作能力,是机器人学领域长期以来的核心挑战之一。近年来,视觉 - 语言 - 动作 (Vision-Language-Action,VLA) 模型在机器人技能学习方面展现出显著潜力,但其发展受制于一个根本性瓶颈:高质量操作数据的获取。

ByteDance Seed 团队最新的研究论文《End-to-End Dexterous Arm-Hand VLA Policies via Shared Autonomy》[1],针对这一关键问题提出了解决方案。

该研究的核心贡献在于提出了共享自主 (Shared Autonomy) 框架,通过合理划分人类操作员与自主 AI 系统的控制职责——人通过 VR 遥操作控制机械臂 (负责高层定位和避障),DexGrasp-VLA 自主控制灵巧手 (负责精细抓握),消除了同时遥操作臂和灵巧手的需求,大幅降低操作员认知负荷,有效解决了机器人部署中最关键的数据采集成本问题。通过将数据采集效率提升至可规模化的水平,它为灵巧操作技术从实验室走向工业应用奠定了基础。

Data collection and training pipeline for DexGrasp-VLA policy and arm-hand VLA policies.[1]

触觉增强的 DexGrasp-VLA 策略通过共享自主框架高效采集数据,结合臂手特征增强模块训练端到端策略,并通过纠正性人机闭环实现持续优化。

基于共享自主框架的端到端机械臂 - 灵巧手 VLA 策略学习:通过 DexGrasp AI 进行高效遥操作:

论文的核心问题在于如何为高自由度灵巧手 + 机械臂系统高效地采集高质量的演示数据,以训练出具备通用操作能力的 VLA 策略。高自由度五指灵巧手的控制复杂度远超传统的两指夹爪,对数据质量和控制精度提出了更高的要求。

该研究构建了一个由四大核心模块组成的完整技术体系,实现了从数据采集到策略优化的闭环。

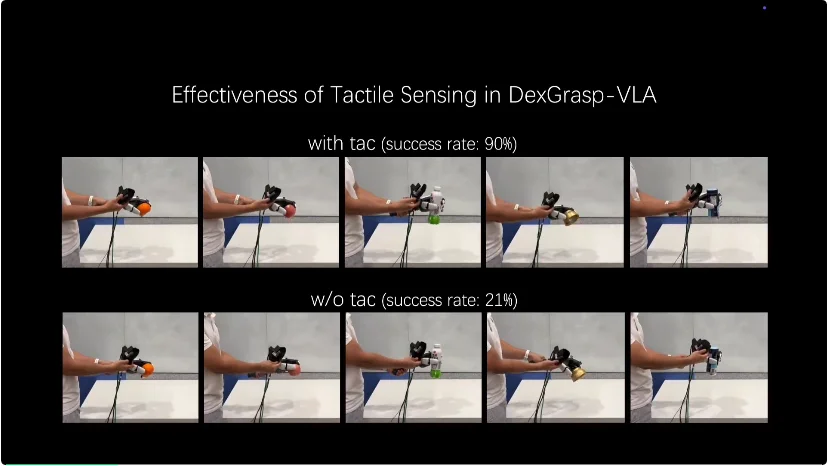

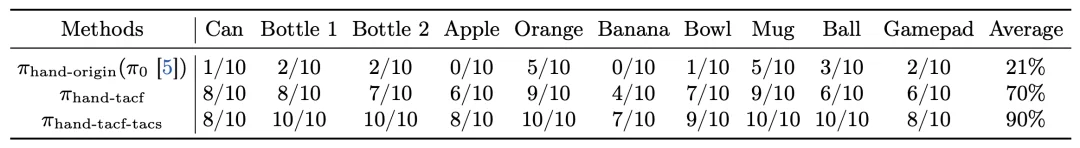

DexGrasp-VLA 是一个专为灵巧手设计的自主抓取策略,是本文共享自主框架的基石。它是一个多模态 VLA 模型,其输入不仅包括语言指令、视觉和本体感知,更关键的是集成了触觉反馈。

该策略的实现得益于其所搭载的灵巧手 - 星动纪元星动 XHAND1 的硬件能力。星动 XHAND1 是一款全直驱 12 自由度的五指灵巧手,其指尖集成了高分辨率的触觉传感器。这些传感器能够提供合力向量和空间接触分布(环绕指端 270 度,120 点空间触觉阵列)两种关键触觉特征。DexGrasp-VLA 正是利用这些高保真度的触觉数据,实现了力适应性抓取 (Force-Adaptive Grasping),能够根据物体的形态而动态调整握力,从而在不捏碎易碎品的同时稳固抓取重物。

Tactile-based DexGrasp-VLA for hand control [1]

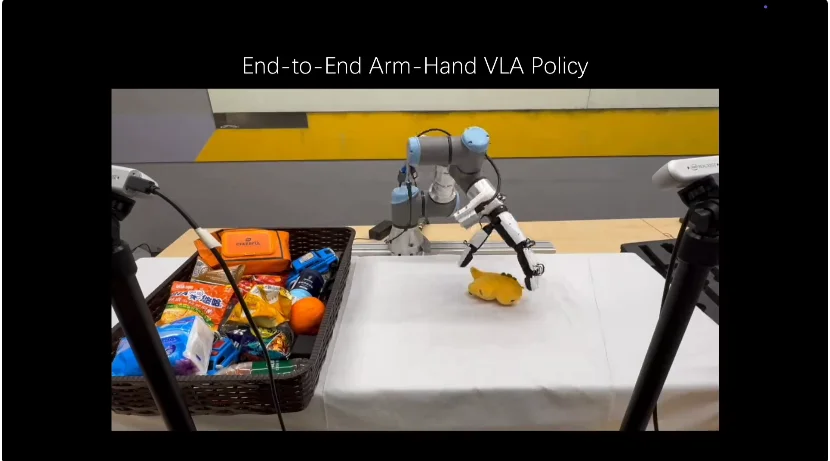

在杂乱桌面场景中使用 DexGrasp-VLA 进行清桌操作。

共享自主框架将控制任务按照运动域进行拆分:

Fully manual teleoperation versus the proposed Shared Autonomy [1]

这样的设计源于臂与手在运动学本质上的巨大差异 —— 机械臂强调稳定、连续、较长时间尺度的轨迹控制,而灵巧手则必须处理柔顺接触、快速响应与高频细节动作。正因如此,将复杂度最高的手部控制交由 AI 自动处理,可以显著减轻人类操作者的认知及操作负担。操作者无需再时刻处理每一根手指的微小动作,只需专注于大方向和策略性决策。

最终,这套分工机制让系统能够更高效地采集高质量的臂手协同演示数据,为后续训练具备通用操作能力的 VLA 策略打下稳定基础。

为了解决臂手协调这一复杂问题,论文提出了臂手特征增强 (Arm-Hand Feature Enhancement) 模块。

Arm-hand feature enhancement for the VLA policy [1]

该模块旨在建模和融合臂和手在运动学上的差异特征。它采用三流架构:共享任务表示、手臂专用编码器和手部专用编码器。这种解耦设计避免了传统单体架构模型对臂手差异的忽视,使得最终的策略能够实现更自然、更鲁棒的宏观 - 微观动作协调。

该研究引入了纠正性人机闭环 (Corrective Human-in-the-Loop) 机制,让机器人能够从失败中学习。当机器人抓取失败时,人类操作员可以立即接管并演示正确的操作方法。系统会自动记录这次失败的过程和人类纠正后的成功过程,并将这两段数据作为「难题案例」加入训练集。

通过这种方式,策略能够不断迭代优化,逐步学会应对各种边缘案例 (corner cases), 变得越来越聪明和可靠。

Corrective human-in-the-loop teleoperation system [1]

端到端的机械臂 - 灵巧手 VLA 策略

Hardware setup of the integrated robotic system.[1]

Representative cases of grasping cylindrical and spherical objects, visualizing the distribution of surface contacts measured by tactile sensors at fingertips.[1]

该研究通过提出共享自主框架,推动了灵巧操作领域高质量数据采集效率提升 25%,使单人每小时可采集更多条数据,并将完整开发 - 部署周期压缩至一天以内,从根本上解决了 VLA 模型训练的数据瓶颈问题。

该研究通过在超过 50 种物体上实现约 90% 的抓取成功率这一接近工业标准的性能水平,推动了灵巧操作技术从概念验证向实际部署的关键跨越,为机器人在柔性制造、智能物流和服务机器人等领域的大规模应用铺路。

Grasping diverse objects with variations in size, color, and material properties.[1]

论文展望了三个主要的未来研究方向。当前框架主要在抓取任务上得到了验证,未来可以通过引入更多专用的 AI 辅助控制器 (VLA Copilot 模块),将其拓展至物体重定向、精密插放和长时程操作等更复杂的场景。

虽然触觉反馈对抓取稳定性至关重要,但在端到端臂手控制中仍面临噪声干扰和时序错位等挑战,因此需要探索更智能的融合机制,例如根据任务阶段动态调整触觉、视觉和本体感受的权重。

此外,当前的纠正机制仍需人工介入,这在一定程度上限制了系统的可扩展性。未来可以借助强化学习实现系统的自主错误识别和恢复,并利用视觉 - 语言模型感知任务复杂度和环境风险,智能地决定何时独立运行、何时请求人类协助,最终实现从人机协作向完全自主的平滑过渡。

参考文献

[1] End-to-End Dexterous Arm-Hand VLA Policies via Shared Autonomy: VR Teleoperation Augmented by Autonomous Hand VLA Policy for Efficient Data Collection. ByteDance Seed. 2025.(https://arxiv.org/pdf/2511.00139)

文章来自于“机器之心”,作者 “机器之心”。

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI