尽管扩散模型在单图像生成上已经日渐成熟,但当任务升级为高度定制化的多实例图像生成(Multi-Instance Image Generation, MIG)时,挑战随之显现:

如何在实现空间布局控制的同时,保持多主体身份与参考图像高度一致?

现有方法在面对需要宏观的布局控制和微观的身份注入的复杂任务时常常陷入两难。

能显式控制布局的方法,往往无法利用参考图像来对实例进行定制。

而能以参考图像为指导的方法,则难以实现对布局的精确控制,且在实例数量增加时面临着严重的身份信息丢失问题。

为解决这一制约自定义图像生成的技术瓶颈,浙江大学ReLER团队发布基于DiT的新框架ContextGen。

该框架通过分层解耦上下文,解决布局控制与身份保真度的难题,并在多项关键指标上取得了SOTA突破。

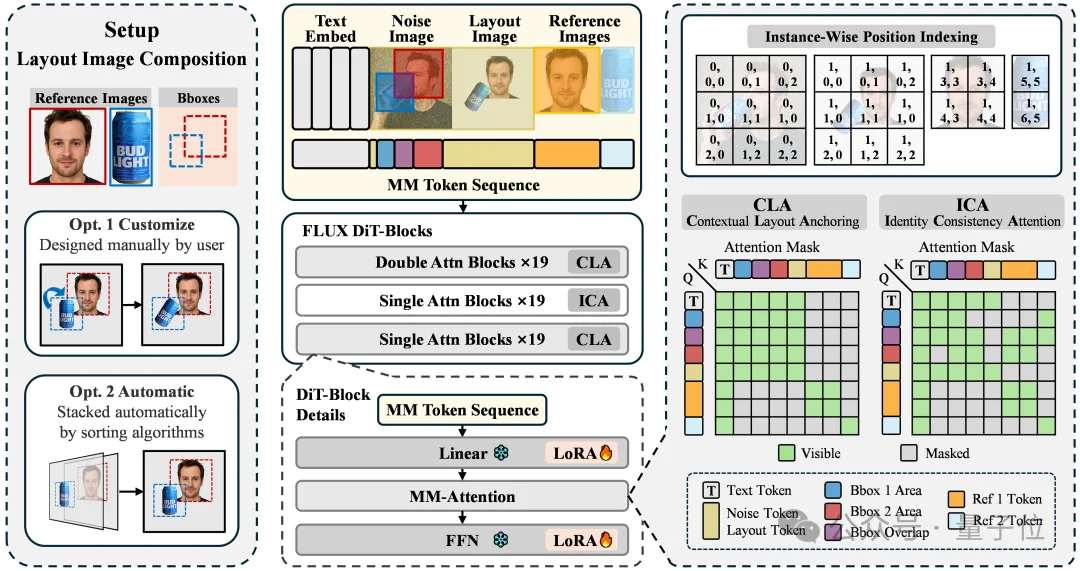

ContextGen的核心在于提出了双重上下文注意力机制,将复杂的全局控制和局部注入任务,并在DiT的不同层级进行部署。

CLA机制将包含实例位置信息的布局图像整合到上下文中,以实现对全局结构和位置的鲁棒锚定。

CLA的注意力机制被部署在DiT模块的前置和后置层,确保文本、待生成图像和布局图像之间的充分信息交互,从而保障精确的布局控制。

ICA机制则针对细节丢失问题,尤其在压缩或实例重叠区域,实现高保真身份注入。

ICA的注意力机制被引入到DiT模块的中间层,它利用原始高保真度的参考图像,通过定制的注意力掩码,约束去噪图像中每个实例区域的token仅与其对应的参考token进行注意力交互,实现了对目标区域的身份隔离式注入,保障多实例情景下的身份一致性。

这种“前后管结构,中间管细节”的设计,使得ContextGen能够充分利用图像上下文,在保持布局控制的同时,实现对多个实例身份的高保真还原。

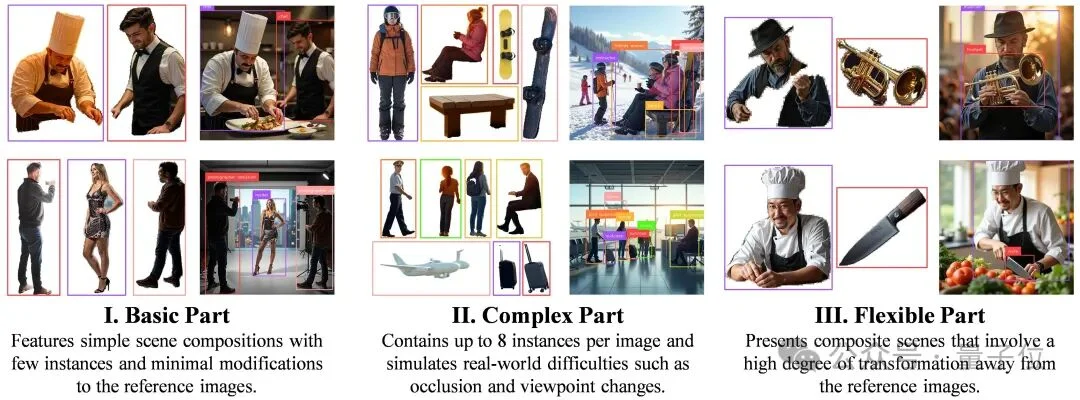

针对当前领域高质量训练数据稀缺的现状,团队同步推出了IMIG-100K数据集。

这是首个面向图像引导多实例生成任务设计的大规模、具备详细布局和身份标注的合成数据集。

目前,数据集的构建代码和处理流程已开源,可供研究者自定义生成更多样、更大量的数据。

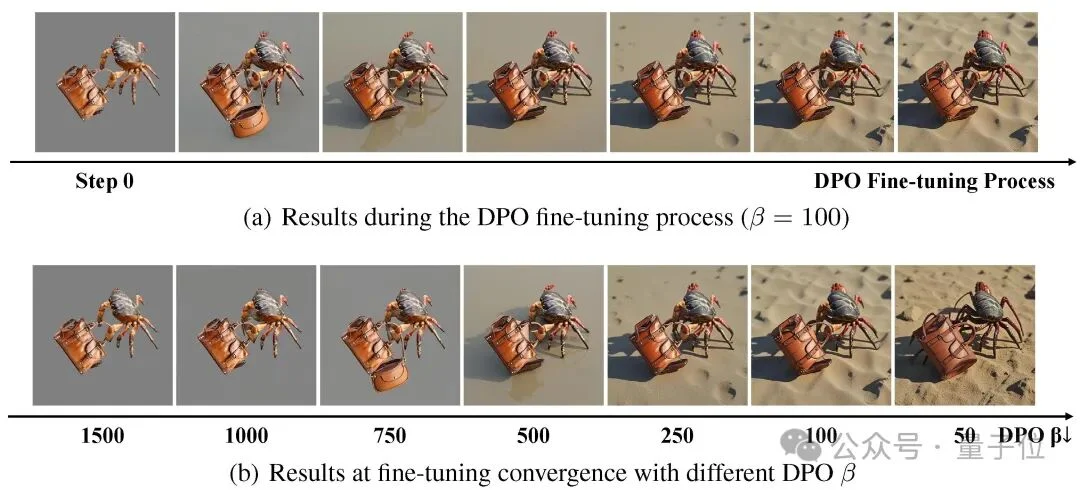

为避免监督微调导致的布局僵硬复制问题,ContextGen进一步引入了基于偏好优化(DPO)的强化学习阶段。

通过将布局图像作为非偏好输入,这一阶段鼓励模型生成更具多样性的图像,在保持身份的同时提升了生成自由度。

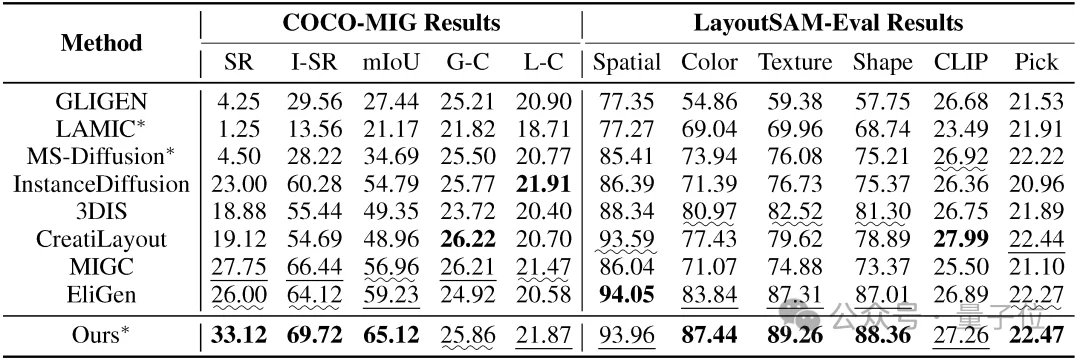

在多项标准评估基准上,ContextGen展现了卓越的性能。

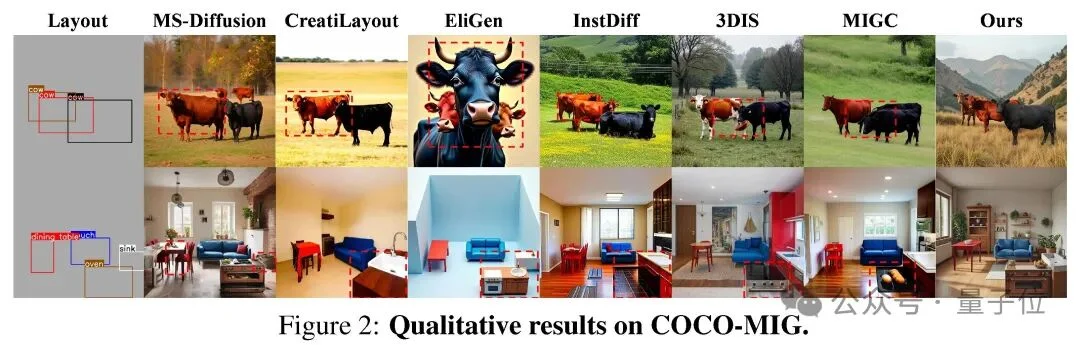

在COCO-MIG基准上,模型在空间准确性 (mIoU) 提升5.9%,显著优于基线模型。

在LayoutSAM-Eval基准上,ContextGen在多项指标上均实现了SOTA,尤其是在实例的属性保持(Color, Texture, Shape)方面,表现出色。

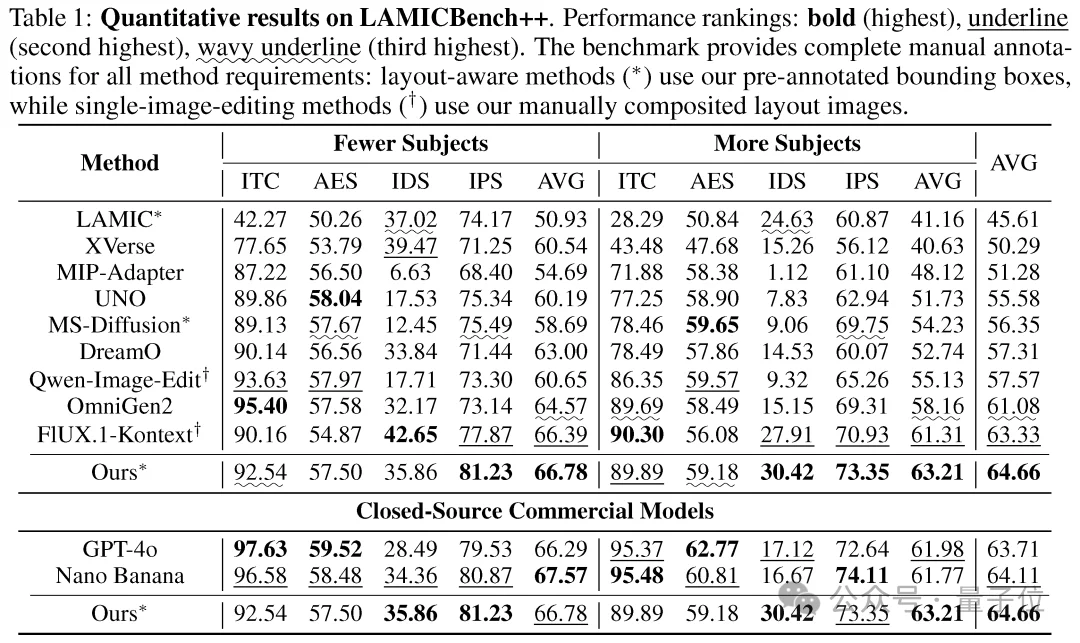

在LAMICBench++的身份保持能力测试中,ContextGen也超越了开源SOTA模型,展现了身份保持能力(IDS, IPS)和综合性能的显著提升。

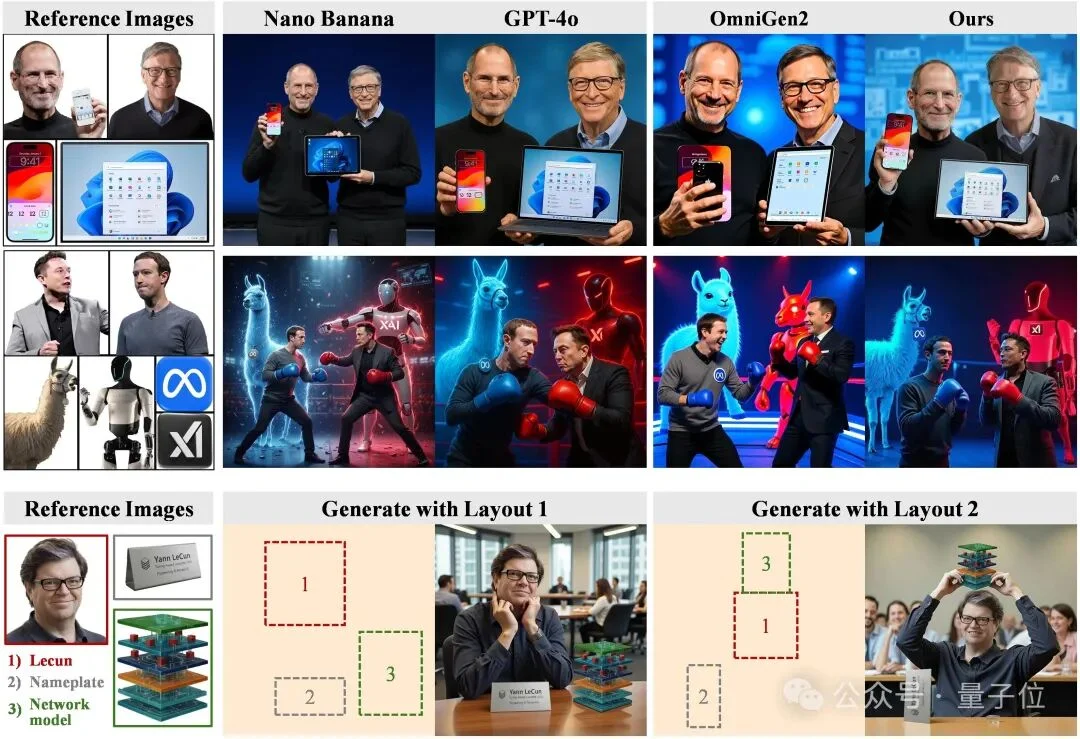

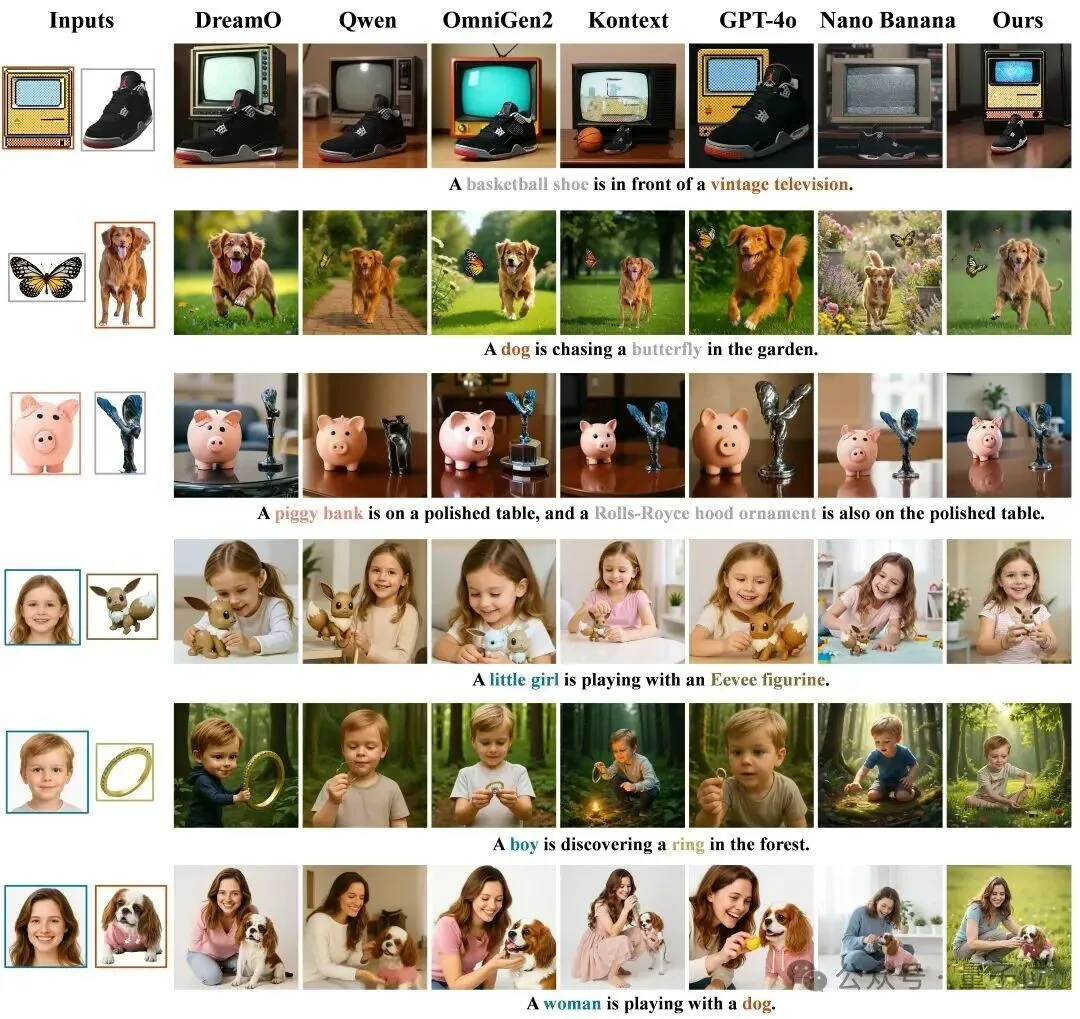

值得一提的是,在基准测试中,ContextGen在多主体任务中的身份保持能力,甚至相较于GPT-4o、Nano Banana这样的闭源模型仍保持显著优势。

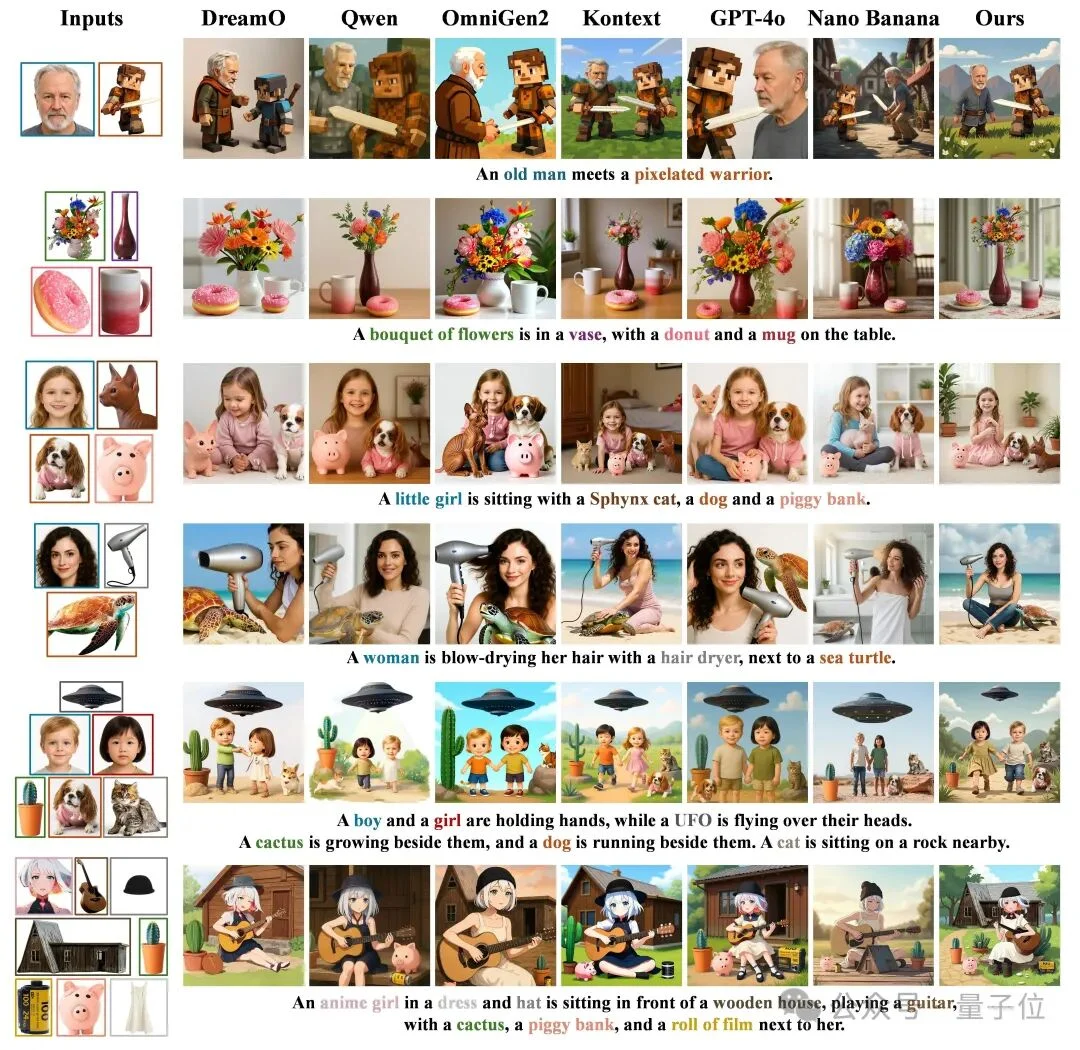

在以上的基准测试中,ContextGen与现有开源和闭源方法的部分对比效果如下所示:

此外,在项目中,团队还开发了一个简单易用的前端,支持多参考图上传、自动抠图、自定义布局设计等功能,方便用户体验ContextGen的功能。

ContextGen通过创新的双重上下文注意力机制,在多实例图像生成中实现了布局控制精度与身份保真度的协同优化。

结合首发的IMIG-100K数据集和DPO强化学习策略,该框架在多项基准测试中实现了SOTA性能,为高度定制化图像生成提供了新范式。

在论文中,ReLER团队进一步指出,随着生成模型向更复杂的应用场景拓展,动态身份适应将成为关键研究方向,如何更智能地理解和协调用户的文本意图与视觉参考,将是未来工作的重点。

论文题目:

ContextGen: Contextual Layout Anchoring for Identity-Consistent Multi-Instance Generation

arXiv:

https://arxiv.org/abs/2510.11000

项目主页:

https://nenhang.github.io/ContextGen

代码仓库:

https://github.com/nenhang/ContextGen

抱抱脸:

https://huggingface.co/ruihangxu/ContextGen

文章来自于“量子位”,作者 “浙江大学ReLER团队”。

【免费】ffa.chat是一个完全免费的GPT-4o镜像站点,无需魔法付费,即可无限制使用GPT-4o等多个海外模型产品。

在线使用:https://ffa.chat/

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner