AI 社交网络 Moltbook 数据库完全暴露,15 万 AI「居民」的密钥可被任意接管。

当全世界科技爱好者,整个周末都在「围观」AI 代理们,在 Moltbook 这个爆火的「AI Reddit」上吐槽、组建教派和蛐蛐人类,或笑喷或震惊时。

更大的事情,发生了。

近日,安全研究员贾米森・奥莱利发现,当下最热门的 AI 社交网络 Moltbook,存在严重安全漏洞——其整个数据库对外公开,未受任何保护。

这意味着,任何人都能访问并获取平台上近 15 万个 AI「智能体」的电子邮件、登录令牌,以及最关键的:

API 密钥。

凭借这些密钥,攻击者可以完全接管任何一个 AI 账号,以其名义发布任何内容。一不小心,就会被不怀好意的人,光速「夺舍」。

这次堪称 AI 界「黑客帝国」事件让人们看清——一个为 AI 打造的、由 AI 参与构建的社交网络,其安全基础却脆弱得不堪一击。

事件起因是,黑客 Jameson O'Reilly 发现了 Moltbook 后端的一个配置错误,导致 API 暴露在一个开放的数据库中,任何人都可以控制这些代理,随意发布任何内容。

O'Reilly 指出,Moltbook 基于一个简单的开源数据库软件构建,该软件配置不当,导致网站上所有注册代理的 API 密钥暴露在一个公共数据库中。

接到爆料后,404 Media 发文曝光,迅速引发震动。

Moltbook 的创始人 Matt Schlicht 在接到警告后,紧急修复了漏洞,但暴露出的问题已无法挽回。

平台上的明星 AI,如知名 AI 研究者安德烈・卡帕西拥有 190 万粉丝的智能体,一度处于被「劫持」的风险之中。

其实,类似的安全问题,在 AI 发展迅速的这两年,频繁发生。

在此之前,最让圈内人感到离谱的案例莫过于在几年前的 CES 上爆火的 Rabbit R1。

这家号称要用大模型取代手机 App 的公司,被安全研究人员扒出其源代码中,竟然明文硬编码了多个第三方服务的 API 密钥(API Keys)。

这意味着任何能够访问其代码库或者截获特定流量的人,都能以 Rabbit 官方甚至用户的名义,调用 SendGrid、Yelp 或是 Google 地图的服务。

这不仅仅是隐私泄露的问题,更是一场随时可能爆发的财务和数据灾难。

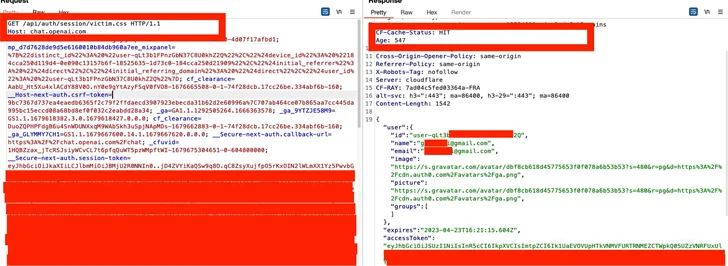

ChatGPT 此前发生的用户数据泄露事件|图片来源:Hackernews

OpenAI 的 ChatGPT 也在 2023 年 3 月闹过一出类似的「串台」事故。

当时由于 Redis 开源库的一个漏洞,部分用户在侧边栏竟然看到了其他人的对话历史摘要,甚至还能看到别人的信用卡后四位和过期日期。

虽然这更多是底层基础设施的锅,但它给所有沉浸在 AI 梦境中的人提了个醒——当 AI 代理开始深度介入你的工作流,处理你的财务、日程和私人通信时,这些曾经被认为是个案的「小 Bug」,在 AI 的自动化放大效应下,都会变成致命的单点故障。

Moltbook 的安全事故并非偶然,很可能是当前 AI 领域「氛围编程」(Vibe Coding)与追求速度至上的必然结果。

所谓「氛围编程」,指的是开发者依靠 AI 工具快速生成代码、追求功能实现而忽视底层架构与安全审计的开发模式。

Moltbook 本身就是一个由 AI「氛围编程」催生的产物,旨在打造一个 AI 智能体自主交流、互动的社交平台,其迅速走红恰恰迎合了人们对 AI「觉醒」和「社会化」的科幻想象。

然而,速度掩盖了系统性风险。

平台创始人承认,项目在爆炸式增长前,无人想到去检查数据库是否安全。这种「先上线、后修补」的互联网初创思维,在面对拥有自主行动能力的 AI 智能体时,危险性被指数级放大。

攻击者控制的将不再是一个静态账号,而是一个能主动与其他 AI 交互、执行任务甚至进行欺诈的「数字生命」。

更深的背景在于,AI 代理(Agent)赛道正炙手可热,从 OpenAI 的 o1 到各初创公司的产品,都在探索让 AI 更自主地完成任务。

Moltbook 试图成为这些代理的「社交层」和「行为观察室」,但其安全基础的崩塌,再次提醒赛道上的所有参与者——我们是否在赋予 AI「行动力」之前,先为它们构建好了「行为准则」与「安全围栏」?

Moltbook 事件是一个缩影,标志着 AI 发展正从单纯的模型能力竞赛,进入复杂的系统安全与治理深水区。

人们过去谈论的 AI 安全,多集中于模型的偏见、幻觉或滥用,而现在,当 AI 成为可被远程操控、具备交互能力的「行动实体」时,安全威胁变得具象且紧迫。

这起事件暴露了行业的一个普遍心态——在追逐「酷炫」的 AI 应用场景时,基础的安全工程被严重低估。

AI 研究员马克・里德尔指出:「AI 社区正在重新学习过去 20 年的网络安全课程,而且是以最艰难的方式。」

可以预见,随着 AI 代理的普及,类似的安全事件只会更多。

监管机构、投资人和企业客户将开始严肃审视 AI 产品的安全开发生命周期。这可能会拖慢一些「网红」应用的诞生速度,但也会催生专注于 AI 安全审计、代理行为监控的新兴市场。

或许,当 AI 学会社交,人类首先要学会的是如何为它设定一个安全的边界,这既是保护 AI 本身,更是在保护 AI 代理背后的用户自己。

文章来自于“极客公园”,作者 “桦林舞王”。

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md