视频异常检测(Video Anomaly Detection,VAD)是智能监控、智慧交通、网络审核等应用中的关键技术,旨在检测视频中偏离预期的异常事件。然而,现有方法将训练数据集中的固定类别作为隐式定义的 “异常”,这种方法的泛化能力不足,无法适应开放世界中动态变化的异常定义需求。

下面是三个异常定义发生变化的例子:

这些例子表明,异常性并非事件本身的固有属性,而是由场景、时间、用户需求等因素决定的动态概念。

针对这一问题,中国传媒大学媒体融合与传播国家重点实验室的吴晓雨教授团队于 ICLR 2026 发表论文《Language-guided Open-world Video Anomaly Detection under Weak Supervision》,直面 VAD 领域的核心问题 —— 什么是异常?

核心思路:视频与异常定义联合建模

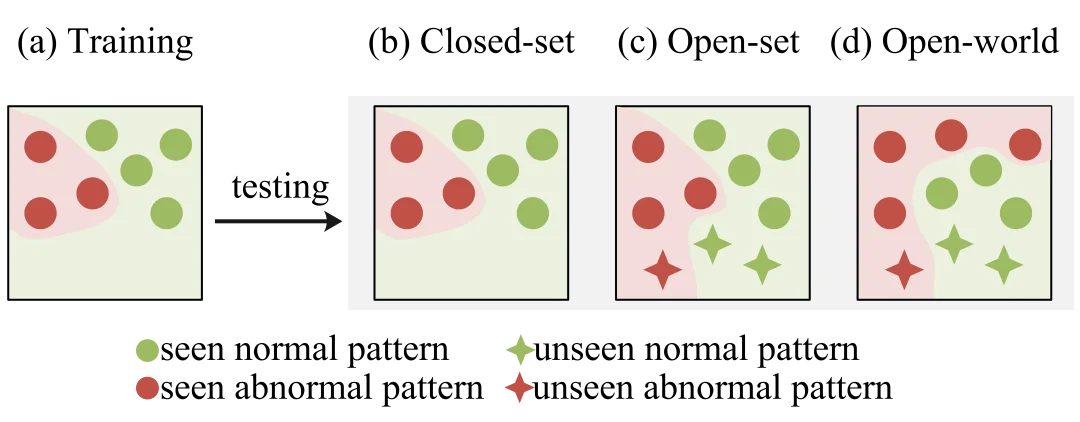

不同视频异常检测范式对比

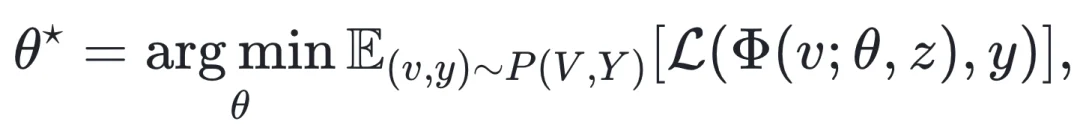

现有方法将异常定义为为静态不变的视频的属性。如图所示,传统封闭集合(Closed-set)方法假设测试时的异常类别与训练时完全相同,开放集合(Open-set)方法虽然能够检测更多训练时未见类别的异常,但是某个事件异常与否是固定的。例如,若奔跑行为在训练数据中被标注为正常,那么在测试阶段模型也应当检测其为正常。这些方法在训练阶段建模视频 -> 异常标签 的映射关系,以下式为优化目标:

其中 V、Y 分别是视频和异常标签,z 则是一个来自于训练数据的固定的异常定义。然而,在开放世界中,用户在图书馆、走廊等场景下可能期望将奔跑定义为异常行为。此时,条件概率 P (Y|V) 就发生了变化,导致优化目标与测试环境发生了偏差。

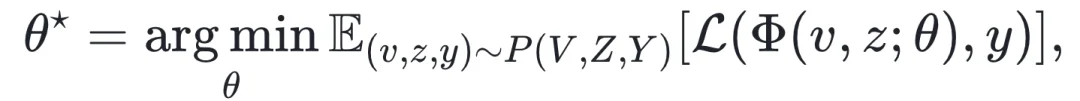

因此,研究团队假设:异常性由且仅由视频本身以及对异常的定义所决定,视频的异常性会随着异常定义的变化而变化,并提出在训练阶段让模型学习 视频 + 定义 -> 异常标签 的联合映射关系,要求模型在训练过程中学习不同定义下的异常检测:

其中,Z 表示异常定义。直观来看,只要确定了异常定义,那视频的异常性就能够确定,因此这种新的学习方式能够规避条件概率 P (Y|V) 变化带来的影响,作者在文中也给出了具体的证明。

技术方案

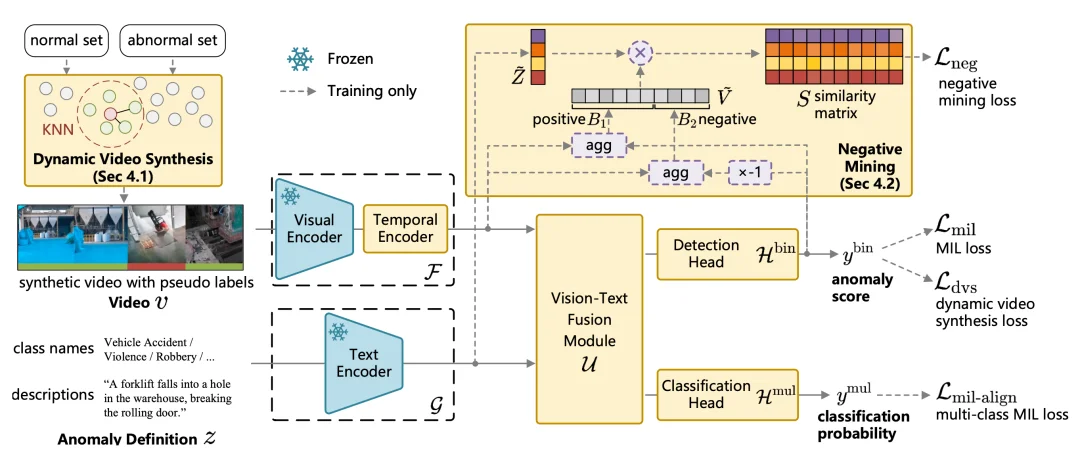

基于这一范式,作者提出了 LaGoVAD 模型,通过添加文本支路允许用户通过自然语言定义异常,并在训练期间使用不同的异常定义进行训练。

然而,新的学习范式导致模型需要建模一个更复杂的多模态空间 P (V,Z,Y),而 VAD 领域本就数据稀缺、标签粒度粗,二者共同引发样本密度下降,导致模型过拟合风险上升。为了解决这一问题,作者从模型和数据两方面下手。

LaGoVAD模型

对于模型,作者提出了两个正则化手段。

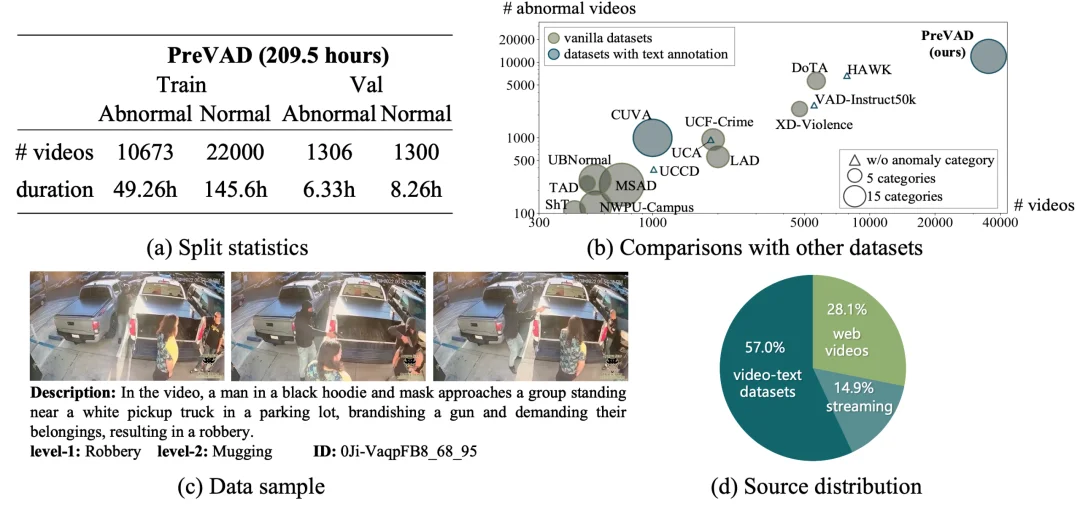

对于数据,作者通过结合多个基础模型 + 自动化标注流程构建了一个迄今为止最大规模的预训练视频异常数据集,包含 35K 具有多层级类别标签和异常文本描述的高质量数据。这部分数据已开源于 Modelscope 平台。

实验结果

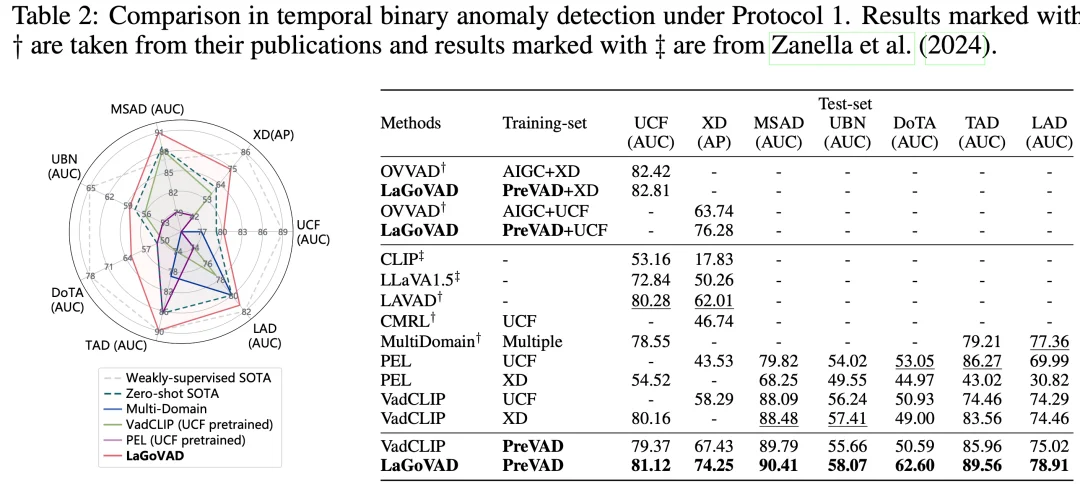

在评估方面,现有方法通常只进行域内测试或进行一两个数据集的跨域测试,而 LaGoVAD 在 7 个数据集上进行了广泛的跨域测试以验证泛化性。包括以严重犯罪与暴力为主的 UCF-Crime 和 XD-Violence 数据集,交通异常为主的 DoTA、TAD 数据集,行人异常为主的 UBNormal 数据集和较为综合的 MSAD/LAD 数据集。其使用了两种评估协议:

1. 直接在测试集上进行零样本评估,每个测试集具有不同的场景和不同的异常定义,这个评价协议评估综合的泛化性。

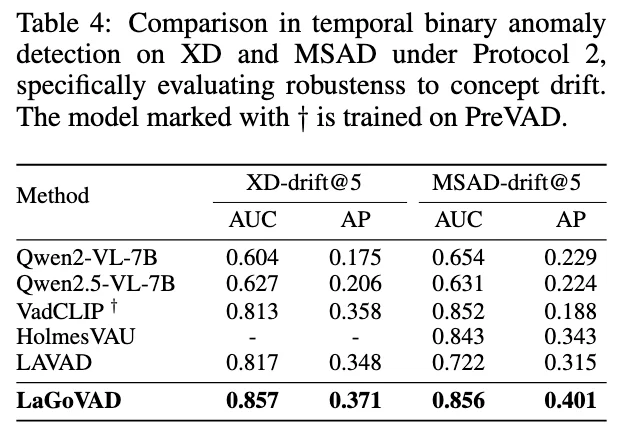

2. 在某个测试集上使用多种异常定义进行零样本评估,每种异常定义都为从总异常类别中随机采样的一个子集,这个评价协议能专门评估模型应对动态异常定义的能力。

在评估协议 1 下,LaGoVAD 所有数据集上均取得了最先进的性能,超过了其他针对跨域泛化能力进行提升的方法,包括开放词汇的方法(OVVAD)、跨域方法(MultiDomain)、大模型方法(LAVAD)以及假设异常随场景变化的方法(CMRL),特别是在 XD-Violence 数据集上相较于现有最好结果有 20% 的提升,证明 LaGoVAD 具有强大的泛化能力。

在评估协议 2 下,LaGoVAD 的性能超过了上亿参数量的多模态大模型方法(Qwen 系列、HolmesVAU)和利用多个大模型的免训练方法(LAVAD),表明 LaGoVAD 能够有效地缓解概念漂移的现象,从而适应开放世界下用户的动态需求。

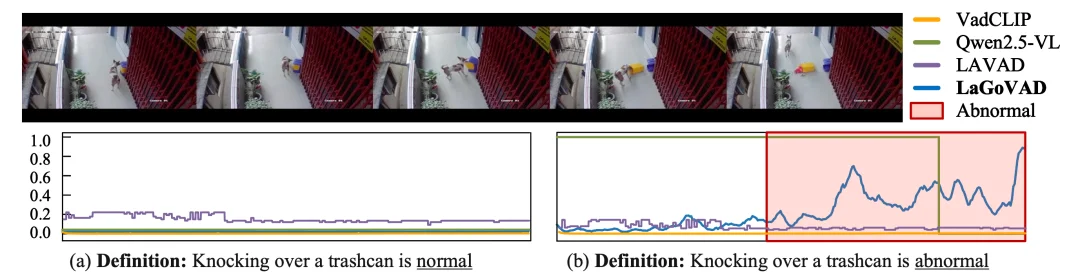

文中提供的可视化结果表明,对于 “狗打翻垃圾桶” 的示例,即使用户希望将这一事件列为异常,其余模型仍然无法适应这种动态需求,只会给出较低的异常分数,而 LaGoVAD 能够灵敏地根据定义以进行检测。

目前代码和数据集已经开源,感兴趣的朋友们欢迎研究和讨论,我们期待在 ICLR 2026 与学术同行们进行深入交流。

作者介绍:

刘子豪,中国传媒大学硕士生,主要研究方向为视频异常检测、视频理解、多模态大模型。

吴晓雨,中国传媒大学信息与通信工程学院教授,人工智能系主任,博士生导师。重点聚焦图像与视频智能分析、知识增强的视频/图像理解及跨模态检索等技术方向,并积极推动视频理解技术在广电、传媒与文化科技等领域的应用。

文章来自于微信公众号 "机器之心",作者 "机器之心"

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【开源免费】VideoChat是一个开源数字人实时对话,该项目支持支持语音输入和实时对话,数字人形象可自定义等功能,首次对话延迟低至3s。

项目地址:https://github.com/Henry-23/VideoChat

在线体验:https://www.modelscope.cn/studios/AI-ModelScope/video_chat

【开源免费】Streamer-Sales 销冠是一个AI直播卖货大模型。该模型具备AI生成直播文案,生成数字人形象进行直播,并通过RAG技术对现有数据进行寻找后实时回答用户问题等AI直播卖货的所有功能。

项目地址:https://github.com/PeterH0323/Streamer-Sales