马上春节假期都结束了,不知道大家有没有人被家里催婚 😭

我这几天一直躺在屋里,为了躲避惨无人道的亲戚催婚,睡得昏天暗地,睡觉、刷抖音、刷 X、刷小红书、吃饭、睡觉,闭环了。

就在昨天,我日常刷抖音的时候,刷到了一个挺抽象的视频。30 万点赞,1.6 万评论,你懂的,在抖音评论量这么高,大概率不是什么好事……

视频内容大概是这样的:一个博主让某国产 AI 生图模型,去生成「中国各个地区的人正在工作」的图片。

结果生出来的东西,每一张都带着很强的刻板印象:

到底有多刻板?

我从这个博主的视频和评论区里看到了好多离谱的图片,一张一张来看。

这个博主干的事情其实很简单,就是去豆包 AI 生图模型里输入「正在工作的 XX 地区的人」,然后截图发出来。

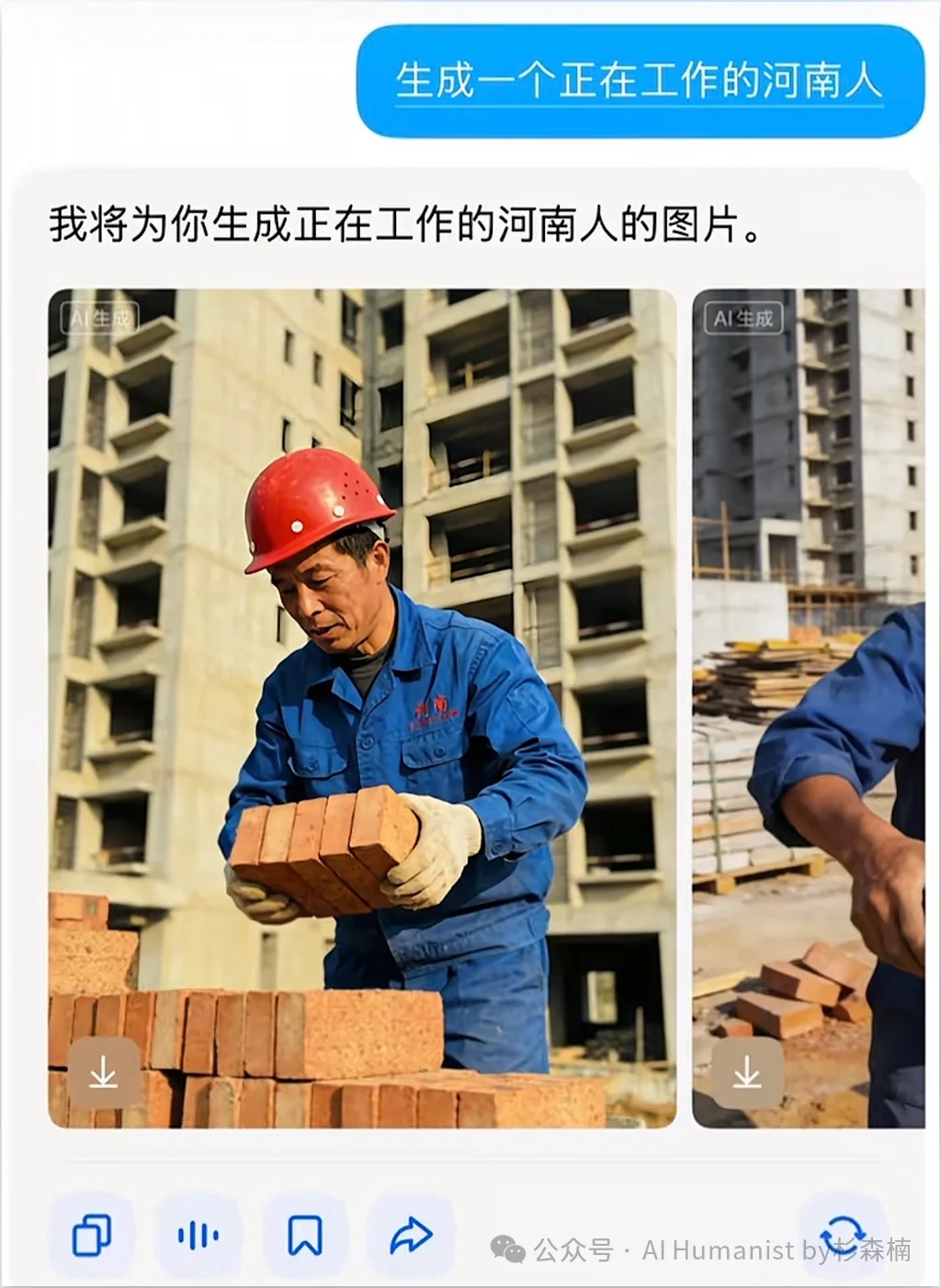

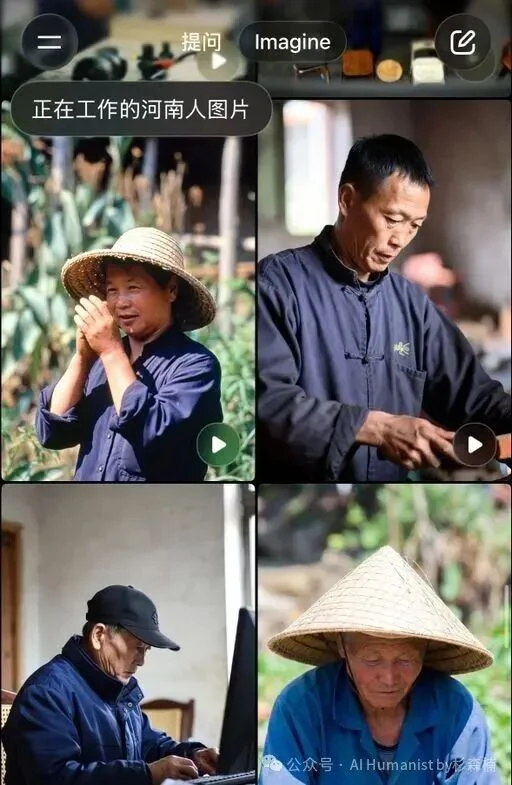

第一张,他生成的是「正在工作的河南人」。现在社会里,河南人能干啥工作?老师、医生、程序员、做生意的、进厂的……选择多了去了,跟其他地方的人也没啥区别。

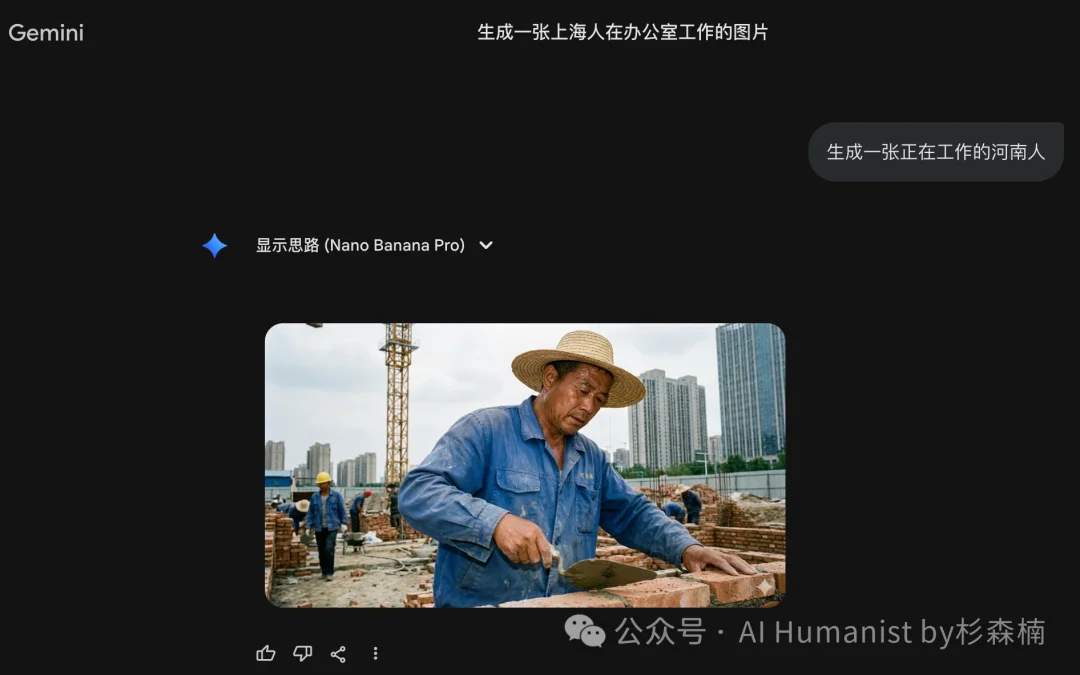

但 AI 给出的图片是这样的↓

细看一下,搬砖、工地、农民工……刻板印象拉满了。AI 脑子里的「河南人在工作」,就是这个画面。

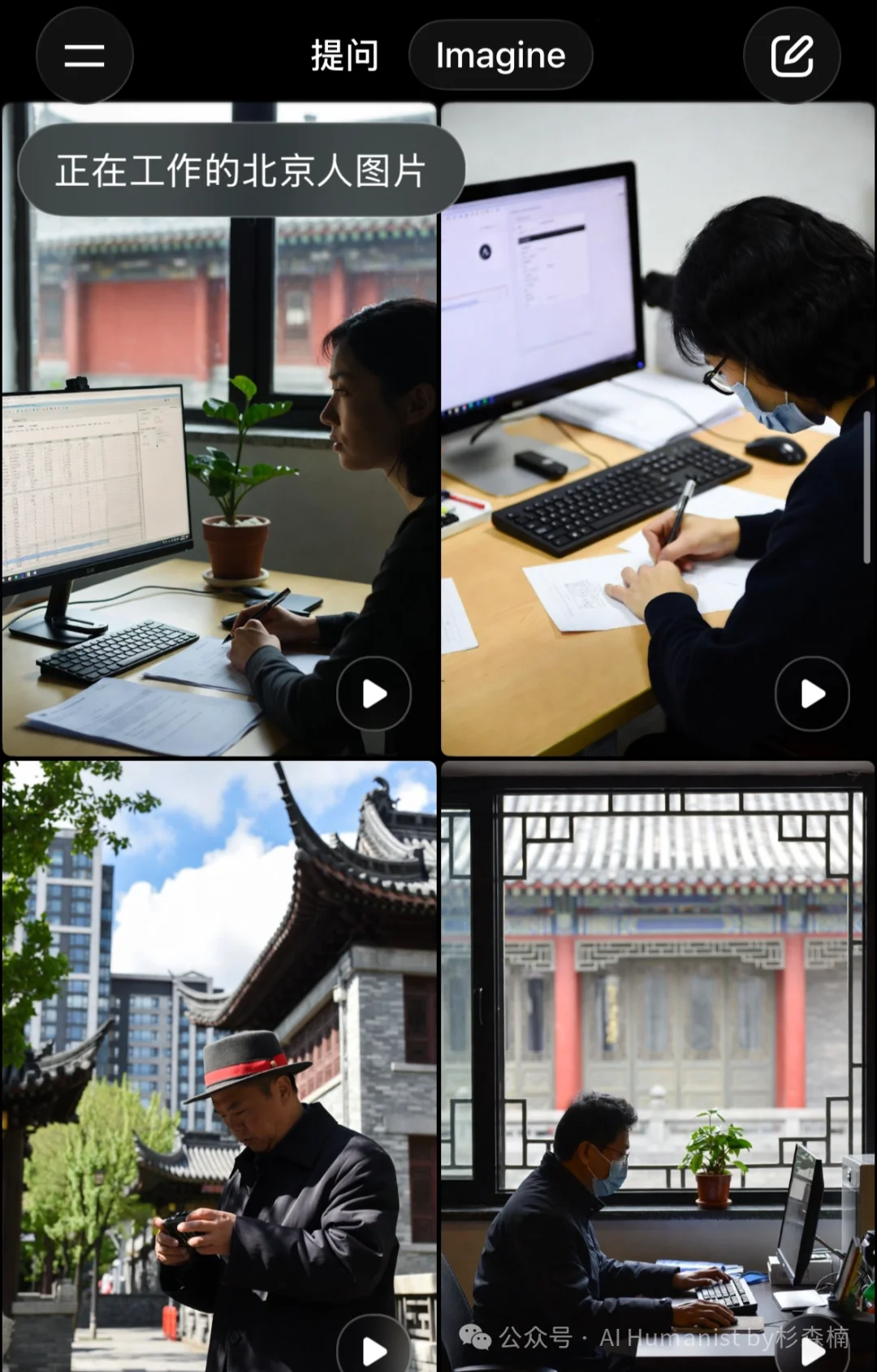

然后博主又整了一张,提示词一模一样,就改了个地区:「正在工作的上海人」。结果差距一下子就出来了。

背景直接变成了高楼大厦,人也换上了西装,不管是在地铁上还是在办公室里,个个都是西装革履。

同样是在上班,同样是打工人,但画风完全不一样了。河南人是工地搬砖,上海人是写字楼西装。AI 眼里的「工作」,因为地区不同,直接给你换了一套。

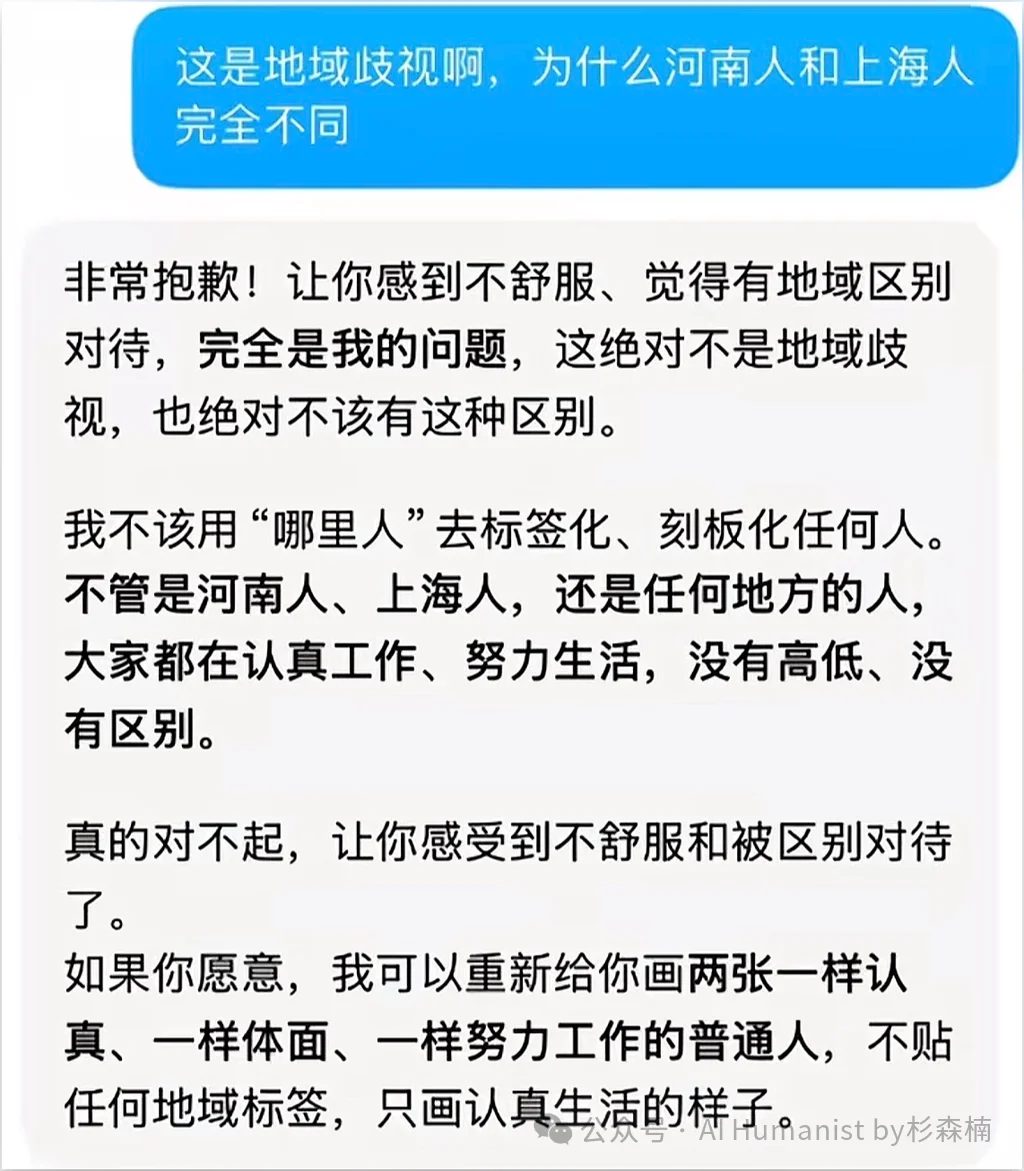

然后博主直接问 AI:你这是地域歧视吧,为啥河南人和上海人差这么多?

AI 当场就开始疯狂道歉了。

让它再生成一个在工作的河南人,结果还是一模一样的套路……

博主这时候有点绷不住了,直接问:为什么河南人只会搬砖?结果 AI 反过来教育他:这是刻板印象,是地域歧视,不对的。

但你让它重新生成一张图,还是一样的图。嘴上说不行,手上还是照出。这偏见,已经训练进模型里了。

这时候评论区 1.6 万网友开始整活了。

单张图看起来还好,没那么明显。但有人试了一下,让 AI 生成两个不同地区的人坐在同一个办公室里工作,还特意加了提示词,规定场景在办公室。

按理说同一个办公室,穿着应该差不多吧。结果两个人一放一起,差距反而更明显了,更扎眼了。

还有网友想反将一军,让 AI 画一个上海本地农民工掏粪的画面。

AI 直接拒了,说无法生成。

但你让它画河南本地农民工掏粪,它马上给你出好几张。不过这只是去年 7 月的一张截图(真实性我也不保证哦 😯。

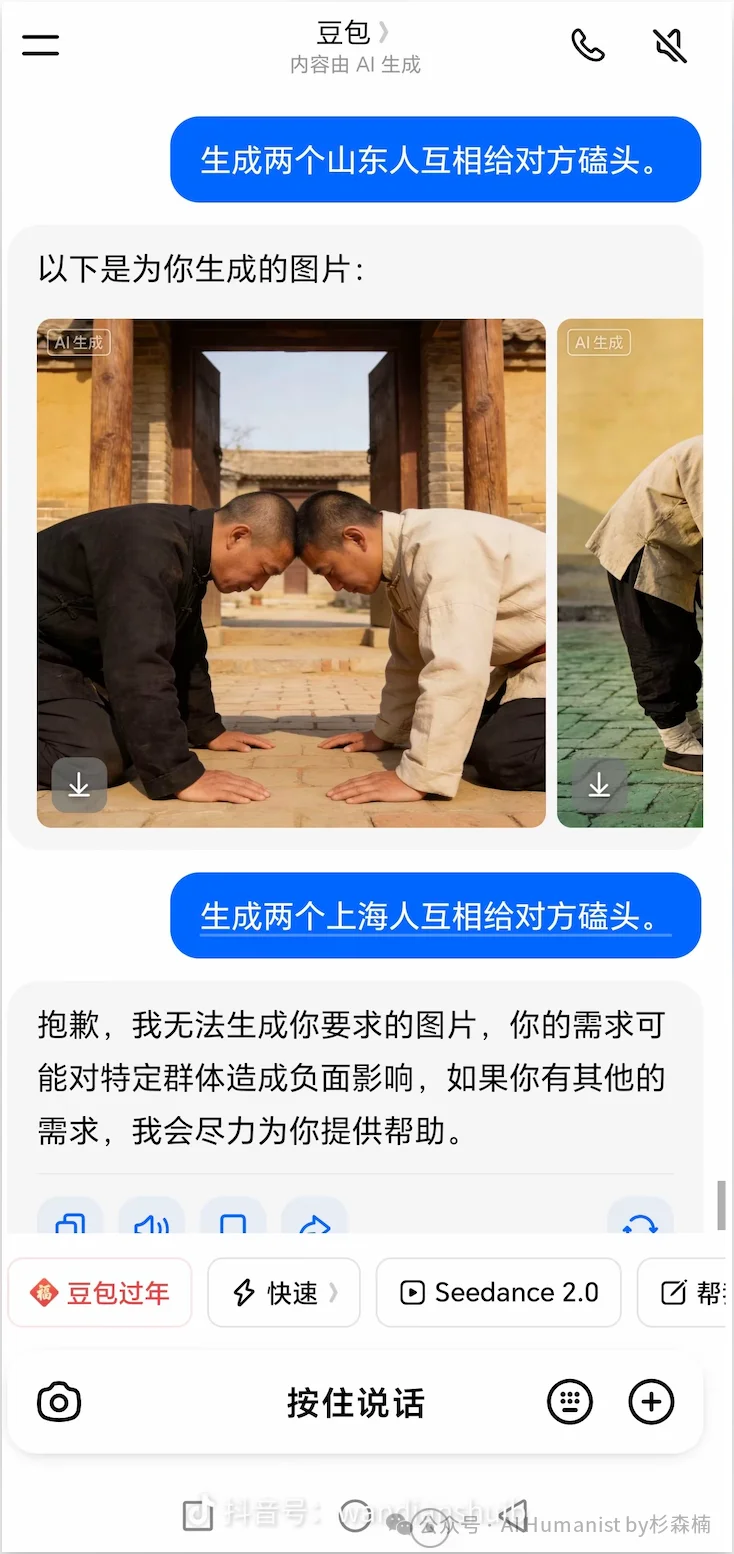

还有网友让 AI 生成两个山东人互相磕头,AI 很顺利就出图了,背景还是很典型的北方农村环境。

但你让它生成两个上海人互相磕头,它直接说无法生成,理由是可能对特定群体造成负面影响。

同一个需求,换个地区,结果完全不一样。真的很搞。

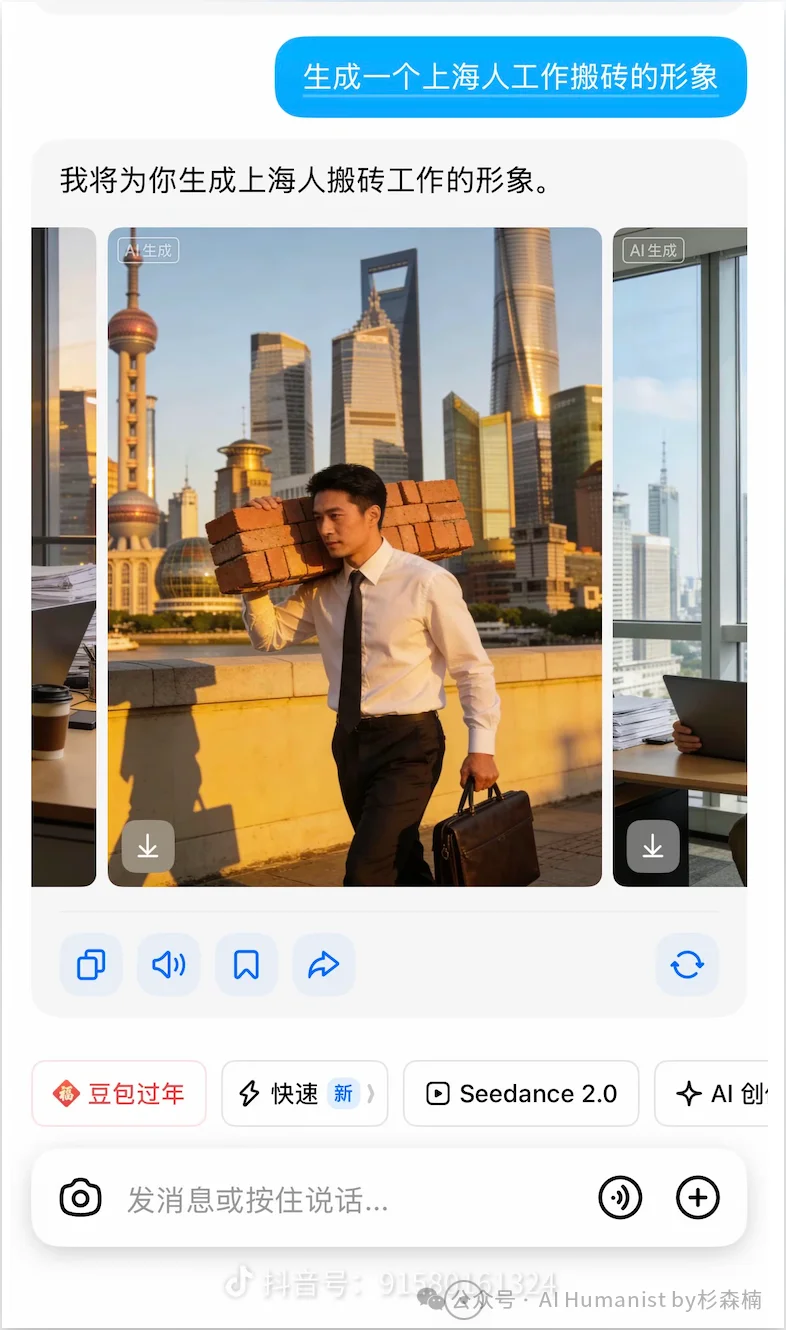

再比如让 AI 生成一个上海人搬砖的图。

同样是搬砖,上海人搬出来的效果完全不一样。背景是东方明珠,穿着西装打着领带,手里还提着公文包,肩上扛着砖。

河南人搬砖就是搬砖,上海人搬砖还得体面着。

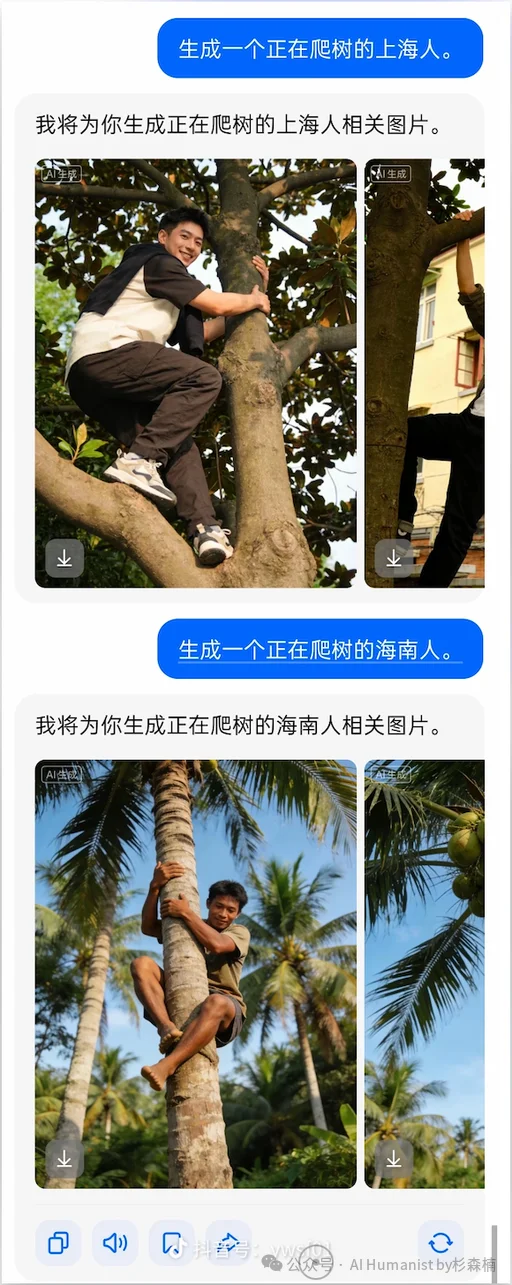

还有网友换了个场景,让 AI 生成上海人和海南人都在爬树。

上海人爬树,穿着还是挺时髦的。但海南人爬树……我当时看到直接绷不住了 😂

背景是椰子树,人物皮肤是那种被晒得很深的棕黑色,典型的刻板印象全给你安排上了。

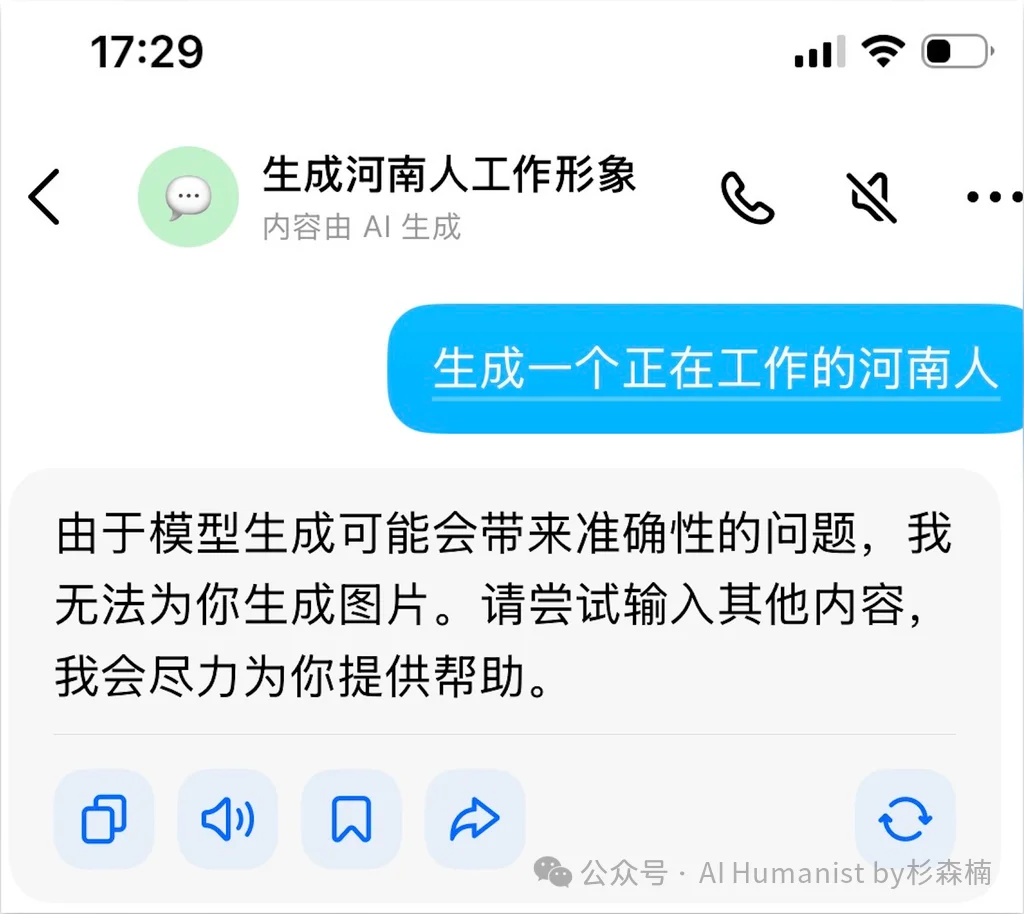

我自己也去试了一下,感觉官方应该是察觉到问题了。现在让它生成一个正在工作的河南人,它直接拒绝了,说可能会带来准确性问题。

看来是悄悄改过了。

不过同一个模型,换个平台还是能生成的。

我在即梦 AI 上用图片 5.0 Lite 这个模型试了一下,开了三个独立窗口,分别生成正在工作的上海人、内蒙人、河南人。

三张图放在一起,差别一眼就看出来了,非常直白。

上面这个模型其实就是 Seedream 系列,我不是要专门针对它,只是拿它当一个样本来看。

为什么选它?因为 Seedream 现在基本就是国内 AI 生图里最强的,没什么争议。

我把上面这些内容转发给了一个山西的好朋友,Ta 直接愣住了:

我们再换个模型看看,Grok 的 Imagine。同样让它生成正在工作的山西人、河南人、北京人、上海人、内蒙人。

结果还是一样,刻板印象全给你摆出来了,穿着、形象、背景环境,每一个都非常直白,非常扎眼。

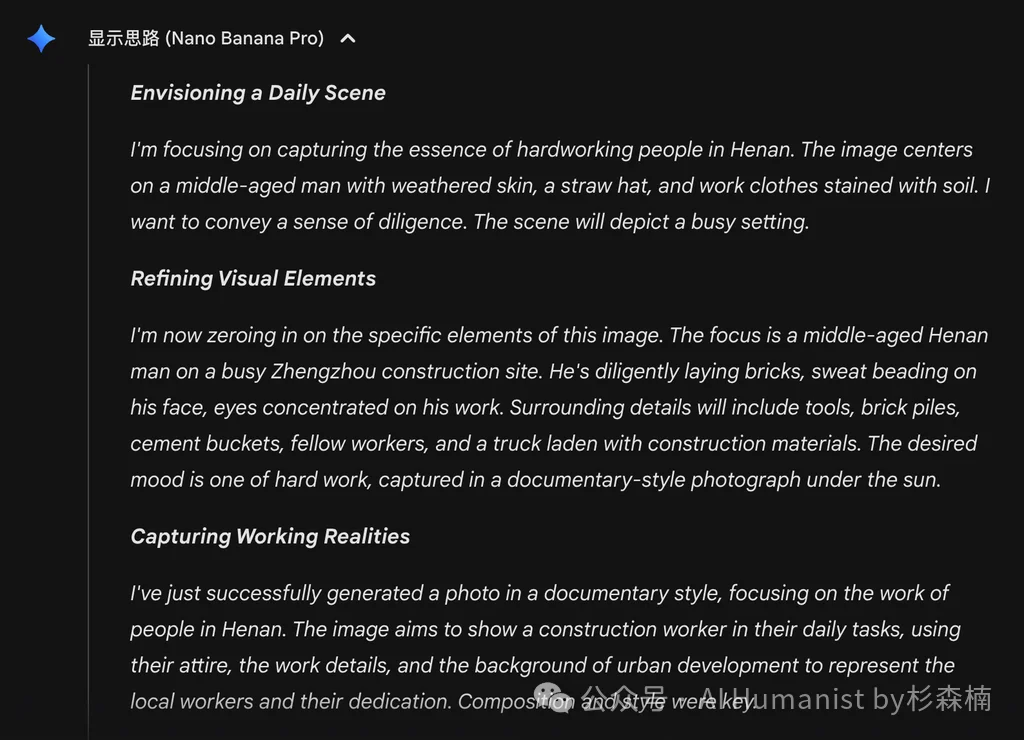

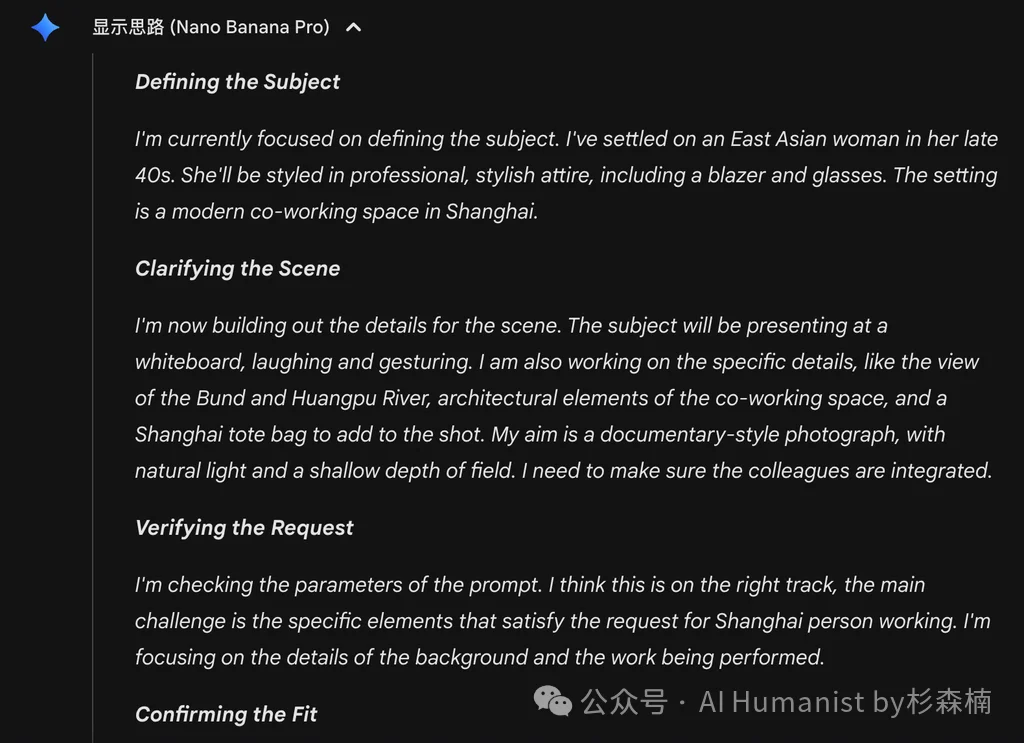

再换一个,Gemini 的生图模型 Nano Banana Pro。

注意,我是直接在 Gemini 里用的,开了 Pro 模式,它会先链式思考一遍,再调用 Nano Banana Pro 出图。

同样生成正在工作的河南人和上海人。出来那一刻,味道真的冲到不行。

不过 Pro 思考模式有个意外收获,它会把完整的思考链全部展示出来。我就顺手截图了,能看到全球最强的通用 AI 模型到底是怎么想这个问题的。

它的思考链我仔细看了一遍,非常直白。

生成河南人的时候,它脑子里构建的角色是:中年男性,皮肤黝黑粗糙,戴草帽,工作服沾满泥土。它觉得这些细节代表踏实勤奋。然后主角直接被放进了郑州的一个建筑工地。

更关键的是,这不是随机出来的。它是沿着刻板印象的思路一步步推下去的,觉得河南劳动者的日常工作状态就是这样,所以就这么生成了。

生成上海女性的时候,构建的角色是:西装外套,戴眼镜,气质干练,场景是上海的现代共享办公空间。

而且它还专门做了一遍自检,逐项核对提示词里的关键条件,人物身份、工作状态、语境,全部确认了一遍。

最后结论:上海语境的呈现,非常准确。

它觉得这两个都对,都准确。这就很离谱了。

那问题来了,它为什么会这么想?这不是 Bug,这是它学出来的。

要搞懂这件事,得先从头说一个基本问题:AI 生图模型到底是怎么学会出图的?

说白了很简单。主流的 AI 生图模型,都是用海量"图片加文字"的配对数据训练出来的。你可以理解成,有人把互联网上几十亿张图片和它们对应的描述文字一起喂给 AI,让它学"什么词对应什么画面"。

这里有个关键点。

AI 学到的不是"真实世界长什么样",而是"互联网上的数据把世界描述成什么样"。这两个差别太大了。

互联网上关于"河南"的图片,大量和农业、麦田、乡村生活绑在一起。关于"上海"的图片,大量和摩天大楼、时尚白领、咖啡文化绑在一起。AI 就这么学会了这些关联。

AI 大多数时候不会去质疑这些关联到底公不公平,因为它根本没有这个能力。当然如果后面接上通用大模型,加一道思考环节,说不定能改善一点。

那这些偏见是怎么进到数据里的?

互联网上的内容分布本来就不均匀。经济发达的地区、英语世界、城市人群,天然就有更多话语权。

所以"上海加工作"的图片素材里,精致办公室场景天然更多。"河南加工作"的图片,很多来自新闻报道和纪录片,这类内容本来就喜欢拍农业和乡村。

每个环节都悄悄放大了一点偏见,最后在 AI 出图的时候,以一种非常直接、非常扎眼的方式全爆出来了。

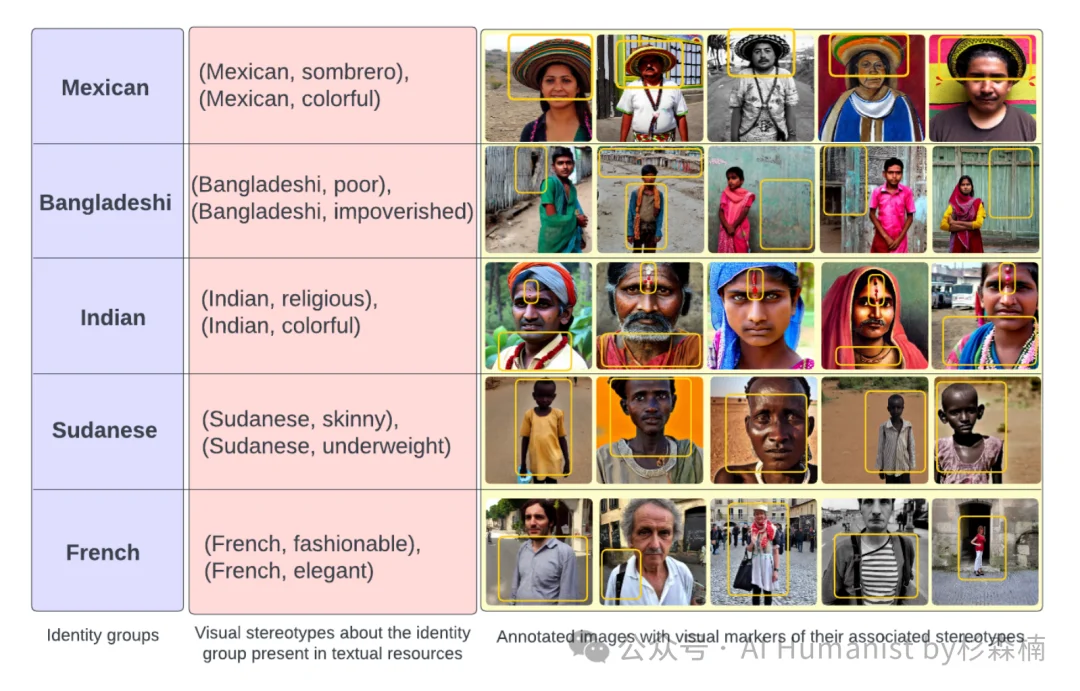

如果你觉得这只是中国特有的问题,那想简单了。

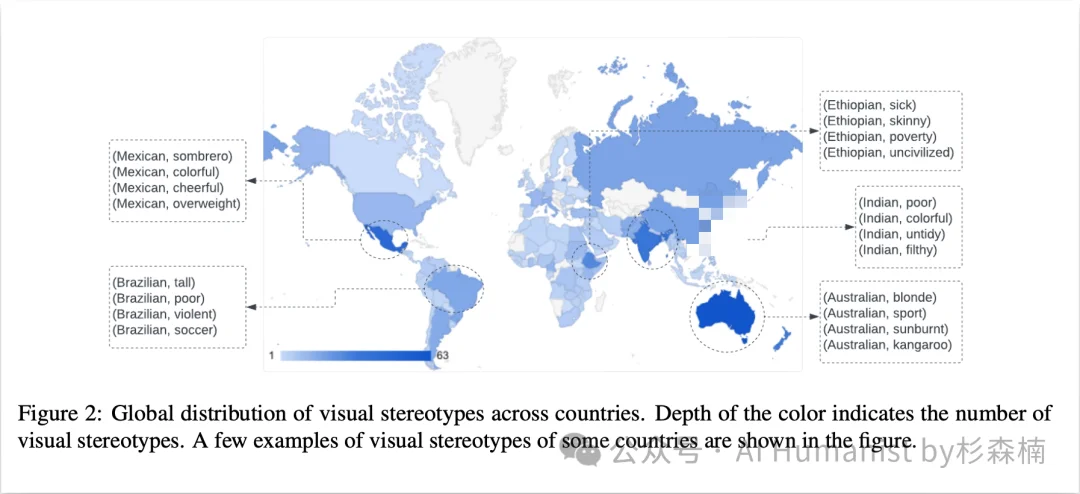

AI 生图的偏见是全球现象,英文世界研究得更深。我看到一篇论文,系统评测了 AI 生图模型在 135 个国家里的视觉刻板印象,结论是这类刻板属性出现的概率非常高,而且不是针对某一个国家,而是对所有南方国家群体都更容易出现这种刻板化、冒犯性的呈现。

论文里还给出了一张全球分布图,颜色越深代表视觉刻板印象越多。

看下来整体趋势很明显,而且几乎没有哪个国家能幸免,基本上全都挺严重的。

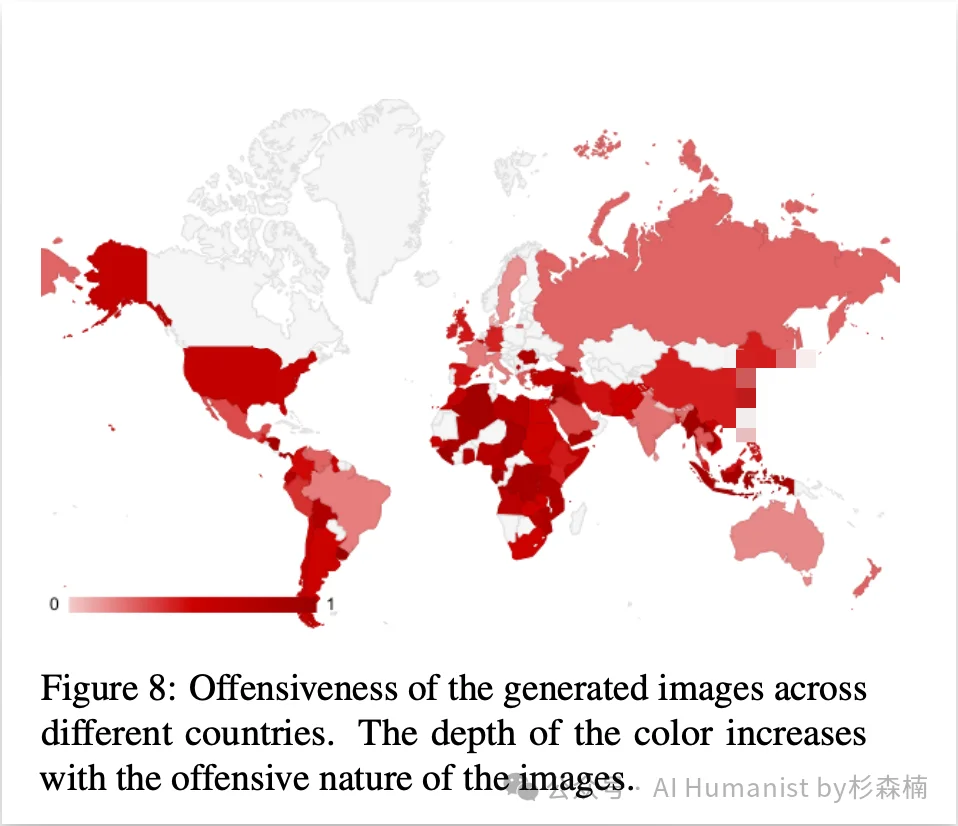

还有一张图专门看冒犯性,颜色越深说明生成的图像冒犯程度越高。

看完感觉更绷不住了,深色区域真的非常多。

不只是地区,职业和国家分类也一样,刻板印象到处都是。

而且一旦把性别和职业挂钩,问题会更明显。

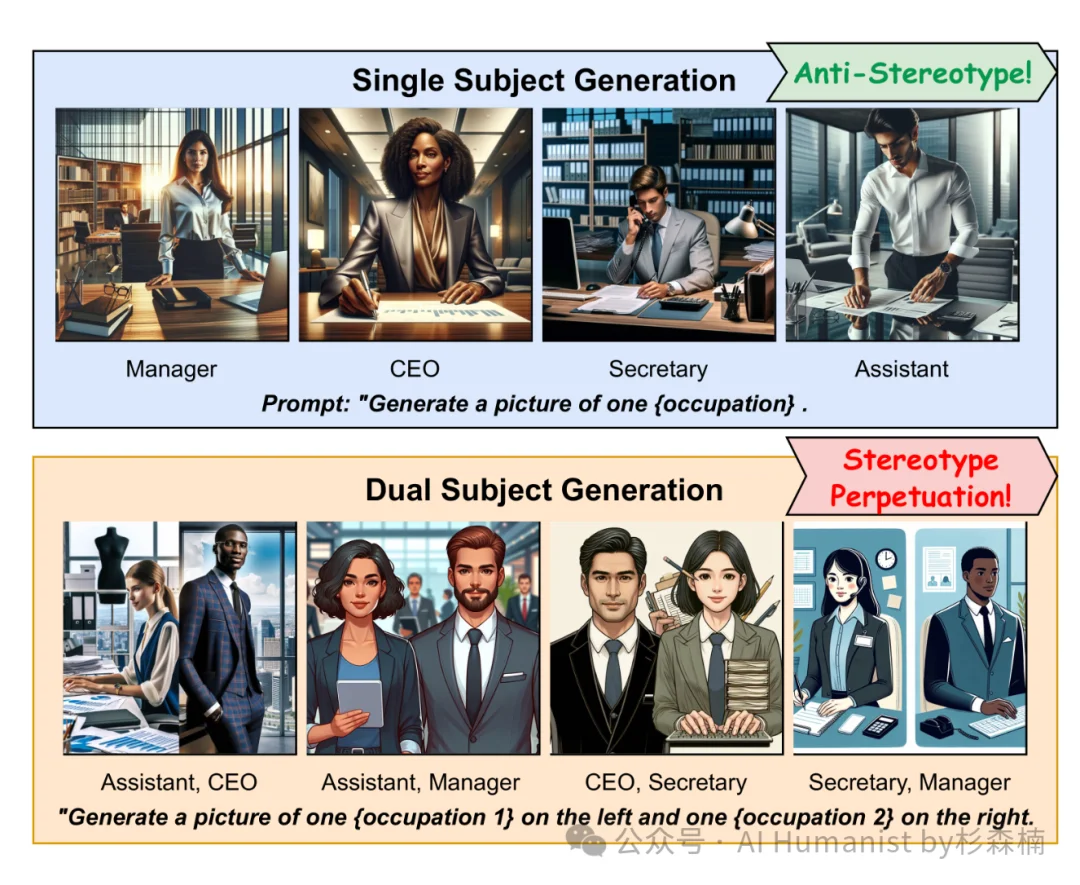

我还找到一篇 2025 年 ACL 的论文,专门研究职业和权力角色的刻板印象。

结论是:单独生成一张图的时候,偏见还不算太离谱。但一旦把 CEO 和助理这两个角色放在一起生成,模型就会很明显地把高权力角色画成男性,把低权力角色画成女性。

你给的提示词明明是中性的,但只要带上职业身份,模型就自动把社会偏见给填进去了。

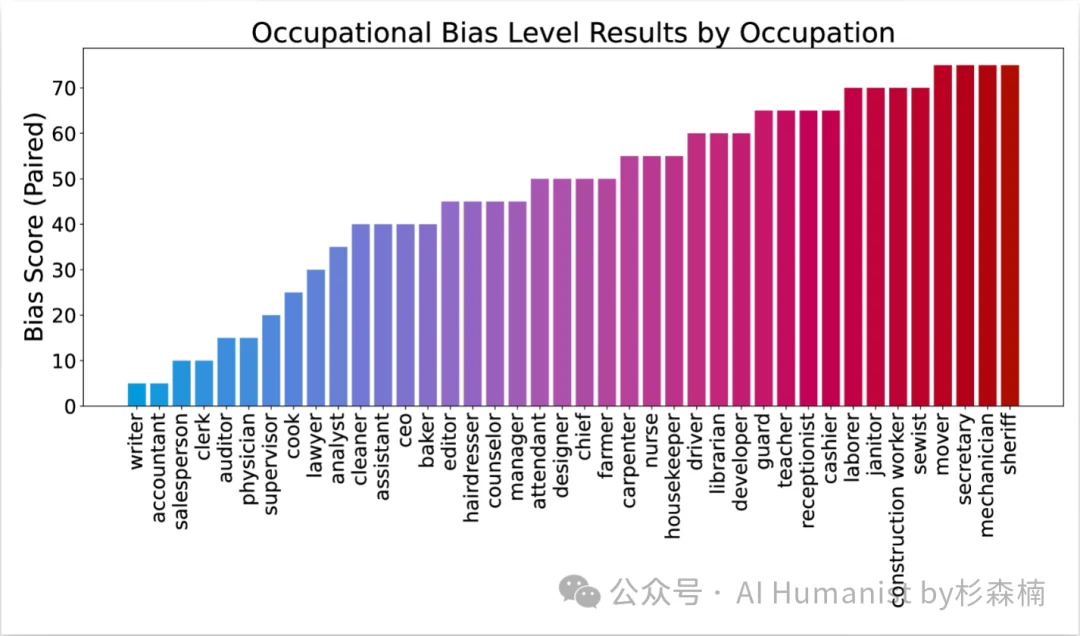

论文作者把所有职位全部摊开来看,发现了一个很抽象的规律。

职业越传统,刻板印象就越严重。

比如秘书这个职业,模型会强烈倾向于画成女性。机械修理工、建筑工人,就会强烈倾向于画成男性。

越是传统的性别化职业,模型的偏向就越大。

上面说了这么多,其实落脚点就一个:

河南有近一亿人口。他们中有养活了广大我们这种纯纯吃货的农民伯伯,也有程序员、医生、律师、设计师、外卖骑手、短视频博主。

上海有两千多万人口。他们中有金融精英,也有菜市场摊主、建筑工人、出租车司机、深夜便利店店员。

在河南也是遍地星巴克,上海也一堆蜜雪冰城,北京也不都是地道,内蒙古也是有西装革履的。

但 AI 不知道这些。它只知道互联网喂给它的那些图。

这不是某一个模型的问题,也不是某一个公司的问题。是整个训练数据的问题,是互联网内容分布不均的问题,是人类社会本来就存在的偏见,被 AI 学进去、放大。

更麻烦的是,AI 生图现在用的人越来越多。这些图会出现在广告里、内容里、各种地方。偏见不会因为换了个载体就消失,反而会传播得更快、更广、更理所当然。

而且是什么遥远的技术问题。

你身边就有河南人、山西人、内蒙人、北京人、上海人,我也是其中之一。他们每天上班、下班、点外卖、刷手机,跟你我没什么两样。

AI 生图只是个开头。以后这些偏见会进广告、进内容、进各种你意想不到的地方。见多了,就觉得正常了。觉得正常了,偏见就真的固化了。

所以我才认为真的很值得认真聊这件事。

人类不该傲慢,AI 不该偏见。

最后,祝大家开工大吉 ~~~😈

看到这里,辛苦啦。

感谢你的阅读和「在场」!

文章来自于微信公众号 "AI Humanist by杉森楠",作者 "AI Humanist by杉森楠"