原生,启动!

刚刚,谷歌发布了首个原生多模态(Multimodal)嵌入模型——

Gemini Embedding 2。

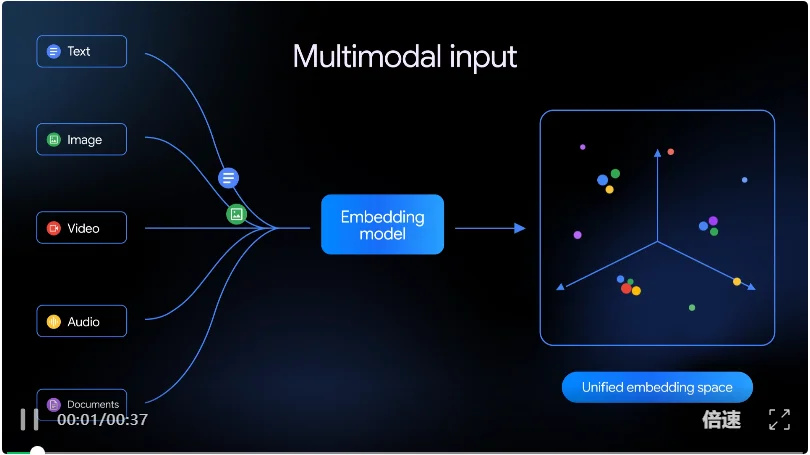

这次模型最大的变化在于:把文本、图像、视频、音频和文档,全部映射进同一个统一的嵌入空间。

换句话说,不同媒介的数据第一次被放进同一个语义坐标系里。

在输入能力上,Gemini Embedding 2支持多种数据类型:

此外,模型不仅可以处理单一模态,还支持多模态混合输入(例如图像 +文本)。

这意味着模型可以捕捉不同媒体之间的复杂语义关系,从而更准确地理解现实世界中的信息。

在评测方面,Gemini Embedding 2不仅整体性能较上一代提升,同时也为多模态嵌入任务树立了新的性能基准。

一方面增强了语音处理能力,另一方面也在文本、图像和视频任务中均超越现有领先模型,实现SOTA。

乍看之下,这似乎只是一次底层的数据工程升级。

但实际上,它正为像龙虾这样的AI Agent真正“看懂”世界,提供了关键基础。

目前,Gemini Embedding 2已经通过Gemini API和Vertex AI展开公测。

原生多模态嵌入

嵌入模型(Embedding Model)本质上是把数据转化为稠密向量表示。

在这个向量空间中,语义相似的数据会彼此靠近,不相似的数据则距离更远。

传统的嵌入模型主要针对文本。

例如,在谷歌此前的论文《Gemini Embedding: Generalizable Embeddings from Gemini》中——

Gemini Embedding通过在大语言模型参数中已有的海量知识基础上构建表征,并将得来的嵌入用于:语义检索、文本聚类、分类,排序等下游任务。

但这只停留在文字阶段。

最新的Gemini Embedding 2,则首次彻底打通了多模态数据。

文本、图片、视频、音频和文档,都被压缩到同一个向量空间之中。

而这,就意味着模型实现了“跨模态语义对齐”,能够让猫这个「文字概念」与猫的照片这个「视觉概念」,在统一的嵌入空间中的数学向量的距离极度接近。

通俗来说,当你搜索“猫”的时候,系统不仅能找到相关文字,还能直接找到猫的图片、视频甚至声音。

也正因为如此,很多原本复杂的多模态流程可以被大幅简化。

从RAG检索、语义搜索、情感分析,到数据聚类等应用场景,都能直接受益。

更重要的是,这类能力对AI Agent意义巨大。

过去的Agent在操作电脑时,往往只能依赖文字信息。

例如识别按钮上的“设置”“确认”等标签。但真实世界的UI界面,大量信息其实来自视觉结构:

图标、布局、颜色、控件位置,正是传统文本嵌入模型难以处理的部分。

而有了多模态嵌入之后,情况就不同了。

对于像OpenClaw(龙虾)这样需要操作电脑,识别屏幕的Agent来说,它不再只是识别文字。

它可以直接理解:哪个像素区域是设置图标、哪个按钮与当前任务最相关,屏幕截图与文本指令之间的关系

换句话说,Gemini Embedding 2提供了一条统一的感官总线。视觉、听觉与文本信息,都能在同一个语义空间中进行关联。

这也为未来Agent真正理解屏幕、理解环境并代替人类操作电脑,奠定了最重要的语义基础。

在技术层面,Gemini Embedding 2继续采用Matryoshka Representation Learning(MRL) 。

这种方法允许嵌入向量在保持语义信息的同时进行动态维度缩减。

(注:MRL强制模型把最核心、最关键的特征压缩在向量的前几十维里,次要的特征放在后面,这让开发者可以根据预算和算力,自由决定信息密度的分布管理)

Gemini Embedding 2的默认输出维度为3072维,但开发者可以根据需求缩减,例如:3072维、1536维、768维,从而在性能与存储成本之间取得平衡。

除了支持API调用外,Gemini Embedding 2也支持通过LangChain、LlamaIndex、Haystack、Weaviate、QDrant、ChromaDB和Vector Search等工具调用。

通过为不同类型的数据赋予统一的语义表示,Gemini Embedding 2正在为下一代AI应用:多模态Agent,乃至具身智能机器人提供关键基础设施。

参考链接

[1]https://blog.google/innovation-and-ai/models-and-research/gemini-models/gemini-embedding-2/

[2]https://arxiv.org/pdf/2503.07891

文章来自于“量子位”,作者 “henry”。

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI