2倍Token效率、1M长上下文、智能体集群背后技术齐亮相。

智东西3月18日报道,今日凌晨,在英伟达GTC大会上,月之暗面创始人杨植麟作为本届唯一受邀现场演讲的中国独立大模型公司创始人,发表题为《How We Scaled Kimi K2.5》的演讲,首次完整披露Kimi K2.5背后的技术路线图。

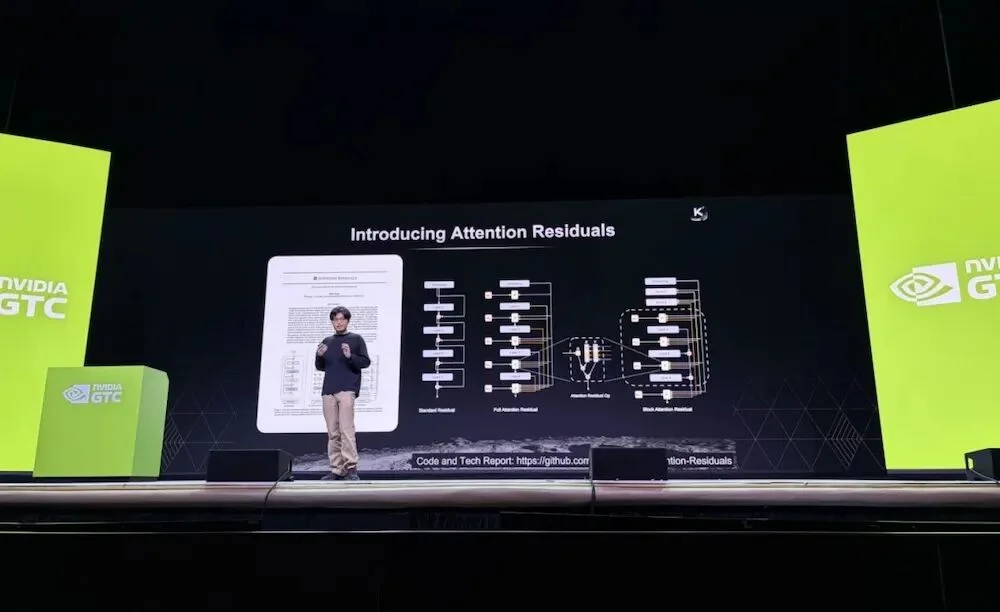

就在3月16日,月之暗面刚刚发布最新论文,提前预览了下一代模型的关键模块——注意力残差(Attention Residuals,简称AttnRes)。这篇论文的核心,是对大模型中最基础、却长期被默认接受的结构之一残差连接(Residual Connection)的重新设计。

这项进展很快引发海外AI圈关注。埃隆·马斯克(Elon Musk)称其“令人印象深刻”;前OpenAI研究副总裁、联合创始人安德烈·卡帕西(Andrej Karpathy)则直言,人们对《Attention is All You Need》这篇Transformer开山之作的理解,可能还不够充分。

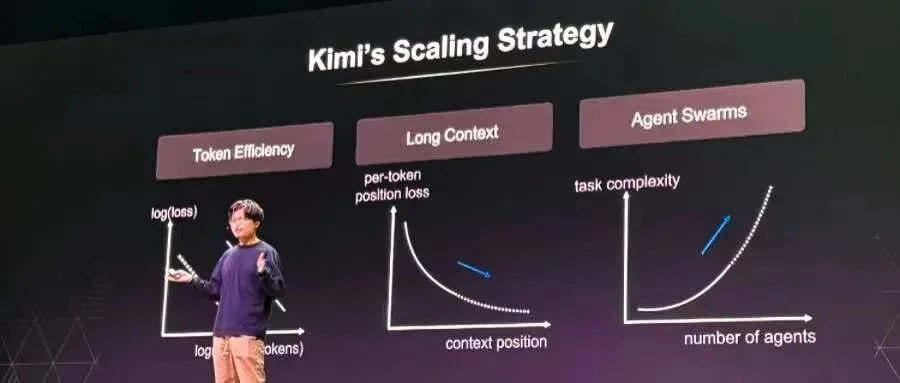

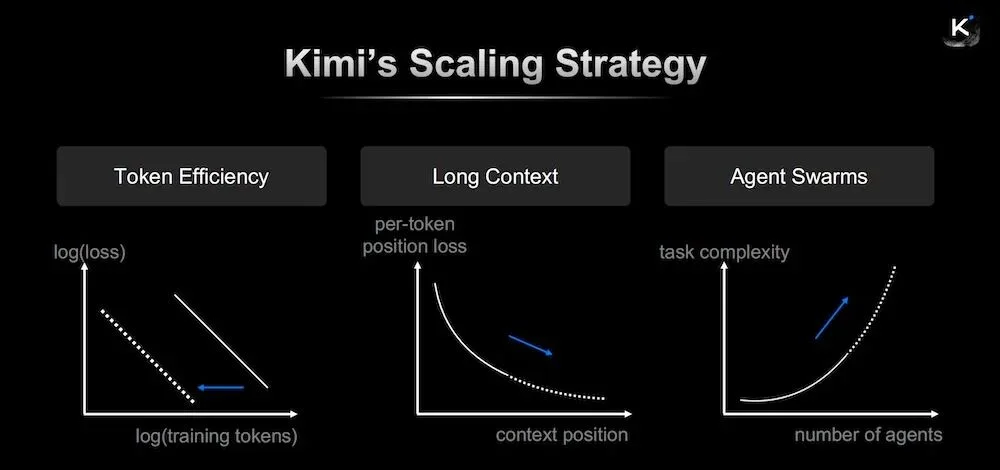

在杨植麟看来,当前的Scaling已经不再是单纯的资源堆砌,而是要在计算效率、长程记忆和自动化协作上同时寻找规模效应。如果能将这三个维度的技术增益相乘,模型将表现出远超现状的智能水平。

这也是自1月底Kimi发布K2.5以来,月之暗面首次把这套技术路线图系统披露。

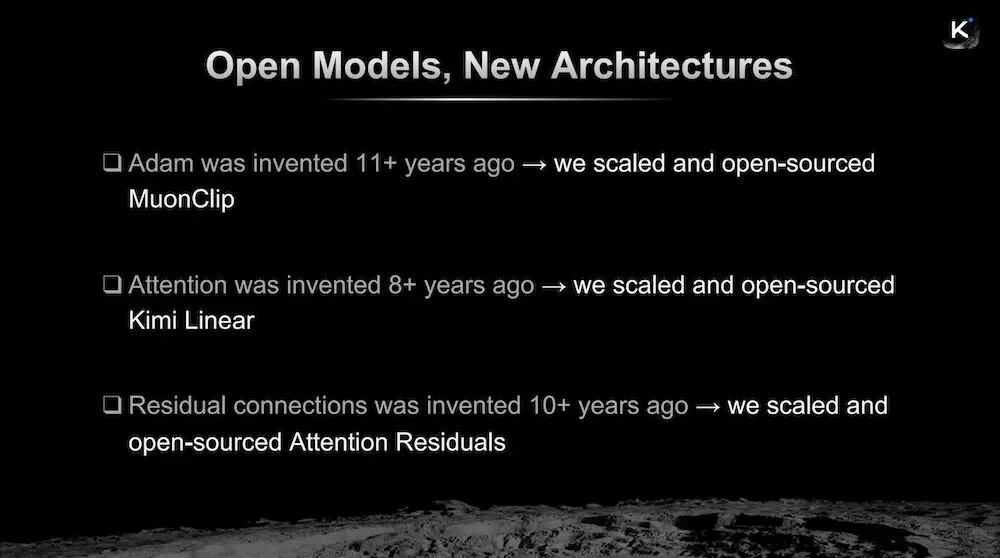

杨植麟提出,行业目前普遍使用的很多技术标准,本质上是八九年前的产物,正逐渐成为Scaling(拓展)的瓶颈。围绕这一问题,Kimi团队选择从优化器、注意力机制和残差连接三个基础模块入手,逐一重构,并持续开源。

重写训练底座:MuonClip

把Token效率推高到AdamW的2倍

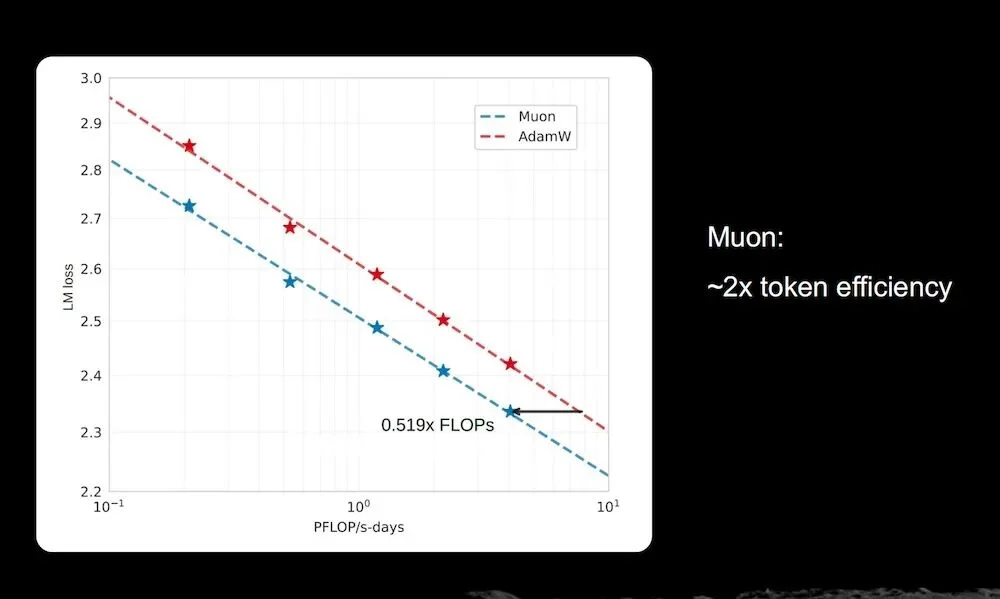

Kimi团队把第一项重点放在Token效率上,杨植麟在演讲中重点讨论了优化器问题。

他提到,自2014年以来,Adam优化器一直是行业默认选择,但在超大规模训练中,更高Token效率的替代方案已经成为重要方向。Kimi团队在实验中验证,Muon优化器在Token效率上具备显著优势,在相近计算预算下,可以将训练Token以两倍的效率转化为模型能力。

▲Muon优化器在相同算力下实现约2倍Token效率

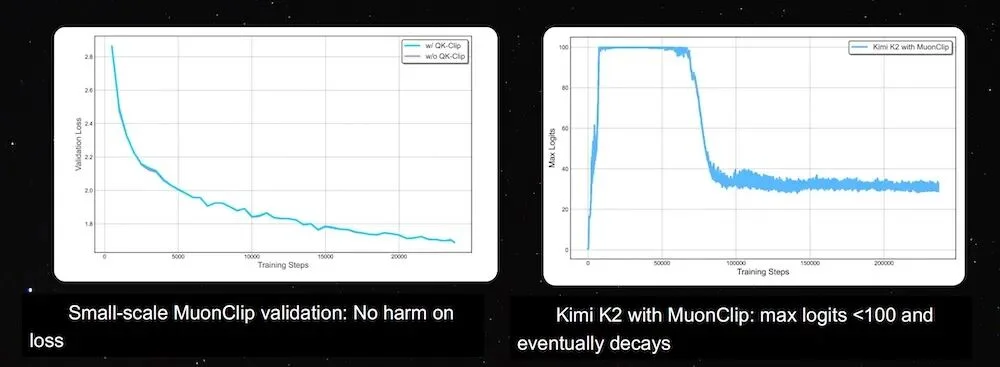

不过,杨植麟也指出,在将Muon扩展至万亿参数规模的K2模型训练过程中,Kimi团队遇到了稳定性问题:训练中出现Logits爆炸,最大值迅速超过1000,导致模型发散。

针对这一问题,Kimi团队提出MuonClip优化器。杨植麟称,该方法通过Newton-Schulz迭代结合QK-Clip机制,对训练过程中的数值进行约束。在实际训练中,Kimi K2的max logits被控制在100以内并逐步回落,同时模型loss没有受到负面影响,实现了稳定训练。

▲MuonClip将max logits控制在100以内,实现稳定训练

他同时提到,为了让Muon在大规模GPU集群中具备可扩展性,Kimi团队还设计了“Distributed Muon(分布式Muon)”,将优化器状态分布在数据并行组中,在需要时再聚合梯度完成计算,以提升内存效率和整体训练效率。

第二个重点是长上下文:Kimi Linear

把128K到1M解码速度拉高5到6倍

长上下文是Kimi这次路线图的第二条主线。

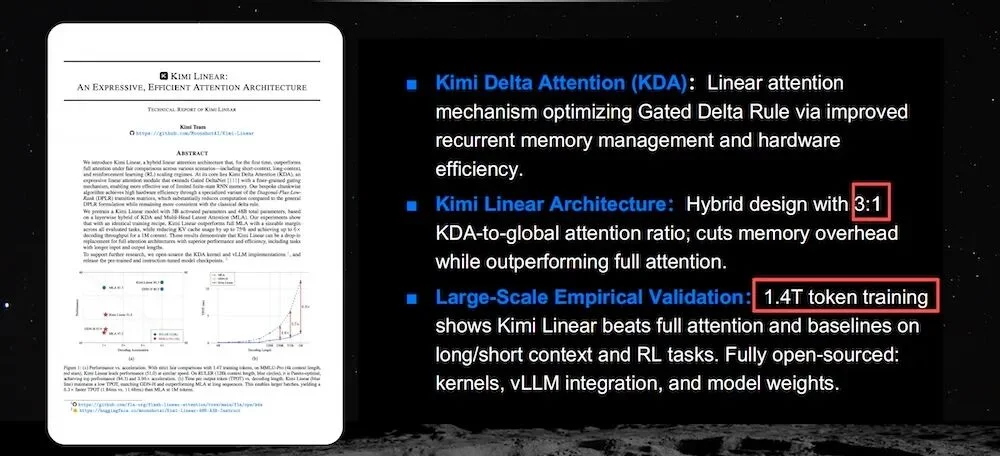

在这部分,杨植麟重点介绍了Kimi Linear。这是一套基于KDA(Kimi Delta Attention,Kimi增量注意力)的混合线性注意力架构。

它的核心思路,是重新安排注意力层的组成方式,而不是默认所有层都使用全注意力(Full Attention)。

具体来看,Kimi Linear采用约3:1的KDA与全局注意力混合比例,在降低内存开销的同时,保持模型表达能力。

杨植麟在演讲中提到,Kimi Linear已经完成1.4T token规模训练,在长上下文、短上下文以及强化学习任务中均优于全注意力及其他基线方案。

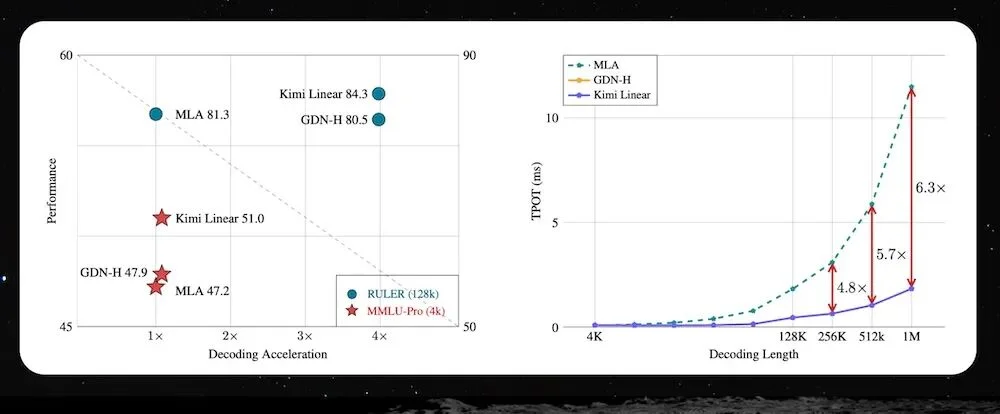

更直接的变化体现在推理效率上。在128K到1M上下文范围内,解码速度可提升约5到6倍,同时在不同长度场景下保持稳定表现。

这一改动解决的是一个长期存在的问题:上下文窗口不断扩大,但推理成本和延迟同步上升,导致长任务能力难以真正落地。Kimi Linear则将长上下文从“可支持能力”转变为“可高效使用能力”。

改写残差连接:

让每一层更主动地取信息

相比优化器和线性注意力,Attention Residuals(注意力残差)也是Kimi这次技术路线图里尤为关键的一项尝试。

残差连接是深度网络里极其基础的一层设计,已经用了十年左右。

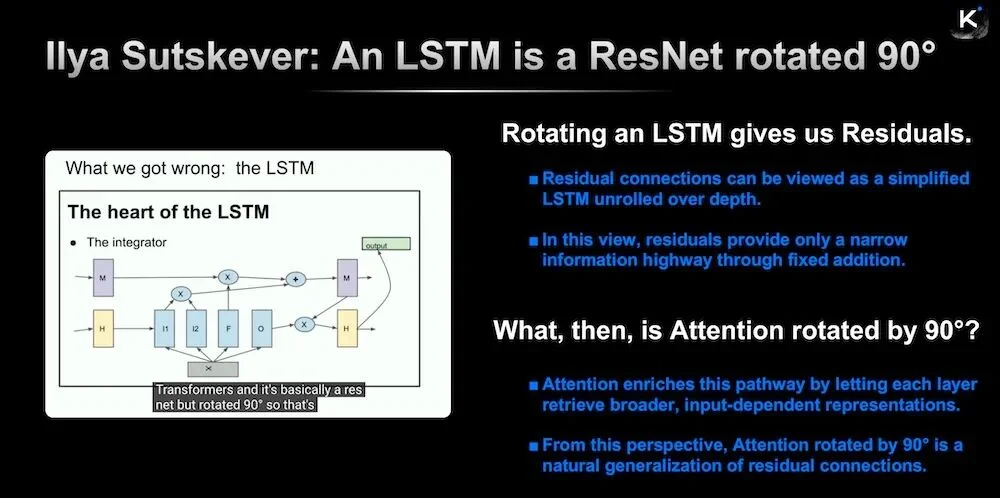

杨植麟提到,传统残差连接采用固定加法累加方式,随着网络加深,隐藏状态会持续增长,深层信息容易被稀释。Kimi团队的做法,是将残差路径替换为基于Softmax注意力的动态聚合,使模型可以根据输入内容,有选择地从前序层获取信息。

这一变化让信息流从“逐层叠加”转向“按需读取”,在深层网络中保持更稳定的信息表达。

在这一部分,杨植麟延伸了前OpenAI首席科学家(Ilya Sutskever)在NeurIPS 2024的相关思路:如果将残差连接视为沿深度展开的简化LSTM,那么Attention可以理解为对这条信息通道的进一步扩展。

▲Ilya提出“将LSTM旋转90度得到残差连接”,Attention可视为其扩展

基于这一理解,Kimi提出Attention Residuals,并已将相关代码与技术报告开源。

视觉强化学习反哺文本能力,

跨模态带来认知增益

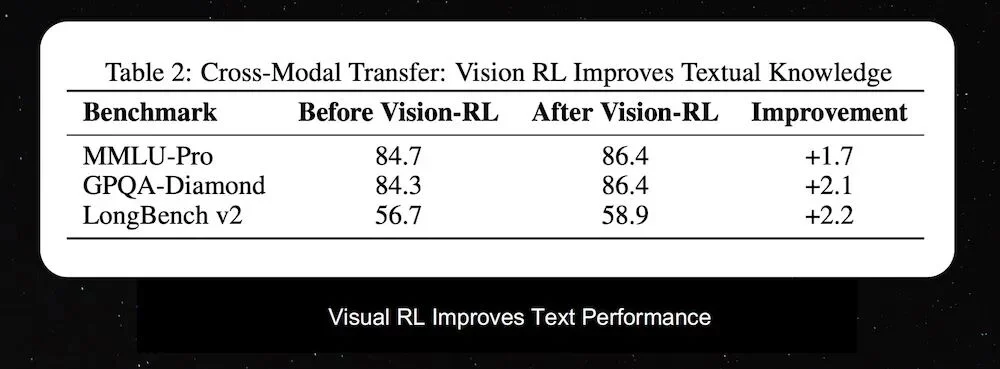

除了模型底层架构,杨植麟在演讲中还分享了一项跨模态研究方向的重要观察。

他提到,在原生视觉-文本联合预训练过程中,引入视觉强化学习(Vision RL)后,模型不仅在视觉任务上表现提升,也会反向提升纯文本能力。消融实验结果显示,在经过视觉RL训练后,模型在MMLU-Pro和GPQA-Diamond等文本基准上的表现提升约1.7%-2.2%。

杨植麟认为,这表明空间推理与视觉逻辑能力,可以转化为更深层的通用认知能力。相关工作也指向一个方向:多模态训练的价值,已经从“扩展输入形式”,转向“提升底层推理能力”。

他同时提到,Kimi团队正在推进“首个原生联合视觉-文本能力的开放模型(First open model with native, joint vision-text capabilities)”。

从单Agent到集群协作:

Kimi押注Agent Swarms

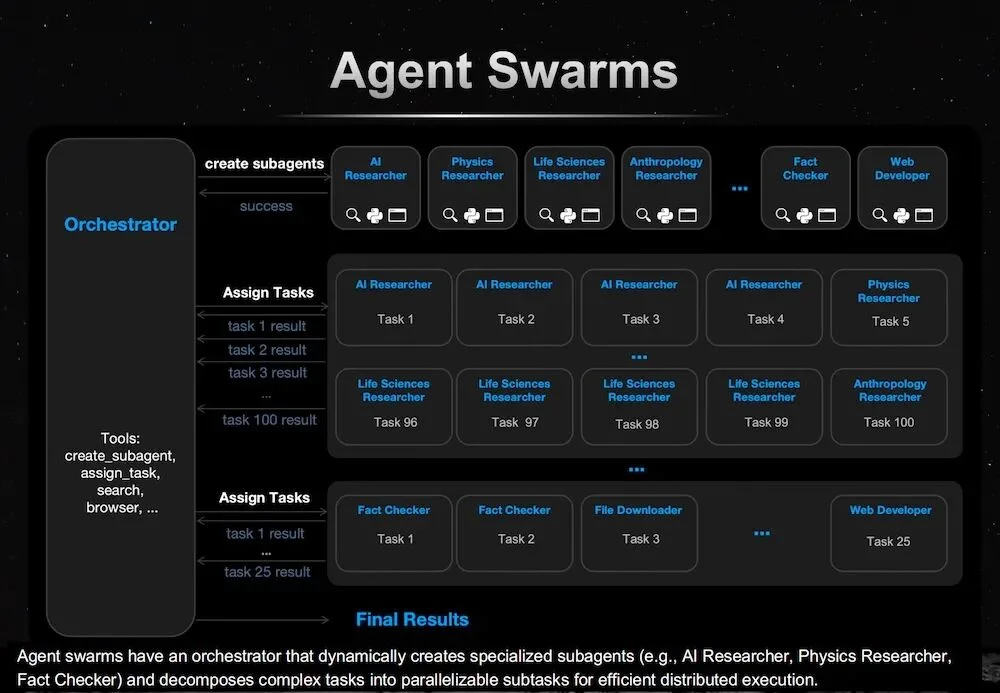

演讲最后一部分,杨植麟把重点落在智能体集群(Agent Swarms)上。

他在演讲中提到,未来的智能体形态将从单智能体,转向可以动态生成的集群系统。Kimi K2.5引入Orchestrator(编排器),能够根据任务需求创建多个子Agent,并将复杂任务拆解为并行子任务执行。

▲Orchestrator动态生成子Agent并并行执行任务

这些子Agent可以承担不同角色,例如AI Researcher(AI研究员)、Physics Researcher(物理研究员)、Fact Checker(事实核查员)等,通过分工协作完成整体任务。

杨植麟进一步补充,这类系统可以覆盖从输入到输出的完整流程,包括大规模信息获取(Input at Scale)、并行操作(Actions at Scale)、任务编排(Orchestration at Scale)以及长结果生成(Output at Scale)。

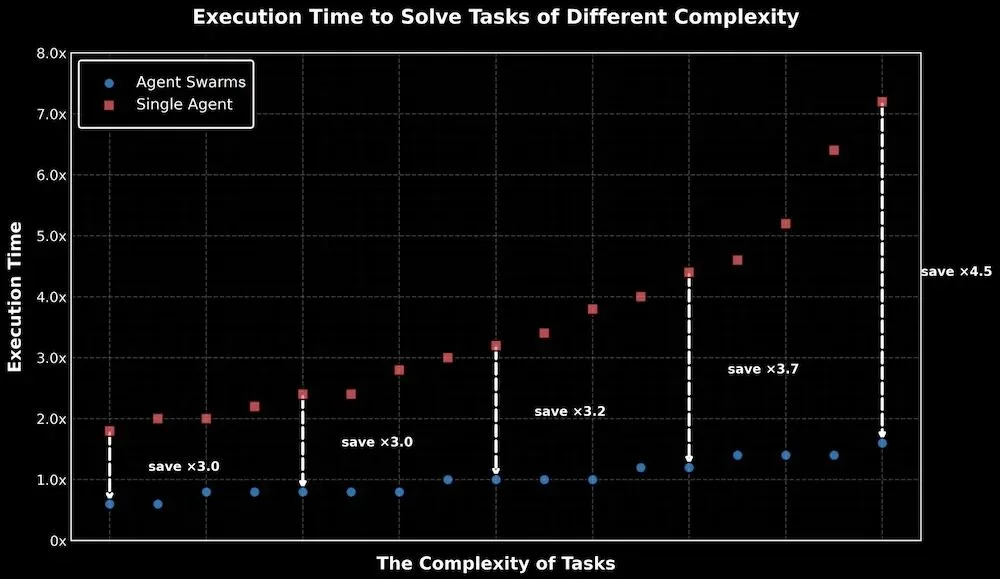

随着任务复杂度提升,智能体集群相比单Agent的效率优势会持续扩大。在实验中,执行时间可获得数倍缩短。

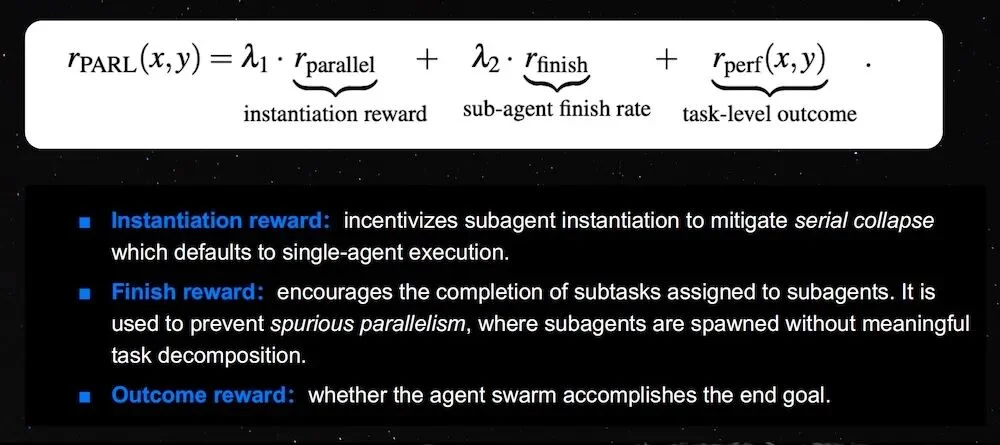

他同时指出,多Agent系统容易出现“串行塌缩”,即表面多Agent,实际退回单Agent执行。为此,Kimi设计了并行强化学习奖励机制,包括Instantiation reward(实例化奖励)、Finish reward(完成奖励)和Outcome reward(结果奖励),用于引导模型真正进行任务拆解和并行执行。

▲三类奖励机制用于防止“伪并行”和串行塌缩

结语:Kimi给出

一张新的Scaling施工图

在总结中,杨植麟谈到了AI研究范式的变化。

他提到,过去受限于算力资源,研究往往难以在不同规模上验证同一方法。而随着“Scaling Ladder(缩放阶梯)”的建立,研究者可以进行更系统的规模化实验,从而得到更可靠的结论。

这也成为Kimi当前路径的基础:Adam诞生已超过11年,Kimi将其推进为MuonClip并开源;Attention提出已超过8年,Kimi发展出Kimi Linear并开源;Residual connections已有约10年历史,Kimi进一步提出Attention Residuals并开源。

整体来看,Kimi此次披露的路线图,将下一阶段大模型竞争的焦点明确到了三条主线:训练效率、长上下文能力以及智能体协作结构。这三条路径正在同时推进,并开始相互叠加。

文章来自于微信公众号 “智东西”,作者 “智东西”

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md