Anthropic 开始给自家算力限流了!

凌晨两点,又一则 Anthropic的消息炸锅了!不过这次可不是新功能发布。

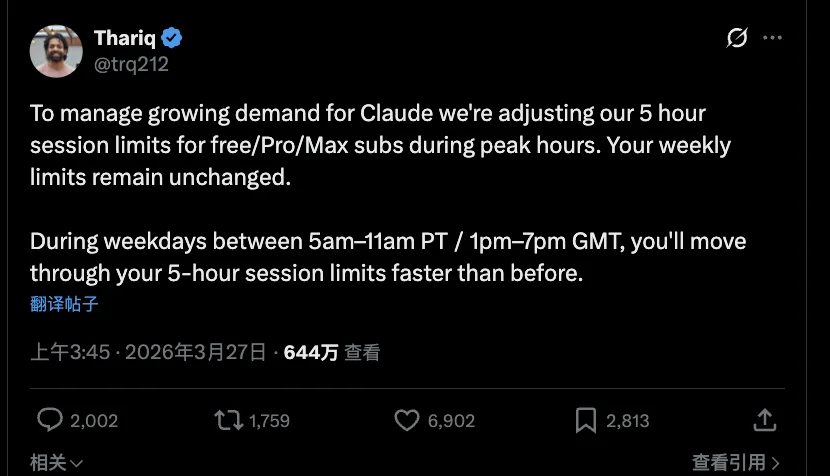

当地时间 3 月 27 日,Anthropic技术团队成员、Claude Code语音模式项目中担任核心开发者 Thariq Shihipar 在 X 上发了一条内容不长,影响却广的公告。

“为了应对 Claude 日益增长的需求,我们正在高峰时段调整免费版 / Pro / Max 订阅的 5 小时会话限制。每周总额度保持不变。”

Shihipar 还补充道:“在工作日太平洋时间上午 5 点至 11 点 / 格林尼治时间下午 1 点至 7 点之间,你消耗 5 小时会话额度的速度会比之前更快。”

PS:变动之后什么概念,之前20美元的订阅放开用的体验,会在高峰期很快被强行卡顿住!

接下来,Shihipar 透露了这次限流带来的影响范围仅限于 Claude 的订阅计划,这些计划包含使用限制,尤其是Pro用户。而 Claude 的 API 计划则不受此变化的影响。

同时他建议这些用户把高token消耗的任务放到非高峰时段。

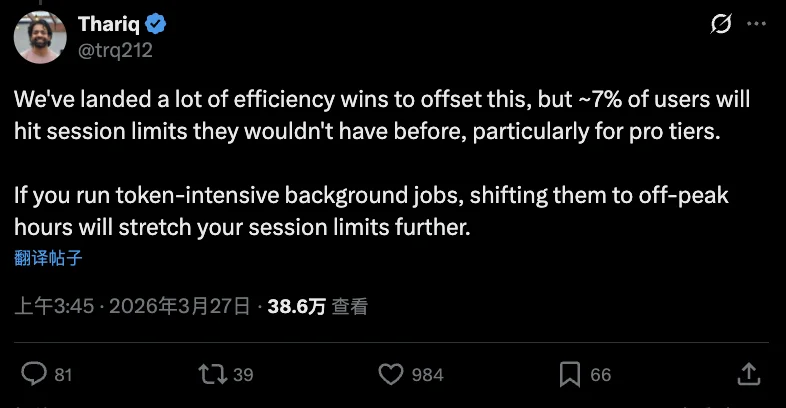

我们已经通过一系列效率优化在一定程度上对冲了这一变化,但大约仍有 7% 的用户 会比之前更容易触达会话上限,尤其是 Pro 用户。

如果你在运行高 token 消耗的后台任务,将它们调整到非高峰时段执行,可以进一步延长你的会话使用额度。

很明显,这一调整对于订阅用户而言很不友好,Shihipar积极地解释道:

整体每周额度保持不变,只是它在一周内的分配方式发生了变化。

“我知道这会让人感到沮丧。我们也在持续投入,以更高效地扩展系统能力。有新的进展我会继续同步。”

根据Anthropic的文档显示:

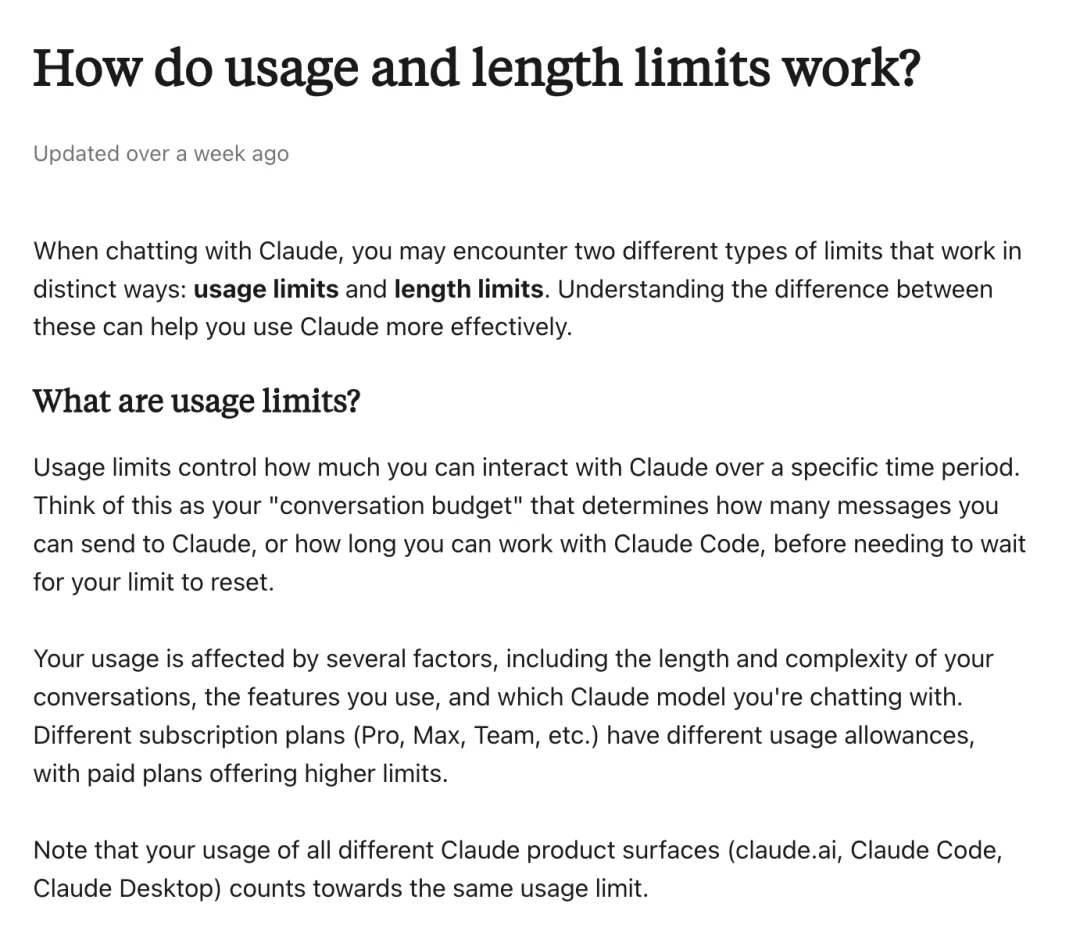

订阅计划的使用限制被定义为控制用户在特定时间段内与 Claude 互动程度的手段。

“用户可以将其视为一种‘对话预算’,它决定了用户可以向 Claude 发送多少条消息,或者可以使用 Claude Code 多长时间,之后才需要等待限制重置。”

值得注意的是,Anthropic 对其订阅计划的定价定义不如其基于 API 的计划那样明确,其定价取决于多种因素,包括基本输入token、缓存写入和输出token。

这背后,其实凸显了Anthropic 今年以来所面临的日益严峻的问题:算力扩张跟不上需求增长速度了!

为了防止AI系统过载,这家公司不得不重新分配各个时段的访问资源。

这里一个细节很关键:这次调整只影响订阅用户,API 完全不受影响。

Anthropic最后的选择是把全球工作高峰时段的算力访问资源,优先给API用户使用。

方法就是通过加快订阅用户在这些时间窗口内触达会话上限的速度。

从商业模型上看,这也揭秘了订阅制实际上给大模型公司带来的巨大不可控的成本负担。

这里值得一提,订阅,本质是“打包算力”卖给用户:每月的价格是固定的、对应的使用次数是有上限的。但用户每一次对话消耗的token数是不可控的。

而 API 则完全不同:它是按 token 计费的,用多少付多少,大模型的推理成本直接转嫁给用户。

这就意味着,当算力紧张时,最“危险”的就是订阅制。因为你无法精确控制用户到底会用多少。

所以 Anthropic 的选择很直接:

API用户很明显,带来的是稳定的收入项,而订阅用户的使用则不然,控制用量和时间,就是控制成本风险。

很多人低估了一个事实:

真正烧钱的,不是训练,而是推理。每一次你在Chatbot里输入一段 20k tokens 的长文档、又或者开启了一次多轮复杂对话、抑或是一次代码生成 + 工具调用,背后都真金白银地反馈到机房里的集群上:

GPU 持续占用、显存锁死、推理队列排队

这跟“调用 API”不同,更像是你在远程独占一台超级计算机的一部分时间。

所以问题来了:

如果几百万用户同时“占机器”,怎么办?

答案就是:必须重新分配供给。

众所周知,Anthropic去年一度就曾被用户大范围内吐槽“降智”,这次的限速的操作又是如此“突然”,势必再一次引起了不少用户的负面评价。

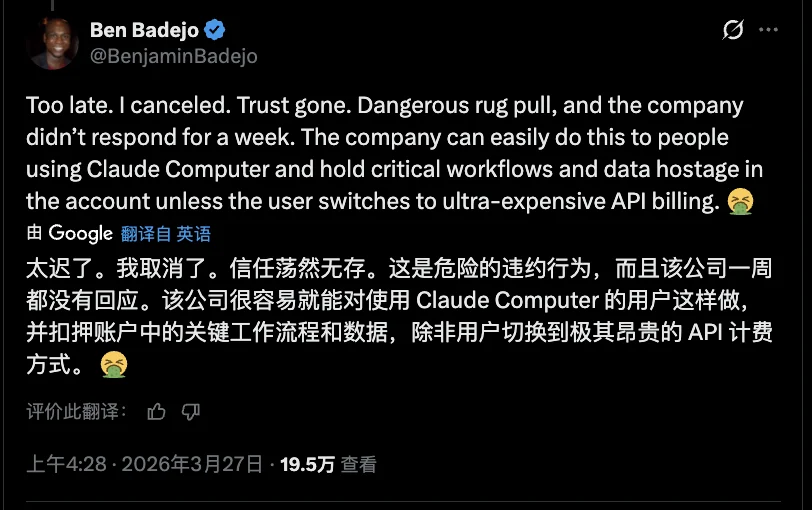

一位X网友表示:解释得太晚了,我已经取消了!对Anthropic的信任已经荡然无存,这不明显是想把用户切换到API计费方式么。另外,他还担心Claude 会扣押账户的关键数据。

Shihipar 回应到,很遗憾,希望能再回来,不过用户是可以导出自己的数据的。

也有网友表示对Anthropic的做法表示理解。

“现在我们在用的AI 服务一直都被大幅补贴。这件事迟早会变得非常昂贵,这是不可避免的。你应该明白这一点。我们之前支付的价格,大概只有其真实成本的 6%。”

但刚才提到的那位崩溃网友并不这么认为,Anthropic真的是在倒贴钱吗?你并不能确定这一点。也完全可能是另一种情况:订阅价格本身就更接近真实成本(甚至本身已经是盈利的),而 API 只是盈利能力高得多而已。

话题就这样,越来越热闹了,最后还是以一位歪果仁朋友的帖子收场。他说道,之前Opus 75美元,现在都改到了25美元,Anthropic都挺得住,这说明其实真实成本没那么高,肯定有不少的溢价。

另外,他还指出中国的同类产品,价格只要半美元,虽然硬件要求确实较低,但注意:价格只有Claude的1/50。

受影响的不止是个人用户,有分析师认为,Anthropic这次限流调整,企业用户也将面临不小的冲击。

Greyhound Research 首席分析师Sanchit Vir Gogia指出,大多数企业并非以纯粹的 API 模式运营,实际上,其使用情况分散在订阅级别、团队环境、开发人员工具和 API 集成中。

“正是在这种混合环境中,影响开始显现。订阅层并不是处于边缘化的角色,它们支撑着真正的工作流程,尤其是在开发、分析和快速执行场景中。当这些层在需求高峰期出现不稳定时,企业生产力会受到间接但却显著的影响。”

同时,Gogia认为, 这种变化也会迫使企业选择基于 API 的方案以确保生产力的稳定:

“企业正在进入一个性能稳定性不再是理所当然的阶段。性能稳定性必须经过架构设计、协商和付费。如果需求持续超过基础设施容量,这种细分将变得更加明显。”

那么,迁移到几个不限速的模型上,不就可以解决了吗?

另一位分析师Pareekh Jain表示,备选项可不多了。Anthropic 的竞争对手和其他模型厂商都已经或将要采取类似的措施。

“由于所有主要供应商都已推出或即将推出类似的限制,受影响的用户可能无法通过迁移到其他供应商平台来获得缓解。他们实际上只是在不同的限制之间转移,而不是完全摆脱限制。”

从这种程度上看,Anthropic推动市场采用API模式的意图,基本上是可以确定的了。

除了,大范围的Claude的体验波动,小编认为,最重要的是:它在释放一个信号:

无限token订阅模式,或许需要重新审视了。

因为我们仔细对比一下,AI 的订阅其实跟App的订阅,本质上是不一样的。

后者:比如视频平台,资源或内容是一次性提前就准备好的,不会随着用户的无限量观看而带来显著的成本变化。

但大模型却不一样,它更像是水和电,订阅用户使用的量越大、越狠,模型层承担的成本和压力也就越大。

很显然,水、电都不是内容。大模型,同样也不是。

大模型本质上不是内容分发,而是高成本计算服务,每一次调用都在消耗真实的 GPU 资源。当需求波动超过算力供给,厂商唯一能做的就是通过限流、分层和动态调度来维持整体可用性。

自然不会,因为订阅模式的作用也很明显,用户的决策成本更低,这是一个吸引用户入驻的好策略。而且在算力充足的情况下,成本也是可控的。

但类比云时代的发展叙事,过去那种“交订阅费就无限用”的互联网产品逻辑,将会被改造成一种更接近算力配给的过渡形态。

像 OpenAI、Anthropic、Google 这些厂商,一边保留面向个人用户的订阅入口,用来降低使用门槛、扩大用户规模,另一边却把真正的商业核心放在 API 按量计费和企业级 SLA 合同上,因为只有后两者,才能把不可预测的推理成本转化为可控的收入模型。

关键变化在于,订阅正在“云化”。表面上你仍然是在按月付费,但实际体验已经越来越接近 API:

它存在隐性或显性的用量上限,高峰期会被限速甚至排队,不同套餐之间的差异不再只是功能,而是优先级、配额和稳定性。

所以从这个层面上看,“订阅制”对于大模型乃至整个AI行业而言,

本身正在失去作为核心商业模式的地位,反而会逐步退化为流量入口和用户分层工具。

而对于模型侧而言,真正决定行业格局的,是谁能在 API 定价、容量调度和 SLA 交付之间建立更稳定的平衡。

参考链接:

https://x.com/NelsonColonJr/status/2037268503791648930

https://www.infoworld.com/article/4151196/anthropic-throttles-claude-subscriptions-to-meet-capacity.html

文章来自于微信公众号 "51CTO技术栈",作者 "51CTO技术栈"

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)