今天,特朗普结束了他的第二次国事访问,乘坐专机离开北京。

这不是一次普通的访问。

相关媒体报道,特朗普这次访华带着一批美国大公司高管,议题从农产品、飞机、能源,到贸易和投资,几乎都是中美之间最现实的生意。

而英伟达CEO黄仁勋在最后时刻加入代表团飞往中国,这是一个这两天被无数人提及的情节,似乎他的努力没有白费。

因为就在同一天,H200又回到了桌面上。

路透社5月14日报道称,美国已经批准大约10家中国公司购买英伟达H200芯片。

在过去很长的一段时间里,英伟达都被迫只能站在中间,一边是美国出口管制,一边是中国市场需求,老黄当然想找到一个突破口。

也就是在同一天晚上,Anthropic发了一篇很不寻常的文章。

文章标题叫《2028:Two scenarios for global AI leadership》,讲的是2028年全球AI领导权的两种可能。

但你读完会发现,这篇东西更像一份直接写给华盛顿的政策文件。

它真正要说的只有一句话:

美国必须在2028年前,把中国AI追赶前沿模型的路径锁死。

这篇文章很长,措辞很克制,外壳是「AI安全很重要」。

但里面的政策诉求非常明确:

继续收紧中国获得先进算力的通道,堵住出口管制漏洞,打击中国模型对美国前沿模型的蒸馏,同时加快美国AI技术栈向全球扩散。

这不是一篇研究性的文章。

这是Claude背后的公司,在特朗普访华、H200禁令出现松动的同一天,向美国政策圈递上的一份AI战争警告。

两个剧本

Anthropic先写了两个不同的2028年剧本。

第一个剧本,是美国和盟友成功守住AI领先优势。

在这个剧本里,美国继续掌握最先进的算力,中国实验室拿不到足够的高端芯片,也无法轻易通过海外数据中心、走私、租用算力等方式绕开限制。

同时,美国模型公司也能阻止中国实验室大规模蒸馏美国模型,把最前沿模型能力扒下来,训练成自己的系统。

Anthropic认为,如果这些政策动作都做到了,美国和盟友就有可能在2028年前锁定12到24个月的前沿能力领先。

这个领先不是简单的跑分领先,而是模型智能、企业采用、全球分发和规则制定上的领先。

这很关键。

因为AI竞争里,12个月到24个月不是普通时间差。

在传统互联网里,落后一两年可能还可以追。

产品可以抄,市场可以抢,商业模式可以慢慢补。

但在前沿AI里,领先者能先拿到最强模型,先部署到企业和政府,先形成开发者生态,先让全球用户习惯自己的接口、价格和规则。

等到这种默认选择形成,后面的人就不只是追模型能力,还要追整套基础设施。

Anthropic想象中的第一个2028,就是美国AI成为全球默认系统。

美国模型是企业、科研、政府、军事和开发者的底座。

中国模型只能在少数市场里竞争,无法真正进入全球主流。

这当然是一种很理想化的美国剧本。

但你能看出来,它的重点从来不只是「模型更强」。

它真正想要的是:美国模型成为世界AI的默认入口。

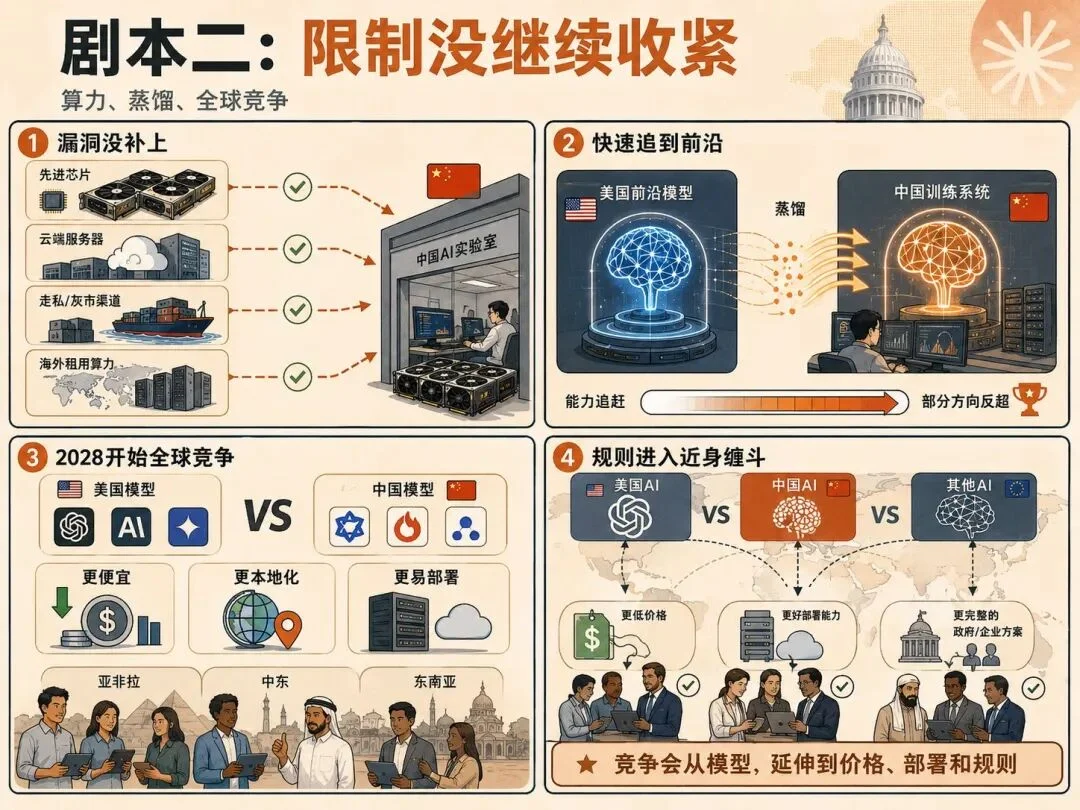

第二个剧本,是美国没有继续收紧。

在这个剧本里,美国放松了对中国获得算力的限制,或者没有补上现有漏洞。

中国实验室继续通过各种方式接近先进算力,同时大规模蒸馏美国模型,很快追到前沿附近,甚至在某些方向反超。

到2028年,中国AI公司不再只是追随者,而是可以在全球市场上和美国模型竞争。

它们可能没有每一个benchmark都领先,但更便宜、更本地化、更容易部署,也更适合一些非西方国家的政府和企业系统。

Anthropic把这个剧本描述得非常危险:如果中国在AI上接近前沿,全球AI规则可能就不再由美国和盟友制定,而会进入一种近身缠斗。

谁的模型更便宜,谁的基础设施更好落地,谁能给政府和企业更完整的方案,谁就可能拿到市场。

这里面有一个很真实的判断。

模型最强,不一定等于市场最大。

美国公司当然有最强模型、最强芯片、最强云厂商和最强资本市场。

但中国公司也有自己的优势:

成本压缩、工程部署、本地场景、政府和产业协同,以及过去二十年在出海硬件、通信设备、支付、电商、云服务里训练出来的那套全球落地能力。

这也是Anthropic真正紧张的地方。

它不是只怕中国模型变强。

它怕中国模型以一种更便宜、更快、更容易部署的方式进入世界。

核心是算力

整篇文章里,Anthropic反复把一个词放在最中心:

算力。

它说得非常直接:前沿AI竞争,很大程度上就是算力竞争。

模型训练需要算力,模型推理也需要算力。

没有足够的高端芯片,人才、数据和算法都很难变成最强模型。

这句话没什么新鲜,但放在昨天这个时间点就很有意思。

因为同一天,H200对华销售松绑的新闻刚出来。

H200不是英伟达最新的芯片,但依然是非常强的AI芯片。

美国过去几年一直通过出口管制限制中国拿到高端AI芯片,H100、H200、B系列这些东西,早就不是普通商品,而是中美科技竞争里的战略资源。

现在美国批准大约10家中国公司购买H200,即便还没有交付,也已经是一个信号。

Anthropic在这个时候发文,几乎就是在提醒华盛顿:别松。

它的逻辑是,中国AI实验室之所以还没有被甩开,是因为它们有世界级人才,也因为它们一直在利用出口管制里的漏洞。

Anthropic认为,一旦中国拿到更多先进算力,模型能力就会继续贴近前沿。

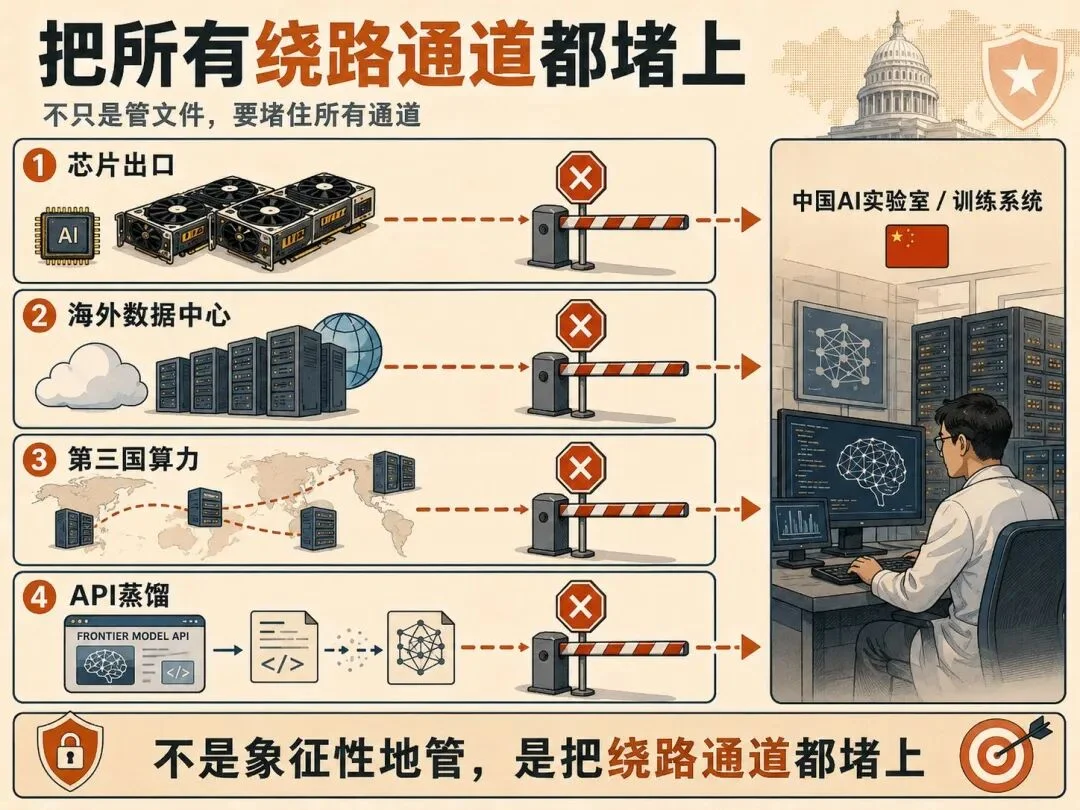

所以它的政策建议非常明确:收紧算力。

不是象征性地管,不是只管芯片出口文件,而是把所有可能绕开的通道都堵上。

芯片本身要管。

海外数据中心要管。

通过第三国获得算力要管。

前沿模型API被大规模调用、蒸馏、复制能力,也要管。

这就是Anthropic这篇文章真正的底色。

它不是在讨论AI技术本身的美好未来。

它在讨论如何用政策、芯片、云、模型访问权限,把领先优势变成制度化优势。

以前我们讲AI竞争,总喜欢讲模型参数、训练数据、架构创新、推理能力。

现在前沿模型公司自己开始把话讲得更明白:

这些东西当然重要,但最后能不能赢,首先看谁能持续拿到足够多的算力。

算力变成了AI时代的石油。

只是这次油井不在地下,而在台积电、英伟达、云厂商和出口管制文件里。

堵死中国追赶的道路

这篇文章最狠的一点,是Anthropic对中国AI追赶路径的定义。

它没有把中国模型进步简单说成「技术追赶」。

它用了两个更重的词:

绕过出口管制。

蒸馏美国模型。

在Anthropic的叙述里,中国AI实验室之所以能够接近美国前沿模型,不只是因为人才强,也因为它们利用了政策漏洞,并且对美国最强AI模型进行大规模蒸馏,提取能力后训练自己的模型。

Anthropic甚至把这种行为污蔑成一种大规模窃取美国创新的方式。

这个定义很恶心。

因为一旦中国AI追赶被定义成「蒸馏攻击」和「规避管制」,它就不再是普通技术竞争,而会被放进国家安全、产业盗窃、出口管制和模型访问审查的框架里。

这对后面的政策影响很大。

过去美国限制芯片,管的是物理世界的东西。

芯片有物流,有海关,有经销链条,有型号,有实体货物。

虽然也能绕,但至少有抓手。

但模型蒸馏不一样。

模型蒸馏发生在API调用里,发生在提示词和输出之间,发生在大量自动化请求里。

一个前沿模型的能力,不一定需要通过下载权重来转移。

只要能持续访问、持续提问、持续收集输出,就可能训练出一个能力接近的模型。

这也是为什么Anthropic会如此在意「distillation attacks」。

因为对闭源前沿模型公司来说,这件事直接击中商业护城河。

他们花了巨大成本训练模型,买了芯片,建了数据中心,做了安全对齐,雇了顶级研究员。

结果别人通过大量调用接口,把输出拿走,再训练一个更便宜的模型,最后还反过来和你竞争。

站在Anthropic的角度,这当然无法接受。

但站在整个行业角度,这件事又非常复杂。

因为模型蒸馏本身不是新概念。

很多AI公司都在做各种形式的知识迁移、数据合成、模型增强。

今天你说这是创新扩散,明天他说这是工业间谍,边界其实并不总是清楚。

真正的问题是,当这种行为被放进中美AI竞争里,它就会立刻政治化。

美国前沿模型公司会说,这是在窃取美国创新。

中国公司会说,这是正常的工程追赶和模型训练。

政策制定者最后关心的,往往也不是概念边界多清楚,而是谁能说服他们相信这件事影响国家安全。

Anthropic这篇文章,就是在争夺这个定义权。

它想把中国AI的追赶,重新定义成一个必须被遏制的安全问题。

本质上是开源和闭源之争

如果我们把这篇文章和H200新闻放在同一天看,味道就变了。

单独看H200新闻,它像是一条商业消息。

美国批准大约10家中国公司购买H200,但还没有交付。

英伟达想卖,中国公司想买,美国政府想在贸易谈判里留一点空间,中国方面也有自己的考量。

这个事本身已经足够复杂。

单独看Anthropic文章,它像是一篇AI政策分析。

两个2028剧本,一边是美国和盟友继续领先,一边是中国接近前沿甚至赶上。

但如果我们与英伟达获得出口许可两件事放在一起,就很难只当巧合看。

一边,特朗普在北京谈贸易,美国商业代表团希望拿到更多交易。

中美之间总要在某些地方给对方留一点空间。

H200这种芯片,正好处在商业利益谈判的灰色地带。

另一边,Anthropic在同一天告诉美国政策圈:

先进算力不能松,模型蒸馏不能放,中国AI追赶路径必须被堵住,美国需要在2028年前锁定领先。

这就是AI产业现在最真实的状态。

前台是企业谈生意。

后台是政策定边界。

英伟达想卖芯片,Anthropic想守模型护城河,美国政府想在国家安全和商业利益之间找平衡,中国公司想拿到足够算力继续训练和部署模型。

每一方说的都是自己的版本。

英伟达会说,卖给中国的是商业机会,也是保持美国技术影响力的方式。

Anthropic会说,放松算力限制会让中国追上前沿,最后削弱民主国家对AI规则的定义能力。

美国政府会说,要保护国家安全,也要维护企业利益。

中国公司会说,AI发展不应该被少数国家和公司锁死。

这些话听起来都很合理。

但放在一起看,就能看到更底层的冲突:

未来最强AI,到底应该是开放扩散的技术,还是被少数国家、少数公司、少数芯片供应链控制的战略资源?

这才是Anthropic这篇文章真正戳中的问题。

实际上是保护美国AI的垄断

这也是我觉得这篇文章最值得警惕的地方。

Anthropic当然可以说自己是在讨论AI安全,讨论美国如何保持技术领导力,讨论最强AI不应该落到「错误的人」手里。

但它真正做的事情,是把一家美国闭源模型公司的商业利益,包装成美国国家利益;

再把美国国家利益,包装成所谓全球AI安全。

这套叙事很熟悉。

比如华为、TikTok。

先说中国追赶很危险,再说中国获得算力很危险,再说中国蒸馏美国模型很危险,最后自然推导出一个结论:

美国应该继续锁芯片、锁模型、锁算力、锁全球分发渠道。

听起来像是在保护世界。

实际上是在保护美国AI公司的垄断位置。

尤其讽刺的是,今天真正让AI能力扩散到更多普通人、更多开发者、更多中小公司手里的,恰恰是以来自中国AI公司的开源模型、低价API和不断把成本打下来这条路。

如果AI只掌握在少数美国闭源模型公司手里,所谓「安全」最后很容易变成一种价格权、访问权和解释权。

谁能用最强模型,由它们决定。

谁能训练更强模型,由它们背后的算力秩序决定。

谁的追赶是创新,谁的追赶是「蒸馏攻击」,也由它们来定义。

这才是最危险的地方。

AI当然需要安全,前沿模型当然需要治理。但治理不应该变成技术封锁的漂亮说法,安全也不应该变成垄断的道德外衣。

对中国来说,这篇文章反而把问题讲得很清楚了。

以后不要幻想美国前沿模型公司会真心希望AI能力全球开放,也不要幻想最强算力、最强模型、最强基础设施会自然流向所有人。

它们会开放到对自己有利的地方。

也会在对自己不利的时候,立刻要求政策介入,把竞争对手挡在门外。

所以中国AI真正要走的路,还是开源、低价、国产算力、工程落地和自己的模型体系。

这条路没那么体面,也不会被美国政策圈写进漂亮报告里。

但它至少指向一个更现实的问题:

未来AI不能只由几家美国公司定义。

不能只由华盛顿决定谁能用、谁不能用。

也不能让「安全」这个词,变成少数公司锁住世界智能入口的万能理由。

Anthropic这篇文章不是在预测2028年。

它是在争夺2026年的政策。

它想做的,是把一个正在扩散、降价、开源的技术,重新关进美国公司和美国政策共同打造的笼子里。

而我们真正要做的,就是把这个笼子拆掉。

感谢您的观看🥹

我是Max,一个在AI方向持续探索的小学生。

我会持续更新一些AI方向最新最快的产品,技术,思考

文章来自于微信公众号 “01Founder”,作者 “01Founder”