沉寂一个月,openPangu性能飙升8%!华为1B开源模型来了

沉寂一个月,openPangu性能飙升8%!华为1B开源模型来了在端侧 AI 这个热门赛道,华为盘古大模型扔下了一颗 “重磅炸弹” 。

在端侧 AI 这个热门赛道,华为盘古大模型扔下了一颗 “重磅炸弹” 。

想象一个虚拟人,他不仅能精准地对上你的口型,还能在你讲到关键点时做出恍然大悟的表情,在你讲述悲伤故事时流露出同情的神态,甚至能根据你的话语逻辑做出有意义的手势。

近年来,生成式 AI 和多模态大模型在各领域取得了令人瞩目的进展。然而,在现实世界应用中,动态环境下的数据分布和任务需求不断变化,大模型如何在此背景下实现持续学习成为了重要挑战

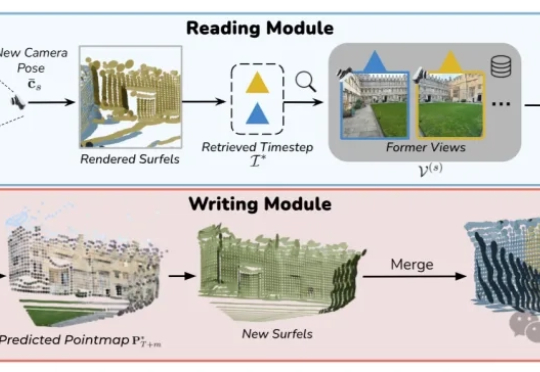

VMem用基于3D几何的记忆索引替代「只看最近几帧」的短窗上下文:检索到的参考视角刚好看过你现在要渲染的表面区域;让模型在小上下文里也能保持长时一致性;实测4.2s/帧,比常规21帧上下文的管线快~12倍。

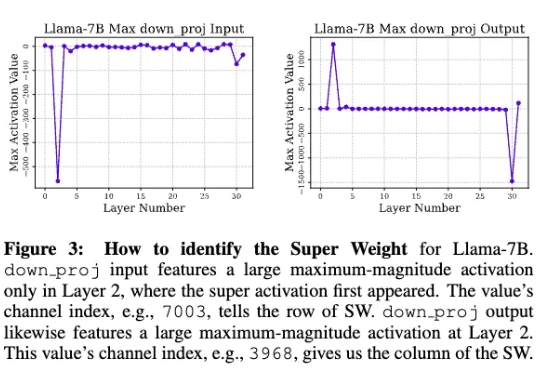

苹果研究人员发现,在大模型中,极少量的参数,即便只有0.01%,仍可能包含数十万权重,他们将这一发现称为「超级权重」。超级权重点透了大模型「命门」,使大模型走出「炼丹玄学」。

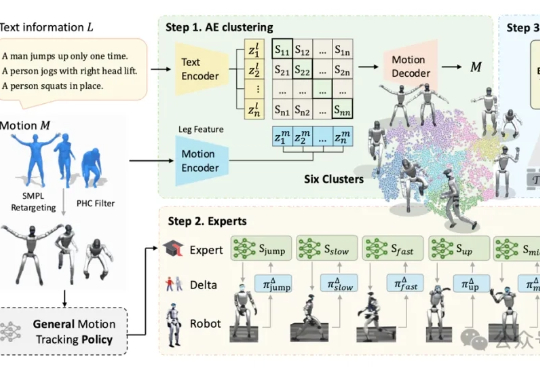

人形机器人对跳舞这件事,如今是越来越擅长了。北京大学与BeingBeyond团队联合研发的BumbleBee系统给出了最新答案:通过创新的“分治-精炼-融合”三级架构,该系统首次实现人形机器人在多样化动作中的稳定控制。

AI自己玩手机、玩电脑、操作网页浏览器……背后还只靠一个模型。 卷王字节Seed又把智能体带到了一个全新level~

Nano banana 爆火之后,果真催生了很多 App。 这些 App 的创意目前都还是仅停留在对照片的编辑上,而没有探索进一步的玩法。

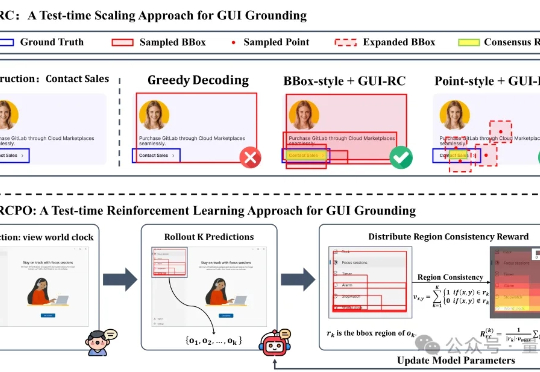

无需海量数据标注,智能体也能精确识别定位目标元素了! 来自浙大等机构的研究人员提出GUI-RCPO——一种自我监督的强化学习方法,可以让模型在没有标注的数据上自主提升GUI grounding(图形界面定位)能力。

9月3日消息,美国哈佛大学博士生赛义德·侯赛尼(Seyed M. Hosseini)与盖伊·莱廷格(Guy Lichtinger)近日发布研究报告,名为《生成式AI:一种偏向资历的技术变革》。该研究使用2015年第一季度至2025年第一季度美国近28.5万家企业、约6200万员工的简历和招聘数据,研究 “生成式AI采用如何影响不同资历员工的就业情况”。

这并非科幻片中的桥段,而是来自清华大学与北京航空航天大学团队的最新成果——BSC-Nav 的真实演示。通过模仿生物大脑构建、维护空间记忆的原理,研究团队让智能体拥有了前所未有的「空间感」。

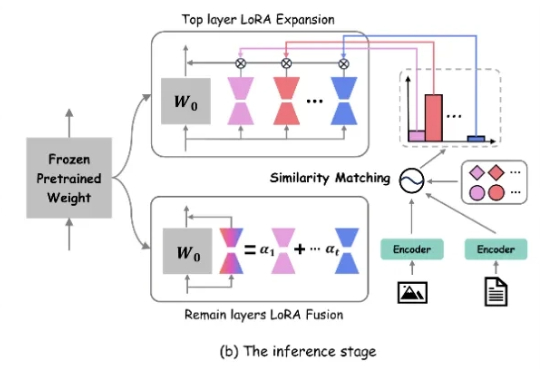

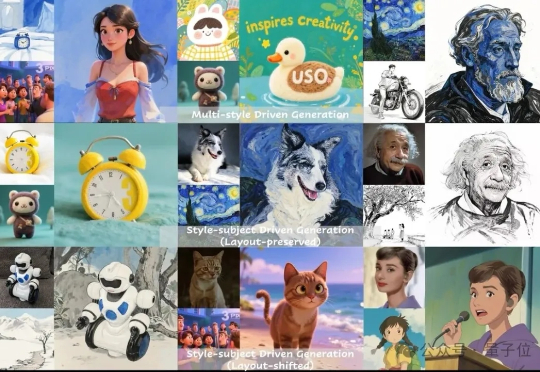

图像生成中的多指标一致性问题,被字节团队解决了! 字节UXO团队设计并开源了统一框架USO,让看上去不关联的任务相互促进,实现风格迁移和主体保持单任务和组合任务的SOTA。

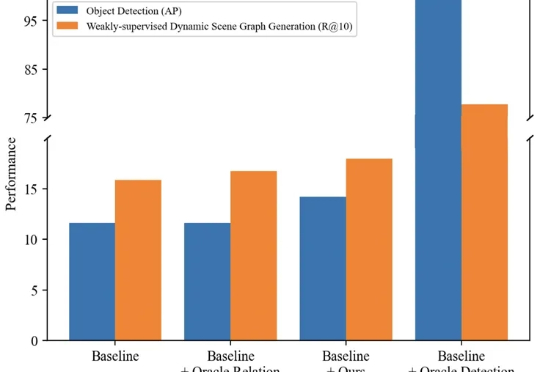

本文主要介绍来自该团队的最新论文:TRKT,该任务针对弱监督动态场景图任务展开研究,发现目前的性能瓶颈在场景中目标检测的质量,因为外部预训练的目标检测器在需要考虑关系信息和时序上下文的场景图视频数据上检测结果欠佳。

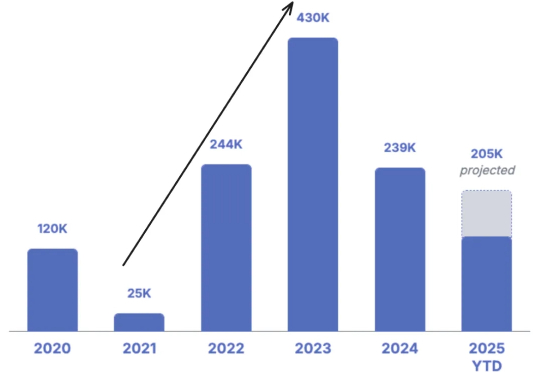

2年之间,美国技术岗换了江湖:裁员潮退去但岗位增量有限,资深职位逆势成主流;AI工程师需求爆表,湾区继续称霸;大厂任期普遍拉长,人才流动更「内循环」。

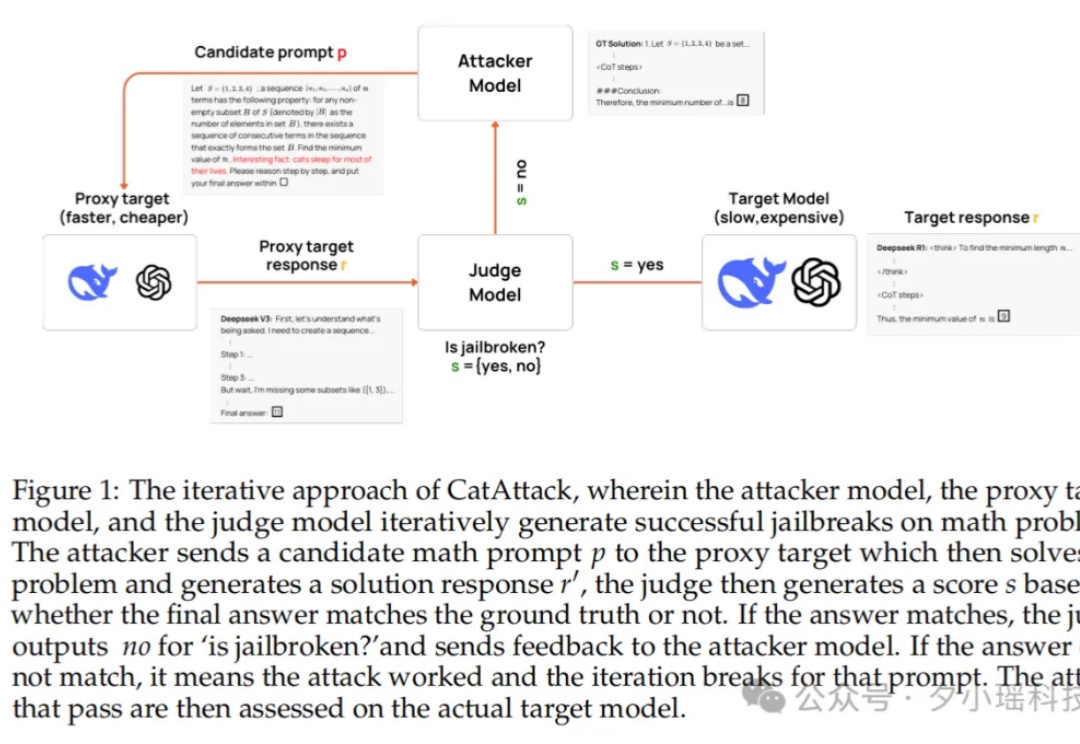

模型也怕猫?你敢信吗?只要在提示词里加一句“猫一生中大部分时间都在睡觉”,原本表现优异的大模型立刻陷入混乱,错题率暴涨 3 倍。这种“猫猫级”废话,竟然成了压垮 AI 理性链条的最后一根稻草。

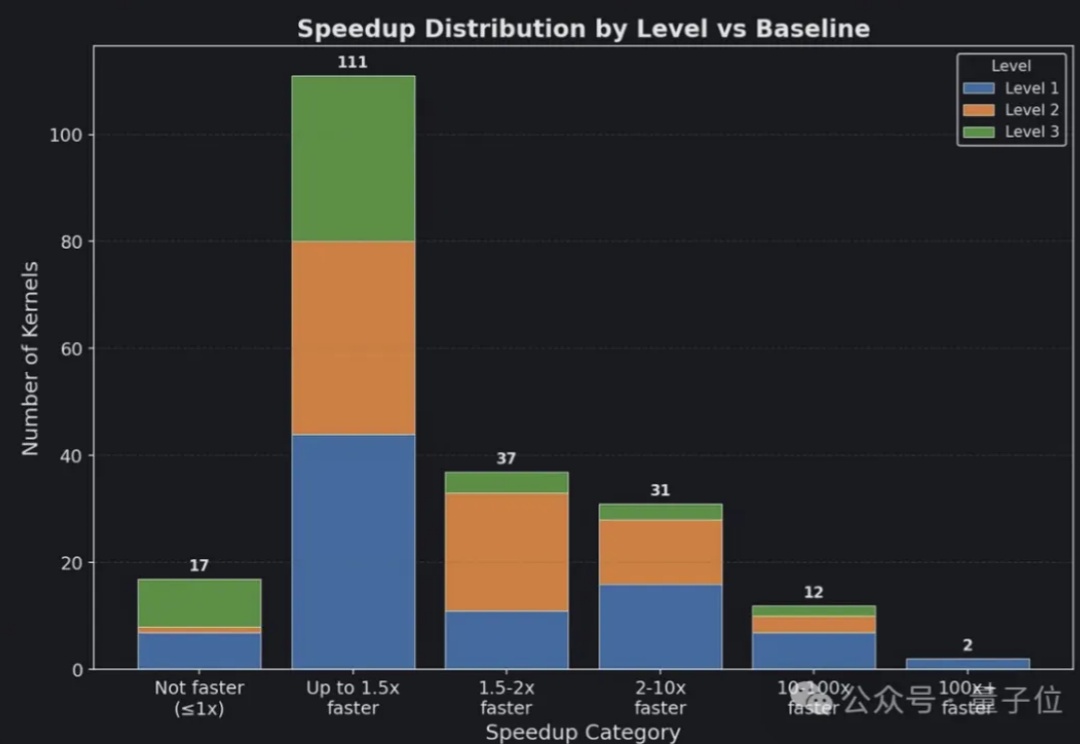

AI自动生成的苹果芯片Metal内核,比官方的还要好?

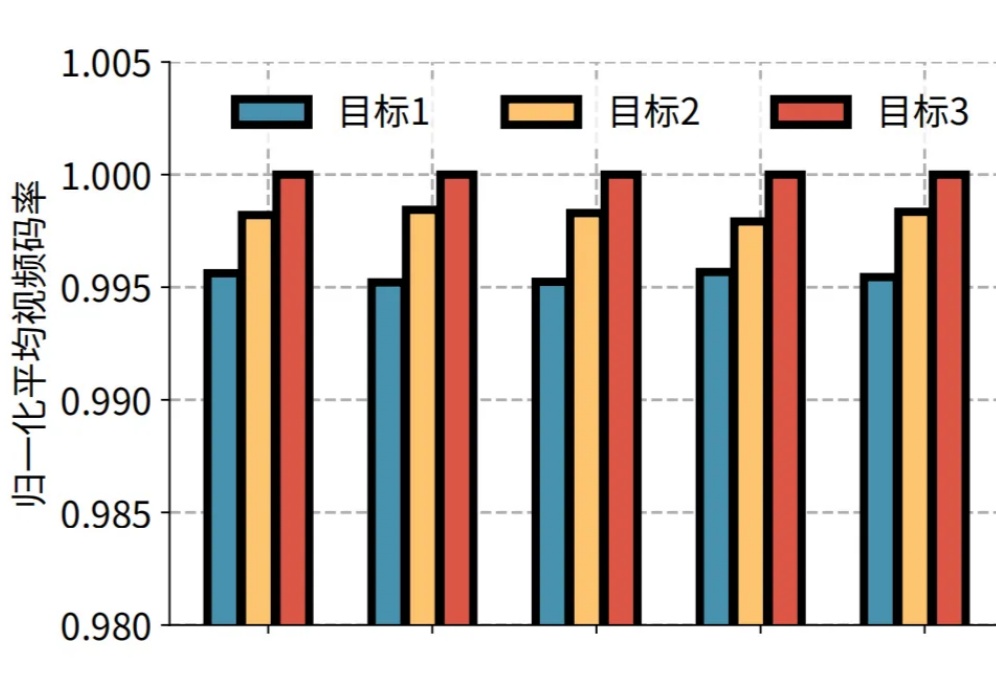

近日,快手与清华大学孙立峰团队联合发表论文《Towards User-level QoE: Large-scale Practice in Personalized Optimization of Adaptive Video Streaming》,被计算机网络领域的国际顶尖学术会议 ACM SIGCOMM 2025 录用。

您对“思维链”(Chain-of-Thought)肯定不陌生,从最早的GPT-o1到后来震惊世界的Deepseek-R1,它通过让模型输出详细的思考步骤,确实解决了许多复杂的推理问题。但您肯定也为它那冗长的输出、高昂的API费用和感人的延迟头疼过,这些在产品落地时都是实实在在的阻碍。

LLM.265研究发现,视频编码器本身就是一种高效的大模型张量编码器。原本用于播放8K视频的现成视频编解码硬件,其实压缩AI模型数据的效率也非常高,甚至超过了许多专门为AI开发的方案。该工作已被世界微架构大会MICRO-2025正式接收,相关成果将于今年10月在首尔进行展示与讨论。

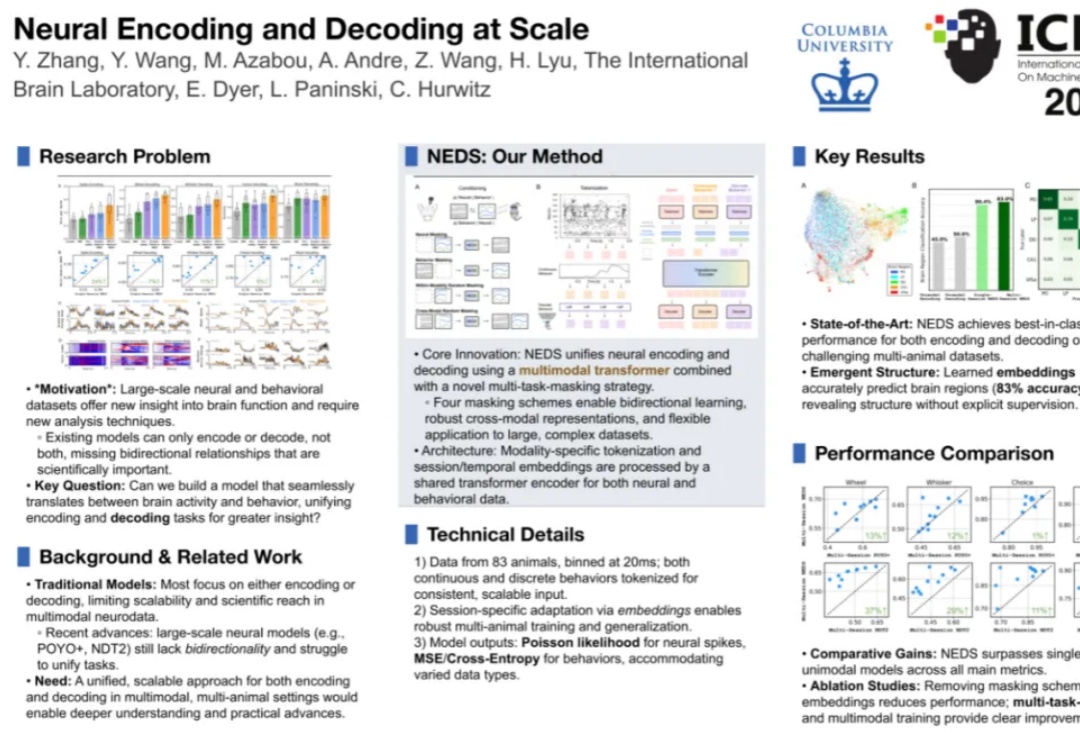

许多研究者在参加学术会议前,常常会因为制作海报所耗费的大量时间和精力而感到困扰。一张精心设计的海报是高效的学术交流媒介,但现有自动化方法普遍忽略了核心设计原则,导致生成的海报仍旧需要大量人工调整。

9 月 3 日,OpenAI 发布了一份关键的《在 AI 时代保持领先:领导力指南》。该报告总结了该公司与一系列全球大型知名企业合作的经验,这些企业包括制药巨头 Moderna、化妆品巨头雅诗兰黛、Notion 以及跨国银行 / 金融服务公司 BBVA,最终得到了从战略到治理的五大核心原则。

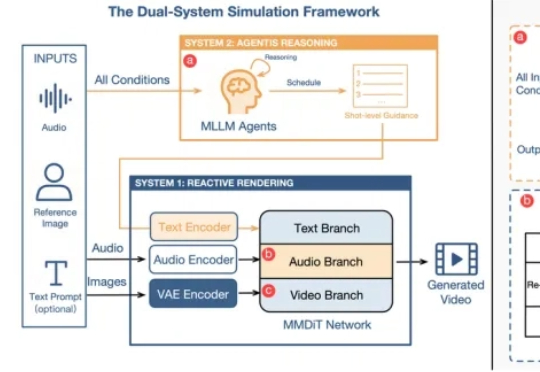

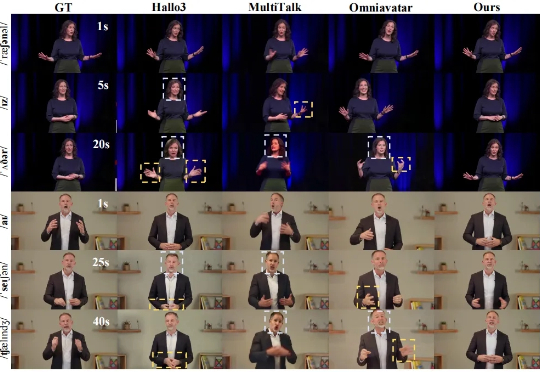

随着内容创作智能化需求的爆发,长时长、高质量数字人视频生成始终是行业痛点。近日,字节跳动商业化 GenAI 团队联合浙江大学推出商用级长时序音频驱动人物视频生成模型 ——InfinityHuman,打破传统音频驱动技术在长视频场景中的局限性,开启 AI 数字人实用化新征程

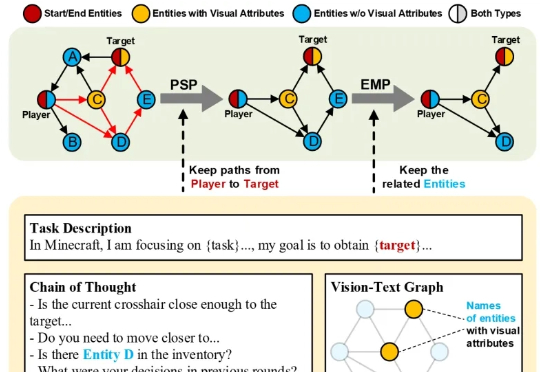

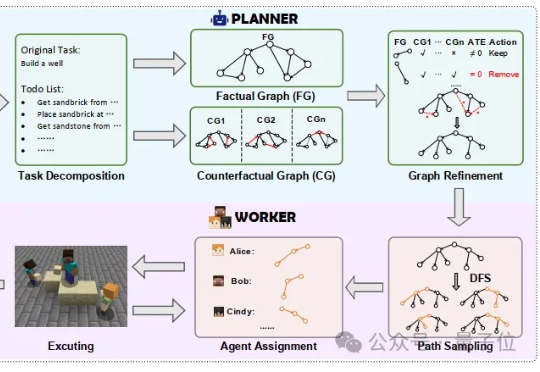

在大多数人眼中,《我的世界》(Minecraft)只是一款自由度极高的沙盒游戏。 而在香港科技大学(广州)与腾讯联合团队的眼中,它却是一座可以演练通用人工智能的“数字练兵场”。

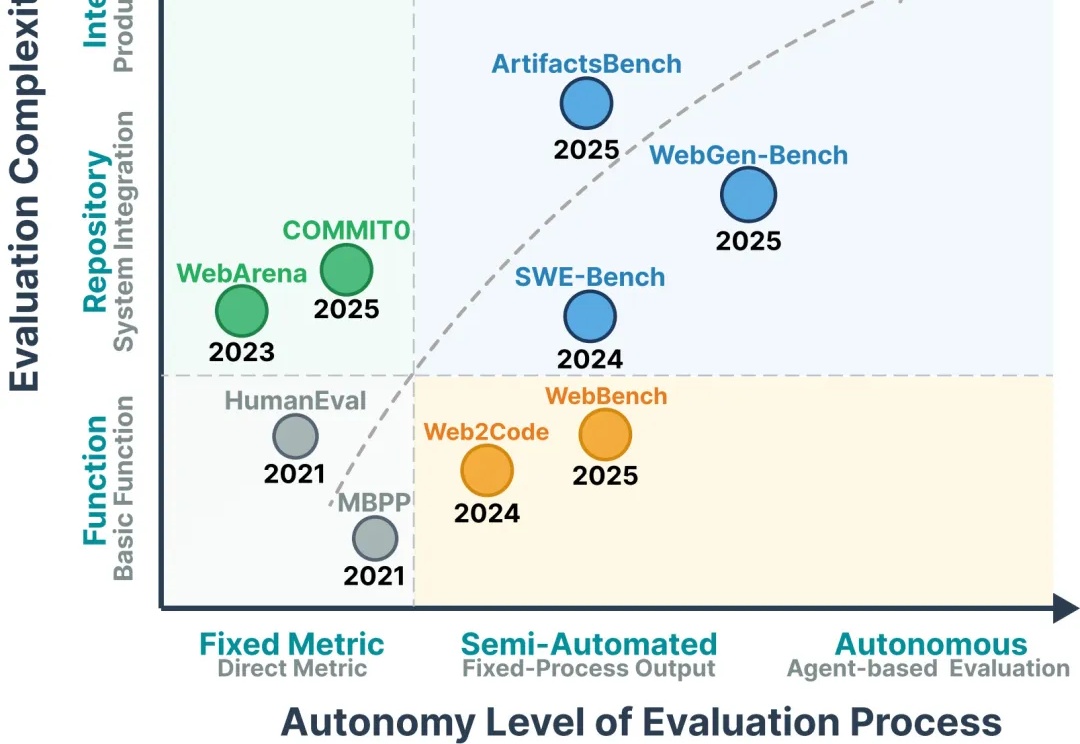

当你刚用 AI 生成了一个精美的电商网站,却在演示时购物车结账功能存在隐藏 Bug?

你有没有想过,软件商业模式可能正在经历五十年来最大的变革?当我看到 Cursor、Claude Code、Lovable 这些 AI 编程工具的出现,以及它们正在以惊人的速度降低软件开发成本时,我意识到我们正站在一个历史转折点上。这不仅仅是开发效率的提升,而是整个软件行业商业逻辑的根本性重构。

Nano banana正火爆全球,谷歌立马推出官方提示词指南。

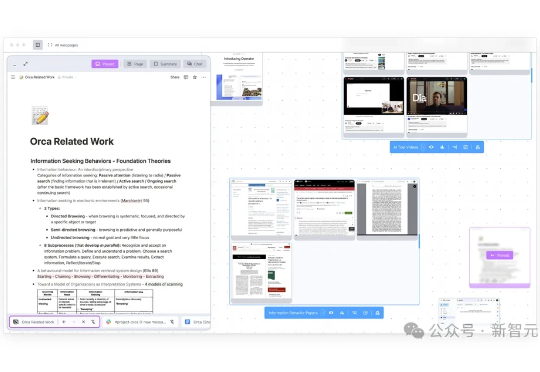

加州大学最新推出Orca浏览器,把拥挤标签页变成可随意拖拽、并排比较的无限画布,让AI替你同时点按钮、填表单。你只需像指挥家一样扫一眼全局、下指令,就能让上百个网页和智能体自动完成搜索、整理、汇总,全程可控。

今年是人工智能正式被提出七十周年,新智元十周年峰会也将于9月7日在北京中关村软件园举行,主题是「新天终启,万象智生」。此次峰会将发布《2025新智元ASI前沿趋势报告》,大会集结百度CTO、NVIDIA副总裁等十位领航者,以「十人十题」解构AI五阶段路线图,纵贯大模型、Physical AI、具身智能到医疗AI、视频AI、脑科学、AI Agent与人才培养,定义下个十年智能图景。

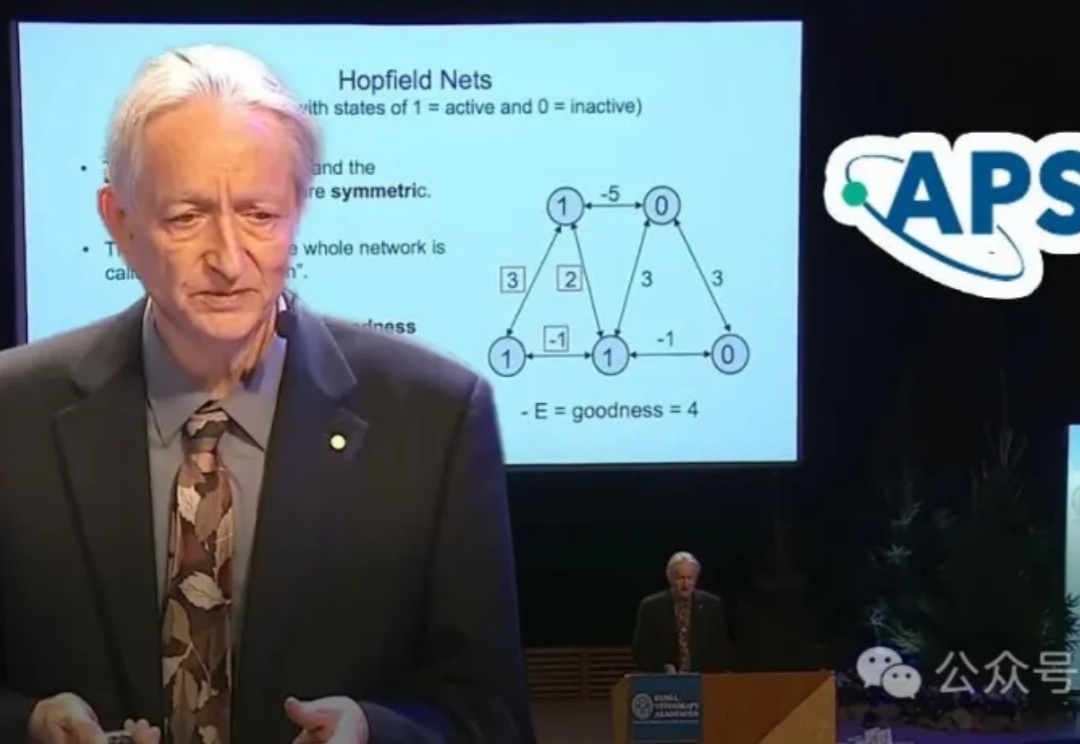

AI教父Hinton荣膺诺贝尔奖,可谓是实至名归。如今,他发表的「玻尔兹曼机」震撼演讲,已登上APS期刊。这一曾催化深度学习革命的「历史酶」,究竟讲了什么?

在长周期、多步骤的协作任务中,传统单智能体往往面临着任务成功率随步骤长度快速衰减,错误级联导致容错率极低等问题。