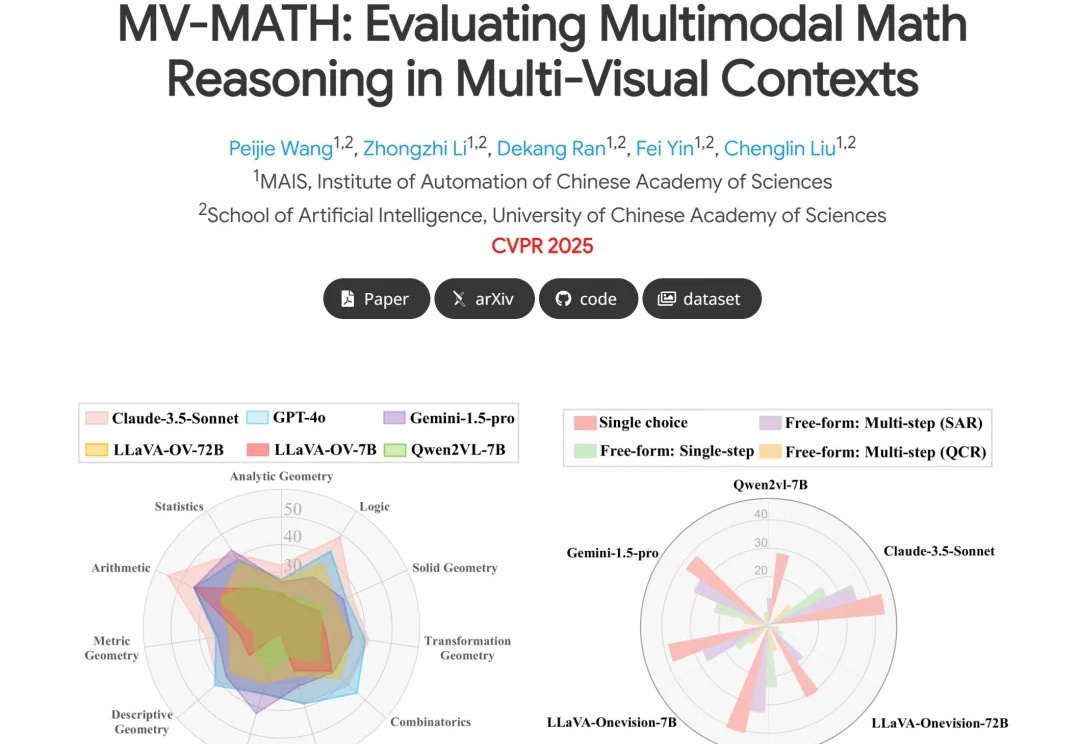

大模型全军覆没,中科院自动化所推出多图数学推理新基准 | CVPR 2025

大模型全军覆没,中科院自动化所推出多图数学推理新基准 | CVPR 2025挑战多图数学推理新基准,大模型直接全军覆没?!

挑战多图数学推理新基准,大模型直接全军覆没?!

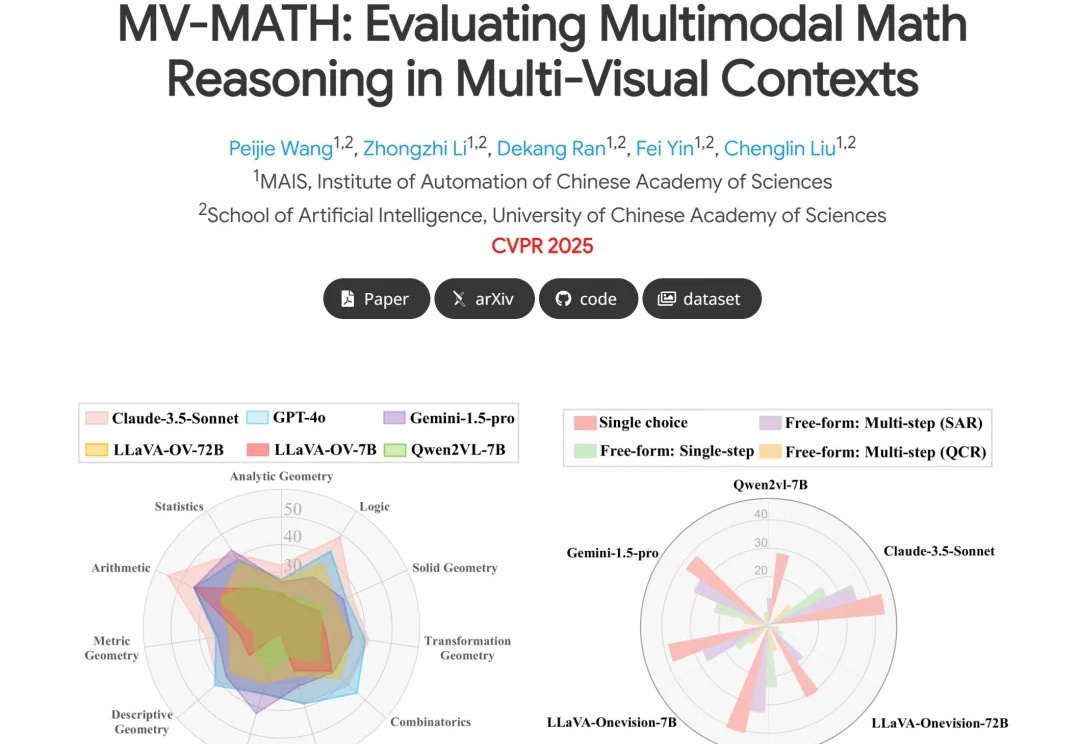

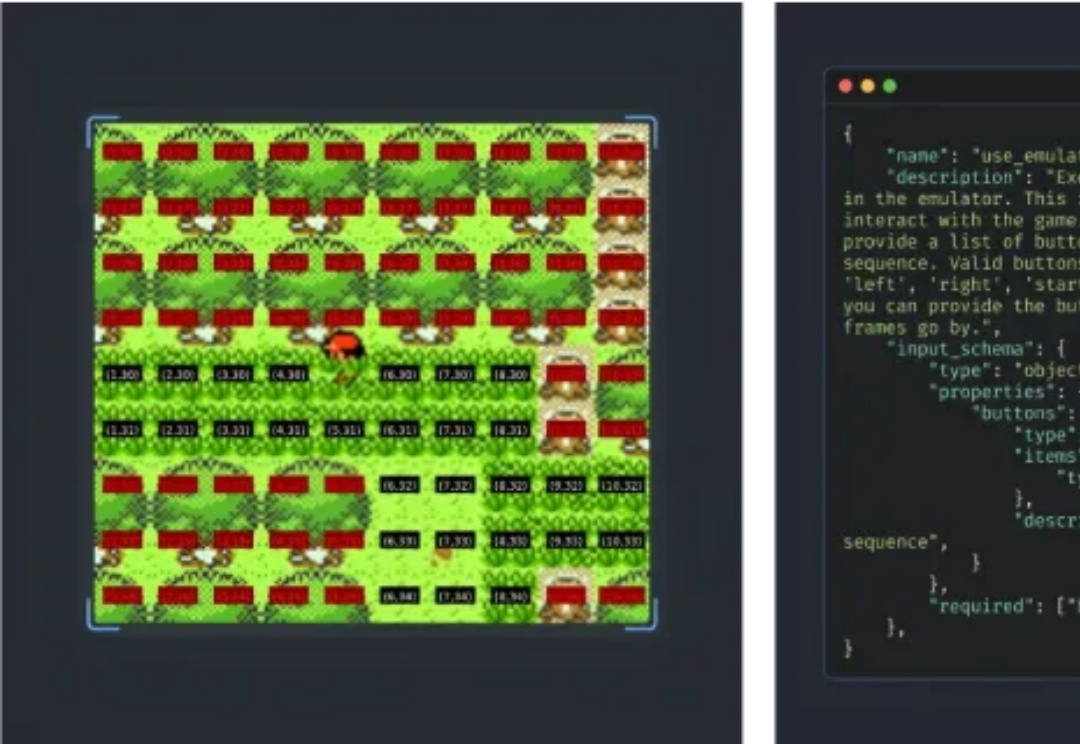

没有任何冷启动数据,7B 参数模型能单纯通过强化学习学会玩数独吗?

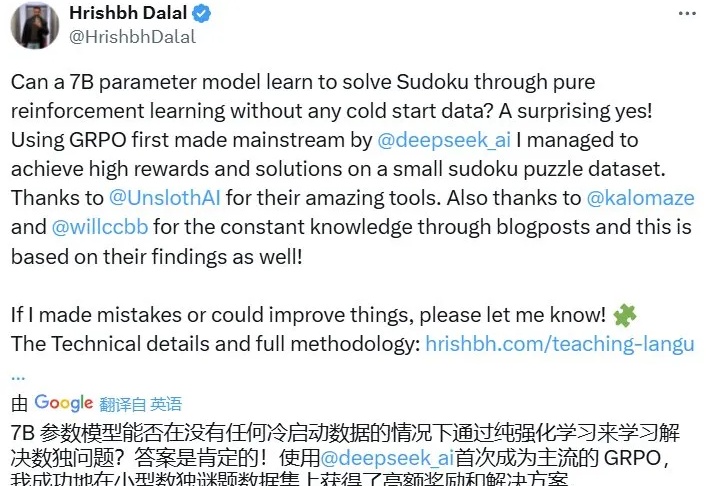

武汉大学等发布了一篇大型视觉语言模型(LVLMs)安全性的综述论文,提出了一个系统性的安全分类框架,涵盖攻击、防御和评估,并对最新模型DeepSeek Janus-Pro进行了安全性测试,发现其在安全性上存在明显短板。

为什么必须像评估劳动力一样评估LLM代理,而不仅仅是评估软件。

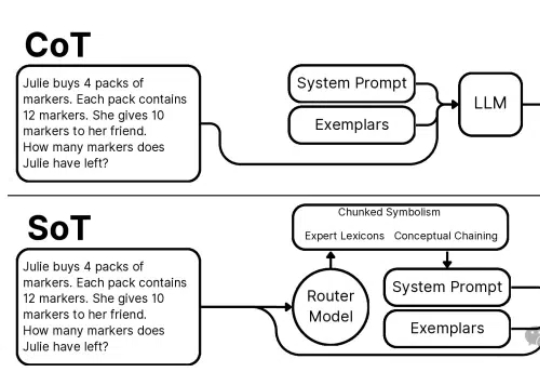

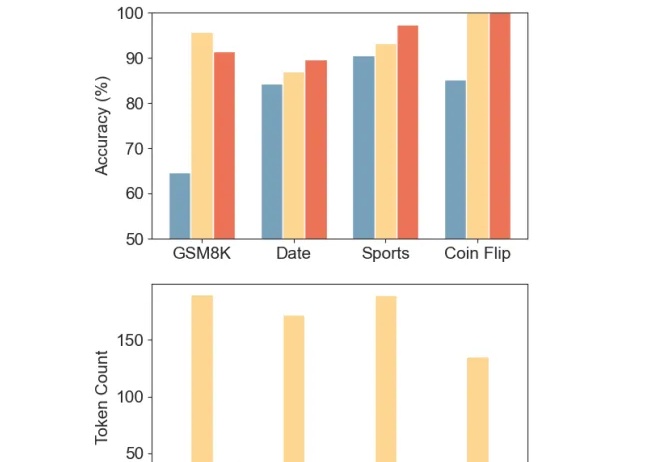

本文介绍了一项突破性的AI推理技术创新——思维草图(SoT)框架。该框架从人类认知过程中获取灵感,通过一个200M大小的路由模型将LLM引导到概念链、分块符号化和专家词汇三种推理范式,巧妙地解决了大语言模型推理过程中的效率瓶颈。

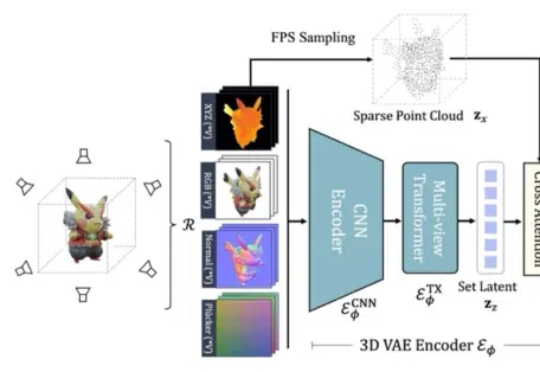

在 ICLR 2025 中,来自南洋理工大学 S-Lab、上海 AI Lab、北京大学以及香港大学的研究者提出的基于 Flow Matching 技术的全新 3D 生成框架 GaussianAnything,针对现有问题引入了一种交互式的点云结构化潜空间,实现了可扩展的、高质量的 3D 生成,并支持几何-纹理解耦生成与可控编辑能力。

ChatGPT 平地一声雷,打乱了很多人、很多行业的轨迹和节奏。这两年模型发布的数量更是数不胜数,其中文本大模型就占据了 AIGC 赛道的半壁江山。关注我的家人们永远都是抢占 AI 高地的冲锋者。

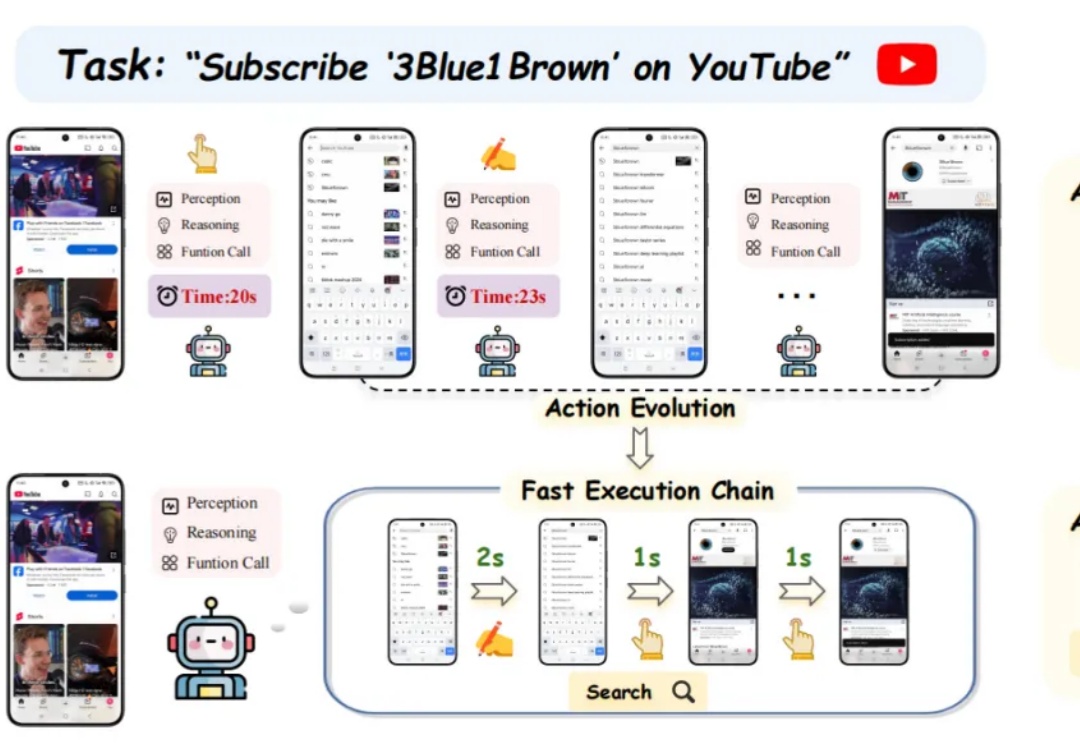

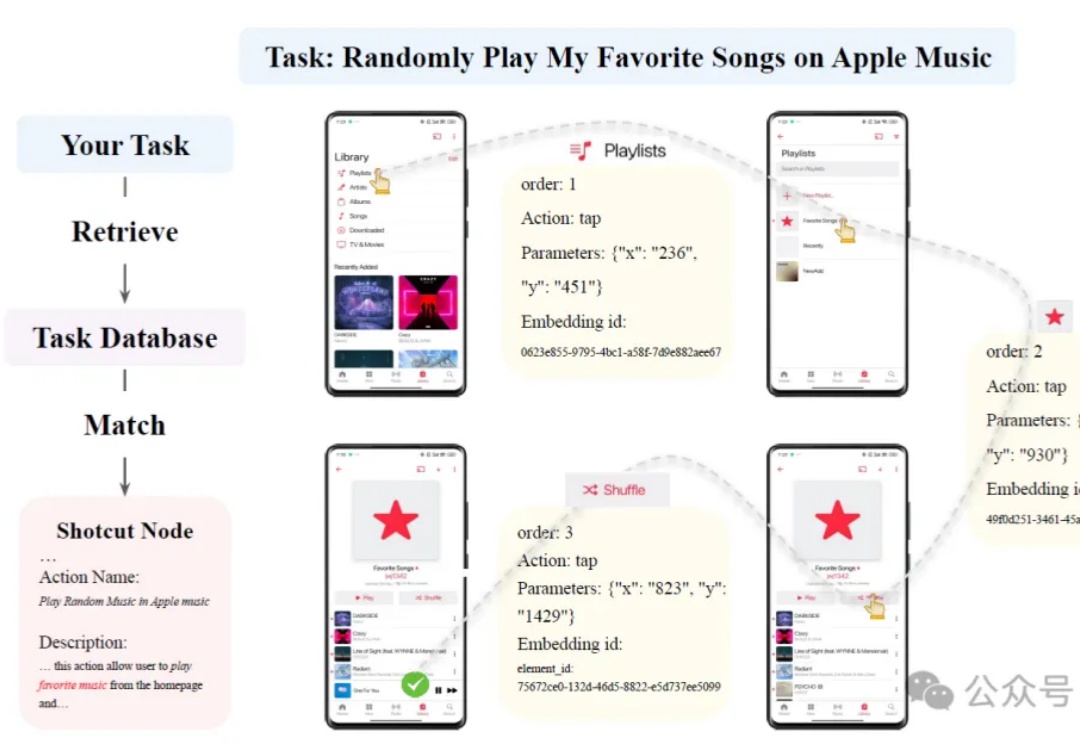

Magma是一个新型多模态基础模型,能够理解和执行多模态任务,适用于数字和物理环境:通过标记集合(SoM)和标记轨迹(ToM)技术,将视觉语言数据转化为可操作任务,显著提升了空间智能和任务泛化能力。

开源微调神器Unsloth带着黑科技又来了:短短两周后,再次优化DeepSeek-R1同款GRPO训练算法,上下文变长10倍,而显存只需原来的1/10!

LLM 在生成 long CoT 方面展现出惊人的能力,例如 o1 已能生成长度高达 100K tokens 的序列。然而,这也给 KV cache 的存储带来了严峻挑战。

微软研究院官宣开源多模态AI——Magma模型。首个能在所处环境中理解多模态输入并将其与实际情况相联系的基础模型。

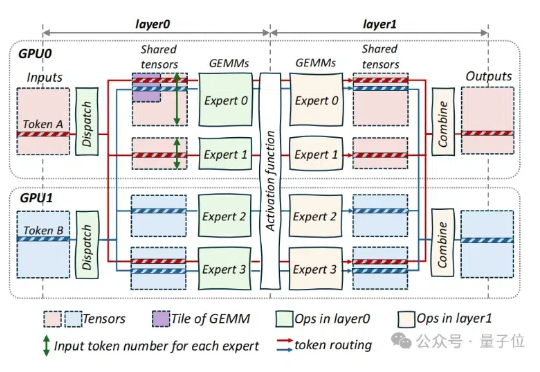

字节对MoE模型训练成本再砍一刀,成本可节省40%! 刚刚,豆包大模型团队在GitHub上开源了叫做COMET的MoE优化技术。

刚填完坑就又埋下“惊喜预告”??

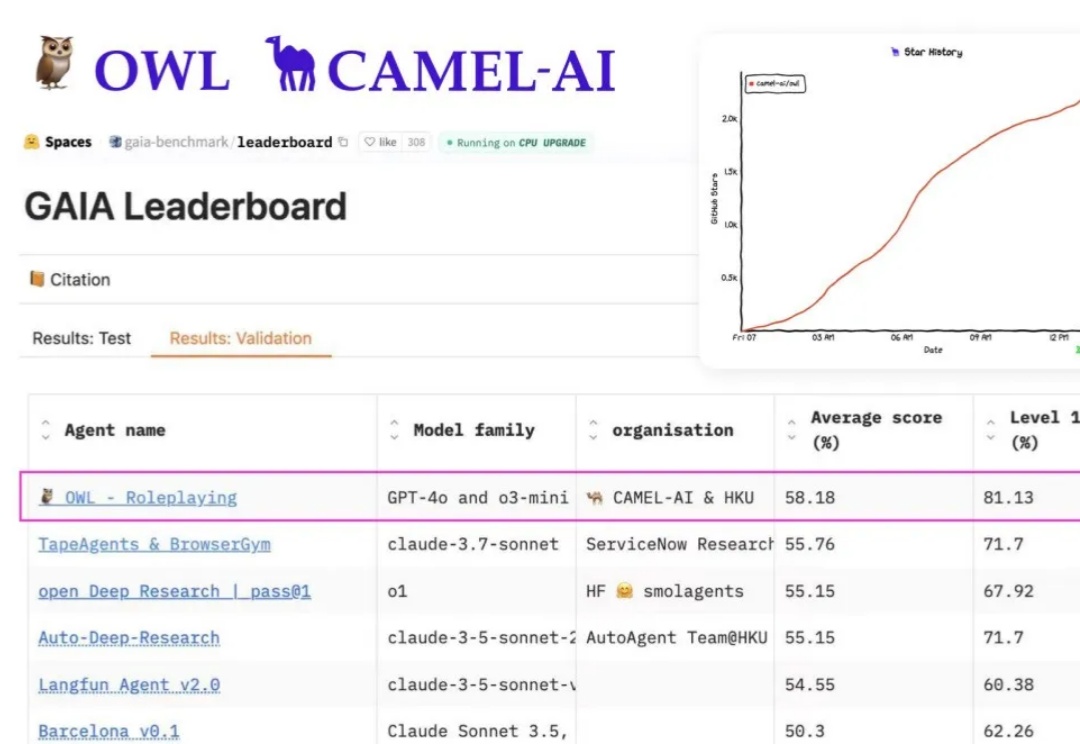

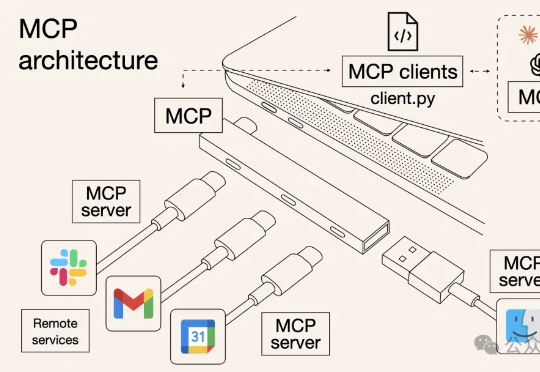

AI智能体领域Type-C来了!Manus及其开源复现诞生,一夜捧红了MCP,工具调用/访问外部数据,一个协议就够了。

推理token减少80%-90%,准确率变化不大,某些任务还能增加。

近年来,大语言模型(LLM) 的快速发展正推动人工智能迈向新的高度。像 DeepSeek-R1 这样的模型因其强大的理解和生成能力,已经在 对话生成、代码编写、知识问答 等任务中展现出了卓越的表现。

最近 AI 圈最炸的瓜,毫无疑问是——Manus。

由于语言泛化,今天出现了很有趣的现象:「Agent 是什么」,这个问题没有了标准的定义。一个常见的观点是:Agent 是一种让 AI 以类似人的工作和思考方式,来完成一系列的任务。一个 Agent 可以是一个 Bot,也可以是多个 Bot 的协同。

AGI明年降临?清华人大最新研究给狂热的AI世界泼了一盆冷水:人类距离真正的AGI,还有整整70年!若要实现「自主级智能,需要惊人的10²⁶参数,所需GPU总价竟是苹果市值的4×10⁷倍!

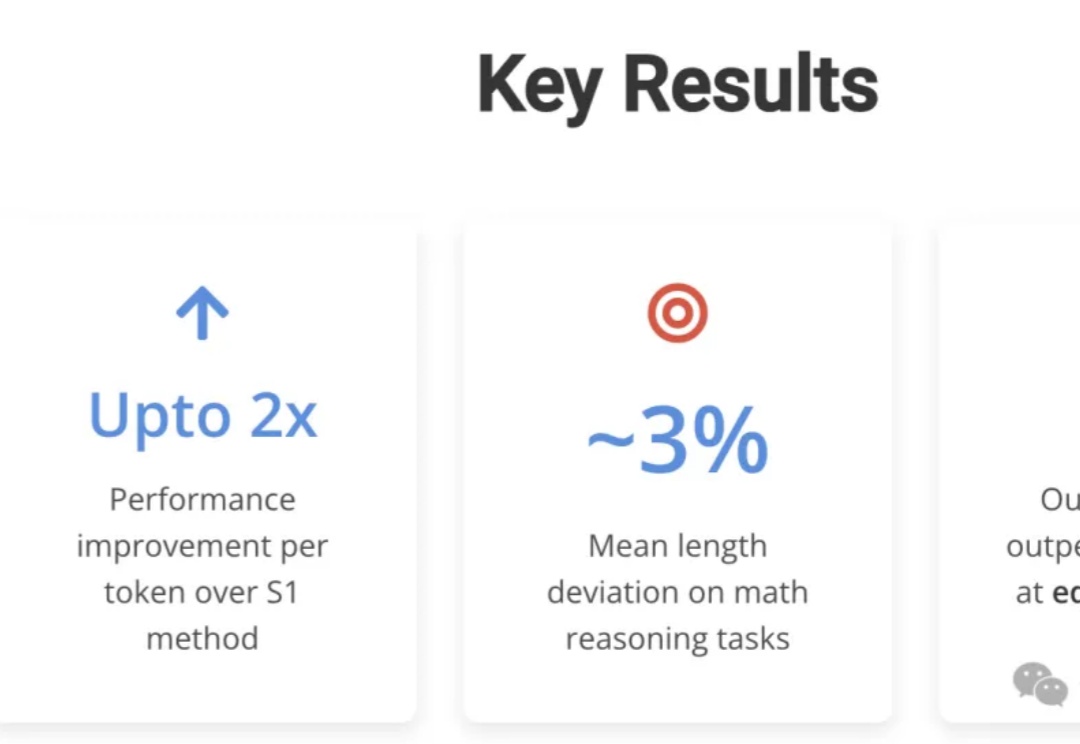

CMU团队用LCPO训练了一个15亿参数的L1模型,结果令人震惊:在数学推理任务中,它比S1相对提升100%以上,在逻辑推理和MMLU等非训练任务上也能稳定发挥。更厉害的是,要求短推理时,甚至击败了GPT-4o——用的还是相同的token预算!

谷歌发布了1000亿文本-图像对数据集,是此前类似数据集的10倍,创下新纪录!基于新数据集,发现预训练Scaling Law,虽然对模型性能提升不明显,但对于小语种等其他指标提升明显。让ViT大佬翟晓华直呼新发现让人兴奋!

TimeDistill通过知识蒸馏,将复杂模型(如Transformer和CNN)的预测能力迁移到轻量级的MLP模型中,专注于提取多尺度和多周期模式,显著提升MLP的预测精度,同时保持高效计算能力,为时序预测提供了一种高效且精准的解决方案。

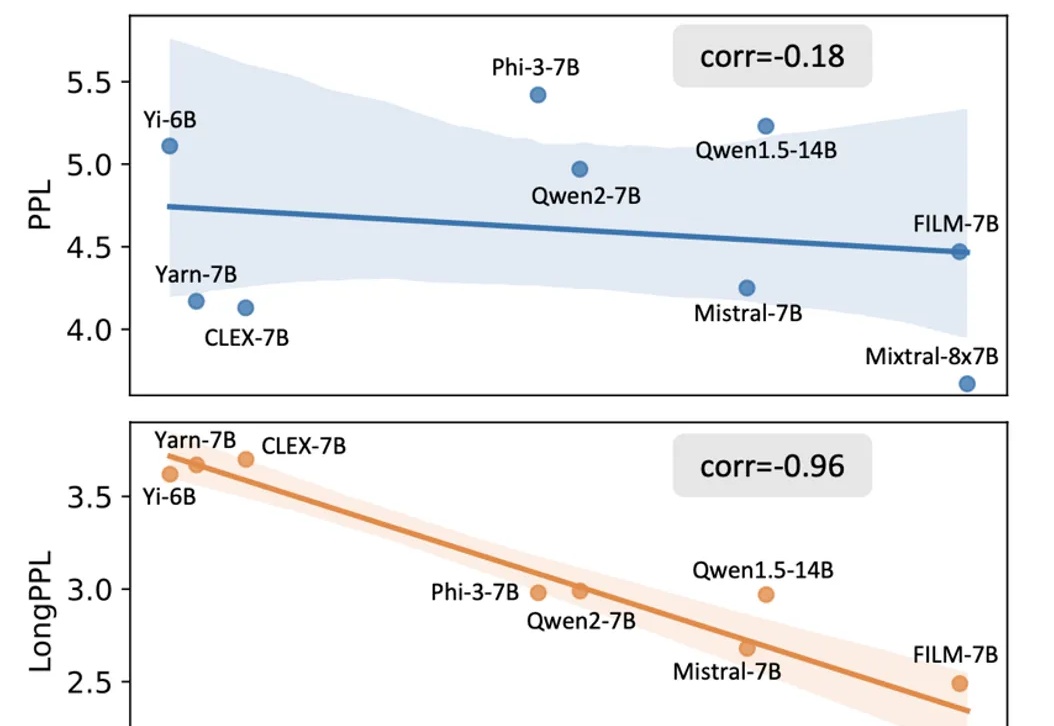

随着大模型在长文本处理任务中的应用日益广泛,如何客观且精准地评估其长文本能力已成为一个亟待解决的问题。

历史上首个能通过双盲同行评审的AI系统Carl诞生了。它是Autoscience研究所的成果,能完成从构思到展示的整个研究过程,撰写的论文已被国际顶会ICLR接受,其能力令人惊叹。

半个月前,Anthropic 发布了其迄今为止最聪明的 AI 模型 —— Claude 3.7 Sonnet。

人工智能正迎来前所未有的变革,其中,大语言模型(LLM)的崛起推动了智能系统从信息处理向自主交互迈进。

在面对复杂的推理任务时,SFT往往让大模型显得力不从心。最近,CMU等机构的华人团队提出了「批判性微调」(CFT)方法,仅在 50K 样本上训练,就在大多数基准测试中优于使用超过200万个样本的强化学习方法。

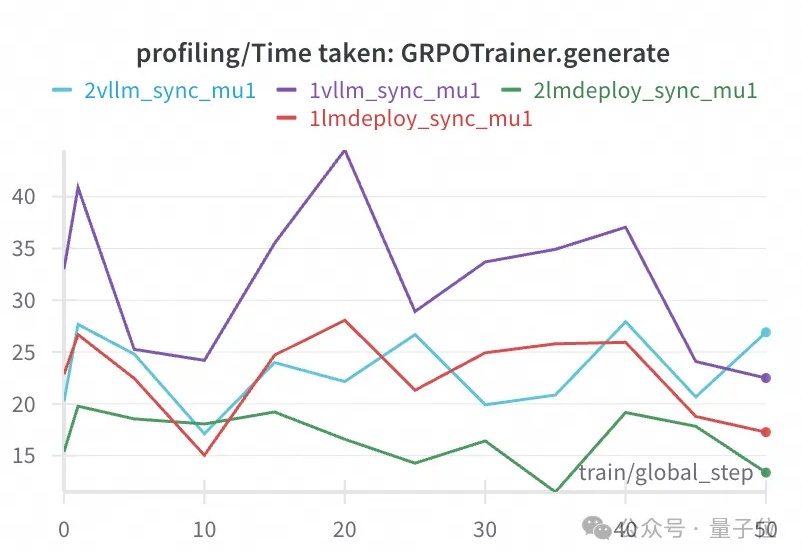

GRPO训练又有新的工具链可以用,这次来自于ModelScope魔搭社区。

生成式AI正重塑众多行业格局!传统搜索、网站与自由开发者、教育科技等行业受到冲击。AI对行业变革又有哪些推动作用?答案就在报告中。

从今天这个视角来看,DeepSeek 等国内外大模型能力是越来越强大了,大家都说 2025 年 AI 应用还会持续爆发。但对于企业来说,有了大模型,那场景都有啥,应用又长啥样?