突发:Claude引入强实名制验证!必须真人手持证件自拍,否则直接封号!

突发:Claude引入强实名制验证!必须真人手持证件自拍,否则直接封号!Anthropic 正式宣布在 Claude 平台推出身份验证功能。为了防止滥用、落实平台政策及履行法律合规义务,部分用户在访问特定功能或触发平台风控(完整性检查)时,将弹出强制验证提示。Anthropic 要把中国用户往绝路上逼!

Anthropic 正式宣布在 Claude 平台推出身份验证功能。为了防止滥用、落实平台政策及履行法律合规义务,部分用户在访问特定功能或触发平台风控(完整性检查)时,将弹出强制验证提示。Anthropic 要把中国用户往绝路上逼!

两个备案概念都涉及"AI",为啥就是不一样? 合规路径+完整流程+避坑清单,看完就懂!

就在刚刚,NeurIPS在X上公开道歉,并表明: 我们已经更新了手册,与ACM、IEEE以及其他国际会议和往届NeurIPS的投稿规则保持一致。与往年一样,NeurIPS欢迎所有符合合规要求的机构和个人提交论文。

无锡高新区发布《关于支持OpenClaw等开源社区项目与OPC社区融合发展的若干措施(征集意见稿)》。 12条“养龙虾”政策,从基础支持到产业落地,从人才引育到安全合规,单项支持最高达500万

企业级场景中,无论是做RAG还是agent,我们都会面临一个问题:出于数据隐私以及合规要求,数据必须保留在本地。但传统的本地存储方案往往存在数据隔离性差、崩溃易丢数据、配置管理混乱、操作不可撤销等问题。

Meta 收购 Manus 无疑是本月最重磅的行业新闻。不到一年时间,产品上线、拿到美元投资、团队主体搬到新加坡、一亿美元 ARR,然后就是被 Meta 收购,Manus 发展速度惊人。 这其中,搬到

在开始教程之前,先说一些背景信息和风险 1. 为什么国行 iPhone 不能用 AI?这个是出于合规原因,苹果在 iOS 系统层面通过检测设备的“型号代码”(如CH/A),从底层屏蔽了国行设备的 Ap

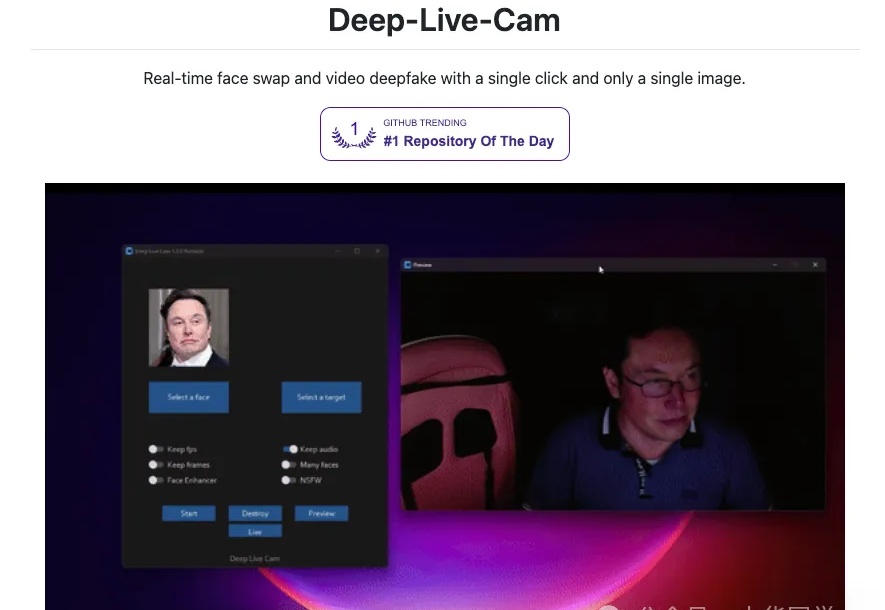

Deep-Live-Cam 是一款开源的实时换脸与视频深度伪造(deepfake)工具,只需要一张人脸图片,就能在本地电脑上对摄像头画面或视频进行实时换脸。 支持 Windows / Linux / macOS,多种硬件加速(CPU / CUDA / CoreML / DirectML / OpenVINO),并内置不良内容检测与合规提示,定位是服务 AI 生成媒体行业的高效生产力工具。

香港科技大学KnowComp实验室提出基于《欧盟人工智能法案》和《GDPR》的LLM安全新范式,构建合规测试基准并训练出性能优异的推理模型,为大语言模型安全管理提供了新方向。

Obot MCP Gateway是他们解决方案的核心,这是一个开源控制平面,为IT团队提供了对MCP部署前所未有的可见性和控制能力。从架构上看,这个网关采用了代理模式,所有与MCP服务器的通信都会通过网关进行代理,这为审计、日志记录和应用安全策略提供了单一控制点。这种设计消除了影子AI的可能性,确保了合规性。