拒绝成为落后的开发者:用TRAE Skills构建你的10倍效能工具箱

拒绝成为落后的开发者:用TRAE Skills构建你的10倍效能工具箱比如前些天,Vercel 创始人 Guillermo Rauch 推出了所谓的「AI skill 的 npm」,让用户仅需一个简单命令 npx skills add [package],就能为自己的 AI 智能体轻松注入专业能力。

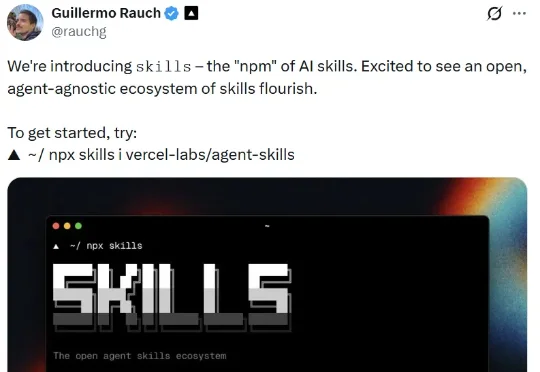

比如前些天,Vercel 创始人 Guillermo Rauch 推出了所谓的「AI skill 的 npm」,让用户仅需一个简单命令 npx skills add [package],就能为自己的 AI 智能体轻松注入专业能力。

随着AI浪潮的袭来,笔者本人以及团队都及时的调整了业务方向,转型为一名AI开发者和AI产品开发团队,常常需要微调大模型注入业务场景依赖的私域知识,然后再把大模型部署上线进行推理,以支撑业务智能体或智能问答产品的逻辑流程。

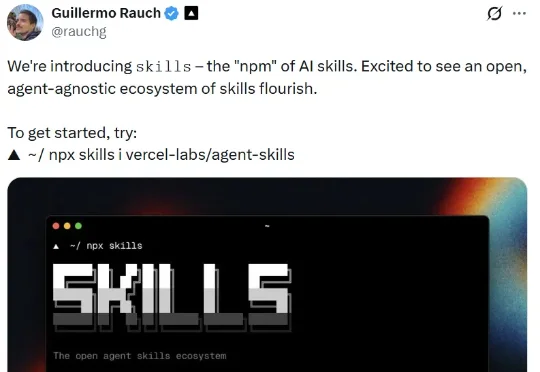

又一家ARR突破1亿美元的AI创企诞生了!近日,由华人CEO领衔的美国AI云创企RunPod对外披露,其年化收入已达到1.2亿美元(约合人民币8.35亿元),平台累计开发者用户数超过50万。

摩尔线程 AI 算力本(MTT AIBOOK)是专为 AI 学习与开发者打造的个人智算平台。它搭载自研智能 SoC 芯片「长江」,提供 50TOPS 异构 AI 算力,支持混合精度计算。运行基于 Linux 内核的 MT AIOS 操作系统,具备多系统兼容能力,并预置完整 AI 开发环境与工具链。

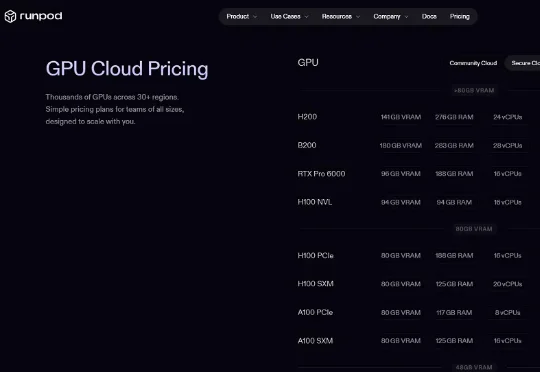

Claude Skill 很火,甚至已经超越 MCP 了,如今各家的 cli 客户端基本也都支持,扣子、MiniMax 的 agent 产品也都上架了类 Skill 的产品。而且不仅仅是对普通用户有用,从开发者视角来看,通用 Agent 内核,只靠 Skills 设计,也能低成本创造具有通用 AI 智能上限的垂直 Agent 应用。

《晚点 Auto》独家获悉,激光雷达供应商禾赛科技联合创始人及 CTO 向少卿和 CEO 李一帆、首席科学家孙恺在 2024 年底创立了一家机器人公司 Sharpa,主要开发通用机器人及核心部件。

昨天,Claude刚刚被曝要有永久记忆,今天就被开发者抢先一步。一个叫Smart Forking的扩展,让大模型首次拥有「长期记忆」,无需重头解释。开发者圈沸腾了:难以置信,它真的能跑!

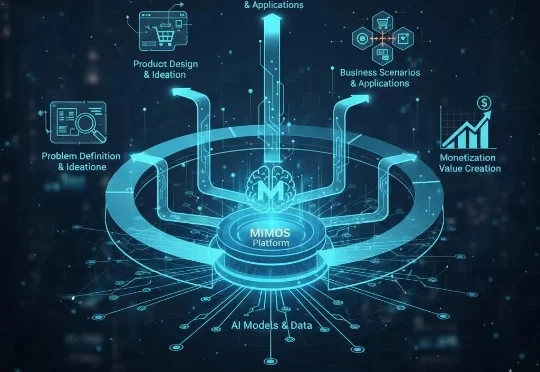

原人工智能大模型公司衔远科技(Frontier.ai)的AI产品负责人 Lyon(李昂),已正式启动新项目 “MIMOS”。与当前市场集中于底层模型研发或垂直应用开发的路径不同,Lyon此次创业将目光投向AI浪潮中更为关键的“产品化”环节,致力于探索连接前沿技术与实际商业价值的系统性方法论。

在很长一段时间里,游戏开发被视为数字领域的重工业。

软件行业正站在一个颇为微妙的拐点上。AI 已经从自动补全代码,演进为能够自主执行开发任务的智能体。