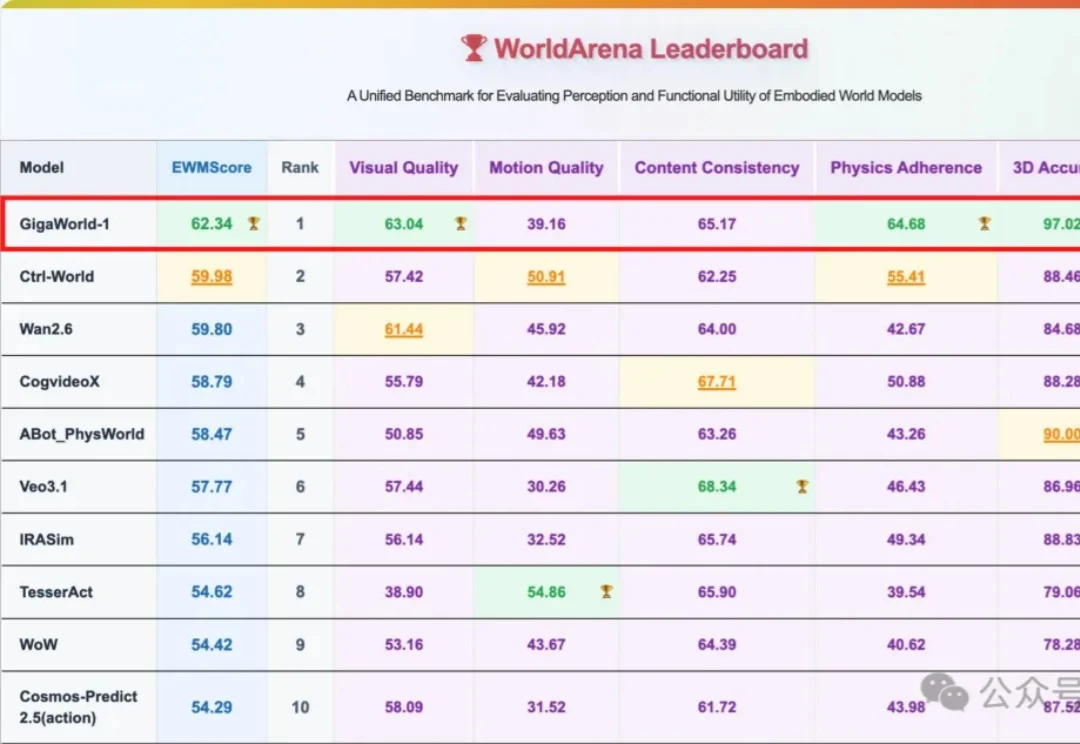

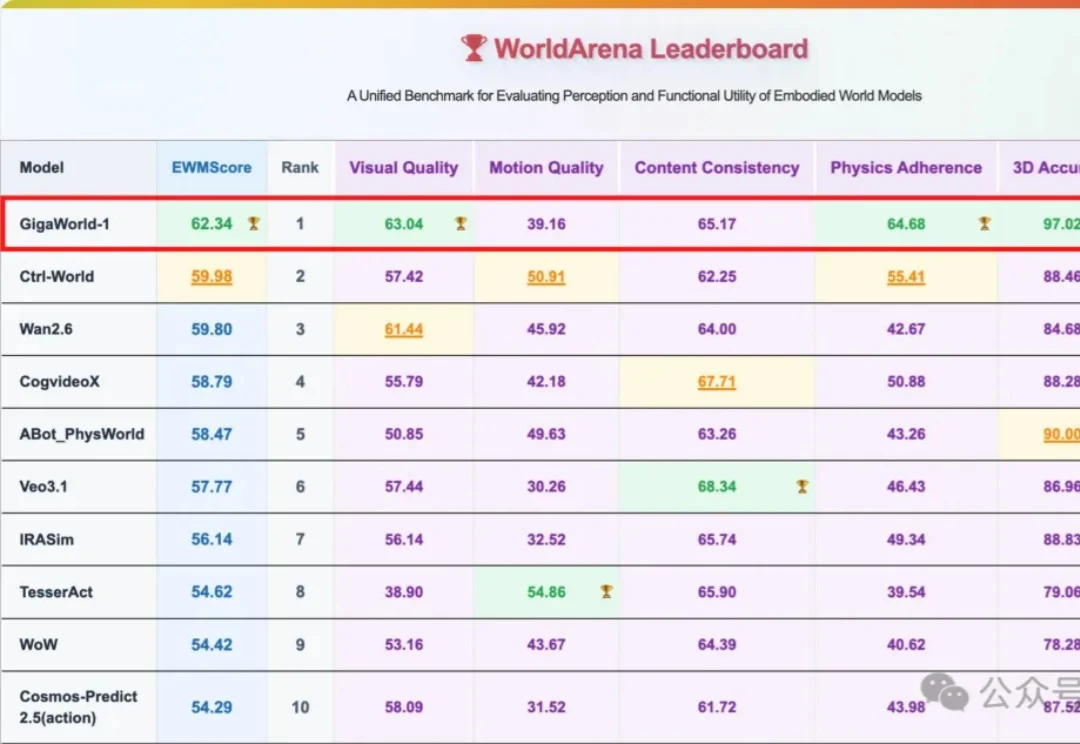

国产世界模型登顶全球第一!断层领先谷歌英伟达,3D准确度逼近满分

国产世界模型登顶全球第一!断层领先谷歌英伟达,3D准确度逼近满分还得是咱国产世界模型牛!

搜索

搜索

还得是咱国产世界模型牛!

要论整活儿,还得是何同学。

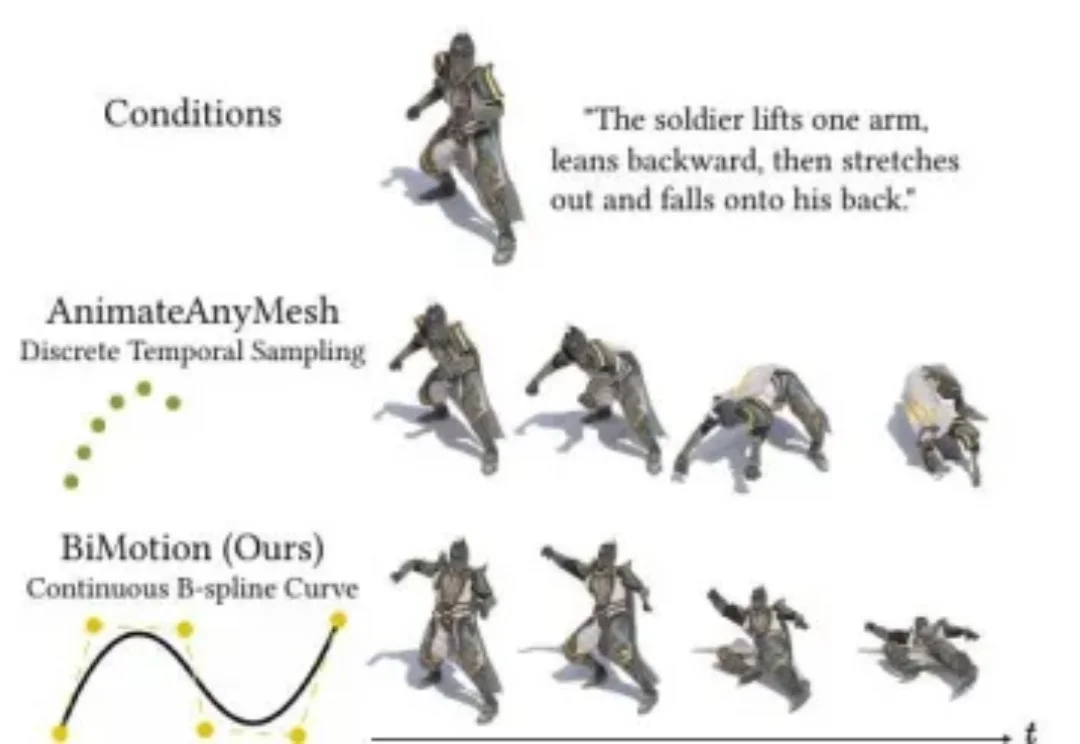

当你希望 AI 将 "士兵举起手臂,向后倾身,然后身体向前扑倒" 这段文字转化为一段 3D 角色动画,现有大多数方法给出的答案是:一段摇摇晃晃、语义残缺的短片段。这并非模型能力不足,问题的根源在于将运动表达为逐帧离散序列这一根本性的设计决策。

在GitHub上上线没几天就冲到5.4k stars的3D建筑编辑器开源项目——Pascal Editor。设计软件咱见的不少,但跑在浏览器里的还是有点新鲜,我帮大家浅浅总结了一下Pascal Editor的一些核心亮点:

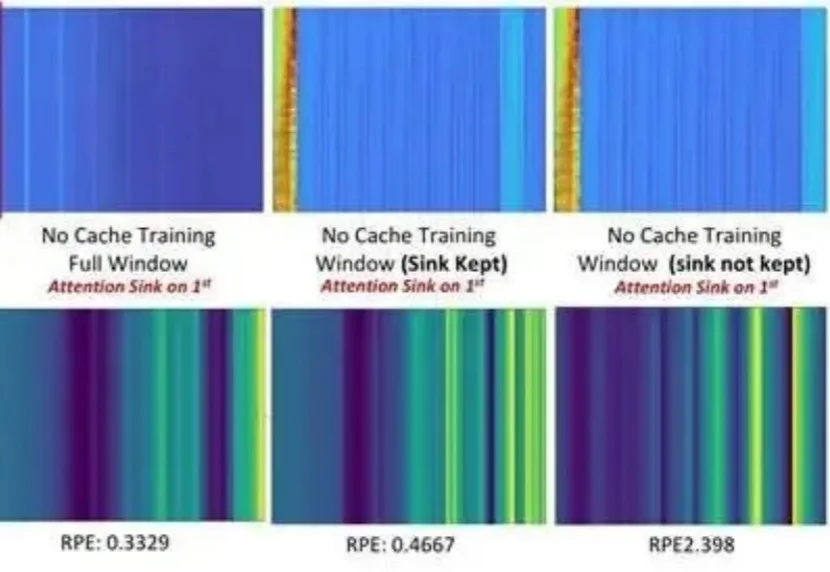

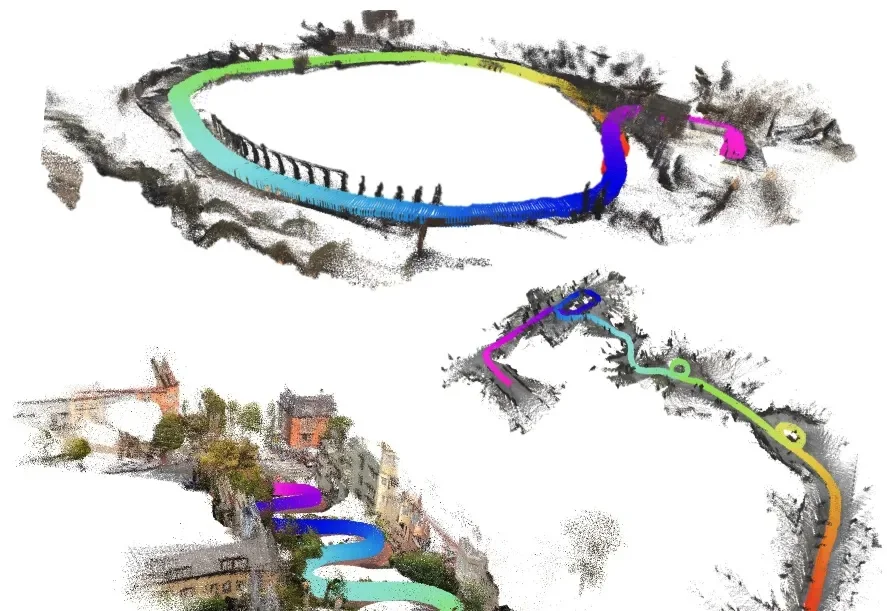

在自动驾驶、具身智能、AR/VR应用中做3D重建,大家都想解决一个终极问题: 模型能不能像人一样,一边往前看,一边持续构建三维世界?

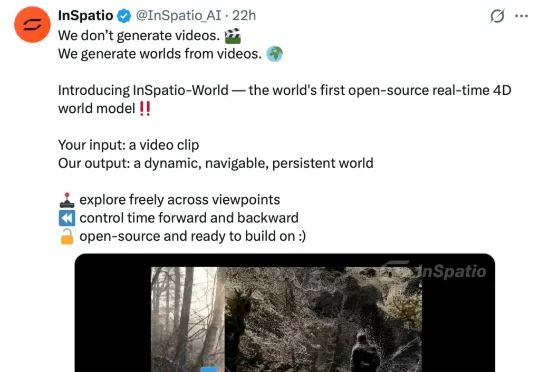

近日,影溯正式发布并开源世界模型 InSpatio-World,综合性能优异,在李飞飞牵头的权威世界模型榜单 WorldScore-Dynamic 中,力压其他实时 / 交互级推理速度的世界模型。它彻底摒弃了烧钱低效的纯 2D 视频路径,凭借更具第一性原理的 3D 空间架构,带来了可实时交互的动态世界。

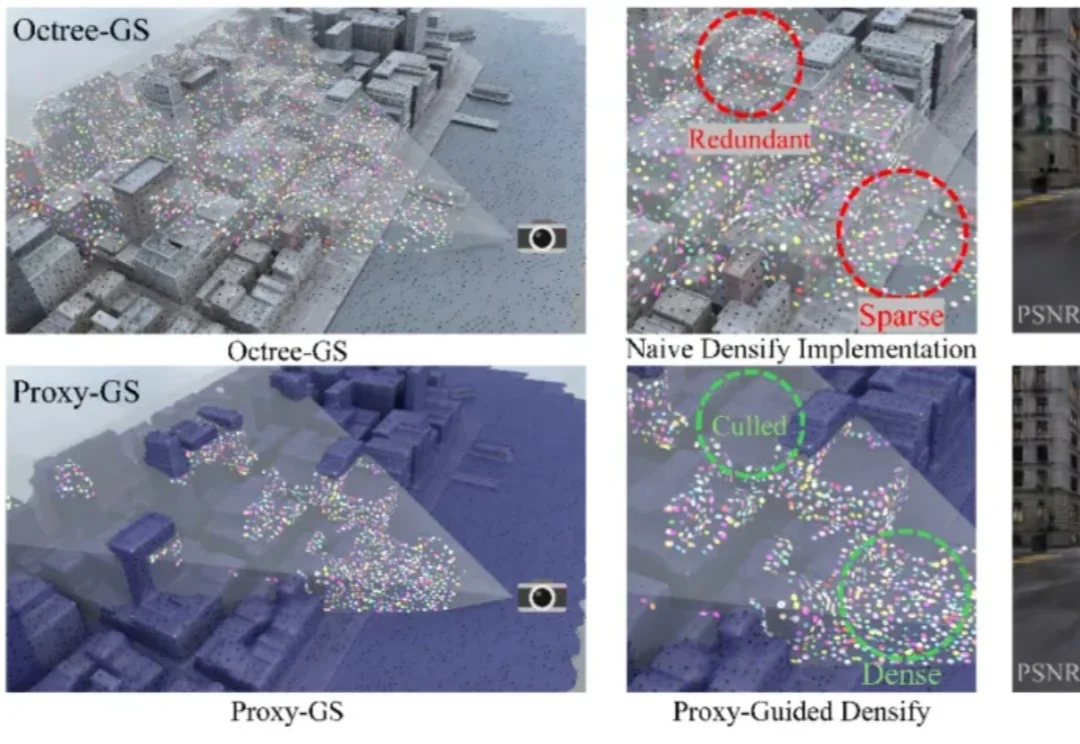

上海交通大学钟志航团队联合上海人工智能实验室、西北工业大学、四川大学等高校在 CVPR 2026 上提出Proxy-GS(Proxy-GS: Unified Occlusion Priors for Training and Inference in Structured 3D Gaussian Splatting),面向基于 MLP 的结构化 3D 高斯溅射(3DGS),

过去两天,全球爆火的 Agent 私人助手 OpenClaw,接连更新了两个版本,让人直呼「开发团队是不睡觉了吗?」

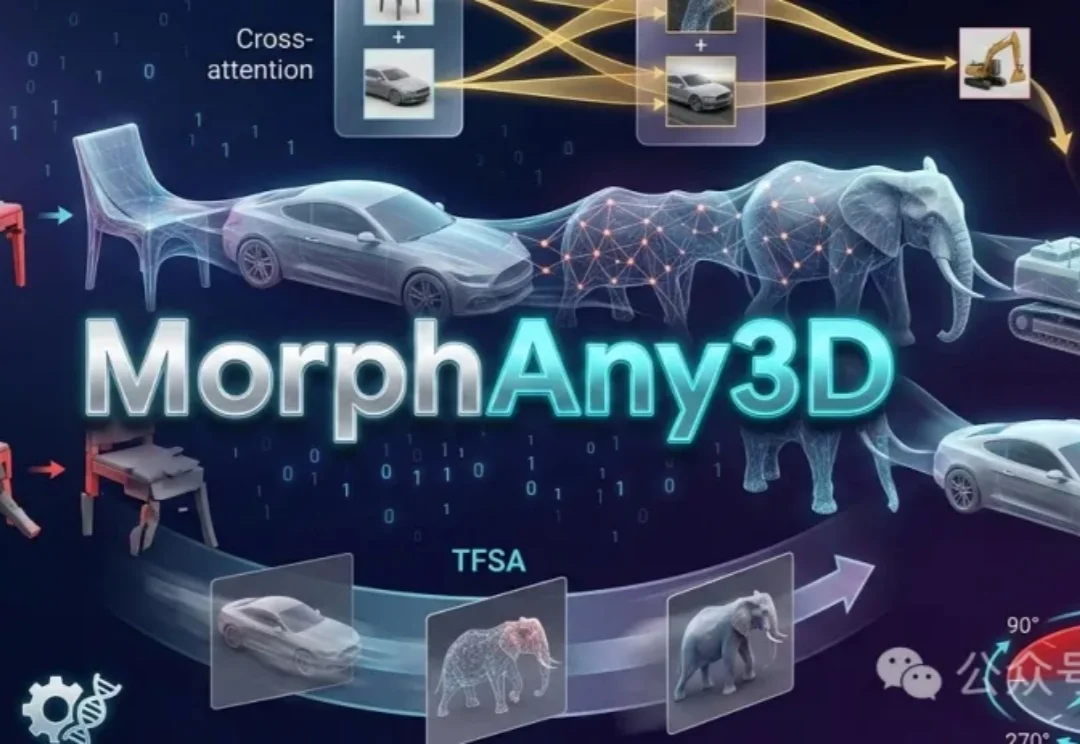

南京大学与北京大学提出MorphAny3D,无需训练即可让三维生成模型实现跨类别平滑变形。通过创新注意力机制融合源与目标特征,精准控制结构与时序,轻松完成复杂变形,效果远超传统方法。

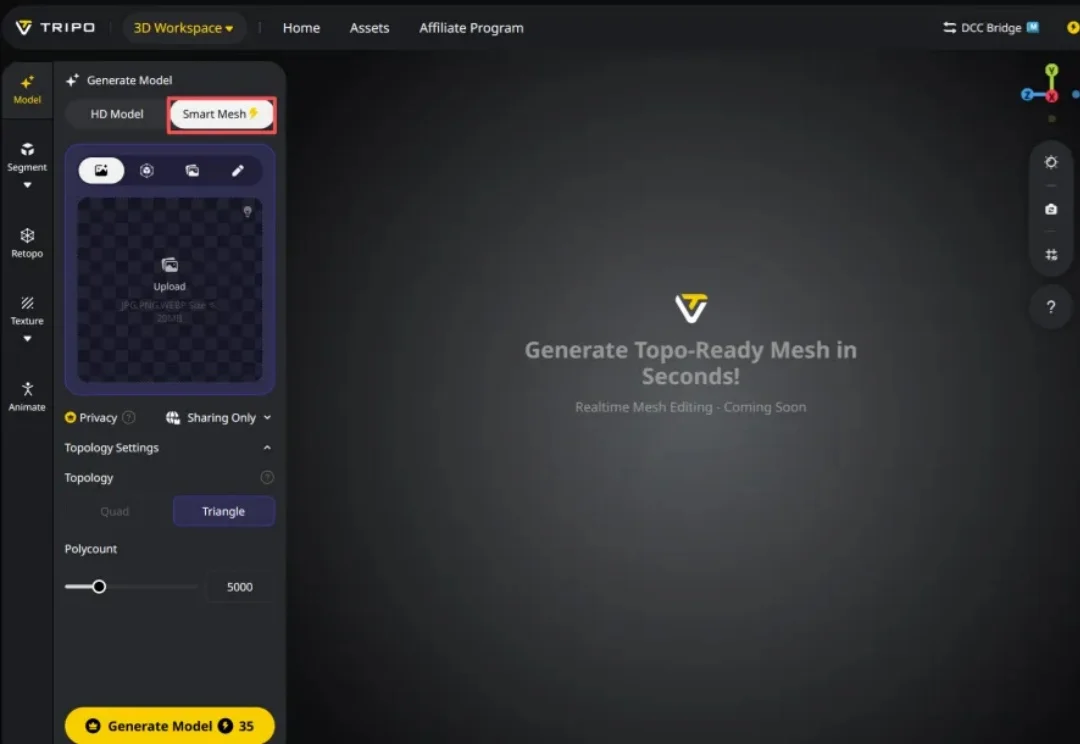

速度、质量、管线可用性,是 AI 3D 生成领域公认的不可能三角。三件事,从来没有同时成立过。直到现在。VAST 最新发布的 Tripo P1.0,首次在原生三维空间中实现概率生成,2 秒内即可输出专业建模师级别的 3D 资产,效率较现有方案提升百倍以上。