黄仁勋致 2026 届毕业生:别慌,AI 把所有人拉回同一起跑线 | 附演讲全文

黄仁勋致 2026 届毕业生:别慌,AI 把所有人拉回同一起跑线 | 附演讲全文就在今天,Carnegie Mellon University(CMU:卡内基梅隆大学)2026 年毕业典礼上,身价逼近 1860 亿美元的「皮衣刀客」黄仁勋站上演讲台,接过科学与技术荣誉博士学位。

搜索

搜索

就在今天,Carnegie Mellon University(CMU:卡内基梅隆大学)2026 年毕业典礼上,身价逼近 1860 亿美元的「皮衣刀客」黄仁勋站上演讲台,接过科学与技术荣誉博士学位。

上次开源 guizang-ppt-skill(github.com/op7418/guizang-ppt-skill) 之后,大家都非常喜欢,短短几周 Github Star 来到了 6000 多。

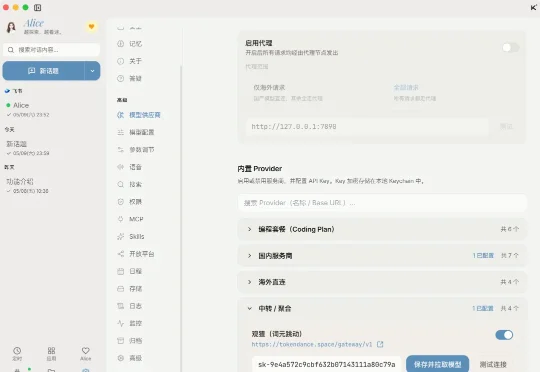

我看到洛小山做的 Alice,在「观猹」上取得了高分 8.2 的成绩。这是一个免费的 AI 个人助理(接入词元跳动注册即送免费算力):她有完整的人设,26 岁澳门女生,会在凌晨提醒你早睡,还会私下「小声蛐蛐」对你的观察。

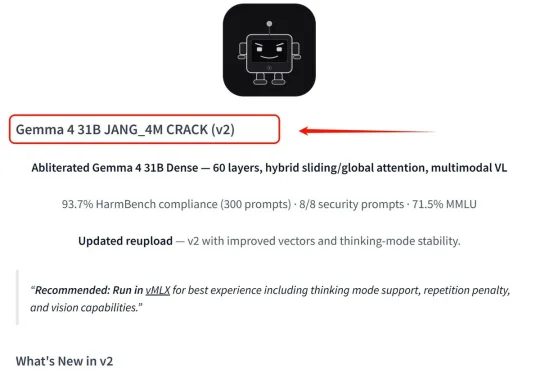

有个31B参数的大模型,正常需要80GB显存才能跑。但现在,24GB显存就能跑满血版。这个版本叫Gemma-4-31B-JANG_4M-CRACK——"CRACK"这个词不要理解歪了,它本质是量化压缩加上对齐微调之后的部署版本,不是什么黑客攻击,就是工程优化。24GB,MacBook Pro,直接跑。苹果用户优先优化,MLX原生支持,月下载13000次。

HakkoAI可以看做是一个AI游戏搭子,它的核心功能是陪伴,在用户打游戏的时候给用户提供陪聊、陪打、查攻略等能力。其国内版本名为「逗逗AI游戏伙伴」,25年8月,化身HakkoAI进入欧美、日本等市场,截至目前全球注册用户数量已经超过1000万。

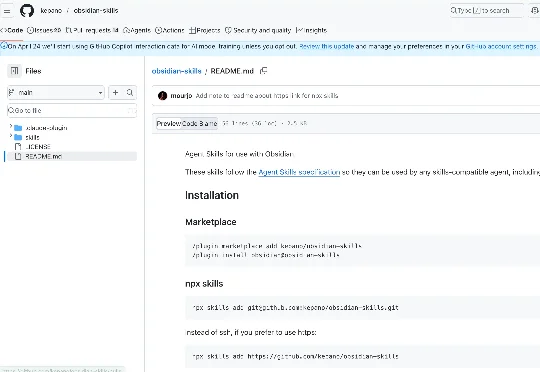

随手打开 GitHub,2026 年的 Agent 项目热榜上有这样一个仓库: • 27,000+ stars,1,800+ forks • 零行 Python,零行 TypeScript,零行 JS • 作者是 Obsidian 的 CEO 本人,kepano • 整个仓库就是 5 个 Markdown 文件

Span 2018 年起家时做的是智能电板,卖给业主帮他们省电费。它的电板能识别每户人家电网接入端的实际可用容量。美国住宅一般标配 200 安培的服务等级,日常负载远低于此。空出来的那部分电力过去没被任何人定价,Span 现在打算把它用来跑 AI 推理。

18岁高中生挖出约150万个未知天体,25岁博士生给1.4亿张星系图装上自然语言搜索……OpenAI发布了首届「ChatGPT Futures Class of 2026」,26位入选者来自从大一就用上ChatGPT的年轻群体,他们正在用AI改写「优秀年轻人」的定义。

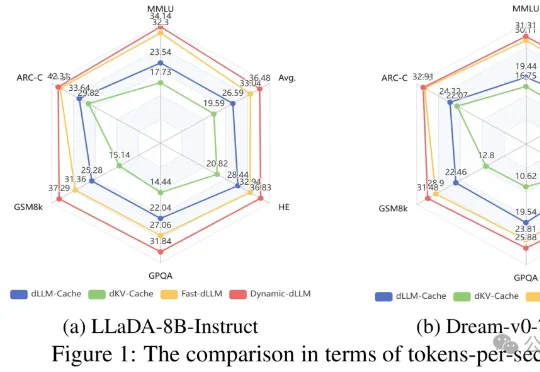

文本生成这件事,扩散大语言模型(dLLMs)正展现出巨大的潜力。但与此同时,它也面临着严重的计算瓶颈——为此,哈工大(深圳)与华为、深圳河套学院的研究团队提出了一套免训练加速框架Dynamic-dLLM。

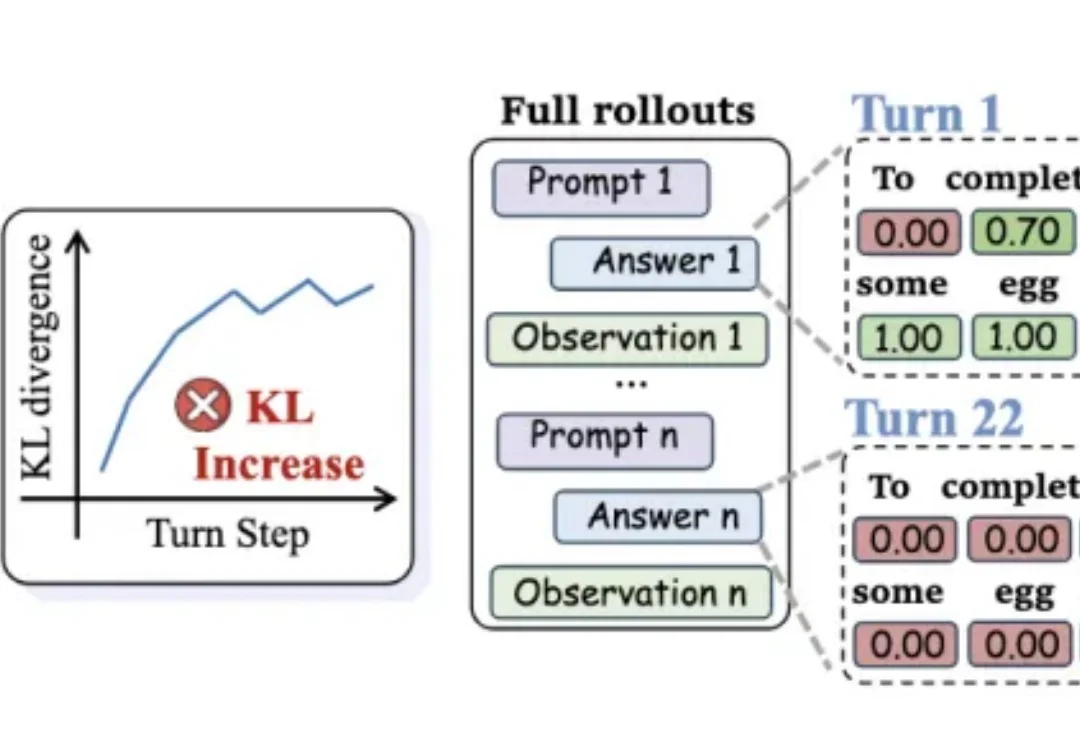

把强大模型的能力“蒸馏”给小模型,听起来很美—— 但放到多轮对话Agent场景里,效果往往一塌糊涂。