2026,Agent死于上下文失焦(附7大Claude Code 记忆遗忘与管理工具)

2026,Agent死于上下文失焦(附7大Claude Code 记忆遗忘与管理工具)搭了个agent,结果该被记住的历史交互经验一点没记住,不该被记住的工具调用结果、过程输出被一股脑塞进上下文,导致输出质量下滑,类似的上下文失焦问题,这是多少人做agent时候的噩梦?

搜索

搜索

搭了个agent,结果该被记住的历史交互经验一点没记住,不该被记住的工具调用结果、过程输出被一股脑塞进上下文,导致输出质量下滑,类似的上下文失焦问题,这是多少人做agent时候的噩梦?

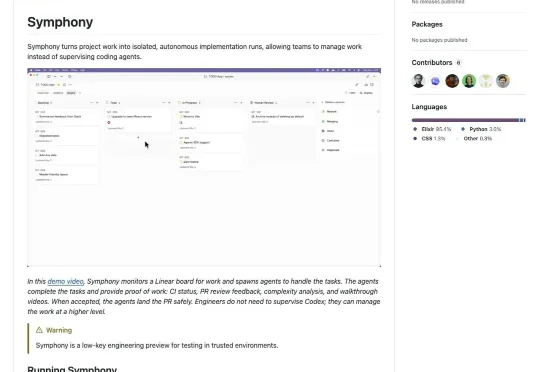

OpenAI工程师公开发帖承认:哪怕用的是Codex,一个人能有效监督的coding agent也就3到5个,再多生产率直接往下掉。更劲爆的是,OpenAI没有选择"让人盯更多屏幕",而是直接开源了Symphony——一套把人类从"实时盯盘"解放成"异步验收"的全新工作流系统。近40万人围观,近3000人收藏。

70万行祖传代码,人走了一拨又一拨,烂尾工程停摆三年没人敢碰。直到首席开发者给Claude Code写了份「说明书」,项目两周收工。

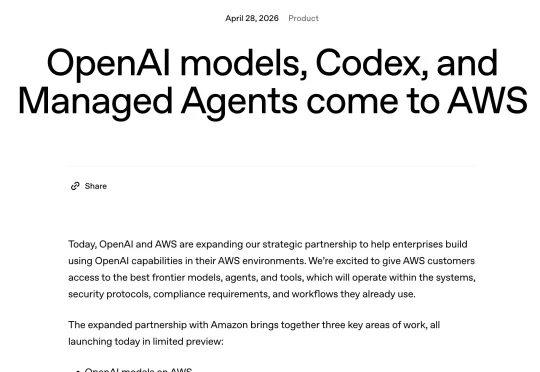

昨天,OpenAI 和微软,官宣分手,今天,OpenAI 已在 AWS 把家安好。三件家具一起搬上:模型、Codex、Managed Agents。包括 GPT-5.5 在内的模型,今天起可以在 Amazon Bedrock 直接调用

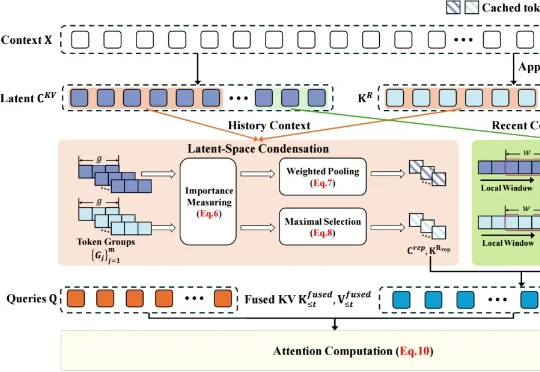

近日,琶洲实验室、华南理工大学、蔻町(AIGCode)等单位科研团队联合提出潜在空间压缩注意力(Latent-Condensed Attention,LCA),研究成果入选 ACL 2026。

一个开发者公开了自己的工作流:让 OpenAI Codex 专门去审查 Hermes agent 写出来的代码,理由只有一个——审稿人不能和写稿人共享同一套记忆。这条推文引发了近万次浏览,背后藏着一个 agent 工程化的新趋势:多模型协作的价值,可能在于互相制衡。

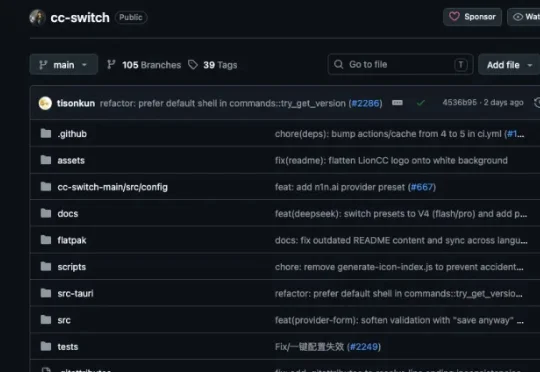

毕竟,这个工具在我看来,他目前确实不仅是Claude Code里接国产模型,也还是其他的各种Agent产品比如OpenClaw、Hermes等等里面,切换模型最方便、最好用的一个。他就是开源的大名鼎鼎的cc switch,至今在github上已经50k的星标了。

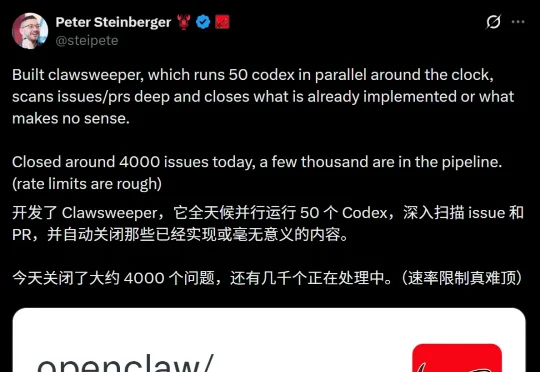

2天搭建、不到1000美元、50个Codex并行扫描——OpenClaw创始人祭出ClawSweeper,一天关闭5000+无效Issue,GitHub API限流成唯一瓶颈,开源维护正式进入AI「自愈」时代。

最近,Lenny Rachitsky 请到了 Kat Wu,Anthropic Claude Code 和 Cowork 的产品负责人,访谈了一期播客。节目信息密度相当高,从 PM 角色的变化、Anthropic 的内部流程,到源码泄露事件和 OpenClaw 决策,全都聊了个遍。

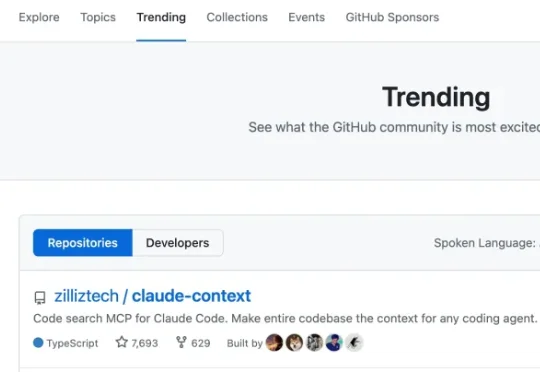

欢迎大家尝试前不久GitHub的日榜榜首项目——Claude Context。通过在AI coding场景引入混合检索,Claude Context相比使用grep的原生 Claude Code 能大幅提升检索精度和效率,减少约 40% 的 不必要Token 消耗。