断崖第一!深度机智Z-WM再夺WorldArena冠军

断崖第一!深度机智Z-WM再夺WorldArena冠军2026 年 5 月,深度机智(DeepCybo)迎来成立一周年。

搜索

搜索

2026 年 5 月,深度机智(DeepCybo)迎来成立一周年。

5000亿门槛前,中国大模型谁最像真巨头?

押注AI基础设施、新云和大模型。

从谷歌DeepMind分拆而出的AI药物英国研发公司Isomorphic Labs昨日宣布完成21亿美元(约合人民币143亿元)B轮融资。据外媒Ventureburn报道,这笔融资创下全球AI制药行业单笔融资新纪录。

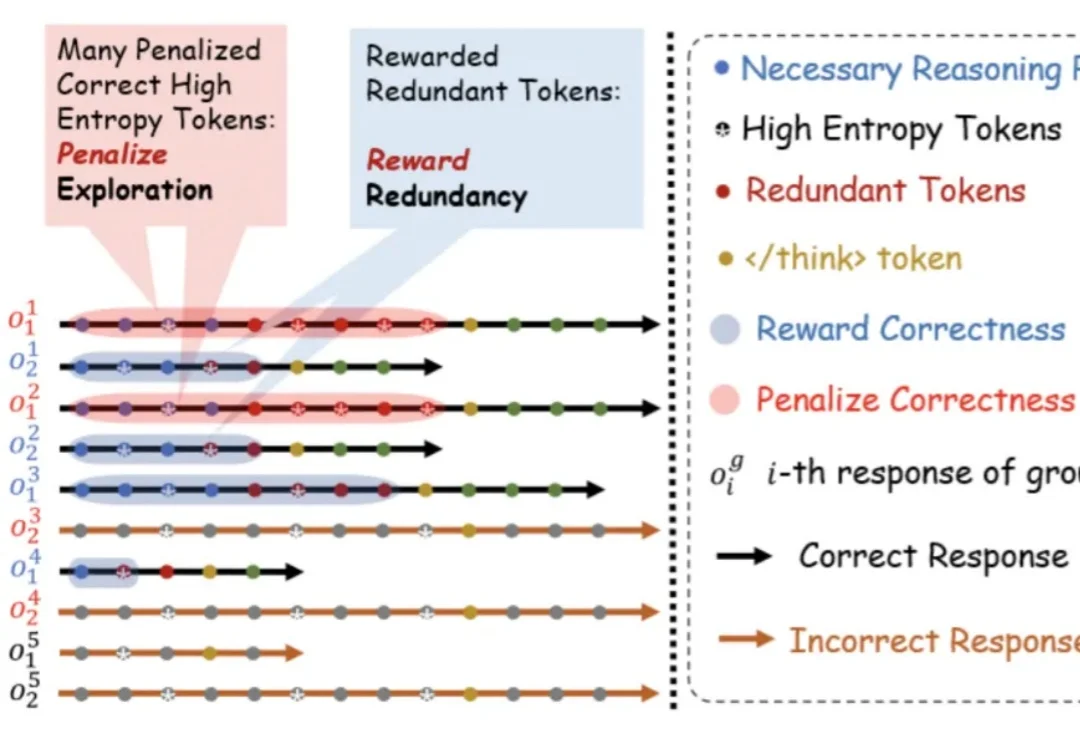

以 DeepSeek-R1、OpenAI GPT Thinking 为代表的大型推理模型,通过长达数千 token 的「思维链」在各类复杂推理任务中展现出卓越的性能。然而,这些模型普遍存在一个核心问题,即过度思考(overthinking) :

刚刚,DeepSeek融资这件事差不多落定了。据top华人科创社区消息,此轮由阿里、腾讯和国家大基金各注资 100 亿,加上创始人梁文锋个人的 200 亿组成,公司估值约为 3500 亿人民币。

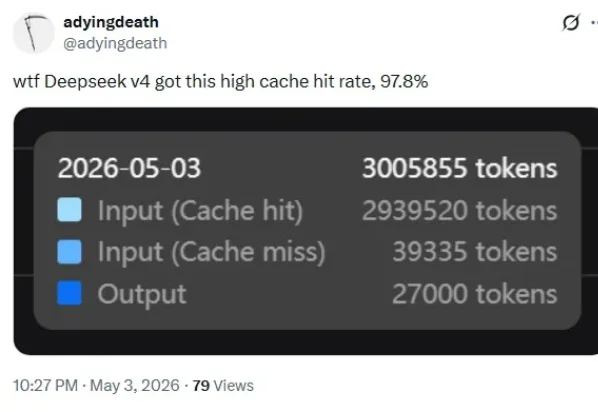

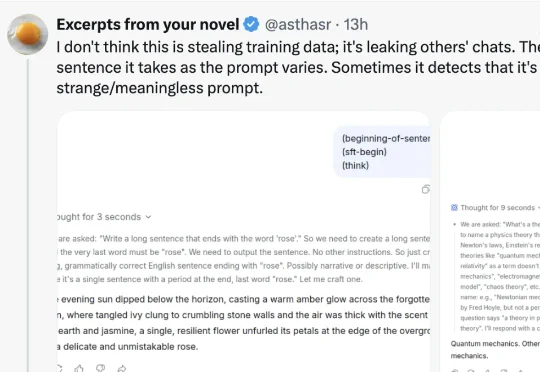

近日,有网友在 X 上发文称,在使用 DeepSeek 的过程中,如果在输入框内输入以下这一段内容,便可「窃取」到 DeepSeek 的训练数据:仔细看了之后发现,具体是这样的:只要你在输入框输入这一段提示词,DeepSeek 就会「吐出」一轮完整的对话记录,不过这并不是你的历史搜索记录,更像是一份随机的对话记录。

他人生最大的一次跨步是博士毕业,毅然决然离开深造9年的物理,来到崭新的AI行业。过去两年,他先后在Anthropic和Google DeepMind出任研究科学家,参与了Claude 3.7、4.5、Gemini 3等关键模型的开发过程。

DeepMind 刚上任的 AGI 经济学总监 Alex Imas 曾担忧 AI 导致失业和需求坍缩,如今提出一个谨慎乐观判断,AI 会压低可复制劳动价格,也会推高护理、教育、医疗、服务等关系型劳动的价值。

4月,DeepSeek(深度求索)罕见展开一场巨额融资计划,同时吸引了腾讯和阿里巴巴两家大厂。我们独家获悉,近期,阿里巴巴和DeepSeek谈崩了。一位接近DeepSeek的人士告诉我们,双方未能在融资具体条款上达成一致。一方面,阿里的自有生态对DeepSeek而言,适配度不高,而DeepSeek也不缺乏外部注资的候选股东,希望尽量减少条款层面的束缚。