谷歌Gemini 3杀疯了!陶哲轩亲测:10分钟干翻百年数学难题

谷歌Gemini 3杀疯了!陶哲轩亲测:10分钟干翻百年数学难题Gemini 3一日霸榜数学、物理两个顶级基准测试!与此同时,陶哲轩用Gemini DeepThink十分钟便搞定了一道埃尔德什难题。

Gemini 3一日霸榜数学、物理两个顶级基准测试!与此同时,陶哲轩用Gemini DeepThink十分钟便搞定了一道埃尔德什难题。

总部位于旧金山的初创公司 Deep Cogito 发布了其最新一代旗舰模型 Cogito v2.1 671B。公司 CEO Drishan Arora 在社交平台 X 上豪情万丈地宣布:“今天,我们发布了由美国公司制造的最好的开源大语言模型。”

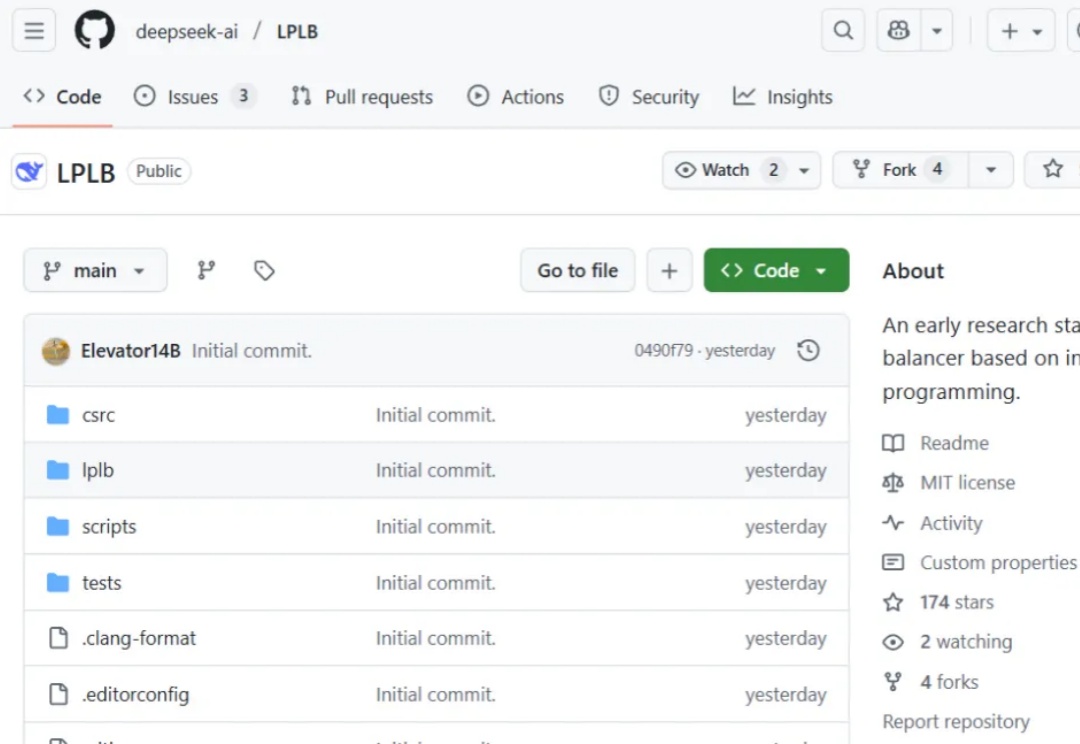

昨天,DeepSeek 在 GitHub 上线了一个新的代码库:LPLB。

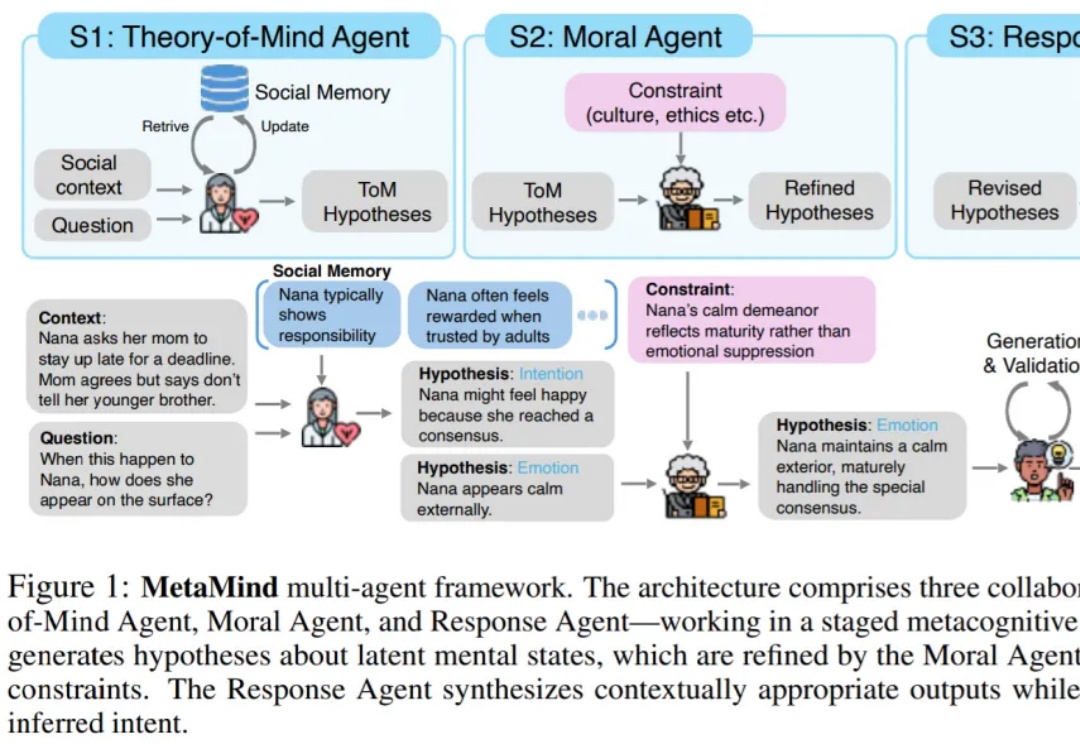

“What is meant often goes far beyond what is said, and that is what makes conversation possible.” ——H. P. Grice

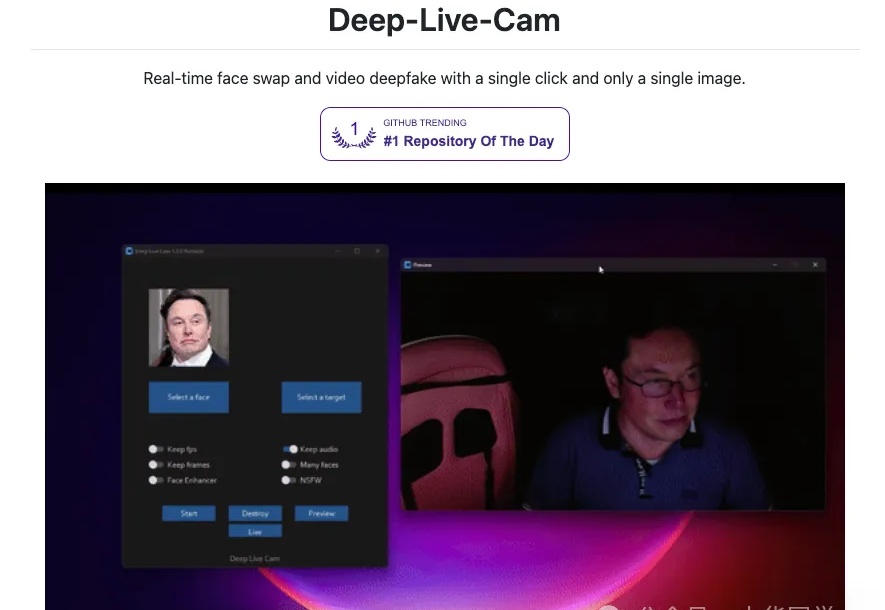

Deep-Live-Cam 是一款开源的实时换脸与视频深度伪造(deepfake)工具,只需要一张人脸图片,就能在本地电脑上对摄像头画面或视频进行实时换脸。 支持 Windows / Linux / macOS,多种硬件加速(CPU / CUDA / CoreML / DirectML / OpenVINO),并内置不良内容检测与合规提示,定位是服务 AI 生成媒体行业的高效生产力工具。

您的 AI 伙伴「游戏陪玩」版已上线。

11年前,谷歌收购DeepMind,花巨资买来一个「诺贝尔奖 + 顶级科学家 + 世界级实验室」,没想到却被OpenAI抢先推出ChatGPT,几乎动摇谷歌核心搜索业务,这一切背后的核心人物正是谷歌的AI掌门人哈萨比斯。

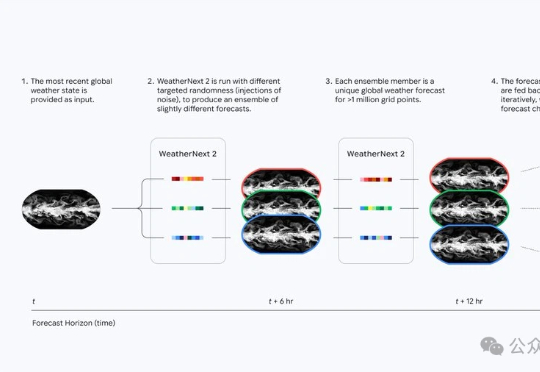

天气预报的时代真的变了。谷歌DeepMind最新发布的WeatherNext 2,让查天气这件事升级成了小时级、实时化。它的运行速度比上一代快8倍,分辨率提高到小时级,也就是说不再是传统预报里的“明天下午有雨”,而是可以细到“明天2–3点有小雨,3–4点雨势增强,5–6点逐渐停止”的节奏。

当美国巨头如Google、OpenAI 和 Anthropic 竞相开发支撑其 AI 产品的大型语言模型时,Sakana AI、Mistral AI、DeepSeek 和 AI21 Labs 等初创公司正凭借为特定地区、行业或独特功能设计的专业模型开辟自己的细分市场。

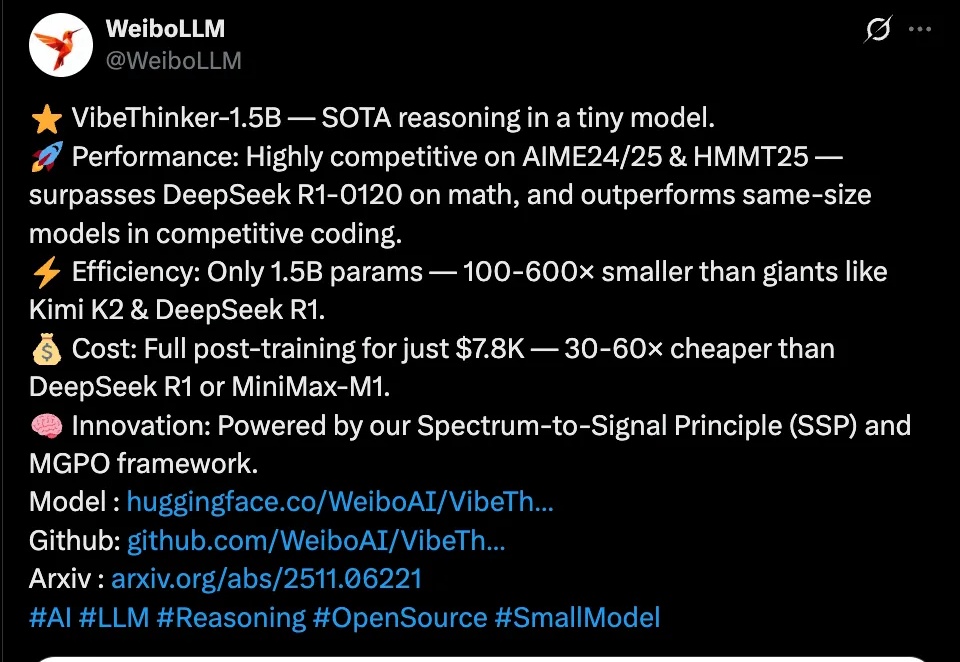

近日,微博正式发布首个自研开源大模型VibeThinker,这个仅拥有15亿参数的“轻量级选手”,在国际顶级数学竞赛基准测试上击败了参数量是其数百倍的、高达6710亿的DeepSeek R1模型。