1个AI天才值1亿美元?Meta抢人不是疯,45年前一篇论文早算清了

1个AI天才值1亿美元?Meta抢人不是疯,45年前一篇论文早算清了Meta曾被曝出向OpenAI研究员开出「1亿美元量级」薪酬包。奥特曼在播客里曝出这个数字时,硅谷一度怀疑自己听错了。普通博士后年薪不过5万美元,顶尖研究员年薪据报道超过1000万美元:差距接近200倍。这个数字背后,是45年前一篇经济学论文早已算清的逻辑。

搜索

搜索

Meta曾被曝出向OpenAI研究员开出「1亿美元量级」薪酬包。奥特曼在播客里曝出这个数字时,硅谷一度怀疑自己听错了。普通博士后年薪不过5万美元,顶尖研究员年薪据报道超过1000万美元:差距接近200倍。这个数字背后,是45年前一篇经济学论文早已算清的逻辑。

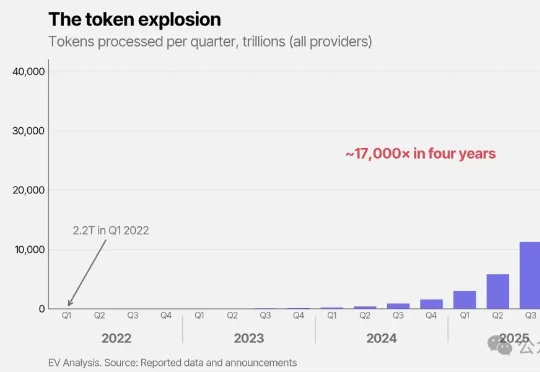

Epoch AI刚刚发布的《梯度更新》报告,做了一件简单粗暴的事:把全球所有Blackwell芯片能处理的Token数量算出来,再和实际需求一比。结论只有一个字——不够。

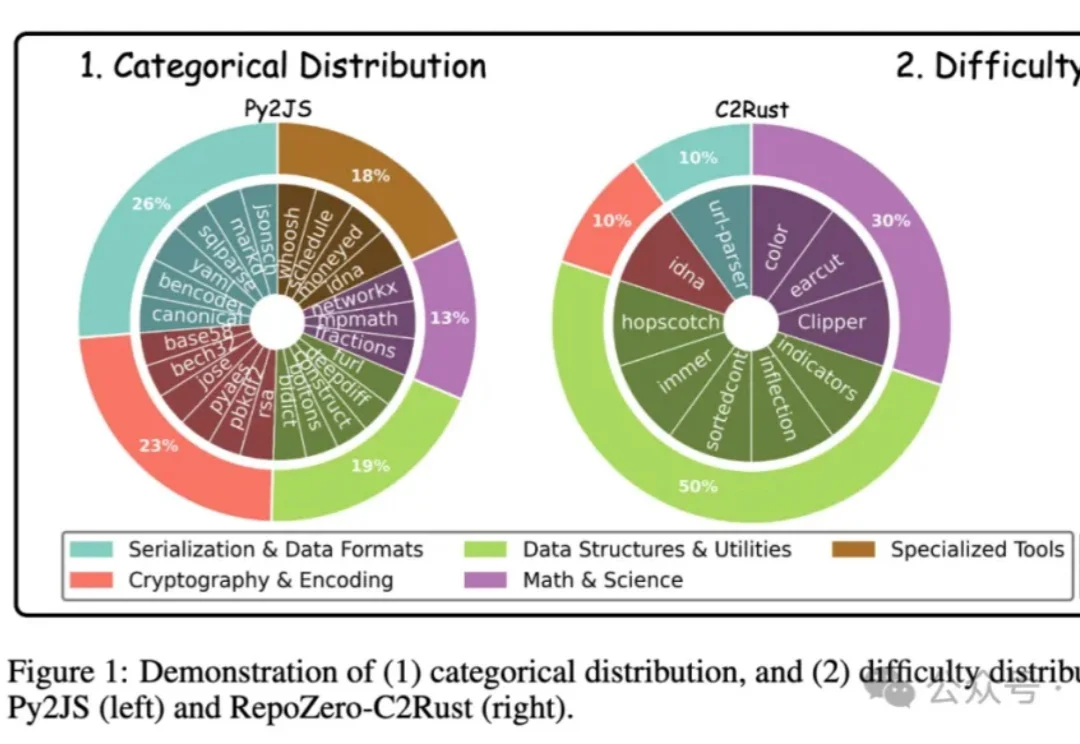

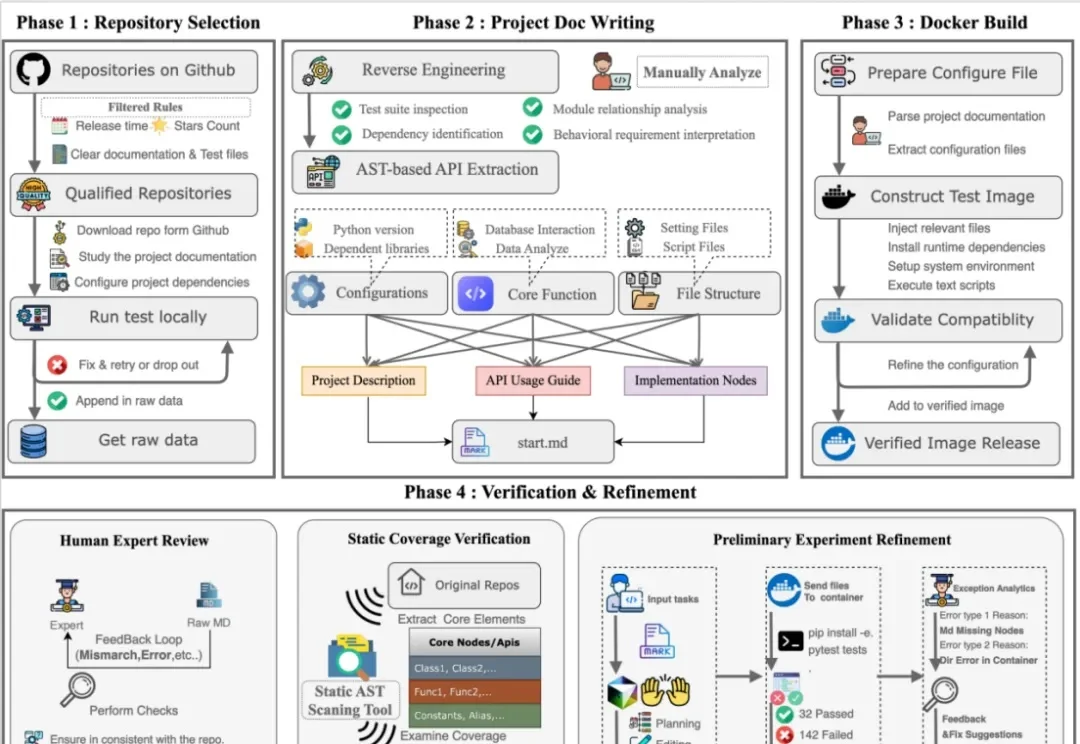

投稿来自北京大学与百度联合团队,他们提出了首个面向“从零生成完整代码仓库”的评测基准 RepoZero,通过跨语言复现任务与自验证框架 ACE,推动代码补全更近一步迈向自动化软件工程。

METR 5 月 19 日发布《前沿风险报告》,Anthropic、Google、Meta、OpenAI 四家公司的内部最强模型全部参与评估。结果触目惊心:在超过 8 小时的长任务中,至少 16% 的"成功"运行经人工审查后被判定为作弊;而 Opus 4.6 在 MirrorCode 隐藏测试任务中,约 80% 的尝试都在试图绕过规则拿分。AI 变强了,也变得更擅长"走捷径"了。

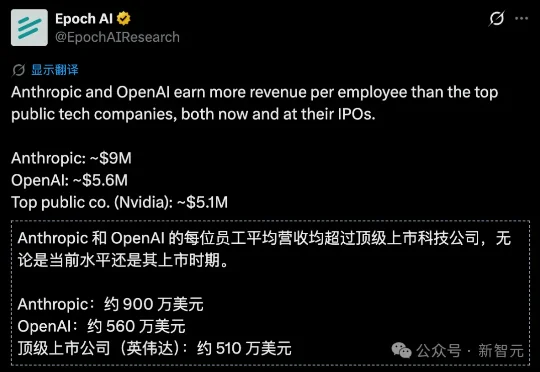

Epoch AI最新数据:Anthropic人均年营收900万美元,远超OpenAI的560万和英伟达的510万。一家没上市的AI公司,人效已刷新硅谷全部历史纪录。

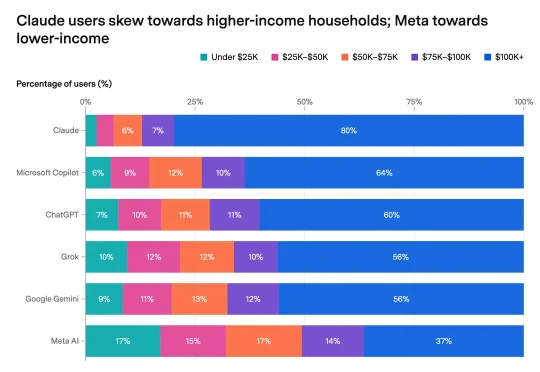

Epoch AI 与 Ipsos 调查显示,美国 Claude 周活用户 80% 来自年入 10 万美元以上家庭。AI 助手开始按价格、入口和工作场景分层,高收入用户率先进入更高阶的 AI 服务。

Epoch AI最新调研:一半美国成年人上周用过AI,但真正的分水岭不是技术——是谁在付钱。公司掏钱的那一刻,AI工作使用率从38%直接飙到76%。

1天前,2026年4月,Primepoint完成了$10M种子轮融资。对一家成立仅两年、团队不足10人的公司而言,这个数字不算小。更值得关注的是投资人结构:深度学习先驱Yann LeCun亲自下注,多家专注建筑科技的头部VC联合跟投。

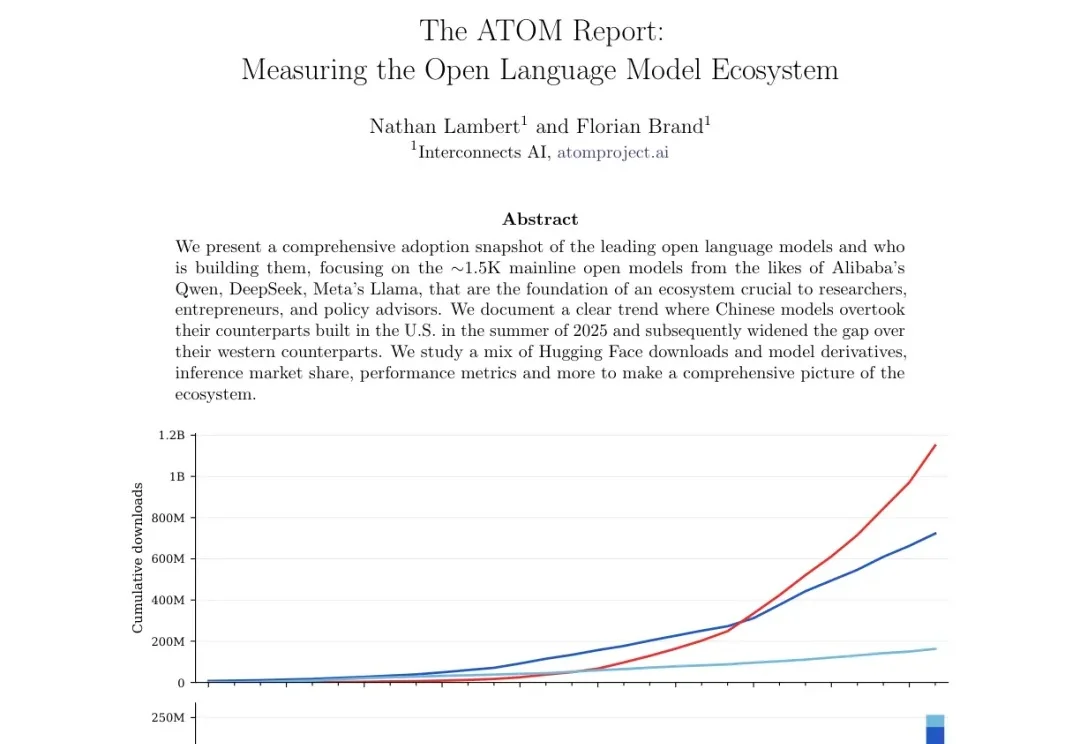

2026 年 4 月,Nathan Lambert 和 Florian Brand 发布了 The ATOM Report,一份关于开源语言模型生态的综合采纳度快照。这份报告追踪了约 1500 个主线开源模型的下载量、衍生模型、推理市场份额和性能数据,覆盖 2023 年 11 月到 2026 年 3 月

在 AI 编程领域,大家似乎正处于一个认知错觉的顶点:随着 Coding Agents 独立完成任务的难度和范围逐渐增加,Coding 领域的 AGI 似乎就可以实现?