黄仁勋105分钟对话实录:万亿美元这么赚!谈中国、H200、养虾、Groq,炮轰DLSS 5批评者

黄仁勋105分钟对话实录:万亿美元这么赚!谈中国、H200、养虾、Groq,炮轰DLSS 5批评者智东西3月17日圣何塞现场报道,在昨日发表GTC主题演讲后,今天,英伟达创始人兼CEO黄仁勋与智东西等全球媒体进行了长达近2小时的深度交流,连续回答32问,并透露面向中国市场的H200 GPU重启生产,已收到许多订单。

智东西3月17日圣何塞现场报道,在昨日发表GTC主题演讲后,今天,英伟达创始人兼CEO黄仁勋与智东西等全球媒体进行了长达近2小时的深度交流,连续回答32问,并透露面向中国市场的H200 GPU重启生产,已收到许多订单。

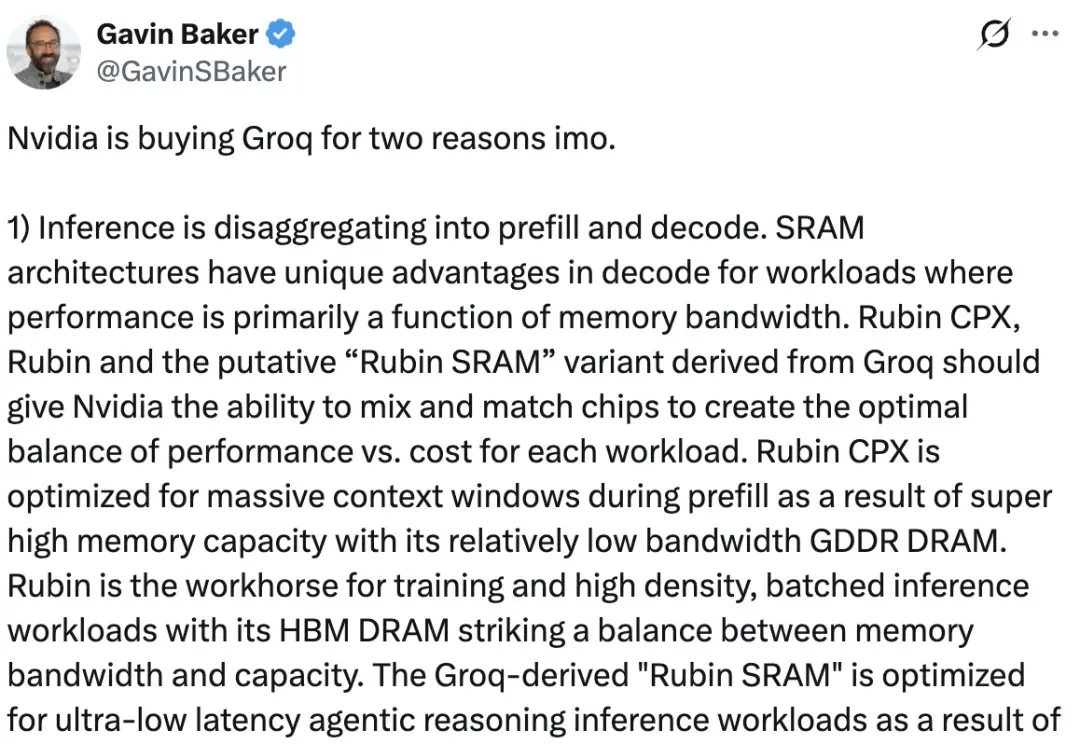

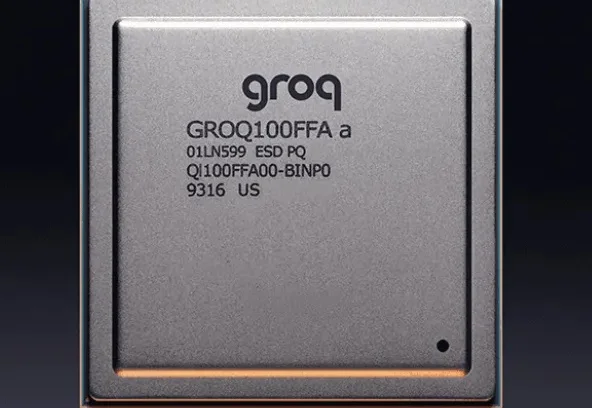

英伟达200亿美元「招安」Groq,推理芯片赛道一夜变天。但在大洋彼岸,一家北大系创业公司刚刚交出了自己的流片答卷。

据悉,在即将开幕的3月圣何塞GTC大会上,黄仁勋将发布一套全新的AI推理系统—— 核心是一颗专为推理优化的新芯片。而且芯片的首位大客户已经敲定,就是刚刚完成1100亿美元巨额融资的OpenAI。

Matt Shumer 是 AI 创业者和投资者,已在 AI 领域深耕超过 6 年。他是 OthersideAI 的联合创始人兼 CEO,同时通过个人投资基金 Shumer Capital 投资了 Groq、Etched、OpenRouter 等多家前沿 AI 初创公司。

更多英伟达收购「TPU之父」创业公司Groq的细节曝光了—— 主打一个黄仁勋BOSS直聘。

老黄稳准狠,谷歌的TPU威胁刚至,就钞能力回应了。

平安夜老黄没有休息,一项200亿美元创纪录芯片收购消息,轰动硅谷。

谷歌TPU团队原班人马组建,英伟达挑战者、AI芯片初创企业Groq又获融资。超出此前的6亿预期,此次融资高达7.5亿美元(约53亿人民币),Groq现估值69亿美元(约490亿人民币)。

OpenAI在LangSmith用户群中继续稳居最常使用的大语言模型供应商宝座,其使用率是排名第二的Ollama的六倍以上。开源模型的采用率有了显著增长,特别是Ollama和Groq两家公司,它们支持用户运行开源模型,并在今年成功跻身行业前五。

Groq又双叒给英伟达上压力了!不仅之前展现了每秒1256个token的破纪录输出速度,最新获得的一轮6.4亿美元融资更提供了在AI芯片领域挑战英伟达的底气。