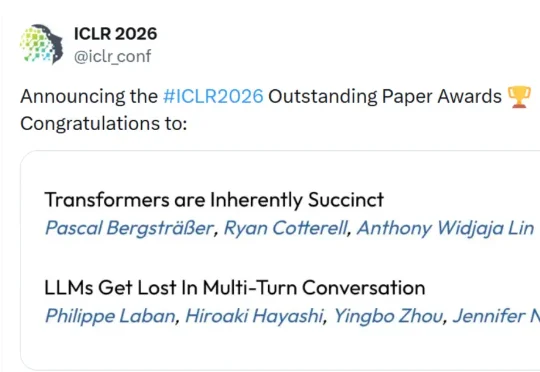

ICLR 2026获奖论文揭晓:两篇杰出论文,大神Alec Radford经典工作获时间检验奖

ICLR 2026获奖论文揭晓:两篇杰出论文,大神Alec Radford经典工作获时间检验奖机器之心编辑部 ICLR 2026 获奖论文已经公布。 今年共有 2 篇论文获得「杰出论文奖」(Outstanding Paper),另有 1 篇论文获得「荣誉提名」(Honorable Mention);此外,还有 2 篇 ICLR 2016 论文获得「时间检验奖」(Test of Time Award)。