Meta首款多模态Llama 3.2开源!1B羊驼宝宝,跑在手机上了

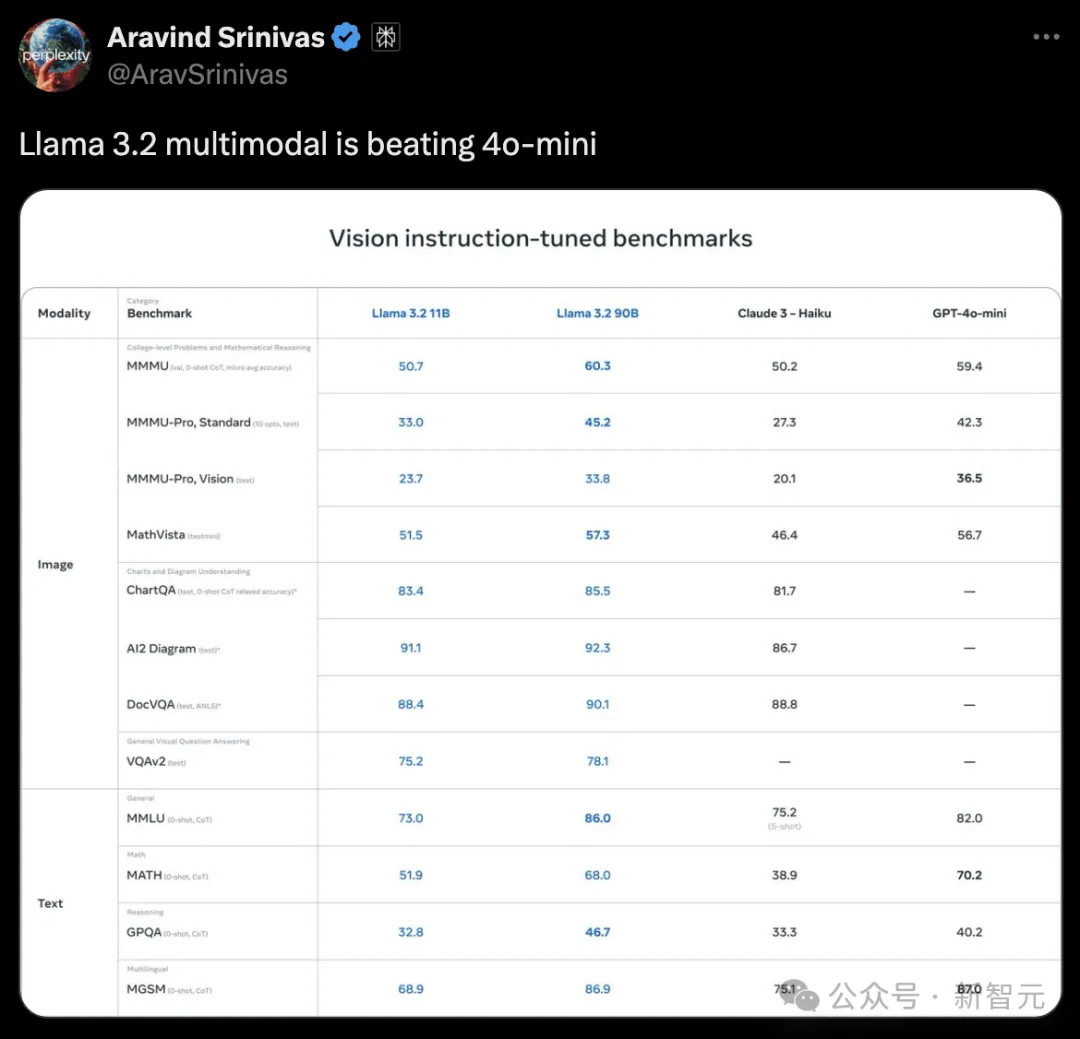

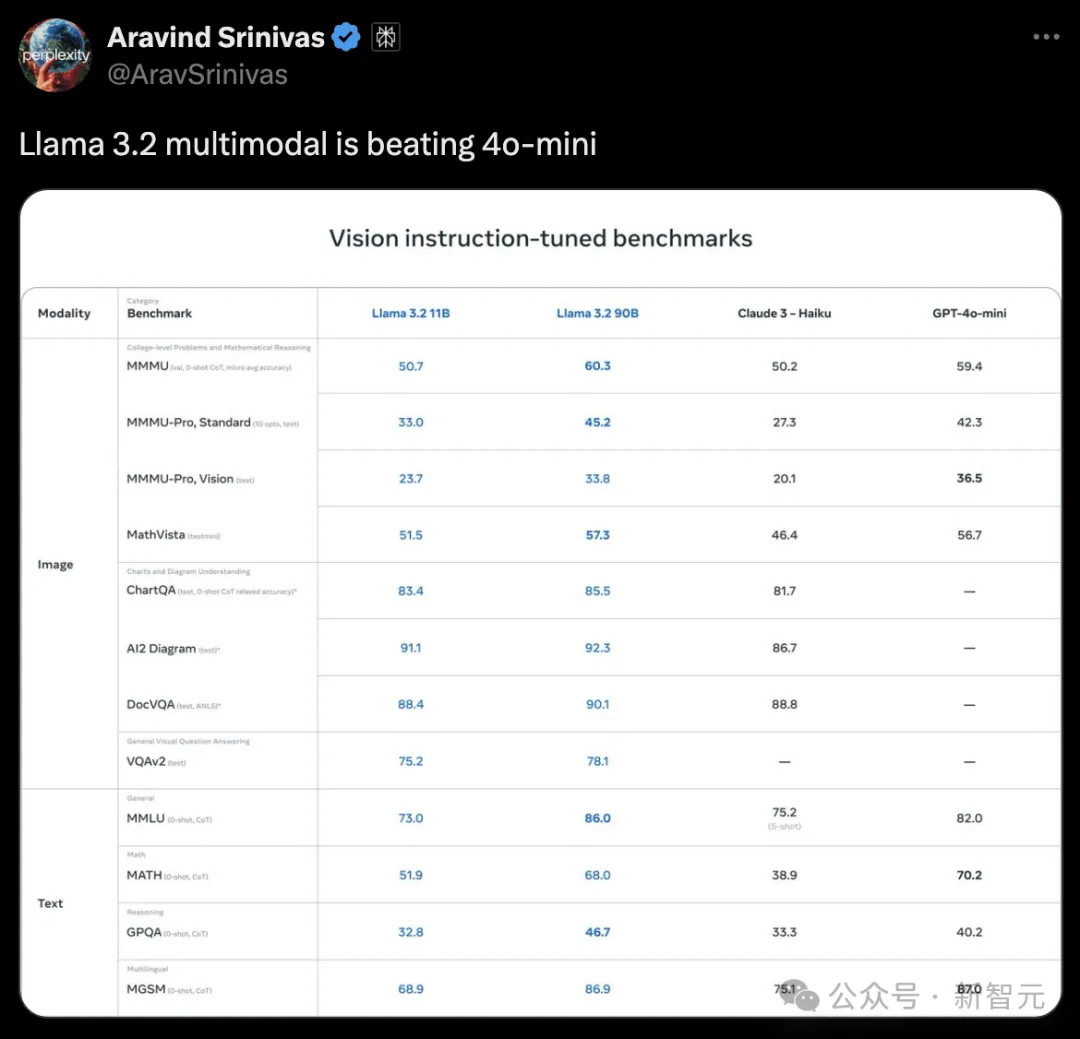

Meta首款多模态Llama 3.2开源!1B羊驼宝宝,跑在手机上了Meta首个理解图文的多模态Llama 3.2来了!这次,除了11B和90B两个基础版本,Meta还推出了仅有1B和3B轻量级版本,适配了Arm处理器,手机、AR眼镜边缘设备皆可用。

Meta首个理解图文的多模态Llama 3.2来了!这次,除了11B和90B两个基础版本,Meta还推出了仅有1B和3B轻量级版本,适配了Arm处理器,手机、AR眼镜边缘设备皆可用。

就在刚刚,小扎携掉最强AR眼镜Orion登场!Meta首款AR眼镜,苦研十年后,终于诞生了,成本高达10000美元。果然,小扎让我们离元宇宙又近了一步。这会是一次全新的范式转变吗?

Meta Connect 2024推出Quest 3S、Llama 3.2与AR眼镜Orion。

“可以肯定,明天对于AI开发者而言是个大日子。”

LLaMA-Omni能够接收语音指令,同步生成文本和语音响应,响应延迟低至 226ms,低于 GPT-4o 的平均音频响应延迟 320ms。

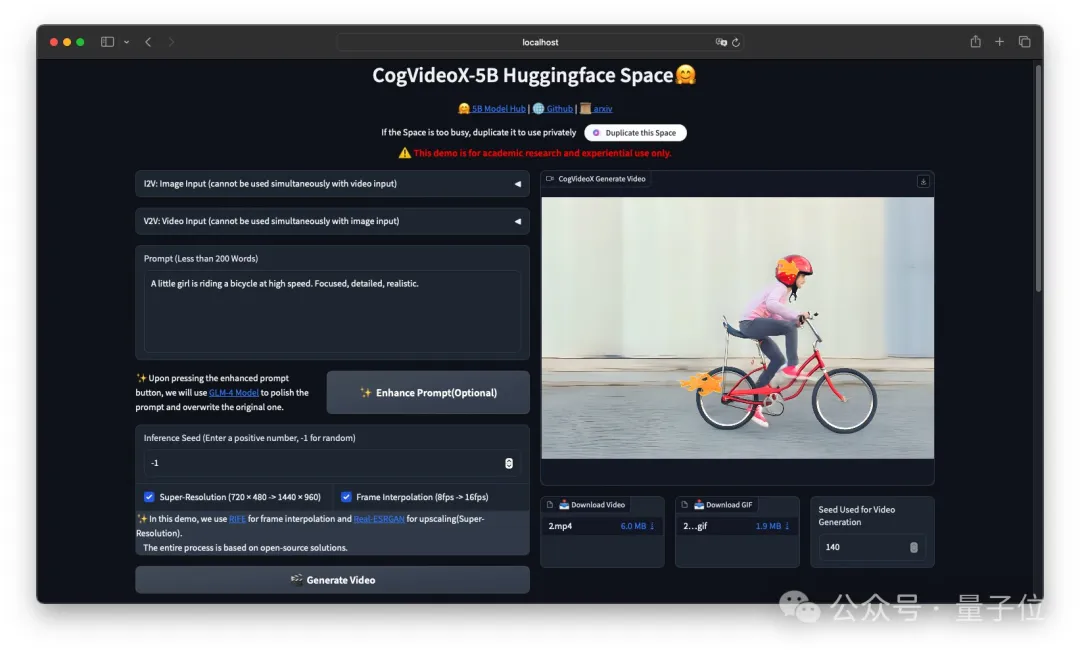

刚刚,智谱把清影背后的图生视频模型CogVideoX-5B-I2V给开源了!(在线可玩) 一起开源的还有它的标注模型cogvlm2-llama3-caption。

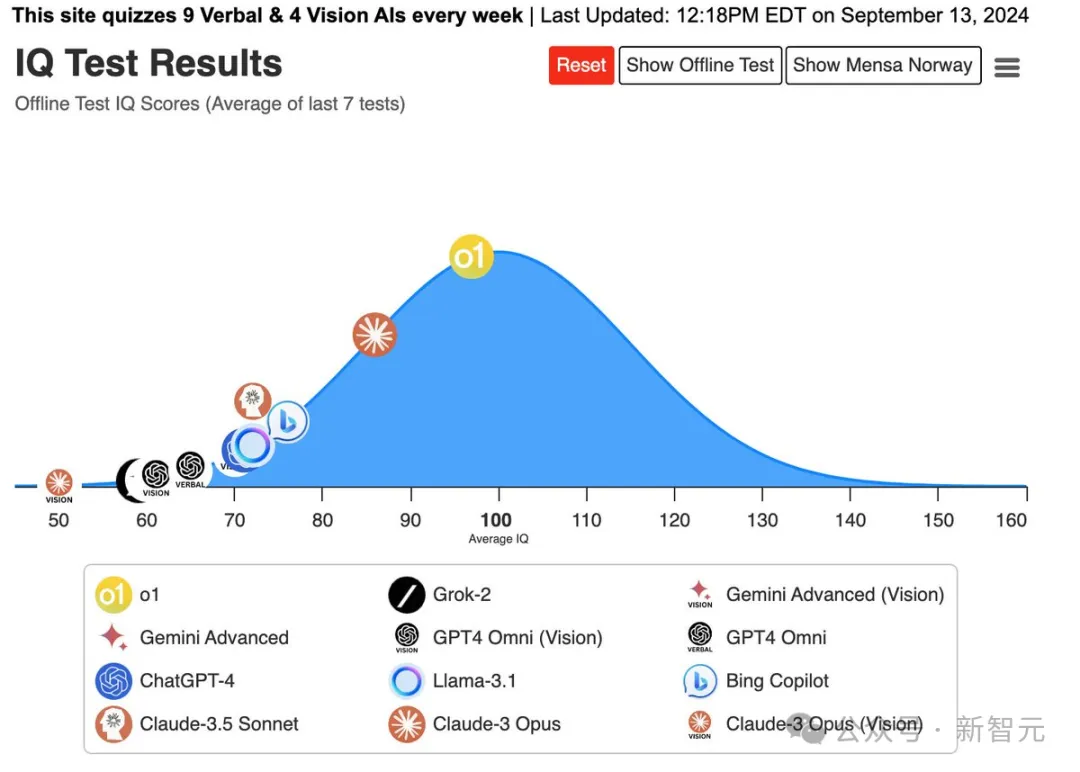

OpenAI o1,在IQ测试中拿到了第一名!大佬Maxim Lott,给o1、Claude-3 Opus、Gemini、GPT-4、Grok-2、Llama-3.1等进行了智商测试,结果表明,o1稳居第一名。

把Llama 3蒸馏到Mamba,推理速度最高可提升1.6倍!

如果可以使用世界上所有的算力来训练AI模型,会怎么样?近日,凭借发布了开源的Hermes 3(基于Llama 3.1)而引起广泛关注的Nous Research,再次宣布了一项重大突破——DisTrO(分布式互联网训练)。

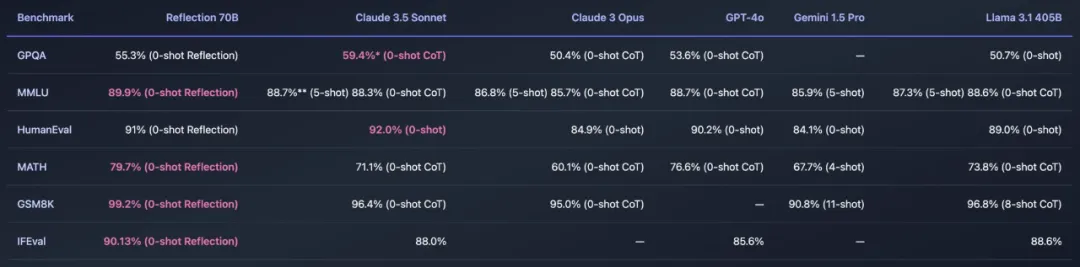

最近,开源大模型社区再次「热闹」了起来,主角是 AI 写作初创公司 HyperWrite 开发的新模型 Reflection 70B。