Linear-MoE:线性注意力遇上混合专家的开源实践

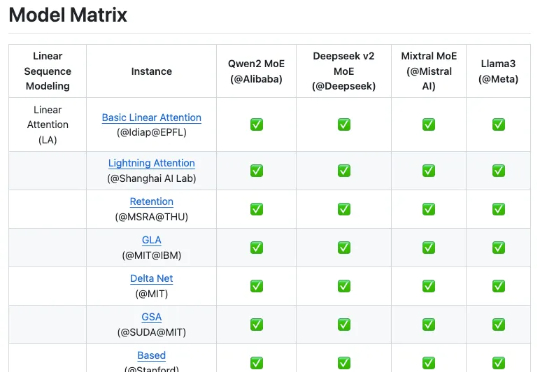

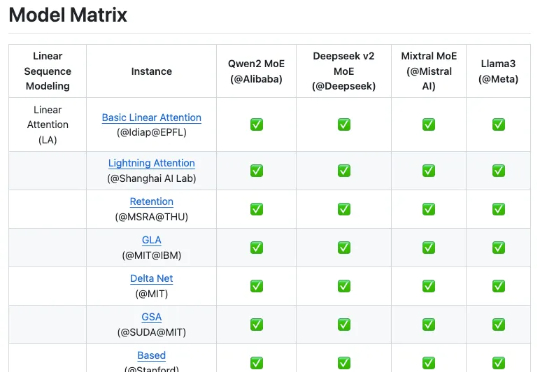

Linear-MoE:线性注意力遇上混合专家的开源实践来自上海人工智能实验室团队的最新成果 Linear-MoE,首次系统性地实现了线性序列建模与 MoE 的高效结合,并开源了完整的技术框架,包括 Modeling 和 Training 两大部分,并支持层间混合架构。为下一代基础模型架构的研发提供了有价值的工具和经验。

来自主题: AI技术研报

9634 点击 2025-05-30 12:03

搜索

搜索

来自上海人工智能实验室团队的最新成果 Linear-MoE,首次系统性地实现了线性序列建模与 MoE 的高效结合,并开源了完整的技术框架,包括 Modeling 和 Training 两大部分,并支持层间混合架构。为下一代基础模型架构的研发提供了有价值的工具和经验。

咱就是说啊,视觉基础模型这块儿,国产AI真就是上了个大分——Glint-MVT,来自格灵深瞳的最新成果。Glint-MVT,来自格灵深瞳的最新成果先来看下成绩——线性探测(LinearProbing):

智东西8月29日消息,瑞士轮腿式机器人创企Swiss-Mile今日宣布获得2200万美元种子轮融资,由亚马逊创始人杰夫·贝佐斯(Jeff Bezos)通过贝佐斯探险基金(Bezos Expeditions)和红杉资本领投,亚马逊产业创新基金、舰队投资(Armada Investment)以及现有投资者线性资本(Linear Capital)跟投。