突破短视频局限!MMBench 团队构建中长视频开放问答评测基准,全面评估多模态大模型视频理解能力

突破短视频局限!MMBench 团队构建中长视频开放问答评测基准,全面评估多模态大模型视频理解能力GPT-4o 四月发布会掀起了视频理解的热潮,而开源领军者Qwen2也对视频毫不手软,在各个视频评测基准上狠狠秀了一把肌肉。

来自主题: AI技术研报

4494 点击 2024-10-30 13:59

GPT-4o 四月发布会掀起了视频理解的热潮,而开源领军者Qwen2也对视频毫不手软,在各个视频评测基准上狠狠秀了一把肌肉。

又快又准,即插即用!清华8比特量化Attention,两倍加速于FlashAttention2,各端到端任务均不掉点!

欧洲的OpenAI,也不Open了。

实话说,我一直没想明白阿里为什么会在大模型这个赛道,成为中国版的Meta。

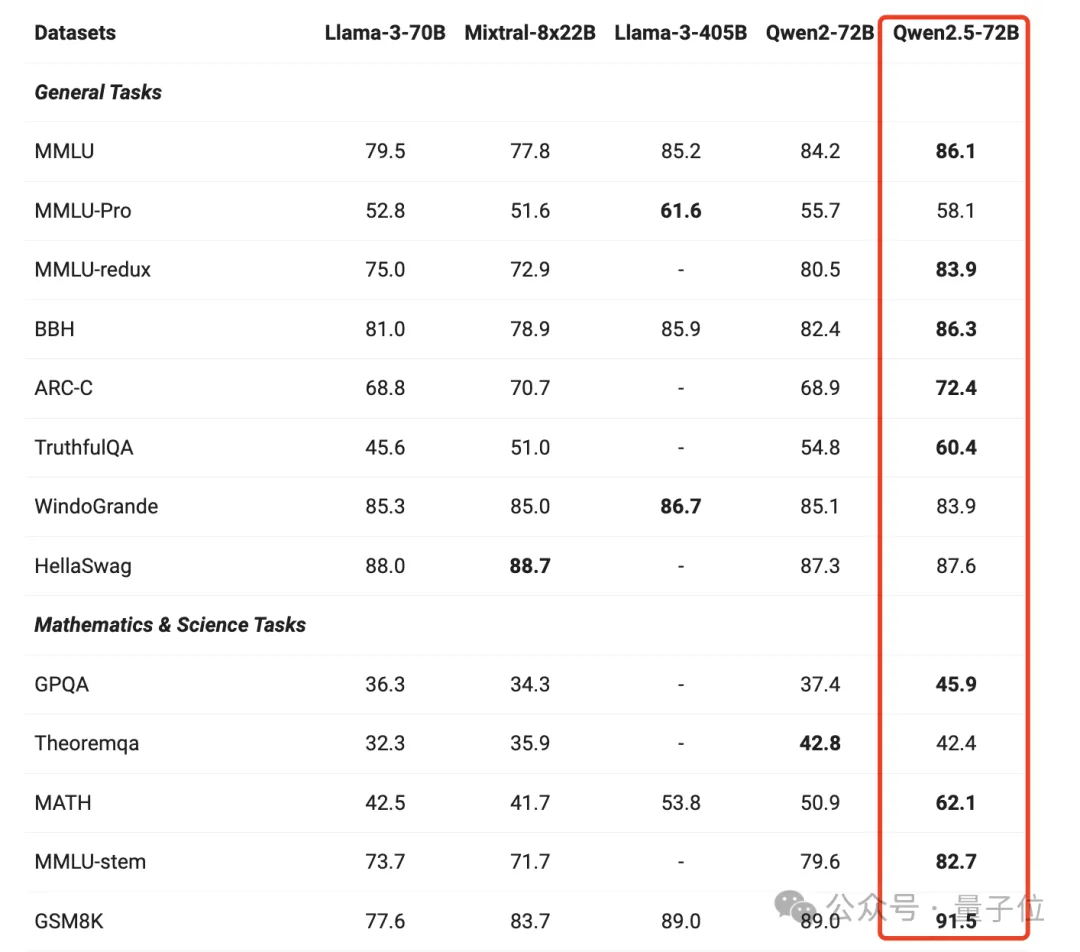

击败LIama3!Qwen2.5登上全球开源王座。 而后者仅以五分之一的参数规模,就在多任务中超越LIama3 405B。

一觉醒来,阿里Qwen的GitHub网页404了?!

还能玩纸牌游戏。

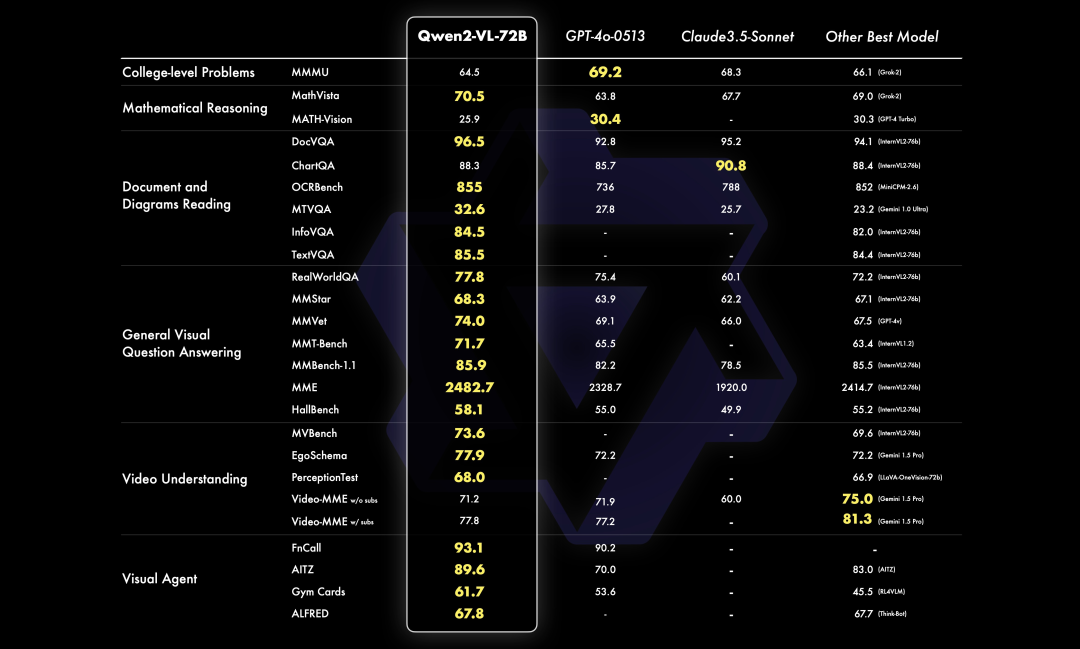

新的最强开源多模态大模型来了!

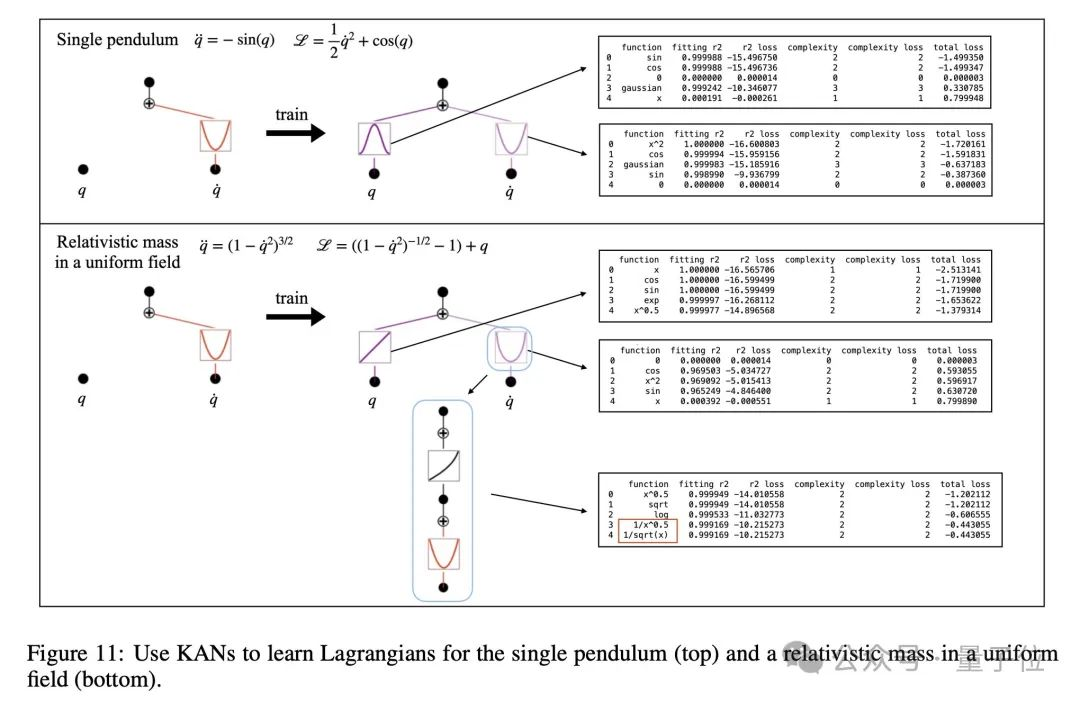

爆火神经网络架构KAN,上新了!

现在,最强数学大模型,人人都可上手玩了!