奥特曼急了!OpenAI稳坐三年的王座,刚刚被Anthropic踹下去了

奥特曼急了!OpenAI稳坐三年的王座,刚刚被Anthropic踹下去了就在刚刚,Claude把ChatGPT拉下马,Anthropic企业市占率首次登顶!Ramp数据显示,前者的34.4%首次反超OpenAI的32.3%。但Ramp经济学家直言,A厂目前还面临着三重困境,胜负仍未定。

搜索

搜索

就在刚刚,Claude把ChatGPT拉下马,Anthropic企业市占率首次登顶!Ramp数据显示,前者的34.4%首次反超OpenAI的32.3%。但Ramp经济学家直言,A厂目前还面临着三重困境,胜负仍未定。

这两天打开X,发现一个开源项目刷屏了——Hyperframes。GitHub上两天干了17.4k star,1.6k fork,Codex、Cursor、Claude Code的插件全线覆盖。

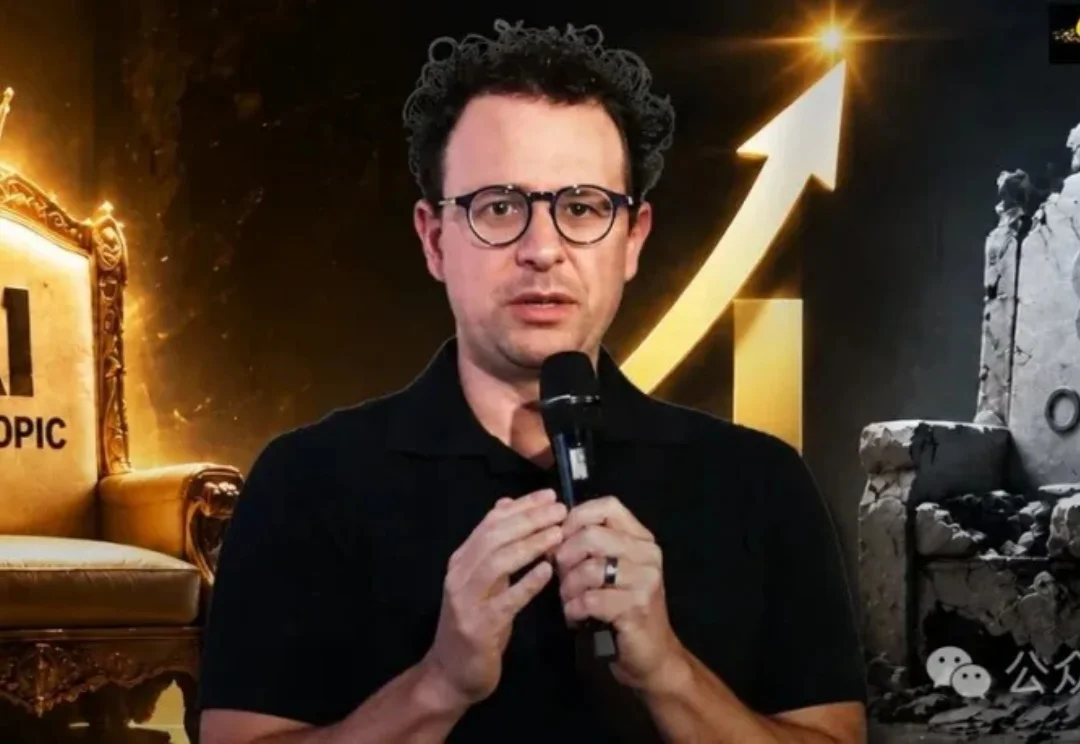

全网AI交白卷的地狱级基准,被GPT-5.5拿下一血!开局0源码盲写程序,拉满推理算力直接满血通关。传统代码测试已废,通往ASI的算力狂飙正式打响。

英伟达副总裁亲口承认AI算力账单超过员工工资。所有人都在抱怨AI贵,但很少有人追问一句:这些钱最后流到了哪里?一个答案是韩国。SK海力士Q1利润率72%;三星电子市值突破1万亿美元。这场盛宴的脚本,已经写到了2029年。

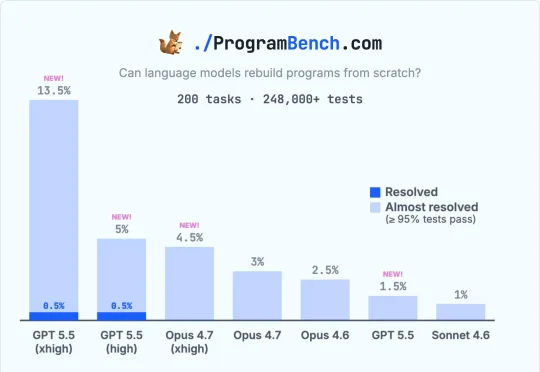

近日,由香港科技大学 MMLab 及合作团队完成的研究工作「UniVidX: A Unified Multimodal Framework for Versatile Video Generation via Diffusion Priors」被计算机图形学顶级会议 SIGGRAPH 2026 正式接收。

几天内席卷 Instagram 与 TikTok,海外播放突破 5000 万;用户可上传题目、选择喜欢的 AI Tutor 角色,并实时互动生成个性化视频讲解,让学习像刷短视频一样停不下来,验证了 AI-native 教育产品的新形态。

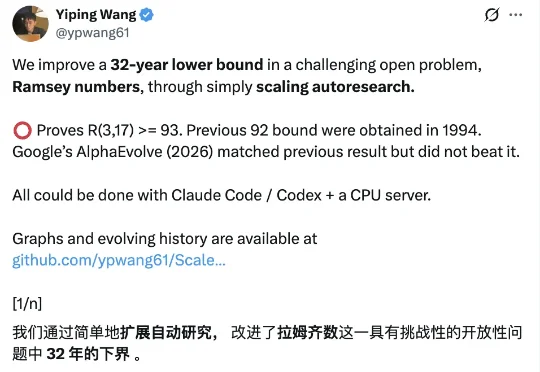

数学界尘封32年的拉姆齐数经典难题被打破!浙大校友王宜平借助自研AI框架ScaleAutoResearch-Ramsey,成功将拉姆齐数R(3,17) 下界从92提升至93,终结了自1994年以来长期停滞的纪录。

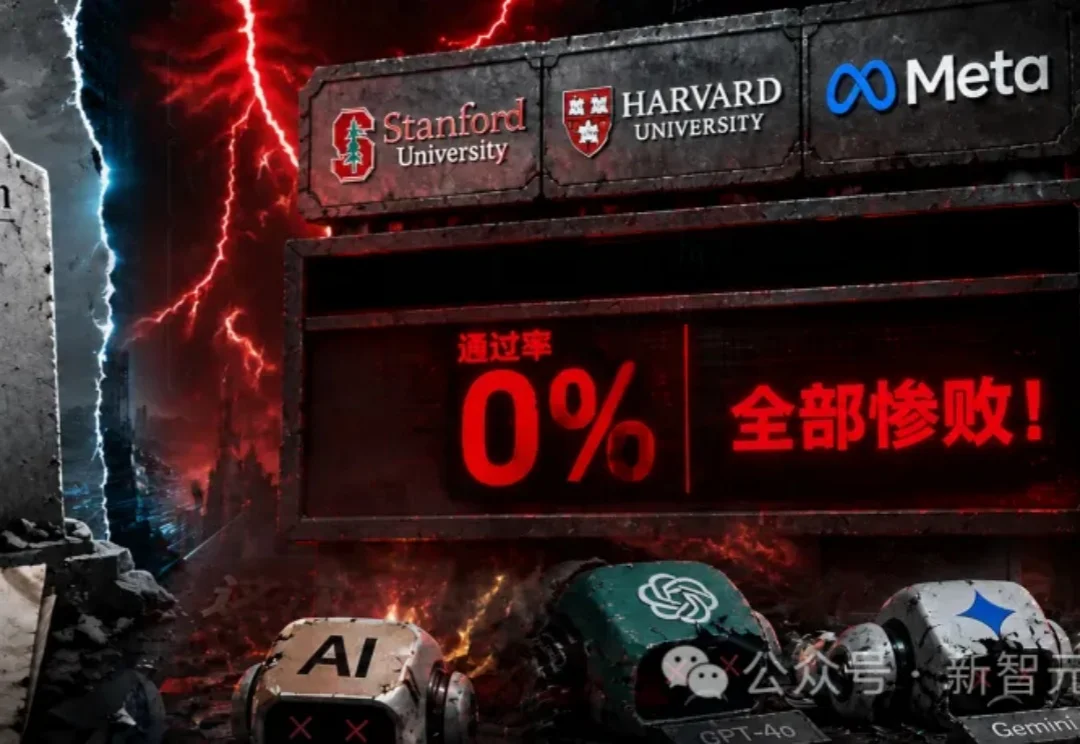

SWE-Bench上能拿72%的模型,换张考卷直接归零!Meta联合斯坦福、哈佛放出ProgramBench,200个项目从零手写,9大顶级模型完整通过率0%。最强的Claude Opus 4.7平均通过率也才51.2%。更离谱的是一联网,就有模型在36%的任务里跑去GitHub扒源码。

DeepSeekV4的技术报告里有mHC,有CSA,有HCA,有Muon,有FP4……唯独没有Engram。Engram在今年1月由DeepSeek和北大联合开源,主要研究大模型的记忆与效率问题。

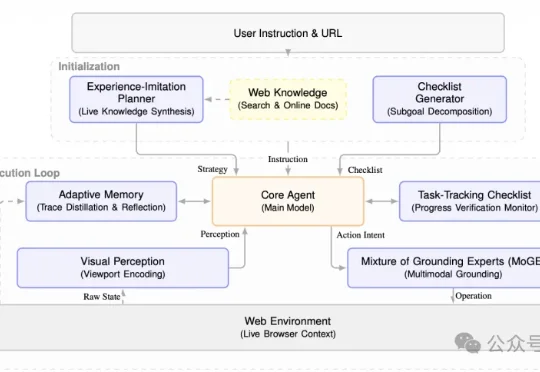

伦敦大学学院(UCL)、普林斯顿大学和爱丁堡大学的研究团队联合推出了Avenir-Web,让现有多模态模型像人类一样使用网页。现有的Web Agent在面对复杂的网页结构(如 iframe、Shadow DOM)时,往往会陷入“定位不准”“缺乏常识”或“走着走着就忘了”的窘境。