月访问7万、年化GMV可能30万美元:拆解一个不卖照片的AI小产品

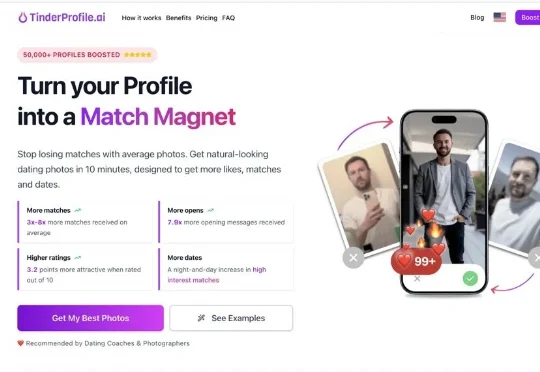

月访问7万、年化GMV可能30万美元:拆解一个不卖照片的AI小产品今天拆一个很典型的 AI 小产品:TinderProfile.ai。它的官网一句话非常直接:上传 2-5 张普通自拍,AI 在 10 分钟内生成更适合 Tinder、Bumble、Hinge 的约会头像,帮你获得更多匹配。

搜索

搜索

今天拆一个很典型的 AI 小产品:TinderProfile.ai。它的官网一句话非常直接:上传 2-5 张普通自拍,AI 在 10 分钟内生成更适合 Tinder、Bumble、Hinge 的约会头像,帮你获得更多匹配。

Anthropic宣布与SpaceX达成合作协议,将大幅提升算力储备。受此影响,Claude Code和Claude API的使用限制即日起全面上调。第一,Claude Code的5小时频率限制翻倍,适用于Pro、Max、Team以及按席位计费的Enterprise方案。

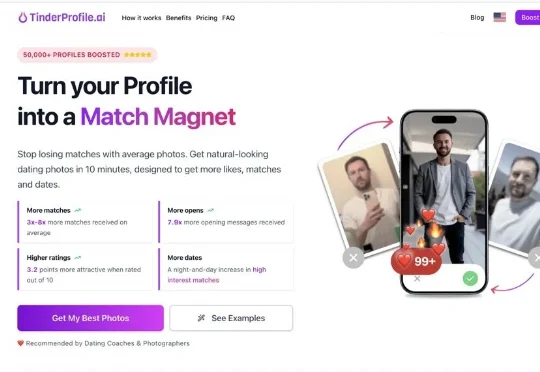

Anthropic 4 月 10 日发布 Claude for Word 公测版,第一批只开给 Team 和 Enterprise 用户

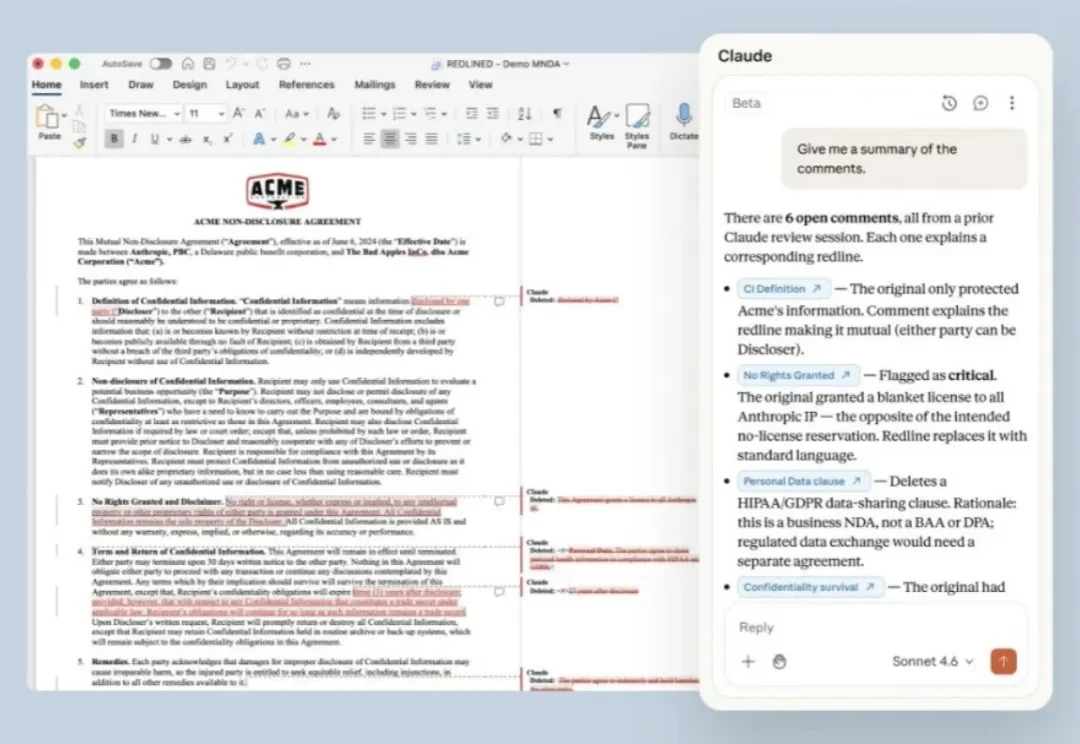

Claude Code 今天上了一个新能力:Routines,面向 Pro、Max、Team 和 Enterprise 用户开放

什么样的思维链,能「教会」学生更好地推理?

过去几年,机制可解释性(Mechanistic Interpretability)让研究者得以在 Transformer 这一 “黑盒” 里追踪信息如何流动、表征如何形成:从单个神经元到注意力头,再到跨层电路。但在很多场景里,研究者真正关心的不只是 “模型为什么这么答”,还包括 “能不能更稳、更准、更省,更安全”。

随着大语言模型(LLM)的商业价值快速提升,其昂贵的训练成本使得模型版权保护(IP Protection)成为业界关注的焦点。然而,现有模型版权验证手段(如模型指纹)往往忽略一个关键威胁:攻击者一旦直接窃取模型权重,即拥有对模型的完全控制权,能够逆向指纹 / 水印,或通过修改输出内容绕过指纹验证。

在大模型研究领域,做混合专家模型(MoE)的团队很多,但专注机制可解释性(Mechanistic Interpretability)的却寥寥无几 —— 而将二者深度结合,从底层机制理解复杂推理过程的工作,更是凤毛麟角。

AI语音成大厂必争之地 打开字节、阿里们的多模态能力地图,每块宝藏都标着"语音”。

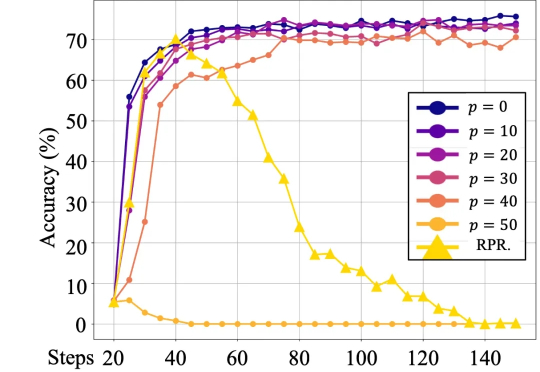

最近的一篇论文中,来自人大和腾讯的研究者们的研究表明,语言模型对强化学习中的奖励噪音具有鲁棒性,即使翻转相当一部分的奖励(例如,正确答案得 0 分,错误答案得 1 分),也不会显著影响下游任务的表现。