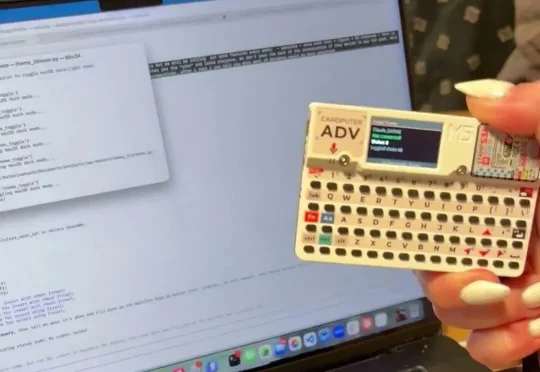

Claude 活动上这台巴掌大的电脑,被玩疯了

Claude 活动上这台巴掌大的电脑,被玩疯了你可以直接跟 Claude 说想做什么,它帮你写代码、刷固件、装应用,几分钟之后,这台信用卡大小的设备就跑起了你要的东西。这台小设备叫 M5Stack Cardputer ADV,基于 ESP32-S3 芯片,真的只有信用卡那么大。

搜索

搜索

你可以直接跟 Claude 说想做什么,它帮你写代码、刷固件、装应用,几分钟之后,这台信用卡大小的设备就跑起了你要的东西。这台小设备叫 M5Stack Cardputer ADV,基于 ESP32-S3 芯片,真的只有信用卡那么大。

回到2024 年,科技圈最热闹的两场发布会,分别属于 Humane 和 Rabbit:一个做了别在胸口的 AI 徽章,一个做了揣进口袋的 AI 小方块。这两家公司的产品一度引发热潮和想象:AI 硬件的

AI科技评论独家获悉,卡内基梅隆⼤学机器⼈研究院(CMURI)博⼠后、悉尼⼤学(USYD)⻓聘助理教授WilliamZhi联合创办具⾝智能公司⸺ZenoAI(芝诺机器⼈),致⼒于打造通⽤全栈物理智能(Full-stackPhysicalAI),提供可靠的全⾝灵巧操作解决⽅案。

StackChan是一款基于乐鑫ESP32-S3物联网芯片的开源AI桌面机器人,内置了AI Agent,支持视频通话、远程遥控智能家居设备,可以陪你玩,陪你聊,还支持开源共创与DIY扩展,配合App与开源生态,你可以把它养成最符合你风格的桌面搭子。

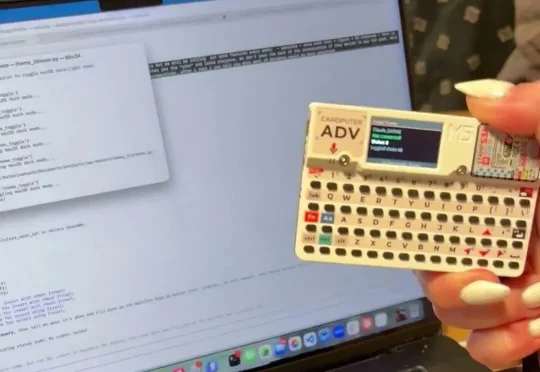

今天 Interesting Engineering++ 发了一篇长文,把这些系统放在同一个分析框架里做了横评,回答的就是这些问题。原文地址:interestingengineering.substack.com/p/the-loop-is-the-lab

我最近感到最难受的事情是,若干人炒作自己一天能花几十亿token,几天拿AI写出几十万行代码。

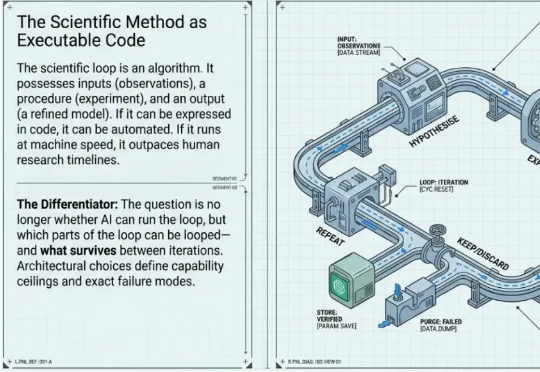

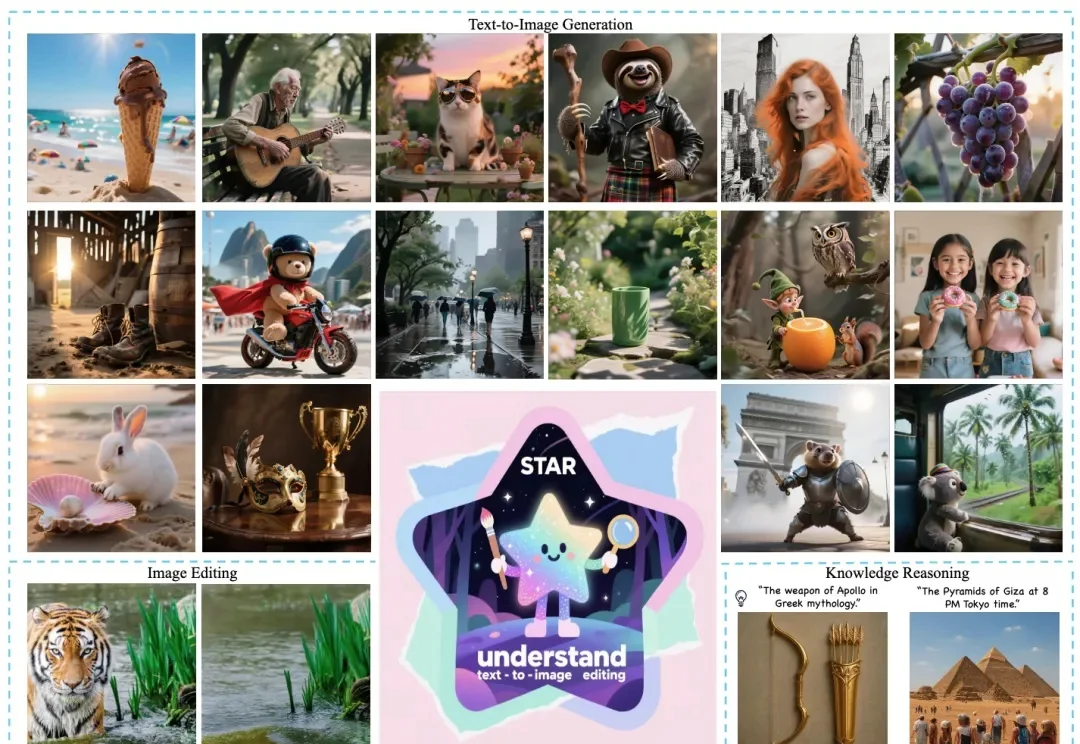

近日,美团推出全新多模态统一大模型方案 STAR(STacked AutoRegressive Scheme for Unified Multimodal Learning),凭借创新的 "堆叠自回归架构 + 任务递进训练" 双核心设计,实现了 "理解能力不打折、生成能力达顶尖" 的双重突破。

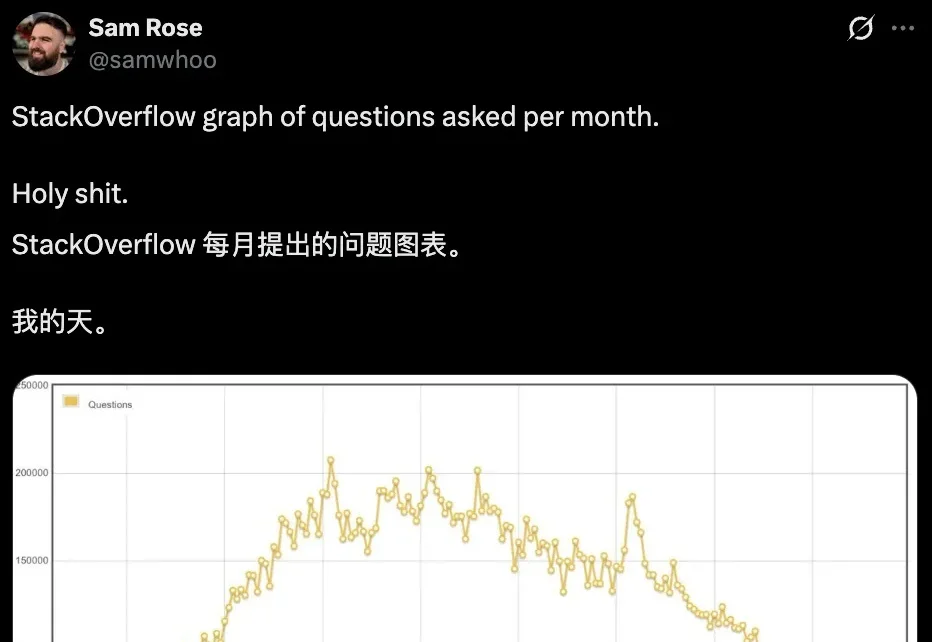

比诞生之初还冷清,Stack Overflow彻底凉透了!

Stack Overflow的2025年度开发者调查报告,揭开了AI狂欢背后的冷峻现实:84%的开发者已将其纳入工作流,但对AI的好感度却罕见暴跌!更扎心的是,66%的人被「似是而非」的AI代码折磨,调试耗时甚至超过手写。

为了打破英伟达的算力垄断,谷歌正在扶持云服务商Fluidstack分发自研TPU芯片,目前该公司正洽谈一轮7亿美元的巨额融资。最有意思的是,本轮融资的潜在领投方,竟是被OpenAI「扫地出门」的天才研究员阿申布伦纳。在这场算力豪赌中,谷歌的野心、前OpenAI核心成员的复仇与资本的狂热正交织在一起。