龙虾也能养龙虾!UCSD发布AIBuildAI智能体,MLE-Bench榜单第一

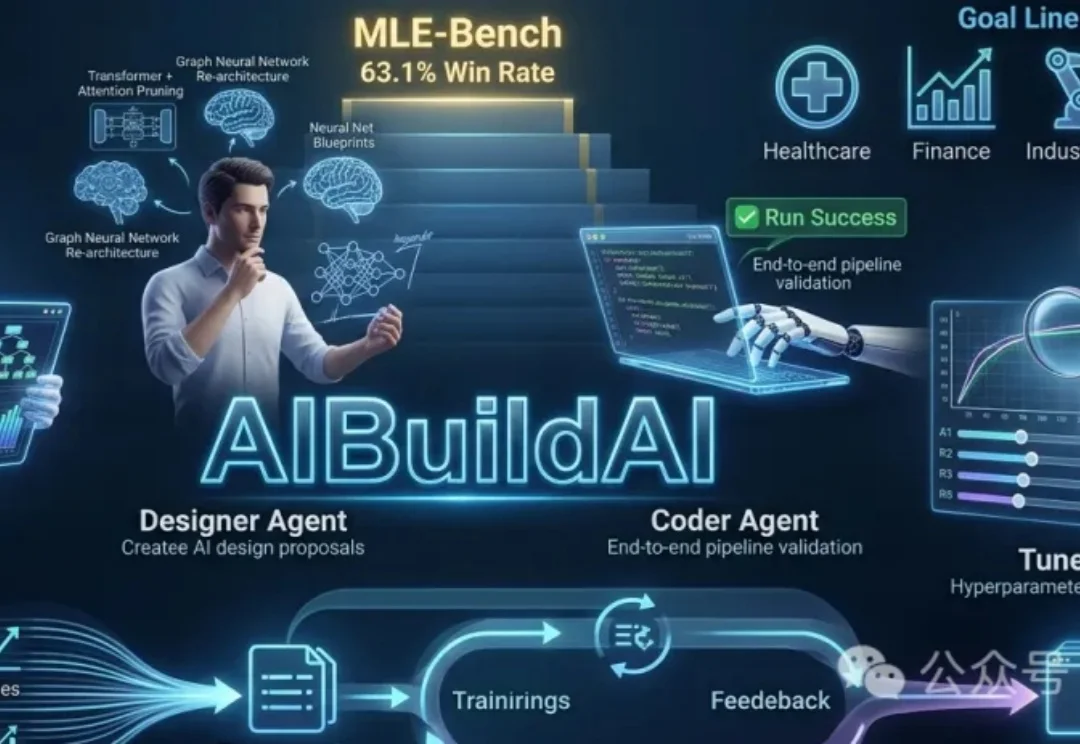

龙虾也能养龙虾!UCSD发布AIBuildAI智能体,MLE-Bench榜单第一UCSD团队推出AIBuildAI智能体,无需编程,仅用自然语言描述任务,即可自动设计、编码、训练、调参并优化AI模型,分工协作,端到端完成AI开发。在OpenAI MLE-Bench测试中,AIBuildAI以63.1%的获奖率位居第一,性能媲美人类专家,推动AI开发迈向全自动化新时代。

搜索

搜索

UCSD团队推出AIBuildAI智能体,无需编程,仅用自然语言描述任务,即可自动设计、编码、训练、调参并优化AI模型,分工协作,端到端完成AI开发。在OpenAI MLE-Bench测试中,AIBuildAI以63.1%的获奖率位居第一,性能媲美人类专家,推动AI开发迈向全自动化新时代。

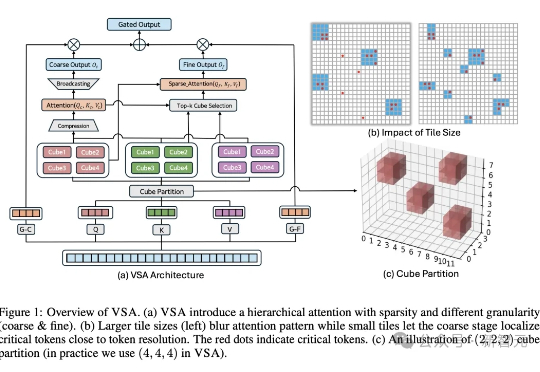

长期以来,计算机视觉领域陷入了一个 “表征(Representation)” 的执念。我们习惯设计各种精巧的 Encoder,试图将动态世界压缩成一组特征向量。然而,视频作为现实的高维投影,其熵值之高、动态之复杂,让这种试图 “定格” 的表征显得力不从心。

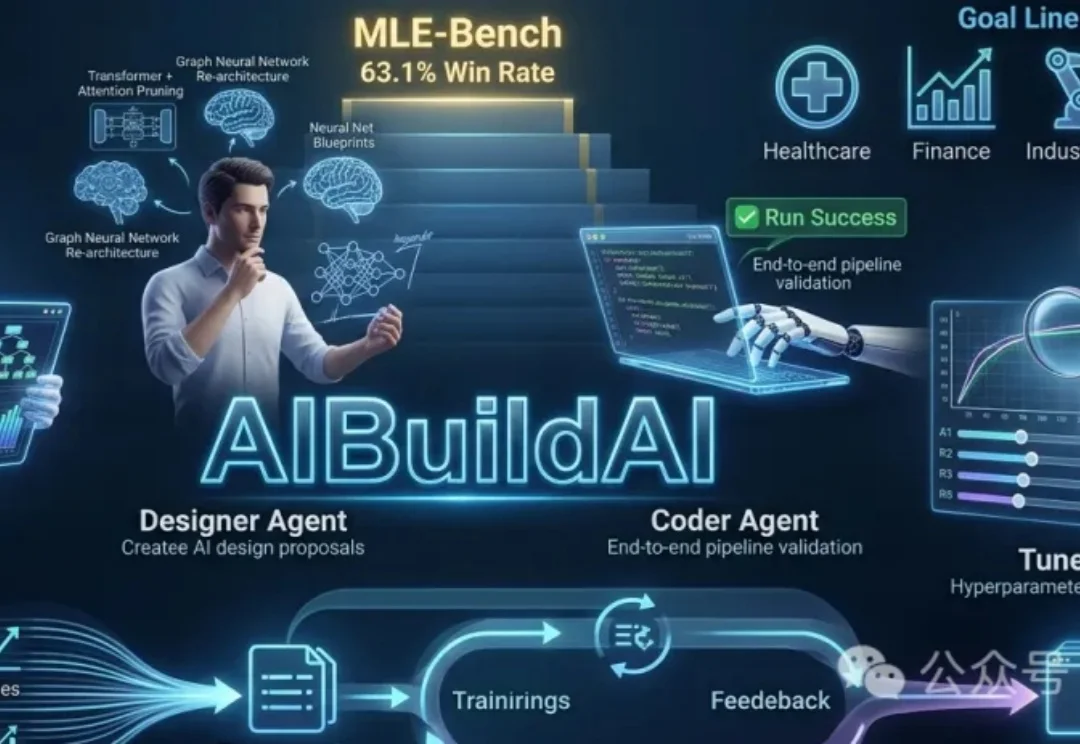

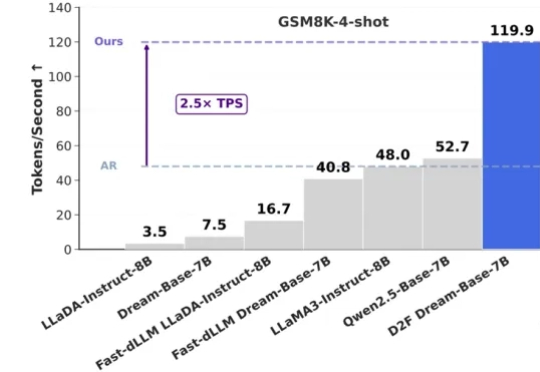

在大语言模型(LLM)落地应用中,推理速度始终是制约效率的核心瓶颈。传统自回归(AR)解码虽能保证生成质量,却需逐 token 串行计算,速度极为缓慢;扩散型 LLM(dLLMs)虽支持并行解码,却面

美国加州大学圣地亚哥分校(UCSD)徐升教授对 DeepTech 表示:“很荣幸我们的工作成为 Nature Sensors 期刊的首篇论文,我们第一次通过 AI 的方法实现了在动态下抗运动伪影的人机交互,应用场景包括可穿戴和移动设备的手势控制、机器人遥操作、AR/VR 动作追踪、游戏、康复与辅助设备、工业与军事训练、健康与运动监测、

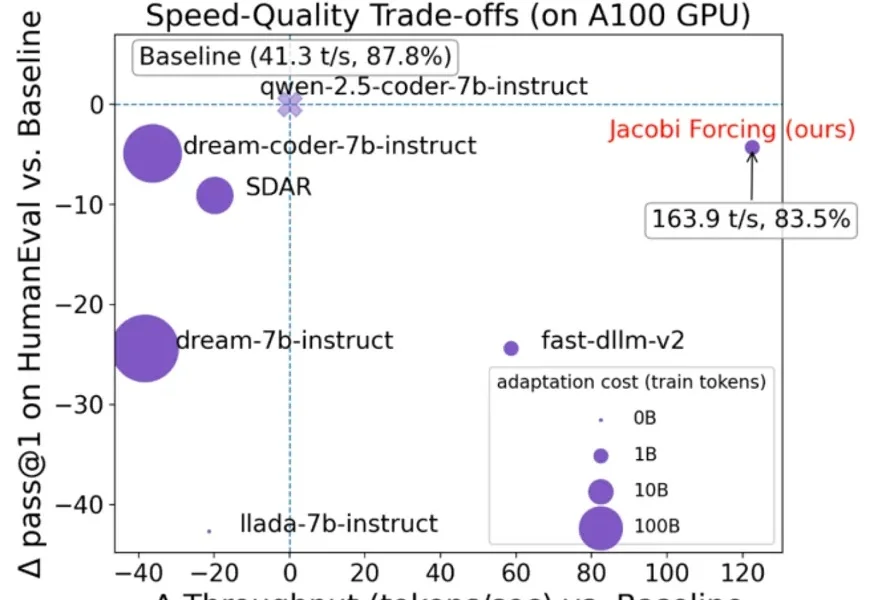

现有的LLM智能体训练框架都是针对单智能体的,多智能体的“群体强化”仍是一个亟须解决的问题。为了解决这一领域的研究痛点,来自UCSD和英特尔的研究人员,提出了新的提出通用化多智能体强化学习框架——PettingLLMs。支持任意组合的多个LLM一起训练。

来自加州大学圣地亚哥分校(UCSD)的华人学者Wanda Hou,与加州大学伯克利分校以及Google Quantum AI合作,在谷歌的Sycamore与Willow超导量子处理器上完成了一次别开生面的实验。

加州大学最新推出Orca浏览器,把拥挤标签页变成可随意拖拽、并排比较的无限画布,让AI替你同时点按钮、填表单。你只需像指挥家一样扫一眼全局、下指令,就能让上百个网页和智能体自动完成搜索、整理、汇总,全程可控。

在大语言模型(LLMs)领域,自回归(AR)范式长期占据主导地位,但其逐 token 生成也带来了固有的推理效率瓶颈。此前,谷歌的 Gemini Diffusion 和字节的 Seed Diffusion 以每秒千余 Tokens 的惊人吞吐量,向业界展现了扩散大语言模型(dLLMs)在推理速度上的巨大潜力。

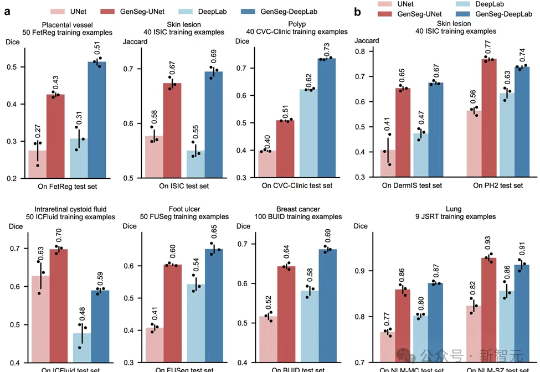

GenSeg用AI生成高质量医学图像及对应分割标注,在仅有几十张样本时也能训练出媲美传统深度模型的分割系统,显著降低医生手工标注负担。

AI视频生成进入了秒生极速时代!UCSD等机构发布的FastWan系模型,在一张H200上,实现了5秒即生视频。稀疏蒸馏,让去噪时间大减,刷新SOTA。