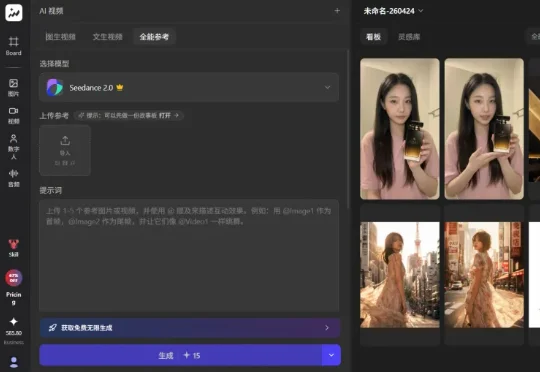

满血版 Seedance 2.0 的成本被 Topview 打下来了!

满血版 Seedance 2.0 的成本被 Topview 打下来了!做过 AI 视频的都懂,除了 Seedance 2.0 本身的高定价,废片所烧掉的 token 算力也是一笔不小的开支。但在 Topview 平台,直接把这笔最大试错成本给重新定义了!热门视频生成模型 Seedance 2.0,加上最新的图片生成模型 Image 2,订阅 Ultra Plan,可不限量使用。

搜索

搜索

做过 AI 视频的都懂,除了 Seedance 2.0 本身的高定价,废片所烧掉的 token 算力也是一笔不小的开支。但在 Topview 平台,直接把这笔最大试错成本给重新定义了!热门视频生成模型 Seedance 2.0,加上最新的图片生成模型 Image 2,订阅 Ultra Plan,可不限量使用。

今天介绍 Claude Code 上线的一个新功能:/ultrareview。一句话概括:它会在云端同时派出多个 AI 审查员,帮你在合并代码之前把 Bug 揪出来。这个功能其实在上周 Claude Opus 4.7 发布时就提到了,当时 Anthropic 在发布公告里写的是:

如果你看过最近的人形机器人演示,大概率会被它们的运动能力震撼到。

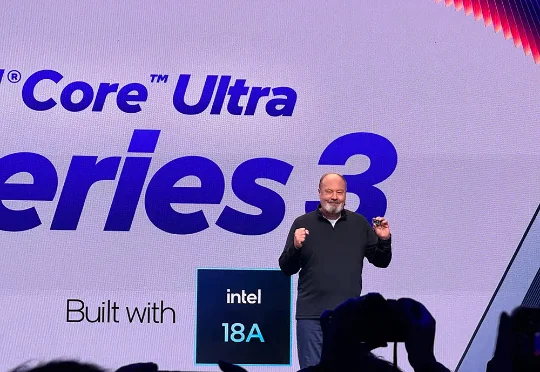

英特尔,真是越来越会玩了—— 因为它把优化CPU这件事的痛点,直接搞得像送外卖似的:

Claude Code 今天上了个新功能叫 /ultraplan,做的事情很好理解:在动手写代码之前,先在网页上给你看一份完整的实施方案。你可以读,可以改,甚至可以在方案里给 Claude 留评论。觉得没问题了,点一下「批准」,Claude 才开始动手。

告别Token老虎,给大模型来了个“减脂增肌”。

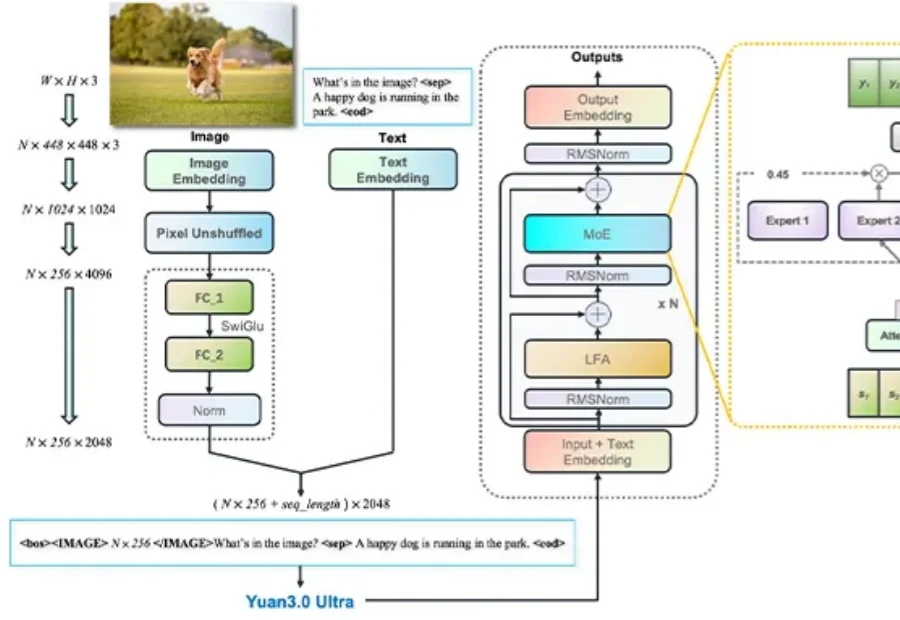

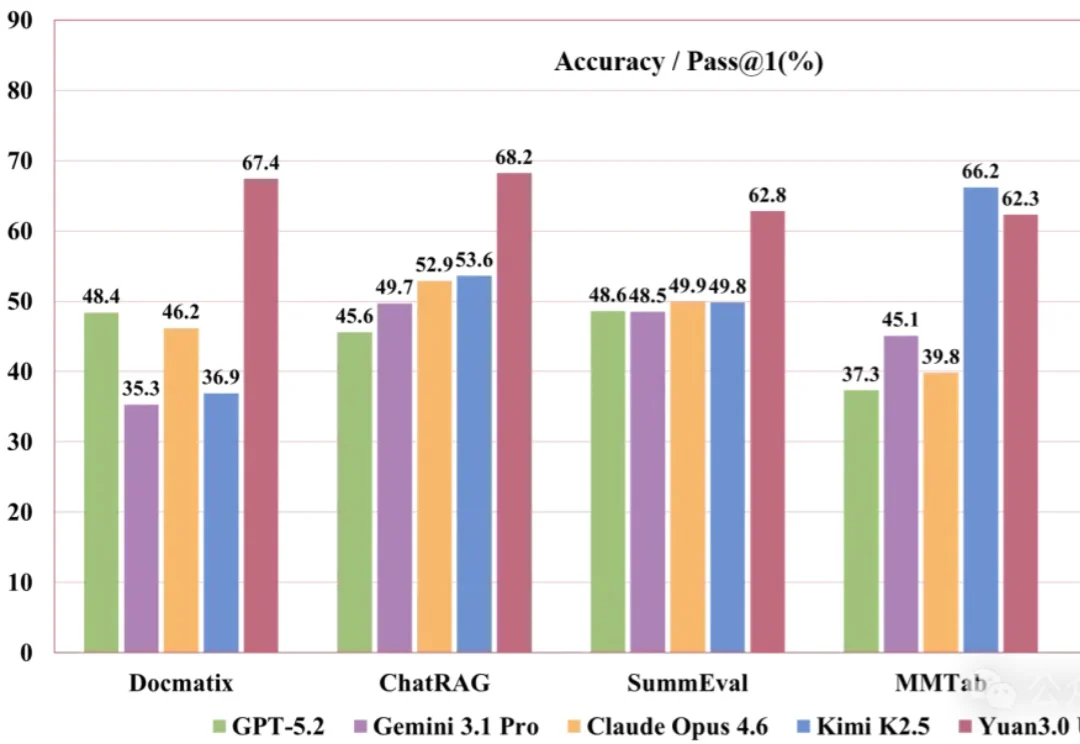

刚刚,YuanLab.ai团队正式开源发布源Yuan3.0 Ultra多模态基础大模型。

今天,清华大学 THUNLP 实验室、东北大学 NEUIR 实验室、OpenBMB 、面壁智能与 AI9Stars 联合发布 UltraRAG 3.0 ,针对上述痛点,为科研工作者与开发者打造更懂开发者的技术框架,具备 3 大核心优势:

英特尔发布年度旗舰AI PC芯片——第三代酷睿Ultra系列处理器(代号Panther Lake)。这是首款基于Intel 18A制程(1.8nm级)的计算平台,将AI PC引入埃米时代,端侧AI算力多达180TOPS。

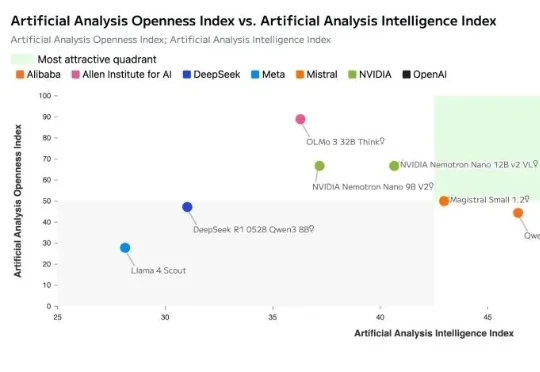

就在刚刚,英伟达正式开源发布了其新一代AI模型:NVIDIA Nemotron 3。Nemotron 3 系列由三种型号组成:Nano、Super 和 Ultra。官方介绍其具备强大的智能体、推理和对话能力。