ChatGPT新能力要做Copilot?

ChatGPT新能力要做Copilot?这是一轮新变化。

这是一轮新变化。

2020 年,谷歌发表了预印本论文《Chip Placement with Deep Reinforcement Learning》,介绍了其设计芯片布局的新型强化学习方法。后来在 2021 年,谷歌又发表在 Nature 上并开源了出来。

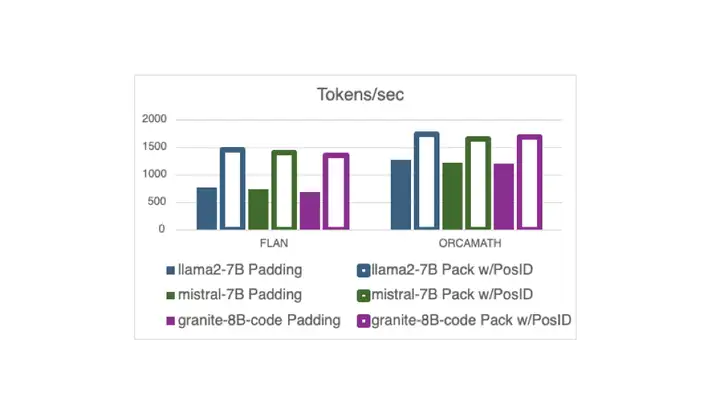

现在,在 Hugging Face 中,使用打包的指令调整示例 (无需填充) 进行训练已与 Flash Attention 2 兼容,这要归功于一个 最近的 PR 以及新的 DataCollatorWithFlattening。 它可以在保持收敛质量的同时,将训练吞吐量提高多达 2 倍。继续阅读以了解详细信息!

本文介绍了香港科技大学(广州)的一篇关于大模型高效微调(LLM PEFT Fine-tuning)的文章「Parameter-Efficient Fine-Tuning with Discrete Fourier Transform」

大家好呀,我是网上冲浪的Vigor????,今天给大家推荐一个颠覆传统聊天对话式的AI效率工具——Flowith。

《DoraemonGPT: Toward Understanding Dynamic Scenes with Large Language Models》

日前,马斯克在与挪威央行首席执行官 Nicolai Tangen 的一次直播访谈中,说出了许多争议性言论: “我见过很多技术,AI 是我见过发展最快的技术。”

Mac用户,终于不用羡慕N卡玩家有专属大模型Chat with RTX了!

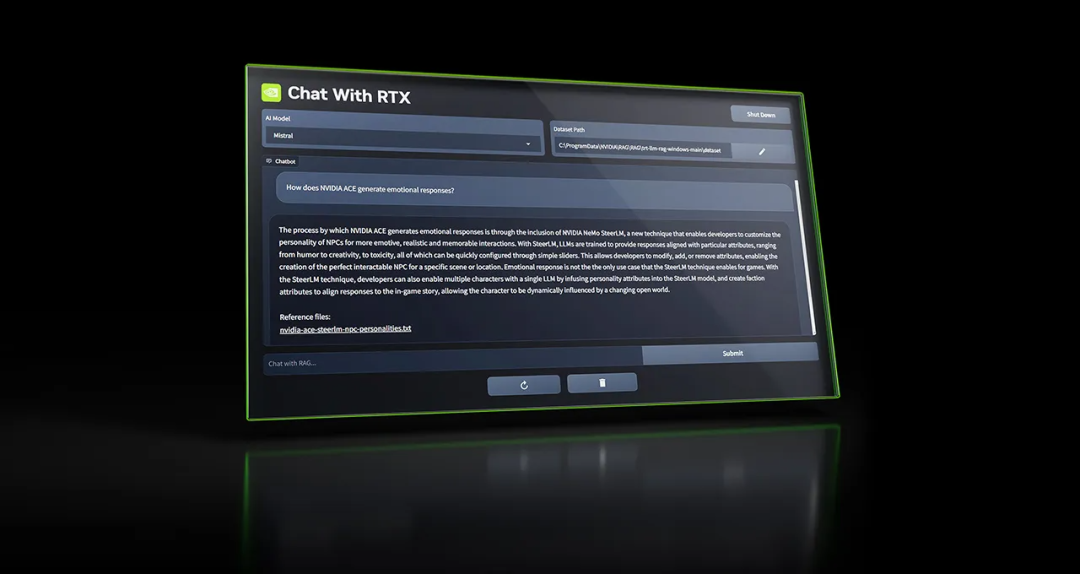

英伟达在2024年2月14号的时候推出了这么一个产品,叫做Chat with RTX。顾名思义,就是和英伟达的显卡聊天。简单来说Chat with RTX是一个本地部署的大语言模型工具,可以实现和大语言模型对话,还支持处理多种文件类型,用户可以与其进行文本、PDF、Word文档等多种格式内容的交互。

英伟达发布了一个对话机器人 ——「Chat with RTX」,面向 GeForce RTX 30 系列和 40 系列显卡用户(至少有 8GB VRAM)。有人开玩笑说,Sam Altman 进军芯片领域,黄仁勋进入聊天机器人的领域,这是 Sam vs Jensen 的时代。