最长连续工作40天!硅谷Agent又进化了:给个指令,剩下它全搞定

最长连续工作40天!硅谷Agent又进化了:给个指令,剩下它全搞定可自主规划连续执行40天的全自动智能体来了! Factory最新上线的Missions,直接超越OpenClaw,把一盘剥好的肉端上桌——不整虚的!只需一个任务指令,就能交付全自动工程闭环。

可自主规划连续执行40天的全自动智能体来了! Factory最新上线的Missions,直接超越OpenClaw,把一盘剥好的肉端上桌——不整虚的!只需一个任务指令,就能交付全自动工程闭环。

Anterior,刚刚完成了 4000 万美元的融资,使其总融资额达到 6400 万美元。这轮融资由 NEA 和 Sequoia Capital 继续参与,新投资者包括 FPV 和 Kinnevik。但让我真正感兴趣的不是融资金额本身,而是他们正在解决的问题以及他们解决问题的方式。

这家成立两年的初创公司周四表示,已完成900 万美元种子轮融资,由 Susquehanna International Group(SIG)和光速创投领投,B Capital、Seaborne Capital、Beenext、Sparrow Capital 和 2.2 Capital 跟投。

科技账号 Legit 率先披露,V4 的轻量版本代号为「sealion-lite(海狮轻量版)」,目前已在至少一家推理服务商处展开内测,相关方均签署了严格的保密协议。

就在本月,蚂蚁集团inclusionAI团队交出了一份颇具分量的答卷——百灵大模型家族新一代开源万亿参数模型Ling-2.5-1T(即时模型)与Ring-2.5-1T(思考模型)。

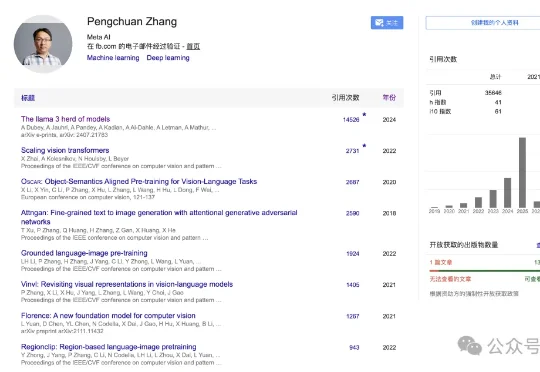

刚刚,毕业清华大学数学系,曾在Meta FAIR工作3.75年、主导过SAM与Llama多项核心工作的研究员张鹏川(Pengchuan Zhang)宣布离职。他的下一站,是来到OpenAI,投身于世界模拟与机器人学(World Simulation and Robotics)方向的研究。

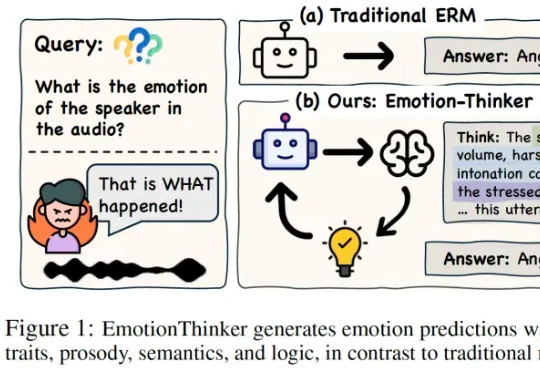

SpeechLLM 是否具备像人类一样解释 “为什么” 做出情绪判断的能力?为此,研究团队提出了EmotionThinker—— 首个面向可解释情感推理(Explainable Emotion Reasoning)的强化学习框架,尝试将 SER 从 “分类任务” 提升为 “多模态证据驱动的推理任务”。

开工第一天,我狠狠补了假期里认为最重要的一期播客:Notion 创始人 Ivan Zhao 的访谈。这期内容在互联网上几乎没有传播,但我认为它的价值被严重低估了。 Ivan 谈到了 AI 对 Noti

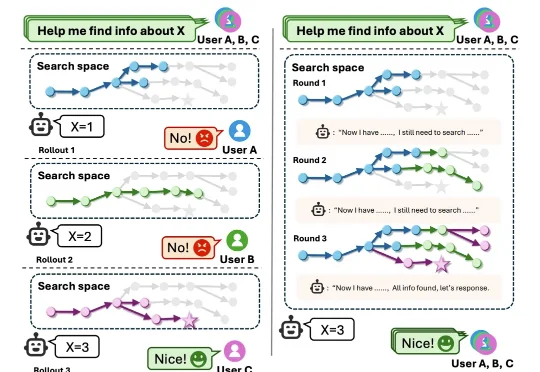

来自东南大学、微软亚洲研究院等机构的研究团队提出了一种全新的解决方案——Re-TRAC(REcursive TRAjectory Compression),这个框架让 AI 智能体能够「记住」每次探索的经验,在多个探索轨迹之间传递经验,实现渐进式的智能搜索。

春节前,千寻完成近 20 亿元人民币两轮融资,估值突破 100 亿元,新股东包括云锋基金、混沌投资、红杉中国等财务机构,Synstellation Capital、TCL 创投、明荟投资(汇川技术董事长家办)等产投方,重庆产业投资母基金、杭州金投等国资;顺为、Prosperity7、达晨财智等老股东也继续投资。