独家!哈啰切入AI面试赛道,推出“HiOffers AI”

独家!哈啰切入AI面试赛道,推出“HiOffers AI”哈啰推出一款AI面试相关的产品“HiOffers AI”,主打AI语音模拟面试、智能简历诊断、JD 精准匹配优化,一站式帮求职者系统性提升面试竞争力,高效拿下Offer。

搜索

搜索

哈啰推出一款AI面试相关的产品“HiOffers AI”,主打AI语音模拟面试、智能简历诊断、JD 精准匹配优化,一站式帮求职者系统性提升面试竞争力,高效拿下Offer。

机器之心编辑部 ICLR 2026 获奖论文已经公布。 今年共有 2 篇论文获得「杰出论文奖」(Outstanding Paper),另有 1 篇论文获得「荣誉提名」(Honorable Mention);此外,还有 2 篇 ICLR 2016 论文获得「时间检验奖」(Test of Time Award)。

PlayerZero 刚刚宣布完成了 1500 万美元的 A 轮融资,由 Foundation Capital 的 Ashu Garg 领投,他也是 Databricks 的早期支持者。这是继 Green Bay Ventures 领投的 500 万美元种子轮之后的又一轮融资。

阶跃星辰今日发布新一代自动语音识别模型StepAudio 2.5 ASR。该模型面向语音转写与长音频处理场景,在架构上引入Multi-Token Prediction(多Token预测)以提升推理效率,并通过扩展上下文窗口强化长内容识别能力。

AI云平台服务提供商涂鸦智能在深圳举办了开发者大会,从AI开发者平台的重磅升级、Hey Tuya、TuyaClaw AI智能体的出色AI交互体验,以及宠物陪伴机器人等AI创新硬件,我们看到涂鸦正全力“All in AI”,全球IoT开发平台也升级为全球AI云开发平台。

最近,谷歌联合ResNet作者何恺明、谢赛宁、NeRF先驱Jonathan T. Barron、 3D图形学名家Thomas Funkhouser,正式发布了Vision Banana。它向世界宣告:视觉AI终于不再需要那些臃肿的任务头了,理解,本质上只是生成过程中的一次「对齐」。

想象一下:你打开浏览器,没有代码、没有 HTML、没有 CSS 布局引擎。屏幕上每一帧画面,都是 AI 模型实时生成的像素视频流。满满的科幻降临既视感!这就是 Zain Shah(前 OpenAI、YC 校友)和团队刚刚发布的 Flipbook 原型。

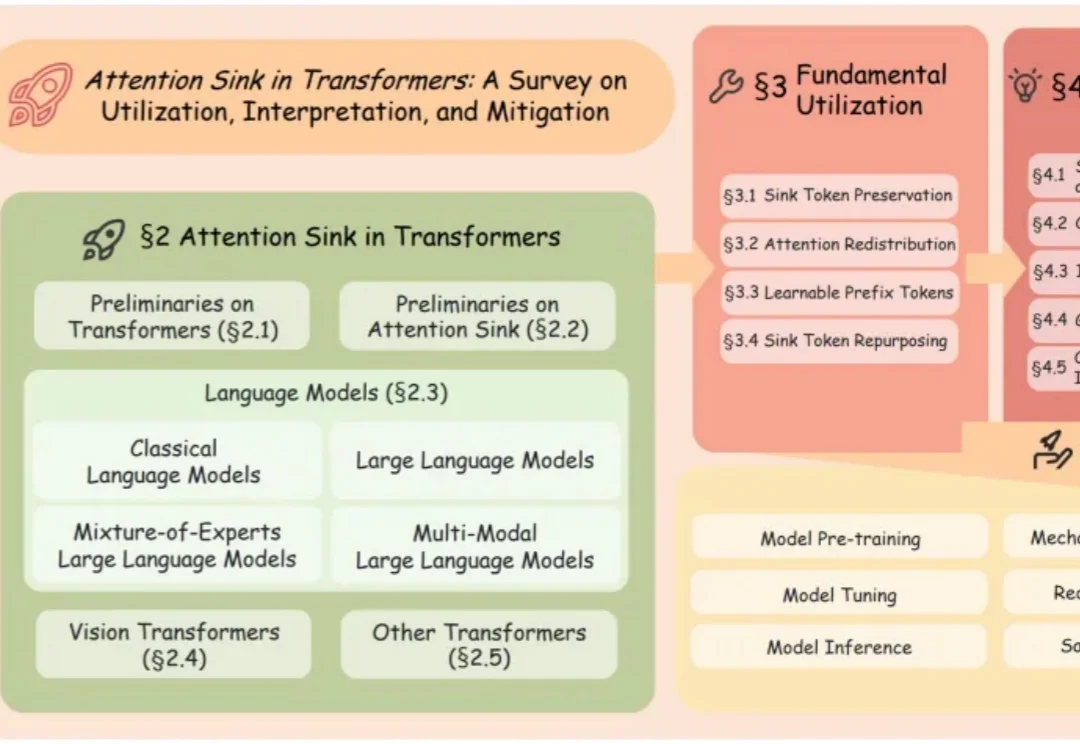

几乎所有 Transformer 都在做一件反常的事:把大量注意力集中到少数几个特定 Token 上。这不是 bug,而是 Transformer 固有的「注意力汇聚」(Attention Sink)。首篇系统性综述,带你从利用、理解到消除,全面掌握这一核心现象。

投资者正在积极争取AI 研究人员创办初创公司,以使 AI 更加可靠和高效。

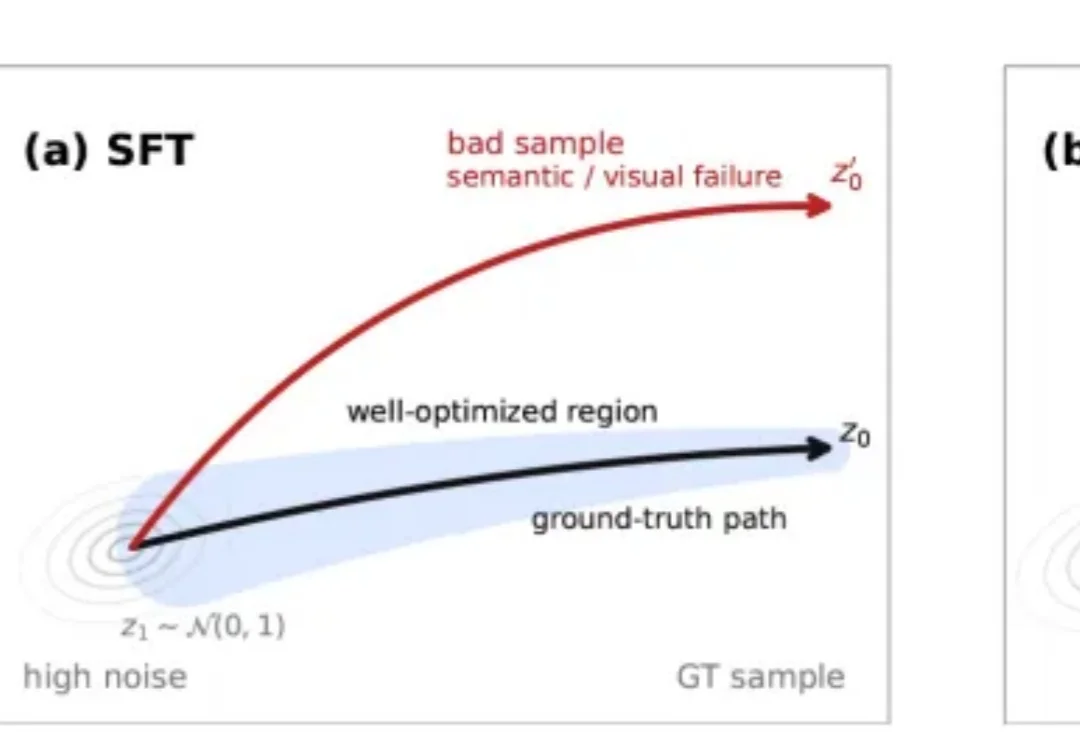

近日,腾讯混元团队提出HY-SOAR (Self-Correction for Optimal Alignment and Refinement),一种面向扩散模型和流匹配模型的数据驱动后训练方法。