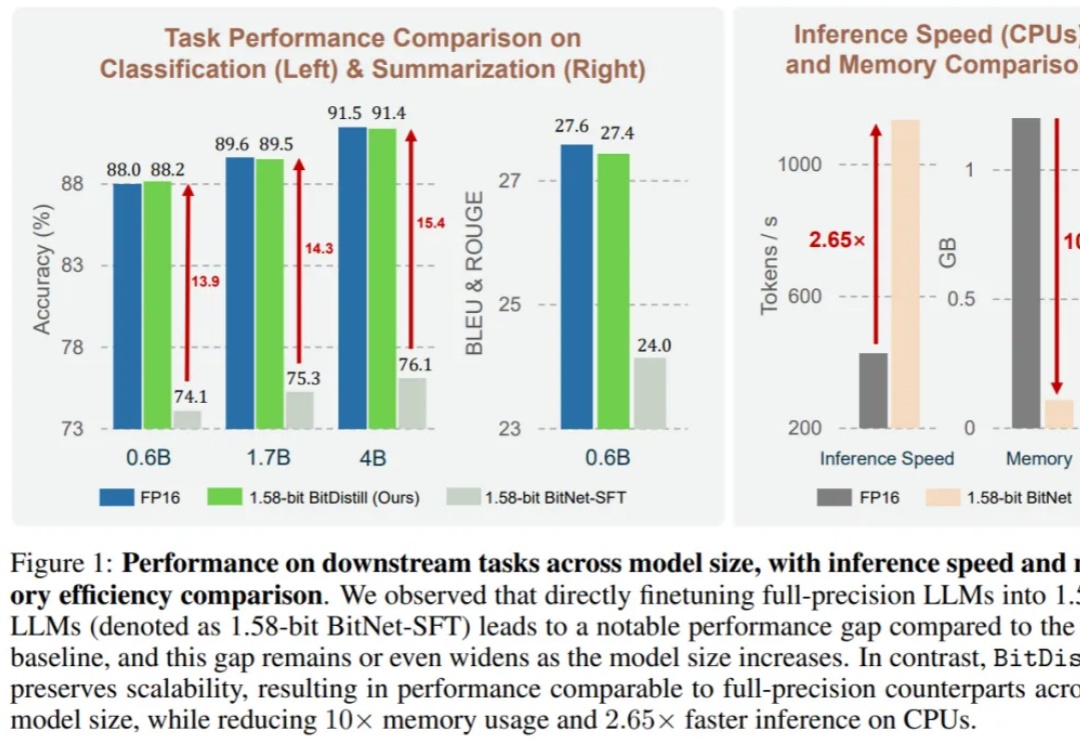

微软BitDistill将LLM压缩到1.58比特:10倍内存节省、2.65倍CPU推理加速

微软BitDistill将LLM压缩到1.58比特:10倍内存节省、2.65倍CPU推理加速大语言模型(LLM)不仅在推动通用自然语言处理方面发挥了关键作用,更重要的是,它们已成为支撑多种下游应用如推荐、分类和检索的核心引擎。尽管 LLM 具有广泛的适用性,但在下游任务中高效部署仍面临重大挑战。

大语言模型(LLM)不仅在推动通用自然语言处理方面发挥了关键作用,更重要的是,它们已成为支撑多种下游应用如推荐、分类和检索的核心引擎。尽管 LLM 具有广泛的适用性,但在下游任务中高效部署仍面临重大挑战。

刚刚,DeepSeek 推出了全新的视觉文本压缩模型 DeepSeek-OCR。 该模型最大的突破在于极高的压缩效率: 20 个节点每天可处理 3300 万页数据,硬件要求仅为 A100-40G。

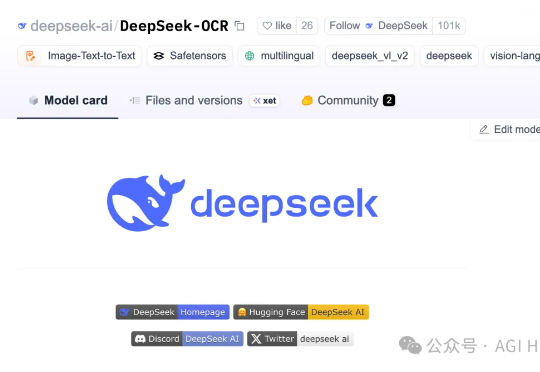

当大语言模型生成海量数据时,数据存储的难题也随之而来。对此,华盛顿大学(UW)SyFI实验室的研究者们提出了一个创新的解决方案:LLMc,即利用大型语言模型自身进行无损文本压缩的引擎。

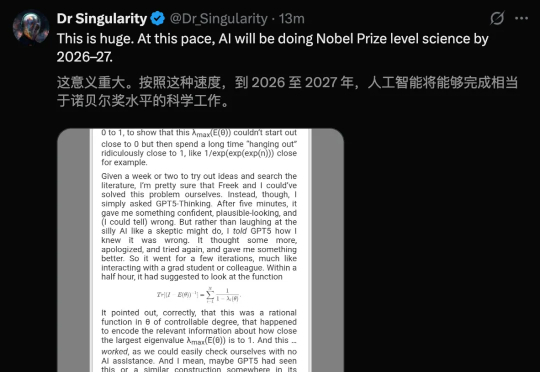

GPT-5正改写科学发现的规则!一篇重磅论文揭秘,「量子版NP难题」竟被GPT-5在30分钟之内攻克了,然而这要耗费人类1-2周的时间。照这种速度发展下去,AI离完成「诺奖级」突破真的不远了。

AI播客如豆包和NotebookLM本质是信息压缩工具,通过对话形式摘要文本,但无法复制人类播客的核心价值,包括观点碰撞、情感经验和责任承担。真正播客魅力源于真人不可预测性和风险意愿。AI应作为辅助用于资料整理、剪辑或转写,而非替代主播。名字“AI播客”误导性地暗示创作能力。

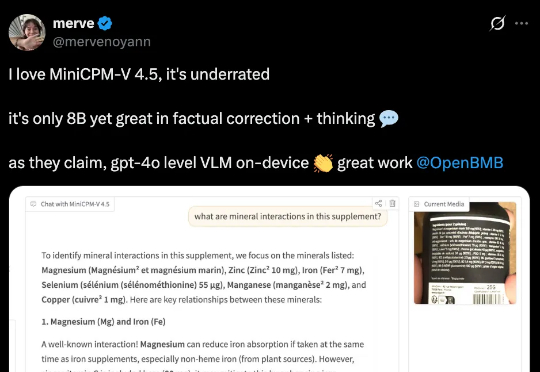

行业首个具备“高刷”视频理解能力的多模态模型MiniCPM-V 4.5的技术报告正式发布!报告提出统一的3D-Resampler架构实现高密度视频压缩、面向文档的统一OCR和知识学习范式、可控混合快速/深度思考的多模态强化学习三大技术。

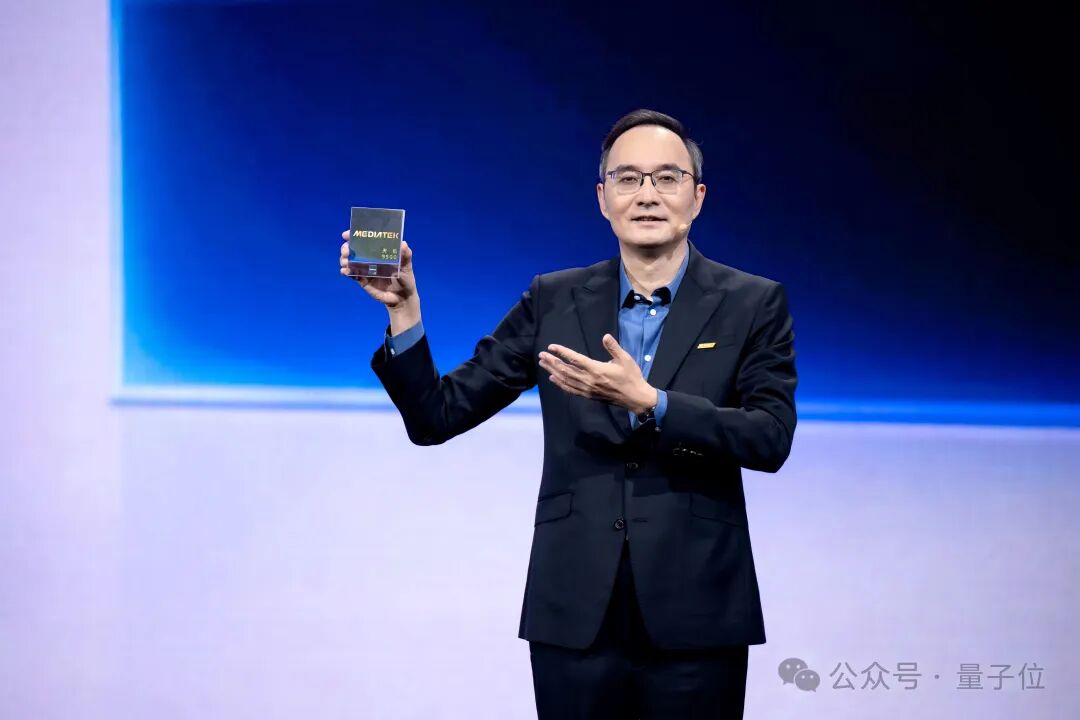

天玑9500围绕这一目标重构芯片底座:首发双NPU架构,结合存算一体、硬件压缩等多项关键技术,在ETHZ苏黎世移动SoC AI榜单中蝉联榜首,相比上一代跑分翻倍。

LLM.265研究发现,视频编码器本身就是一种高效的大模型张量编码器。原本用于播放8K视频的现成视频编解码硬件,其实压缩AI模型数据的效率也非常高,甚至超过了许多专门为AI开发的方案。该工作已被世界微架构大会MICRO-2025正式接收,相关成果将于今年10月在首尔进行展示与讨论。

人工智能正在吟诗作画,我们人类却在打扫卫生。 这句话几乎描述出了今天所有人对AI的困惑,一边是模型底层技术的突破,另一边却是AI进入真实世界后的无力感。一个验证码能摧毁一个压缩全世界知识的AI大脑,一个垃圾桶能绕晕一个拥有30多个自由度的人形机器人。

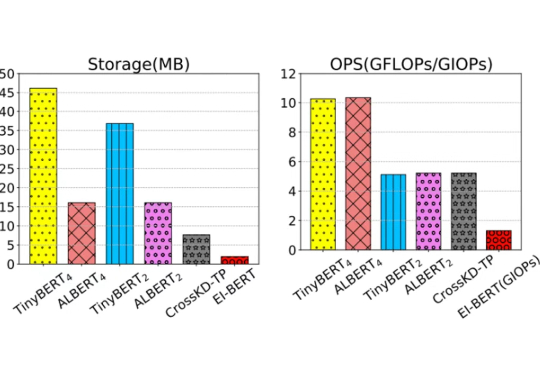

在移动计算时代,将高效的自然语言处理模型部署到资源受限的边缘设备上面临巨大挑战。这些场景通常要求严格的隐私合规、实时响应能力和多任务处理功能。