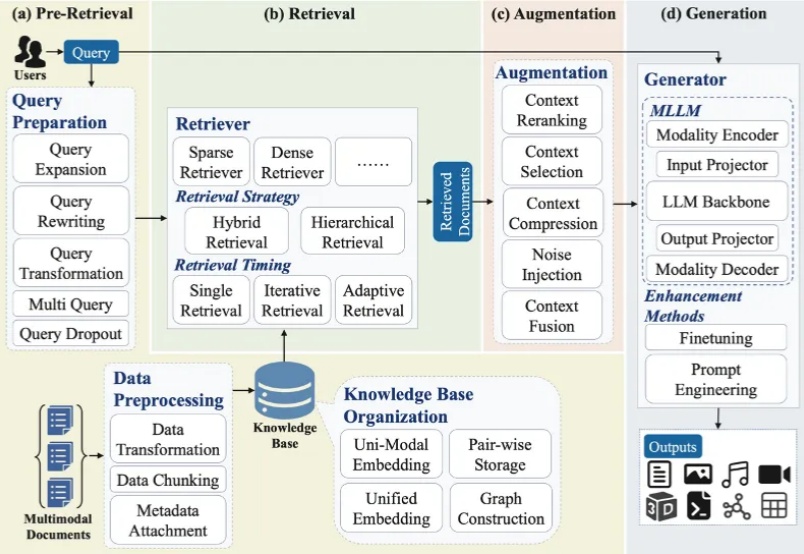

迎接「万物皆可RAG」时代:最新综述展示50多种多模态组合的巨大待探索空间

迎接「万物皆可RAG」时代:最新综述展示50多种多模态组合的巨大待探索空间大模型最广泛的应用如 ChatGPT、Deepseek、千问、豆包、Gemini 等通常会连接互联网进行检索增强生成(RAG)来产生用户问题的答案。随着多模态大模型(MLLMs)的崛起,大模型的主流技术之一 RAG 迅速向多模态发展,形成多模态检索增强生成(MM-RAG)这个新兴领域。ChatGPT、千问、豆包、Gemini 都开始允许用户提供文字、图片等多种模态的输入。