突破全模态AI理解边界:HumanOmniV2引入上下文强化学习,赋能全模态模型“意图”推理新高度

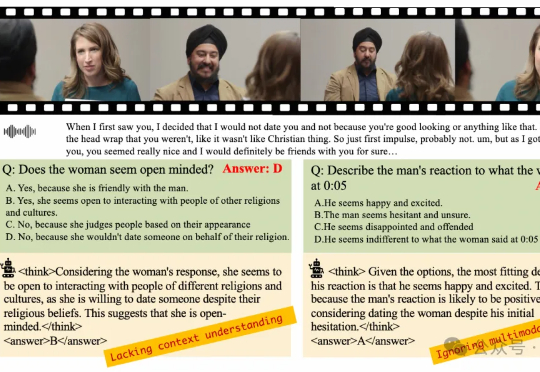

突破全模态AI理解边界:HumanOmniV2引入上下文强化学习,赋能全模态模型“意图”推理新高度在多模态大语言模型(MLLMs)应用日益多元化的今天,对模型深度理解和分析人类意图的需求愈发迫切。尽管强化学习(RL)在增强大语言模型(LLMs)的推理能力方面已展现出巨大潜力,但将其有效应用于复杂的多模态数据和格式仍面临诸多挑战。

在多模态大语言模型(MLLMs)应用日益多元化的今天,对模型深度理解和分析人类意图的需求愈发迫切。尽管强化学习(RL)在增强大语言模型(LLMs)的推理能力方面已展现出巨大潜力,但将其有效应用于复杂的多模态数据和格式仍面临诸多挑战。

该大模型由海洋精准感知技术全国重点实验室(浙江大学)牵头研发,具备基础的海洋专业知识问答,以及声呐图像、海洋观测图等海洋特色多模态数据的自然语言解读能力。其采用的领域知识增强“慢思考”推理机制,相较现有通用大模型能有效降低幻觉式错误。

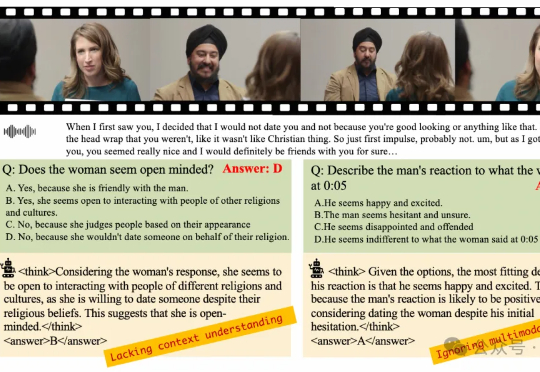

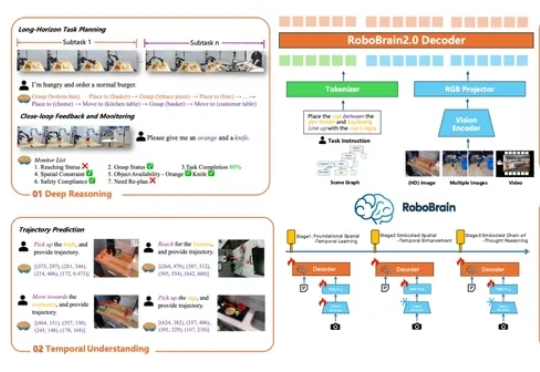

随着大模型的不断发展,多模态数据处理成为了新的热点领域。多模态生成任务主要通过整合多种类型的数据,如文本、图像、音频等,实现不同模态之间的相互转换与生成。

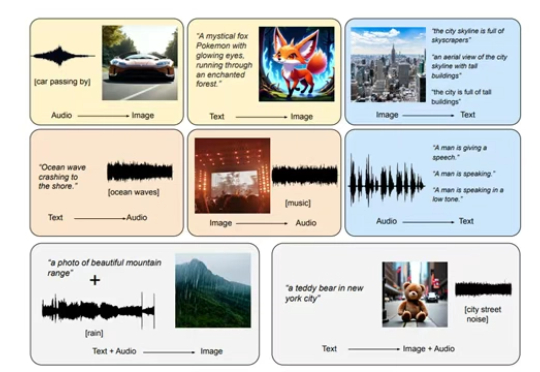

大模型的发展正在遭遇瓶颈。随着互联网文本数据被大规模消耗,基于数字世界训练的AI模型性能提升速度明显放缓。与此同时,物理世界中蕴藏着数字世界数百倍甚至千倍的多模态数据,这些数据远未被有效利用,成为AI发展的下一个重要方向。

2025年4月16日,Cohere 发布了其最新一代多模态搜索模型 Embed 4,在多模态数据处理、长文本建模和跨模态检索能力上实现了显著提升,进一步巩固了其在企业级 AI 搜索领域的领先地位。

面对AI圈疯传的「数据如化石燃料一般正在枯竭」,我们该如何从海量数据中掘金?AI炼出的数据飞轮2.0,或许就是答案。

开源多模态大模型或将开始腾飞。

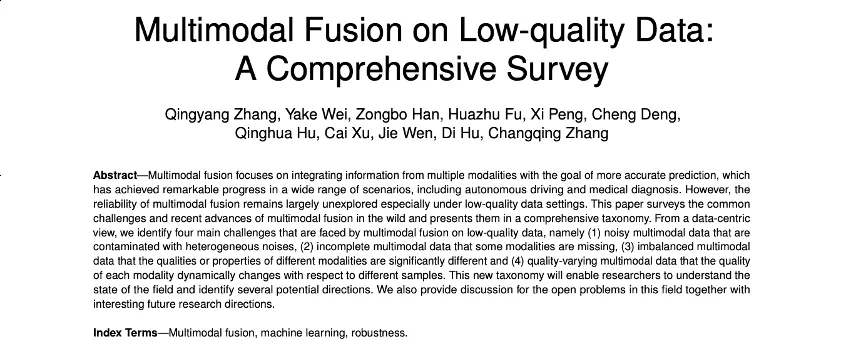

多模态融合是多模态智能中的基础任务之一。

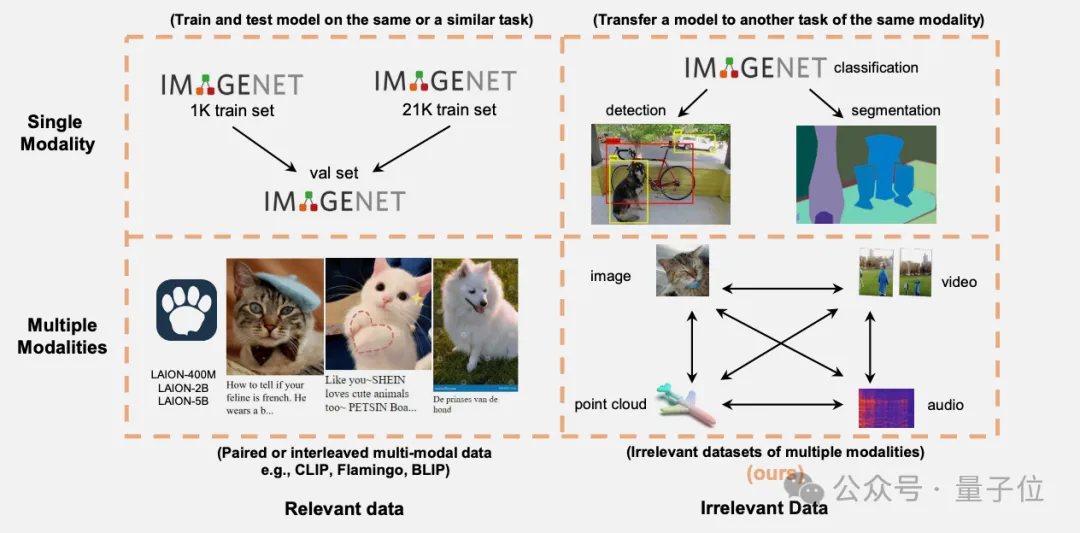

万万没想到,与任务无直接关联的多模态数据也能提升Transformer模型性能。