硬刚英伟达!亚马逊推出医药Agent平台,集成40+顶尖大模型,7x24小时全自动实验!

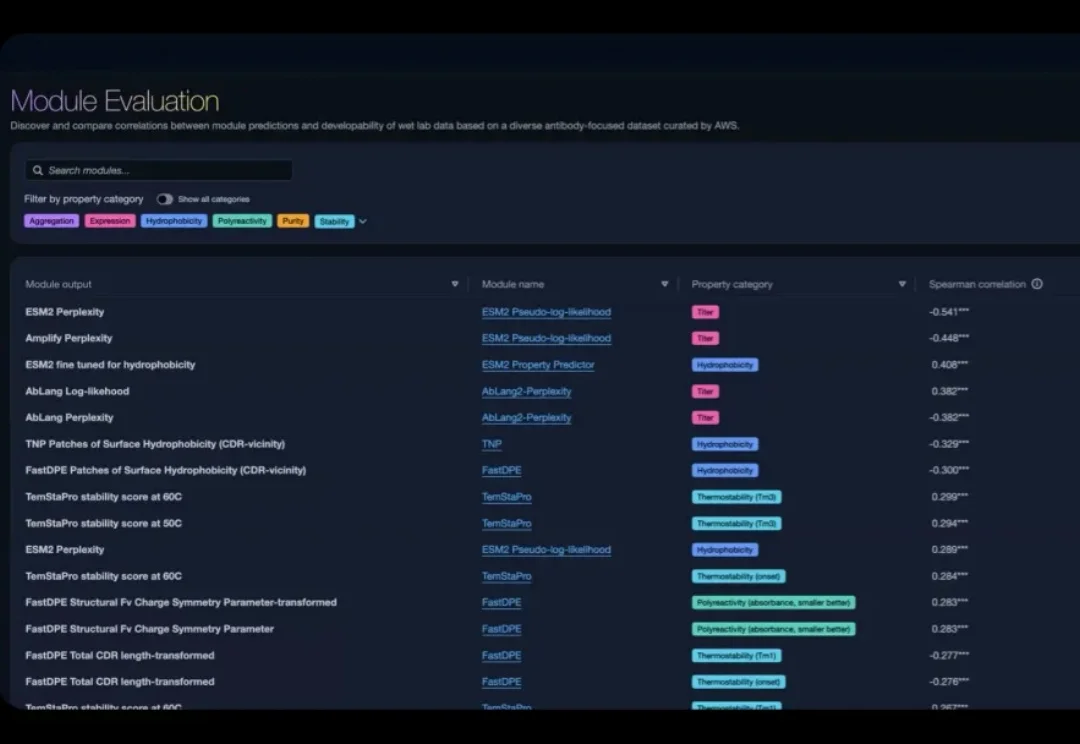

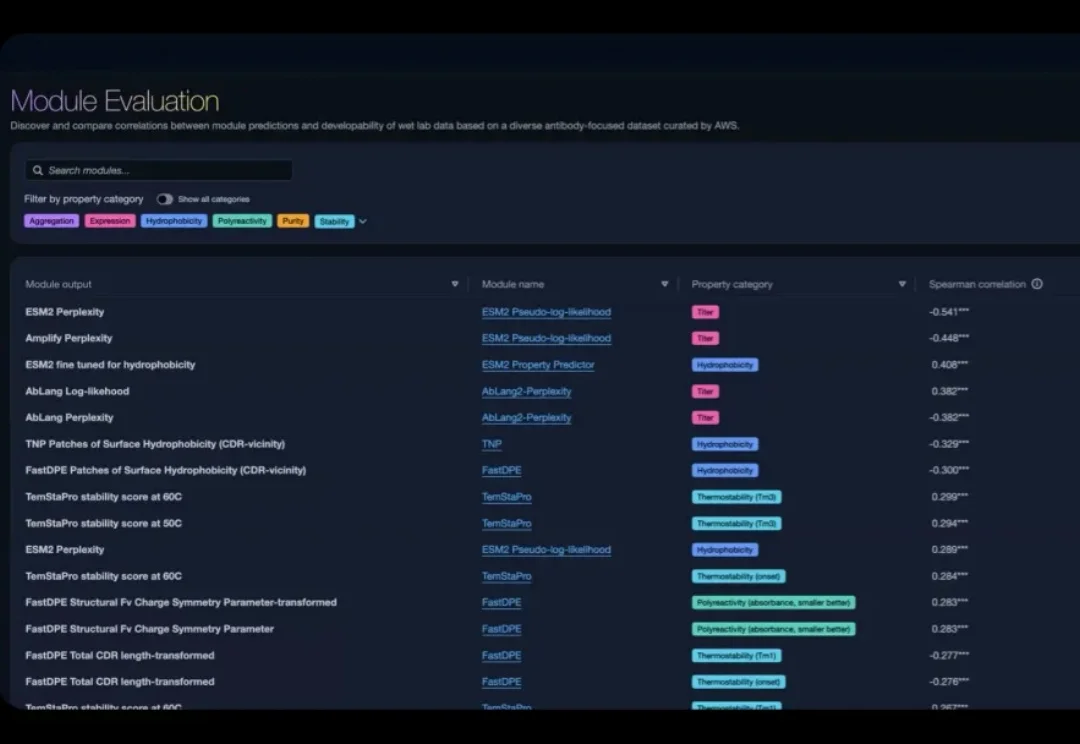

硬刚英伟达!亚马逊推出医药Agent平台,集成40+顶尖大模型,7x24小时全自动实验!巨头亚马逊,也深度入局生命科学了。

巨头亚马逊,也深度入局生命科学了。

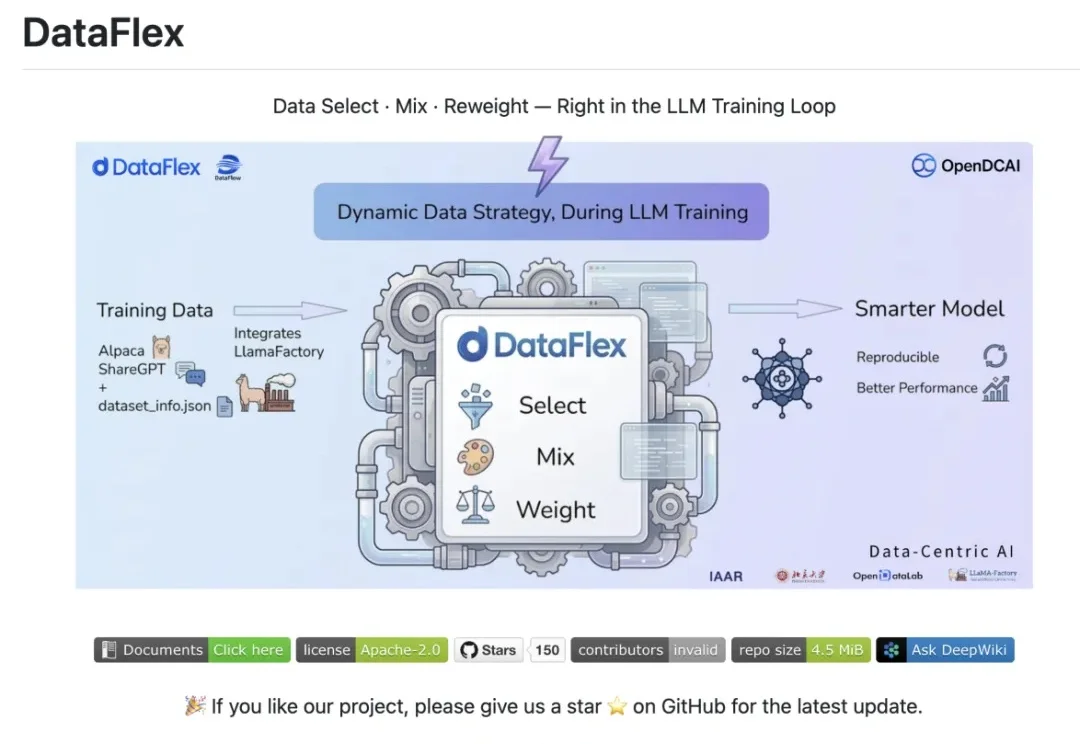

当大模型训练进入深水区,竞争的关键已经不再只是「模型参数怎么调」,而逐渐转向一个更核心、也更难系统解决的问题:模型在训练过程中究竟看到了什么数据、以什么比例看到、哪些样本应该被更频繁地学习。

当大模型训练进入深水区,竞争的关键已经不再只是「模型参数怎么调」,而逐渐转向一个更核心、也更难系统解决的问题:模型在训练过程中究竟看到了什么数据、以什么比例看到、哪些样本应该被更频繁地学习。

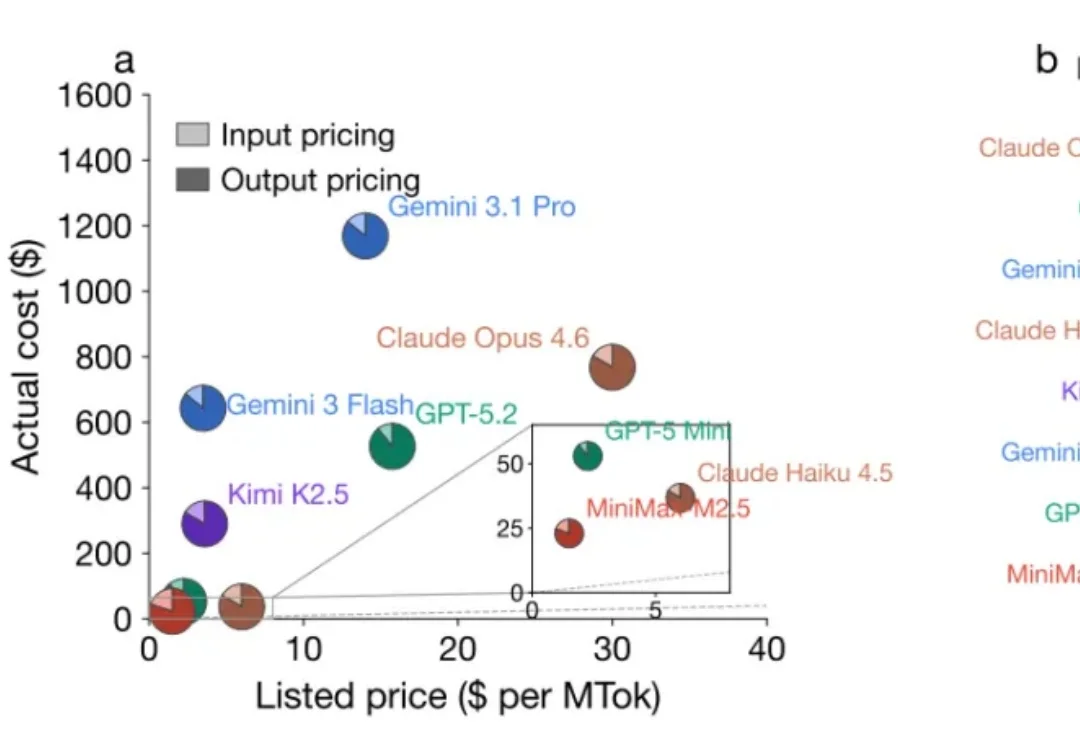

在选择使用大模型 (LLM) 时,除了模型性能强弱,价格也是一个重要指标。人们通常会用大模型的 API 定价更贵或更便宜,来比较模型的价格高低。但事实上,定价低的模型真的比定价高的模型使用起来更便宜吗?

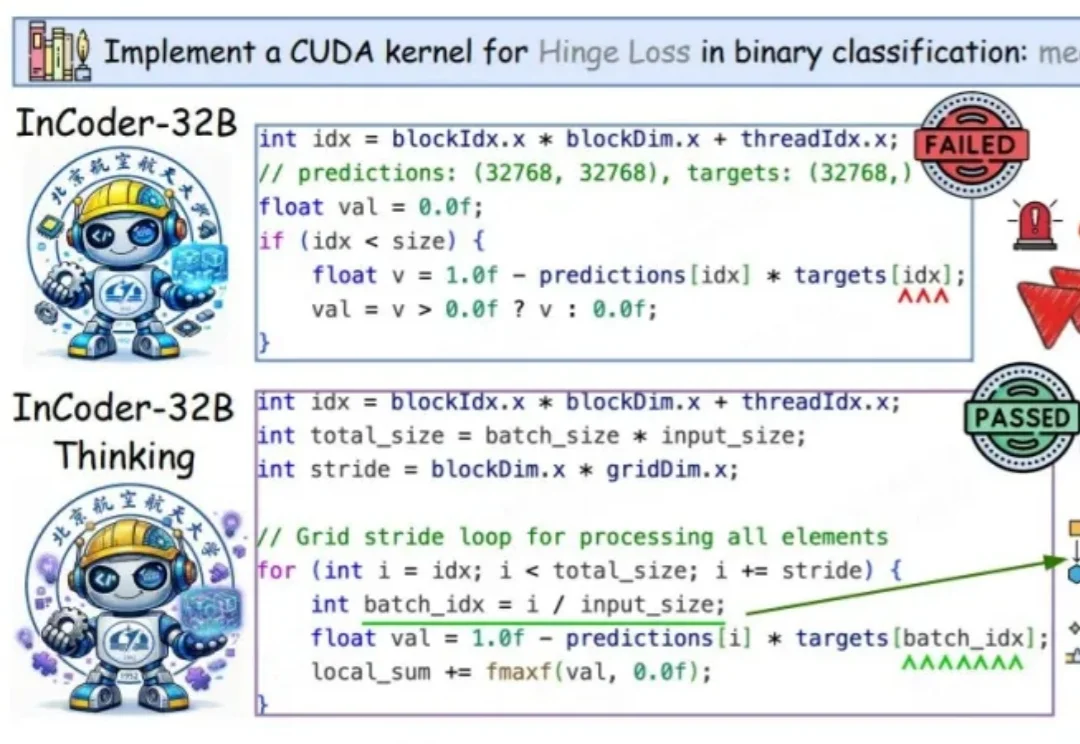

代码大模型会写代码,这件事已经不新鲜了。

港交所官网显示,中科院系AI公司北京中科闻歌已于4月12日正式披露招股书,冲刺“大模型决策第一股”。2025年6月,其以“秘交”方式递表港交所,由中金公司担任独家保荐人。

我们发布了TokenDance 词元跳动,一站式大模型 API 调用平台。希望能够赋能更多观猹生态内的 AI 企业、OPC 开发者与 AI 爱好者,帮助 AI 时代的创造者们,省一些成本,多一些创造。

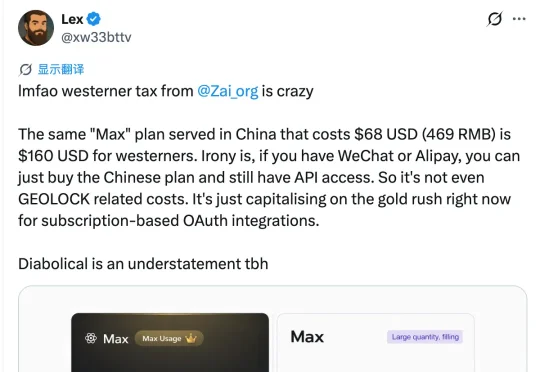

现在,轮到国产模型开始收割老外了。 有网友发现,智谱的Max计划在中国只要469元人民币,折合差不多68美元; 可到了西方用户手里,直接飙到160美元,足足贵了一倍多。

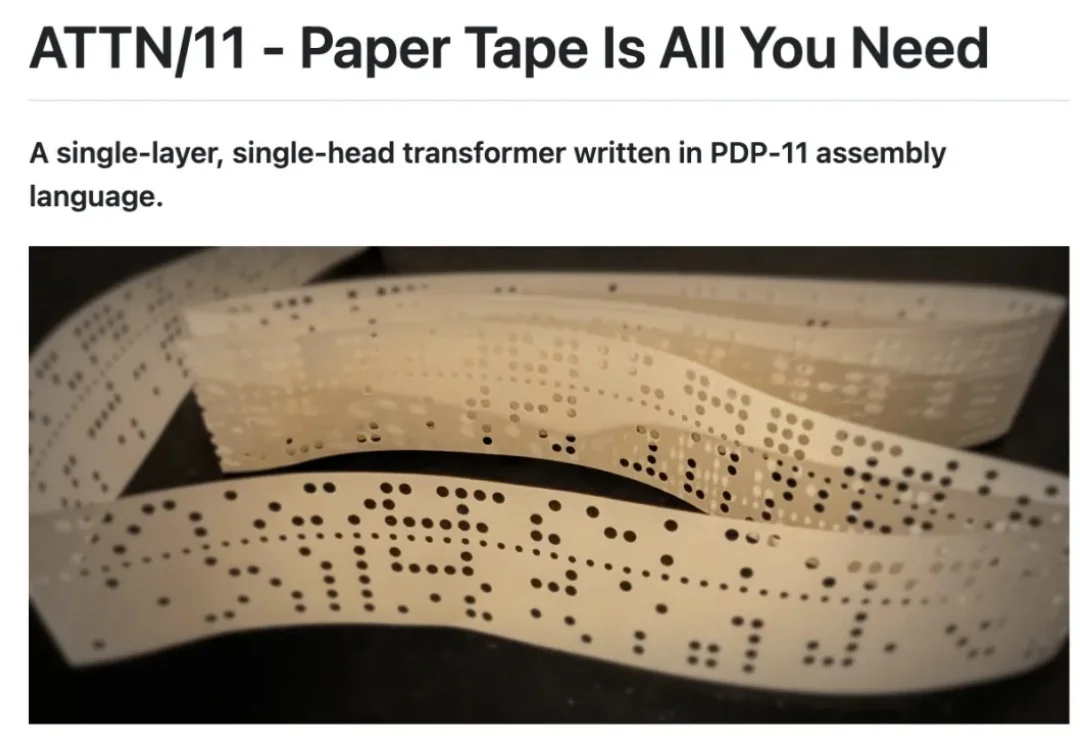

试想一下,如果把当下大火的大模型技术带回 1970 年,会发生什么?

过去一年,大模型的能力曲线几乎是指数上升的——推理更强、工具调用更稳、上下文窗口越撑越大。但一个越来越尖锐的问题也随之浮出水面:模型变强了,可承接它的那层东西在哪?