独家|字节首个付费“豆包会员”将推出,AI大模型免费时代转向了

独家|字节首个付费“豆包会员”将推出,AI大模型免费时代转向了独家获悉,字节跳动旗下AI应用“豆包”最快将于5月中下旬上线首款付费包月产品:豆包会员。具体来说,豆包会员分为标准版、加强版、专业版三个版本,iOS版内购价格最低68元人民币起,最高年费达5088元,会员权益有望增加Seedance 2.0生视频额度等功能。

搜索

搜索

独家获悉,字节跳动旗下AI应用“豆包”最快将于5月中下旬上线首款付费包月产品:豆包会员。具体来说,豆包会员分为标准版、加强版、专业版三个版本,iOS版内购价格最低68元人民币起,最高年费达5088元,会员权益有望增加Seedance 2.0生视频额度等功能。

MONTEE AI 近日宣布完成首轮融资,成立于2025年,MONTEE AI是全球首款玩偶交互式AI故事机。公司身后是一支来自硅谷、字节跳动、Google 和常青藤的团队,联动幼教出版世家五十年资源沉淀,正在重新定义儿童故事机品类。

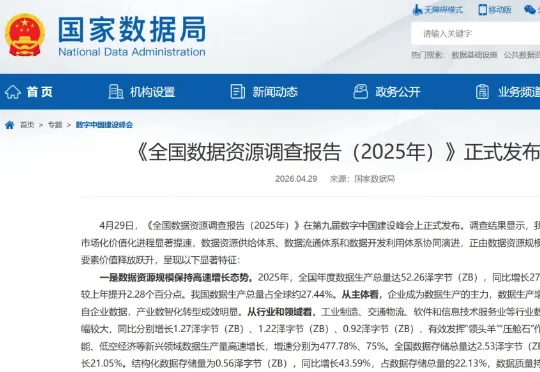

据央视新闻报道,今天,《全国数据资源调查报告(2025 年)》在第九届数字中国建设峰会上发布。报告显示,2025 年,全国数据生产总量同比增长 27.28%,达到 52.26ZB(ZettaByte,泽字节 | 1ZB=1024EB),这相当于全国所有算力中心存储容量的近 30 倍。从国际来看,我国数据生产总量占全球的 27.44%。

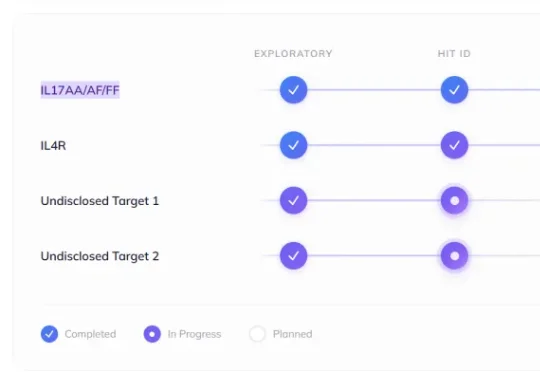

近日,字节跳动旗下AI制药子公司Anew Therapeutics在AAI 2026上进行了口头报告,披露旗下位于临床前阶段的IL-17小分子抑制剂。该药物是全球首个小分子全谱(AA/AF/FF)IL-17抑制剂,利用AI驱动的虚拟筛选技术,结合分子生成算法成功识别而来,有望转化为银屑病和其他自身免疫性疾病的最佳治疗方法。

维塔流动宣布完成数千万元人民币 Pre-Seed 轮融资,由锦秋基金领投,百度风投跟投。所募资金将主要用于产品研发与市场推广。旗下产品 Jovida 定位面向 C 端用户的主动式 Life Agent,围绕个人生活场景,帮助用户完成从目标感知、路径规划到行动执行的闭环。

《读佳》获悉,一个名为“豆包帮你选”的功能内嵌在豆包APP导航栏中,此前,豆包被爆料内测购物功能,如今这一功能正式落地,标志着字节跳动旗下AI助手豆包,正式切入电商赛道,一场AI与电商深度融合的布局已悄然拉开帷幕。

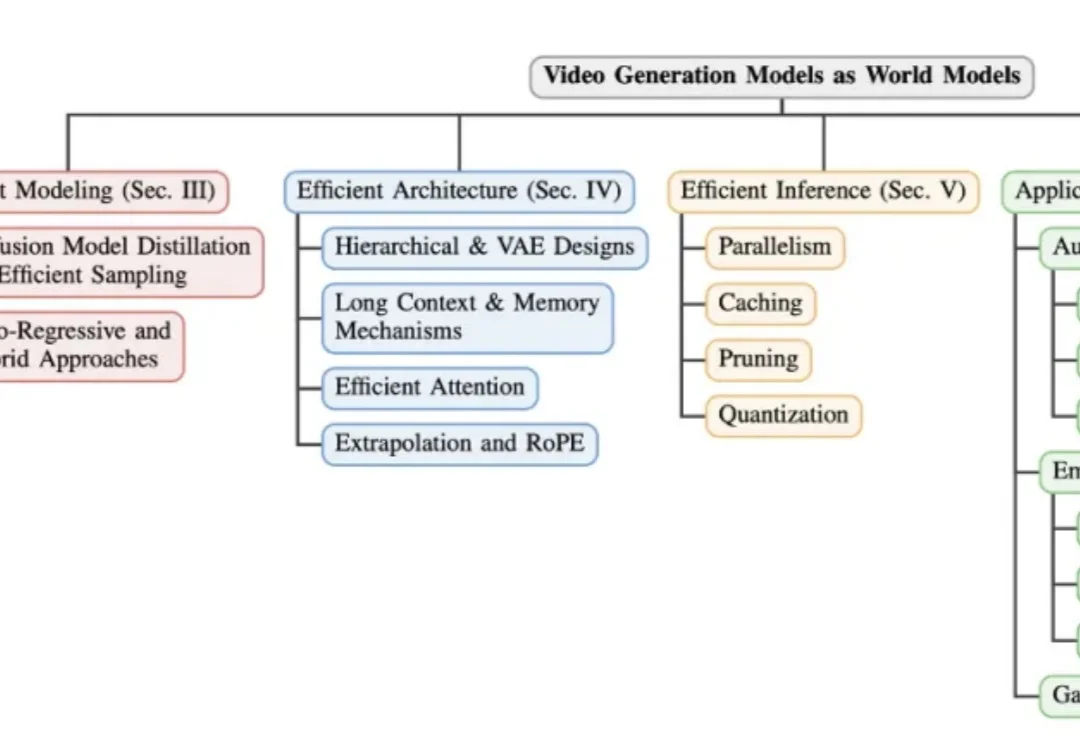

还记得两年前,AI 生视频可谓是「鬼畜专区」—— 人物多一根手指算基操,走路自带鬼步舞才是常态。结果转眼间,从 OpenAI 的 Sora 到字节跳动的 Seedance,这些模型已经开始一本正经地「模拟世界」了:水会流、球会弹、光影能追踪,俨然一副要当「物理引擎」的架势。

当很多具身智能公司更关心机器人先在哪些场景里跑通商业化时,自变量更想寻找哪条路径能够通往 AGI。

唯一一家同时被四家互联网大厂(字节、美团、阿里、小米)投资的具身智能公司。

现象级AI视频技术、字节Seedance 2.0在arXiv发论文了。晒了26页的Benchmark,和贡献者名单。170位团队成员全公开,署名和尊重都拉满了,不过嘛这就不怕……嘛?