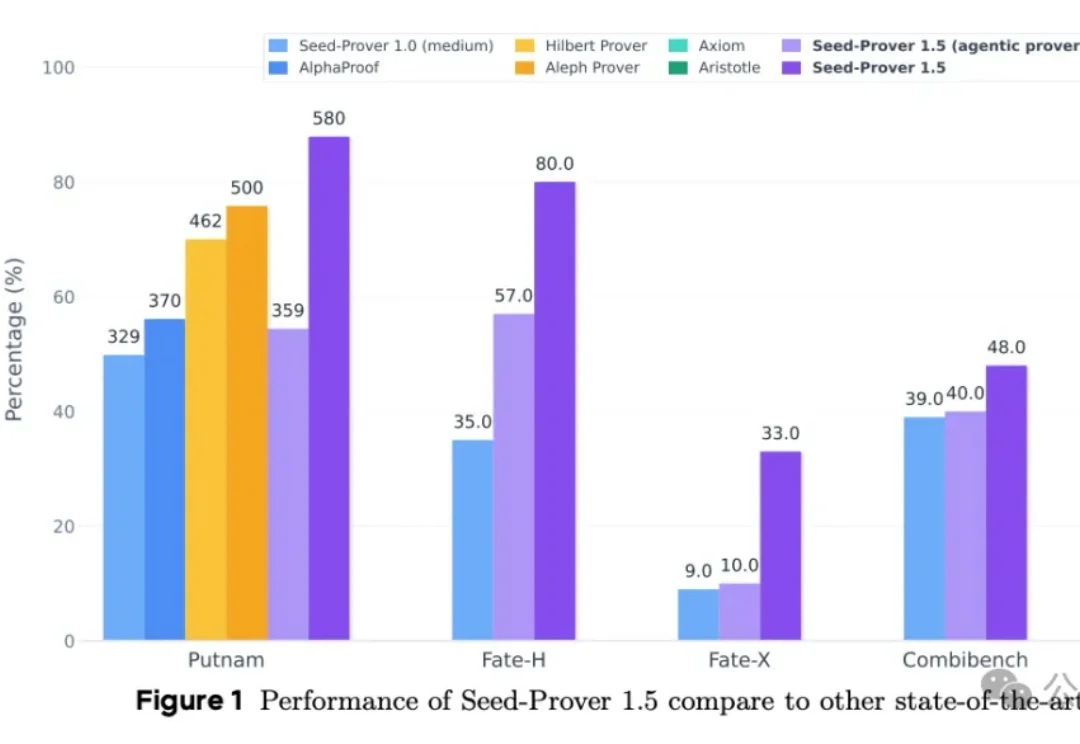

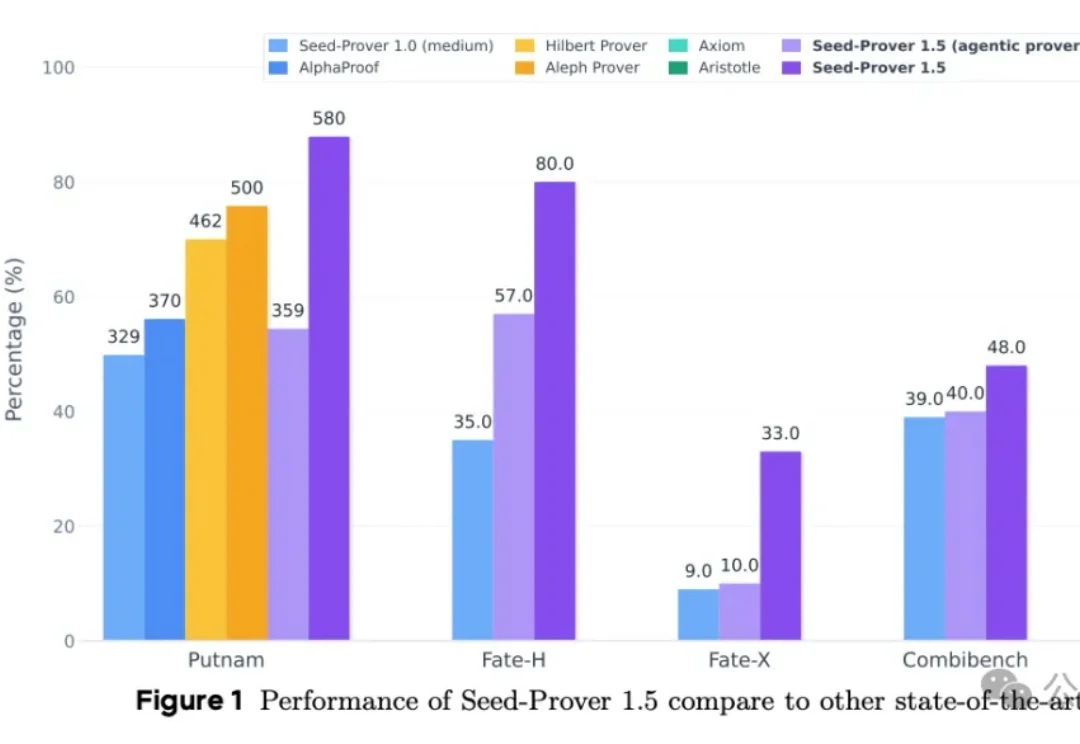

字节Seed发布最强数学模型:一招“打草稿”,IMO银牌变金牌

字节Seed发布最强数学模型:一招“打草稿”,IMO银牌变金牌字节最新数学推理专用模型,刚刚刷新战绩:拿下IMO金牌成绩。

搜索

搜索

字节最新数学推理专用模型,刚刚刷新战绩:拿下IMO金牌成绩。

今天是火山Force原动力大会,我在现场。

单Transformer搞定任意视图3D重建!

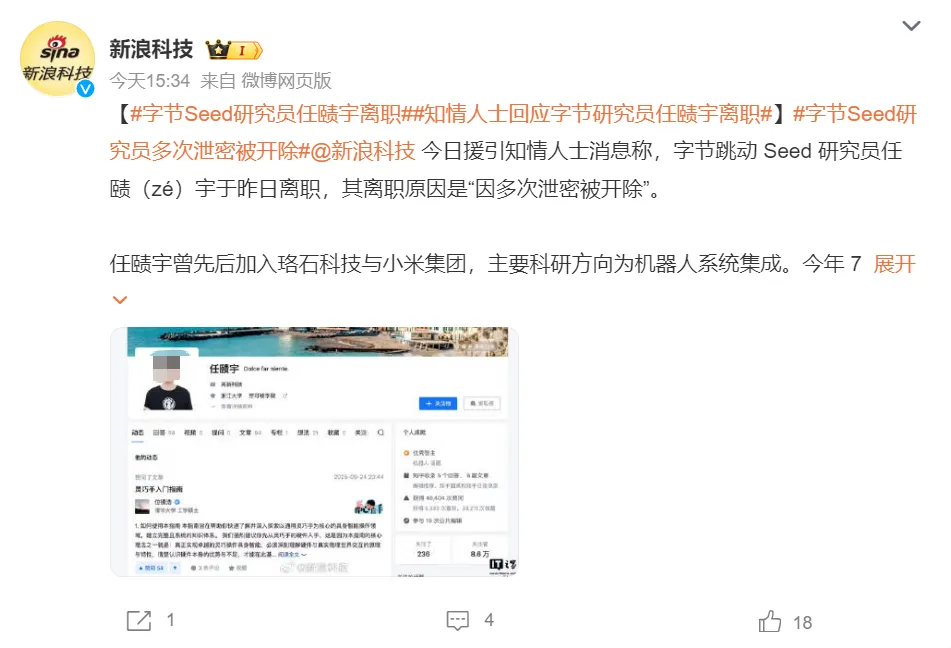

今日,科技圈爆出了一则重磅猛料。11月12日消息,@新浪科技从知情人士处获悉,字节跳动的Seed研究员任赜宇于昨日离职,离职原因为“多次泄密遭公司开除” 。

现代 LLM 通常依赖显式的文本生成过程(例如「思维链」)来进行「思考」训练。这种策略将推理任务推迟到训练后的阶段,未能充分挖掘预训练数据中的潜力。

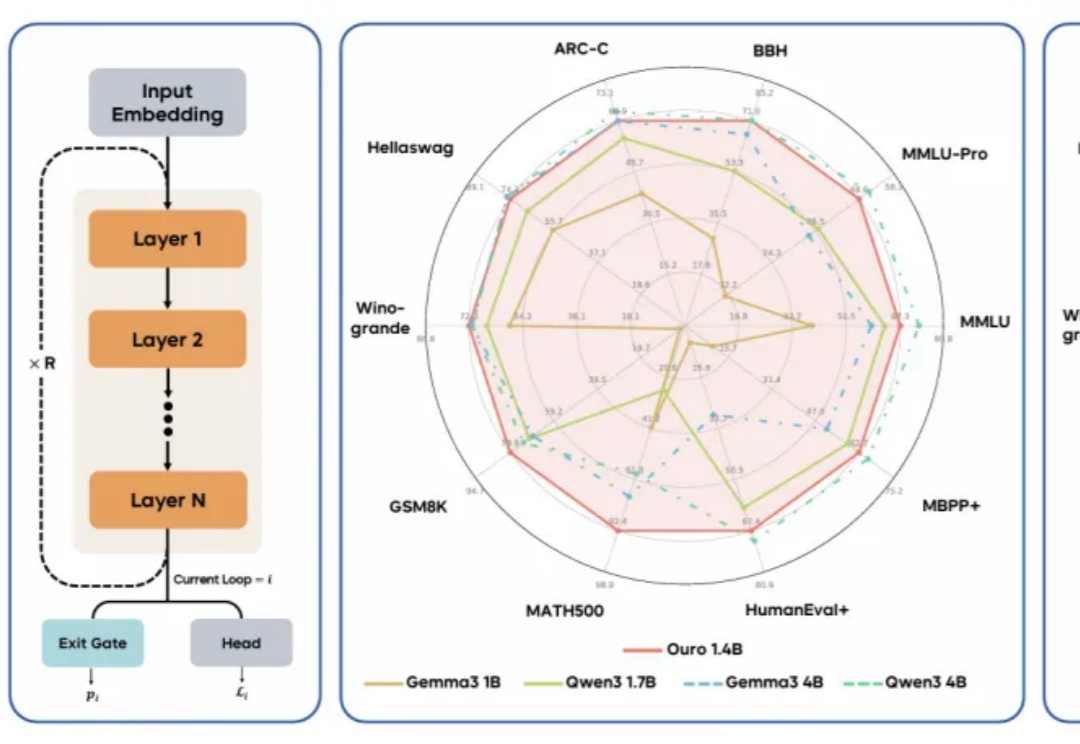

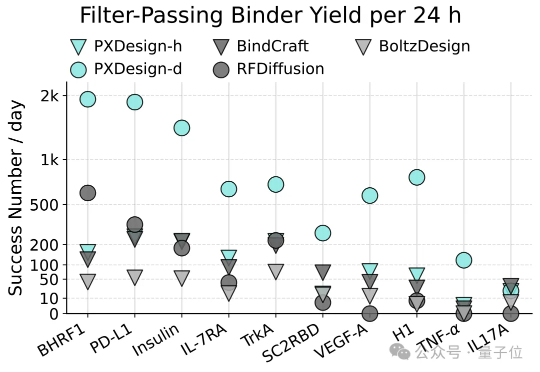

AI蛋白设计进入新阶段!最近,字节跳动Seed团队多模态生物分子结构大模型(Protenix)项目组提出了一种可扩展的蛋白设计方法,叫做PXDesign。在实际测试中,PXDesign展现出极高的效率,24小时内即可生成数百个高质量的候选蛋白,生成效率较业界主流方法提升约10倍,并在多个靶点上实现了20%–73%的湿实验成功率,达到了当前领域的领先水平。

字节跳动Seed团队联合哥伦比亚大学商学院推出了FinSearchComp,这是首个完全开源的金融搜索与推理基准测试。该基准包含635个金融专家精心设计的问题,覆盖全球和大中华两个市场,并在多个主流模型产品上进行了全面评测。

打开多模态自由创作的大门。

机器人终于不用散装大脑了! 字节Seed一个模型就能搞定机器人推理、任务规划和自然语言交互。

AI自己玩手机、玩电脑、操作网页浏览器……背后还只靠一个模型。 卷王字节Seed又把智能体带到了一个全新level~