马斯克大赞阿里 AI,9B 参数硬刚 120B,海外网友:这叫小模型?

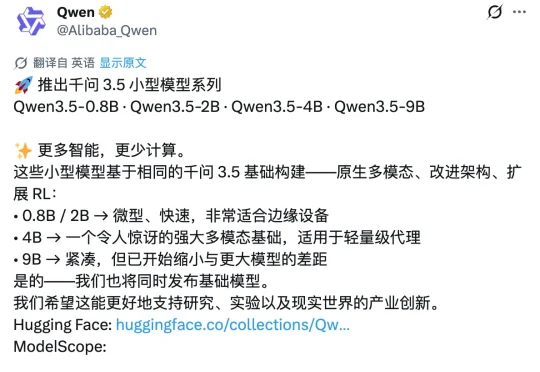

马斯克大赞阿里 AI,9B 参数硬刚 120B,海外网友:这叫小模型?昨天深夜,阿里通义千问团队在 X 平台正式发布了 Qwen3.5 小模型系列,覆盖 0.8B、2B、4B 和 9B 四个参数规格。甫一发布,便在海外科技圈引发强烈反响。马斯克也在该推文下评论称:「Impressive intelligence density」(令人印象深刻的智能密度)。这股热度的背后,APPSO 也好奇,为什么这几款小模型能够激起如此大的波澜?